点击下方卡片,关注“自动驾驶之心”公众号

静态元素自动标注方案升级

小林是公司云端模型的算法工程师,老板听说理想量产模型使用了1000W Clip的自动标注数据,安排小林做个调研,团队也需要升级一下现有的自动标注模型和链路。公司现有的链路是还是以前依赖2D标注的方式,在关键帧上标注,车端模型可以直接使用。但是标注实在是太贵了,而且存在大量重复标注的情况,并且车道线在图像上不方便标注3D空间的位置。

调研下来,原来业内已经在完整的3D场景中展开标注了,这样统一的时空下,利用位姿就可以投影到每一帧上,保证位姿的准确性就可以,并且在俯视图上车道线标注的难度大大降低,非常适合大规模铺开。

现有的方法,会先将3D场景转换为BEV视图,这样不会损失路面上的静态元素信息,但是整个BEV视图非常大,不适合模型直接训练使用。因此实际中会根据自车位姿滑动窗口截取局部地面重建图,再去训练云端的自动标注大模型,这是和车端模型最大的区别。总结来说,云端的pipeline主要有以下几个步骤:

输入3D重建结果

裁剪+转换为bev图

根据自车位姿滑动窗口截取局部地面重建图

利用maptr模型输出矢量车道线

局部矢量地图拼接refine

如下图所示:

至此,便可以得到高质量的云端自动化标注模型,后续产出的数据可以用于车端模型训练。关于静态元素自动标注的进一步详细内容,推荐学习自动驾驶之心平台打造的《自动驾驶4D标注就业小班课》!课程详细介绍了动静态、OCC和端到端自动化标注的全流程以及量产实际遇到的问题,欢迎扫码加入学习~

自动标注难在哪里?

自动驾驶数据闭环中的4D自动标注(即3D空间+时间维度的动态标注)难点主要体现在以下几个方面:

时空一致性要求极高:需在连续帧中精准追踪动态目标(如车辆、行人)的运动轨迹,确保跨帧标注的连贯性,而复杂场景下的遮挡、形变或交互行为易导致标注断裂;

多模态数据融合复杂:需同步融合激光雷达、相机、雷达等多源传感器的时空数据,解决坐标对齐、语义统一和时延补偿问题;

动态场景泛化难度大:交通参与者的行为不确定性(如突然变道、急刹)及环境干扰(光照变化、恶劣天气)显著增加标注模型的适应性挑战;

标注效率与成本矛盾:高精度4D自动标注依赖人工校验,但海量数据导致标注周期长、成本高,而自动化算法面对复杂场景仍然精度不足;

量产场景泛化要求高:自动驾驶量产算法功能验证可行后,下一步就需要推进场景泛化,不同城市、道路、天气、交通状况的数据如何挖掘,又如何保证标注算法的性能,仍然是当前业内量产的痛点;

这些难点直接制约了数据闭环的迭代效率,成为提升自动驾驶系统泛化能力与安全性的关键瓶颈。很多小白根本不知道怎么入门,没有完整的学习体系,将会处处踩坑,久久不能入门,导致最终放弃学习,错失了机会。为此我们联合行业知名4D自动标注算法专家,出品了平台首门《自动驾驶4D自动标注算法就业小班课》教程。旨在解决大家入门难,优化进阶难的问题!什么有价值我们就教什么!

全栈教程:动静态、OCC、端到端一网打尽

本课程面向想要深入自动驾驶数据闭环领域的学习者,系统讲解自动驾驶4D自动标注全流程及核心算法。结合真实落地算法,配合实战演练,全方面提升算法能力。课程核心内容如下:

全面掌握4D自动标注的整体流程和核心算法;

每章节均配套大量实战,不仅听懂更能实战;

动态障碍物检测&跟踪&问题优化&数据质检;

激光&视觉SLAM重建原理和实战演练;

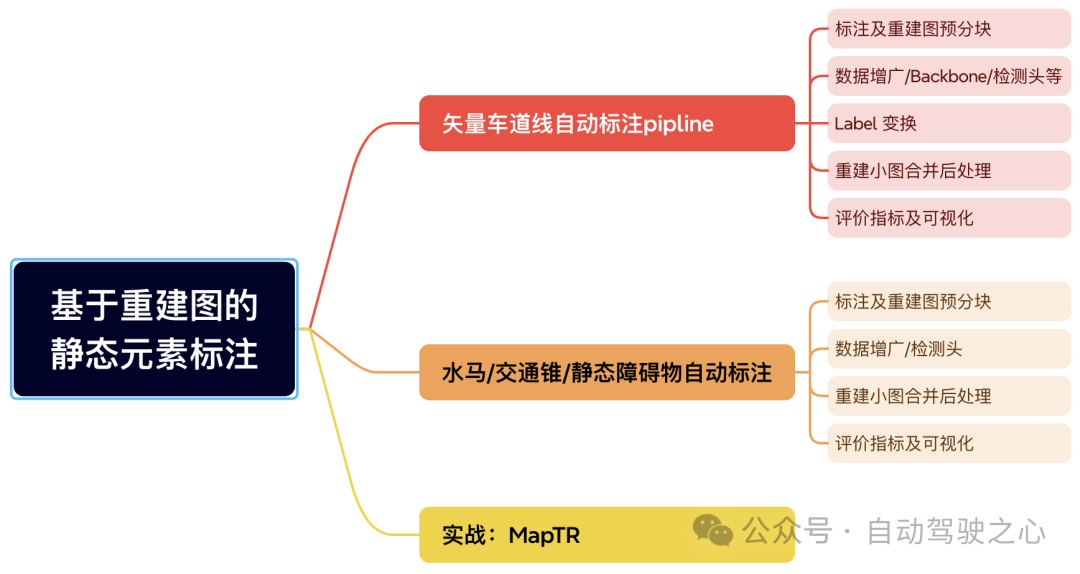

基于重建图的静态元素标注;

通用障碍物OCC的标注全流程;

端到端标注的主流范式和实战教学;

数据闭环的核心痛点及未来趋势。

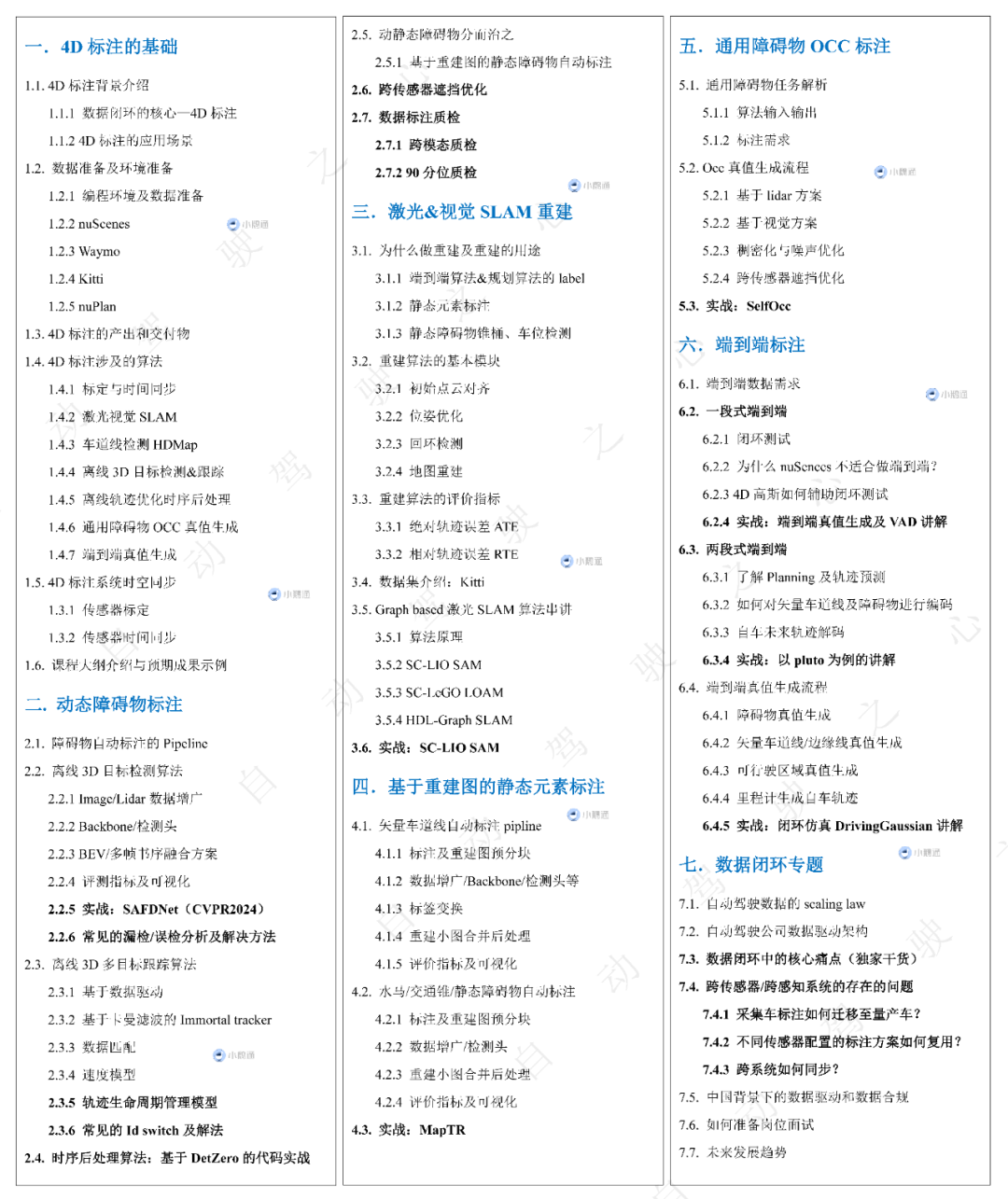

课程大纲如下:

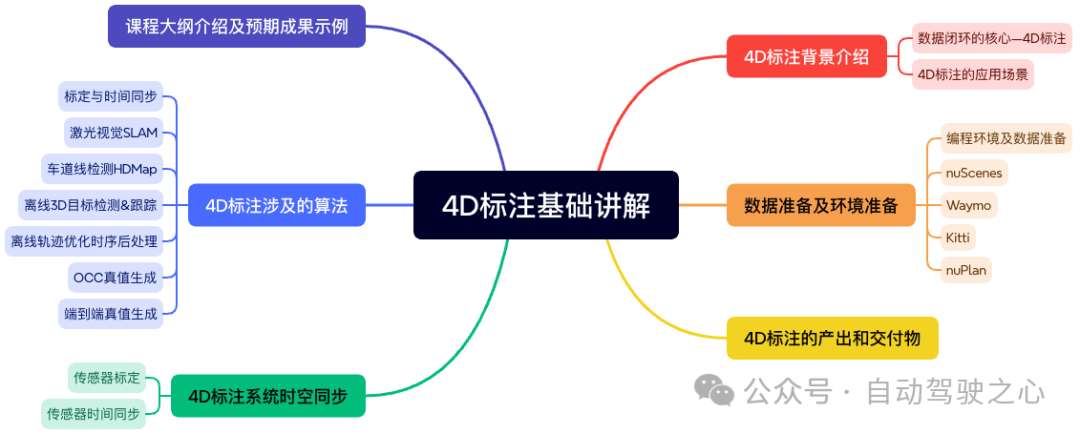

第一章 4D自动标注的基础

第一章主要介绍4D自动标注的相关基础。作为自动驾驶数据闭环的算法核心,这一章先从整体上帮助同学们了解4D自动标注是做什么的,有哪些应用场景。下一步延伸到课程所需要的数据及相关环境。然后重点介绍4D标出的交付物和涉及的诸多算法,从更高的层级认识4D自动标注。我们为什么需要这些算法,他们的作用究竟是什么。最后则重点介绍系统时空同步,传感器标定怎么做,时间同步如何保证精度。都会在第一章得到答案!

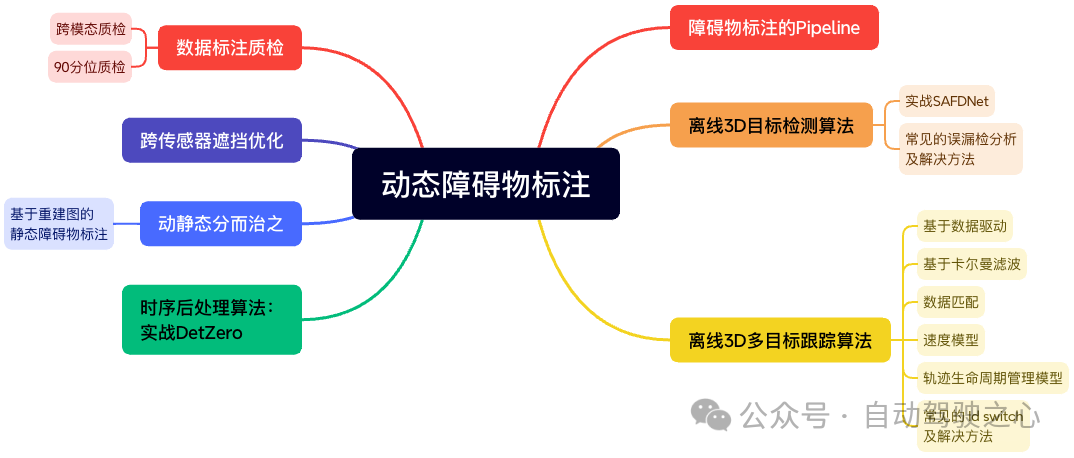

第二章 动态障碍物标注

第二章正式进入到动态障碍物标注的相关内容。首先介绍动态障碍物标注的整体流程。然后重点讲解离线3D目标检测算法,常用检测算法的Image/Lidar数据增广怎么做、Backbone/检测头有哪些、BEV/多帧时序融合方案是哪些,老师都会一一介绍!之后实战聚焦在CVPR 2024的SAFDNet算法,让大家实际感受下3D检测算法的输出是什么,以及面对工程上最常见的误漏检问题我们都有哪些解决方法!下一步则展开讲解3D多目标跟踪算法,数据匹配怎么做、速度模型如何实现、轨迹的生命周期如何管理、ID跳变如何解决,全都是问题!全都有答案!!!进一步老师会展开时序后处理算法DetZero的实战讲解,以及实际工程中遇到传感器遮挡时如何优化。最后则是数据质检部分,结果好不好,质检来把关。

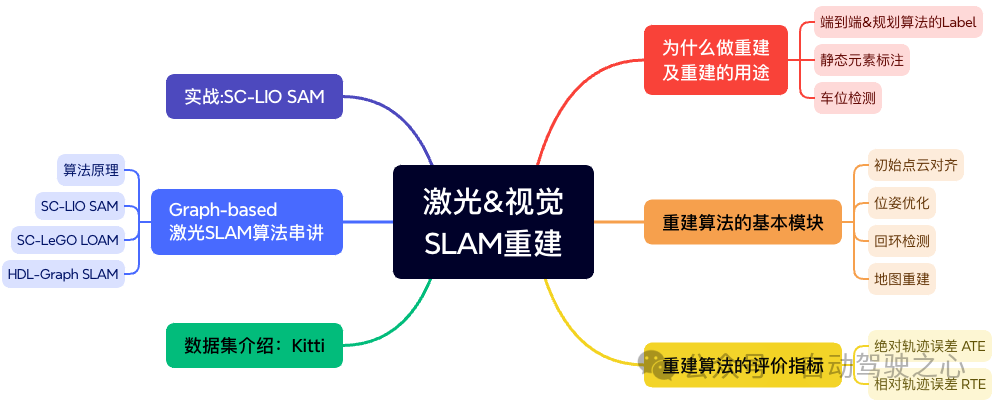

第三章 激光&视觉SLAM重建

第三章的内容聚焦在激光&视觉SLAM重建。我们首先回答一个问题:为什么要做重建?在4D自动标注中都有哪些用途?先把这个问题搞清楚,咱们在进一步介绍重建算法的基本模块和评价指标。然后讲解Graph-based的常用激光SLAM算法。

第四章 基于重建图的静态元素标注

第四章承上启下关注静态元素的自动化标注。静态元素和动态标注不同,动态元素需要单帧检测再通过跟踪把时序的结果串起来。如果静态元素也采用单帧感知,投影得到的整条道路则可能会存在偏差。所以基于第三章SLAM的重建输出,我们就可以得到全局clip的道路信息,进而基于重建图的得到静态元素的自动化标注结果。

第五章 通用障碍物OCC标注

第五章聚焦在通用障碍物OCC标注上。自从2022年特斯拉宣布Occupancy Network量产以来,OCC基本上成为了自动驾驶感知的标配。所以第五章我们聚焦在通用障碍物OCC标注上。我们首先解析通用障碍物算法的输入输出和标注需求。再进一步讲解OCC真值的生成流程,基于lidar的方案怎么做、基于视觉的方案怎么做、工程上如何稠密化点云和优化噪声、跨传感器遮挡的场景如何优化。都会在这一章得到答案!

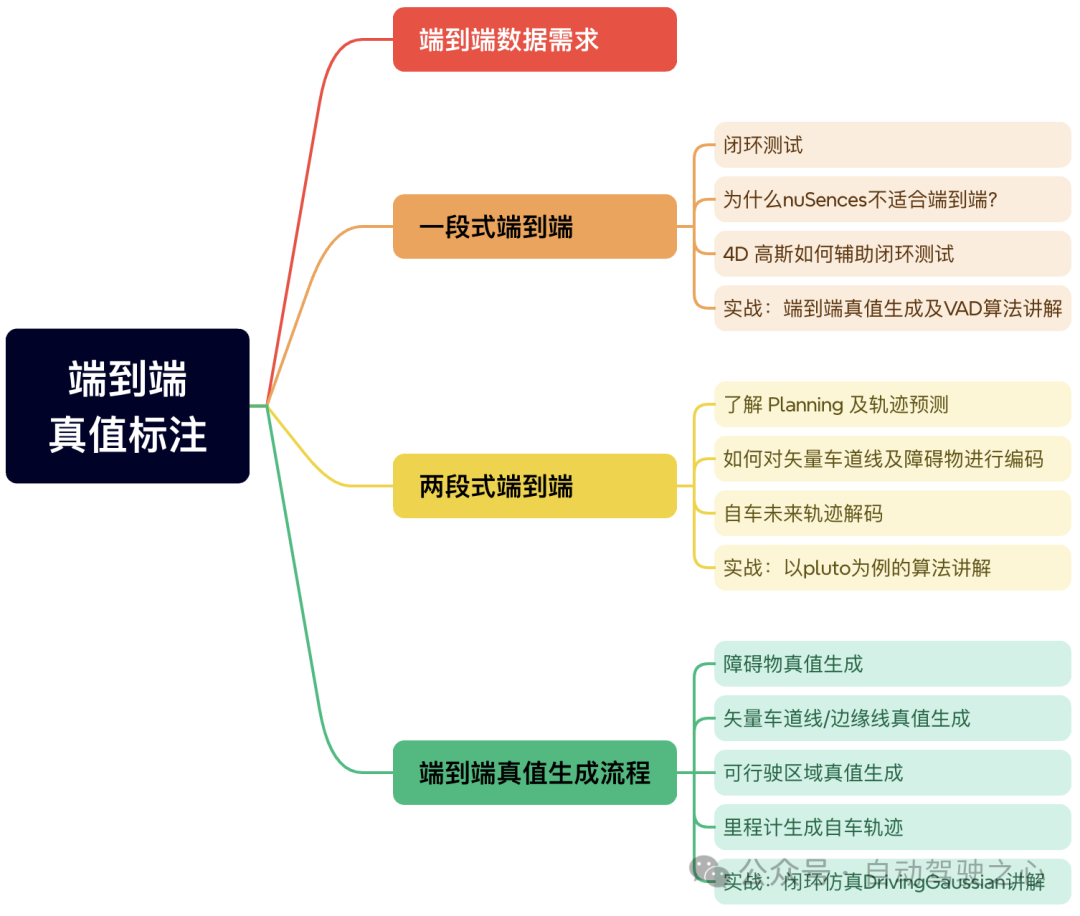

第六章 端到端真值标注

第六章则是咱们课程最重要的章节:端到端真值生成!首先明确下端到端的数据需求,然后进一步展开讲解业内应用最广泛的一段式和两段式端到端如何实现?最后则是把端到端真值生成的流程整体串起来:动态障碍物、静态元素、可行驶区域、自车轨迹全部打通!老师还特别准备了闭环仿真DrivingGaussian算法的讲解,闭环仿真是端到端自动驾驶的刚需,在4D自动标注的基础上,进一步扩展同学们的视野。总结来说第六章三大实战,全面搞定端到端真值生成!

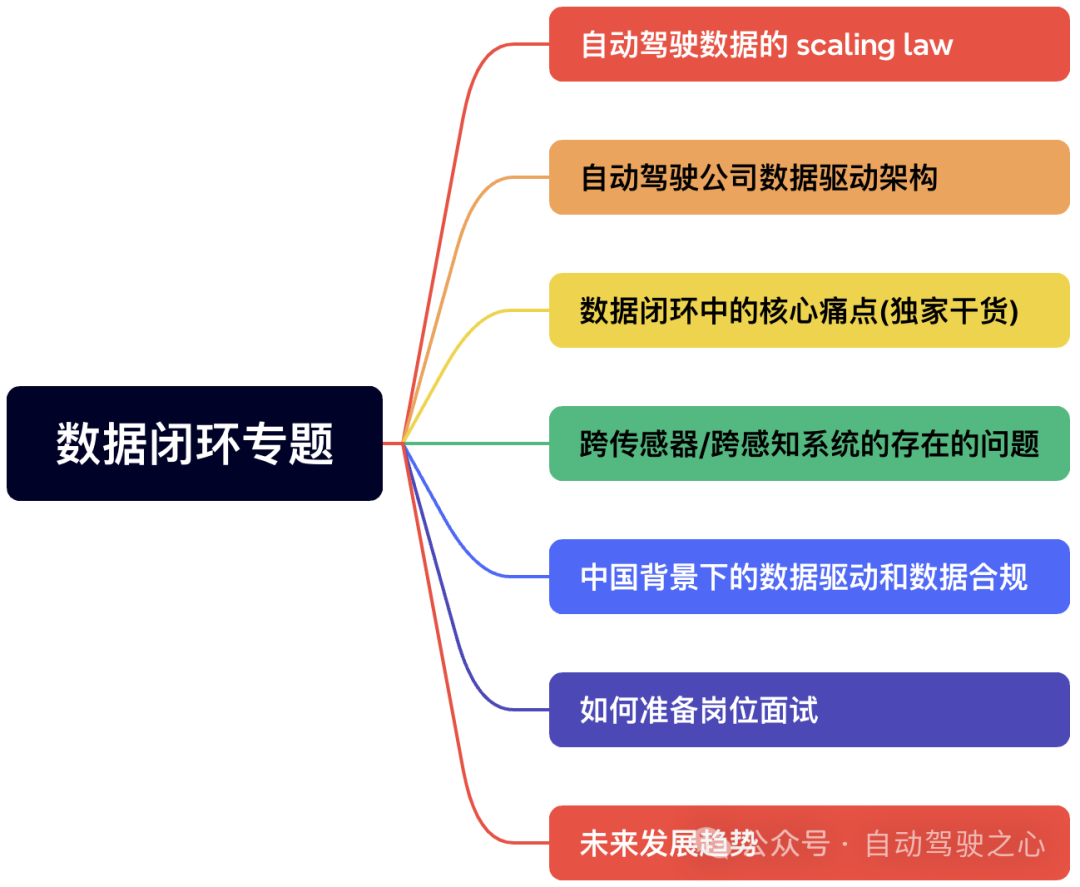

第七章 数据闭环专题

有了前面六个章节的算法基础,第七章我们聚焦在更高层面的经验输出,这一章都是实打实老师工作多年的经验积累。自动驾驶数据的scaling law还奏效么?业内主流公司的数据驱动架构是怎样的?数据闭环当前面临哪些痛点?跨传感器/跨感知系统又存在什么问题?我们又如何准备相关岗位的面试,什么内容是公司真正关注的?在这一章都会有答案!

讲师介绍

Mark老师!c9院校硕士毕业,业内一线大厂数据闭环算法专家。从事自动驾驶感知算法多年,聚焦于多模态3D感知、数据闭环等方向。在4D自动标注算法开发、工程化落地上具有丰富经验。参与过多个量产交付项目,已发表多篇量产专利和专业论文。

课程收获

掌握4D自动标注的落地全流程;

掌握4D自动标注学术界&工业界的前沿算法;

具备4D自动标注算法研发的实际能力;

具备4D自动标注解决实际问题的能力;

提升工作核心竞争力。

授课方式 & 课程计划

课程模式:

线上录播

配套资料、源码示例

微信群内答疑

购买后1年有效,可反复观看

退款说明:课程为虚拟商品,购买后不支持退款

适合人群

高校研究人员与学生;

初创企业技术团队;

企业技术专家、骨干;

想要转行从事数据闭环的同学;

所需基础

一定的深度学习与自动驾驶感知算法基础;

了解Transformer模型结构;

Python和PyTorch基础,具备代码读写的能力;

需要自备GPU,显存不低于12G;

课程咨询

备战秋招!扫码学习课程~

9702

9702

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?