今天是春节后的第一篇原创,关于多任务学习,AAAI2023的work,如果您有相关工作需要分享,请在文末联系我们!

论文名称:Deformable Mixer Transformer for Multi-Task Learning of Dense Prediction

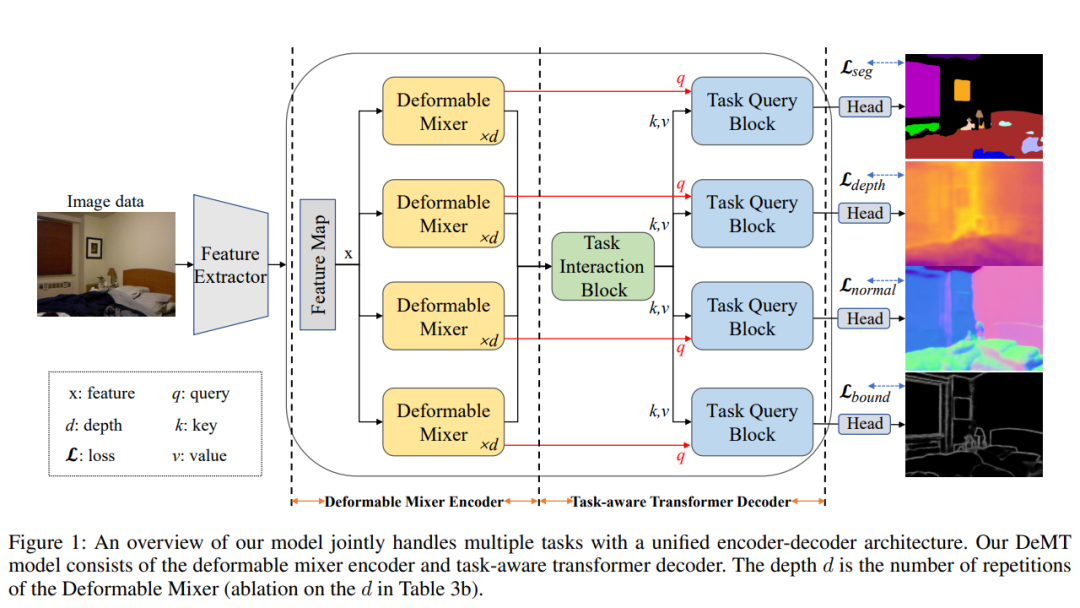

卷积神经网络(CNN)和Transformer具有各自的优势,它们都被广泛用于多任务学习(MTL)中的密集预测。目前对MTL的大多数研究仅依赖于CNN或Transformer,本文结合了可变形CNN和query-based 的Transformer优点,提出了一种新的MTL模型,用于密集预测的多任务学习,基于简单有效的编码器-解码器架构(即,可变形混合器编码器和任务感知transformer解码器),称之为DeMT。首先,可变形混合器编码器包含两种类型的算子:信道感知混合算子,用于允许不同信道之间的通信(即,有效的信道位置混合),以及空间感知可变形算子,其可变形卷积应用于有效地采样更多信息的空间位置(即,变形特征)。第二,任务感知transformer解码器由任务交互block和任务查询block组成。前者用于通过自关注来捕捉任务交互特征,后者利用变形特征和任务交互特征,通过基于查询的Transformer生成相应的任务特定特征,用于相应的任务预测。在两个密集图像预测数据集NYUD-v2和PASCAL Context上的大量实验表明,本文的模型使用更少的GFLOP,但在各种指标上显著优于当前基于Transformer和CNN的模型。

代码:https://github.com/yangyangxu0/DeMT.

1领域背景介绍

人类视觉可以从一个视觉场景执行不同的任务,如分类、分割、识别等。因此,多任务学习(MTL)研究是计算机视觉领域的热点。期望开发一个强大的视觉模型,以在不同的视觉场景中同时执行多个任务,有望高效工作。如图1所示,本文旨在开发一个强大的视觉模型同时学习多个任务,包括语义分割、人体部位分割、深度估计、边界检测、显著性估计和normal estimation。

尽管基于CNN的MTL模型被谨慎地提出以在多任务密集预测任务上实现有希望的性能,但这些模型仍然受到卷积运算的限制,即缺乏全局建模和跨任务交互能力。一些工作(Bruggemann et al.2021;Vandenhende et al.2020)开发了一种蒸馏方案,通过扩大感受野和堆叠多个卷积层来增加跨任务和全局信息传递的表达能力,但仍然无法直接建立全局依赖性。为了建模全局和跨任务交互信息,基

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

863

863

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?