点击下方卡片,关注“自动驾驶之心”公众号

ADAS巨卷干货,即可获取

点击进入→自动驾驶之心技术交流群

后台回复【RV融合】获取论文!

后台回复【领域综述】获取自动驾驶全栈近80篇综述论文!

自动驾驶在复杂场景下的目标检测任务至关重要,而毫米波雷达和视觉融合是确保障碍物精准检测的主流解决方案。本论文详细介绍了基于毫米波雷达和视觉融合的障碍物检测方法,从任务介绍、评估标准和数据集三方面展开。

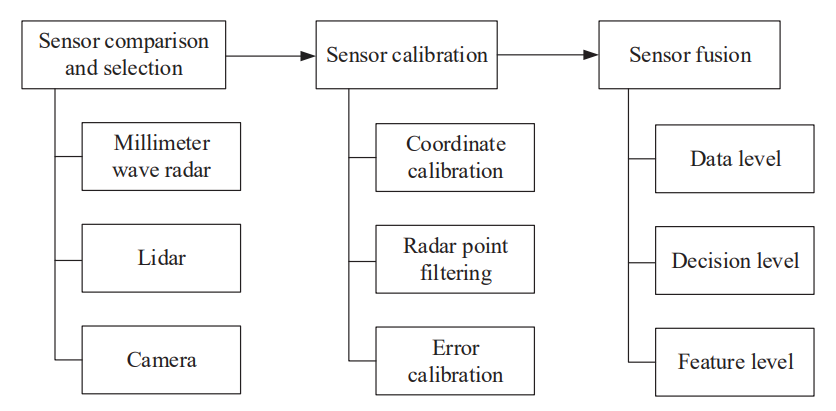

并对毫米波雷达和视觉融合过程的传感器部署、传感器标定和传感器融合(融合方法分为数据级、决策级和特征级融合方法)三个部分进行了汇总讨论。

此外,还介绍了三维(3D)目标检测、自动驾驶中的激光雷达和视觉融合以及多模态信息融合,并进行了展望。

1背景介绍

较高level的自动驾驶车辆面临的挑战之一是复杂场景中的精确目标检测,当前的视觉目标检测算法已经达到了性能上限,因为检测算法在实践中面临非常复杂的情况。

对于自动驾驶场景,障碍物主要包括行人、汽车、卡车、自行车和摩托车,视觉范围内的障碍物具有不同的尺度和长宽比。此外,障碍物之间可能存在不同程度的遮挡,并且由于暴雨、大雪和大雾等极端天气,障碍物的外观可能会模糊,从而导致检测性能大大降低[13]。研究表明,CNN对未经训练的场景泛化能力较差[14]。

camera不足以独立完成自动驾驶感知任务,与视觉传感器相比,毫米波雷达的检测性能受极端天气的影响较小[15]、[16]。此外,毫米波雷达不仅测量距离,还可以利用运动物体反射信号的多普勒效应测量速度矢量[17]、[18]。然而,毫米波雷达无法提供目标的轮廓信息,并且难以区分相对静止的目标。从这个方面看,视觉传感器和毫米波雷达的探测能力可以相互补充。基于毫米波雷达和视觉融合的检测算法可以显著提高自主车辆的感知能力,帮助车辆更好地应对复杂场景中的目标检测任务。

基于毫米波雷达和视觉融合的目标检测过程如下图所示,毫米波雷达与视觉融合过程包括三个部分:传感器选择、传感器标定和传感器融合,为了实现毫米波雷达和视觉融合目标检测的预期性能,需要解决以下挑战:

-

同一时间和空间的标定校准;

-

融合不同传感器的数据以实现best性能的目标检测;

最近几年,大部分综述集中在视觉检测上,很少有radar-camera融合相关的paper,对雷达和视觉融合缺乏深入分析,本论文将重点介绍低成本毫米波雷达和视觉融合解决方案。

2检测任务定义

二维(2D)目标检测使用2D box在车辆的视觉图像中选择检测到的障碍物目标,然后对目标进行分类和定位。这里的定位指的是图像中目标的定位,而不是真实世界中目标相对于车辆的定位。

在三维(3D)目标检测中,使用3D box定位目标,不仅是图像中确定目标的位置,而且还确定了现实世界中目标的姿态和位置。

3评价标准

主要使用AP和AR权衡目标检测中的准确度和召回率,通过将召回值和精度值分别作为水平轴和垂直轴,可以获得精度召回(PR)曲线,平均精度(mAP)表示检测模型的合并结果,可通过计算所有类别的平均AP值获得。

以自动驾驶KITTI数据集为例,对于2D对象检测,通过比较检测边界框和gt边界框之间的IoU是否大于阈值来确定目标定位的正确性[22]。然而在自主驾驶的研究中,三维目标检测目前更具吸引力。KITTI正式规定,对于车辆,正确预测要求预测的3D框与真实3D框重叠70%以上,而对于行人和自行车,则要求3D框重叠50%[24]。

4相关数据集

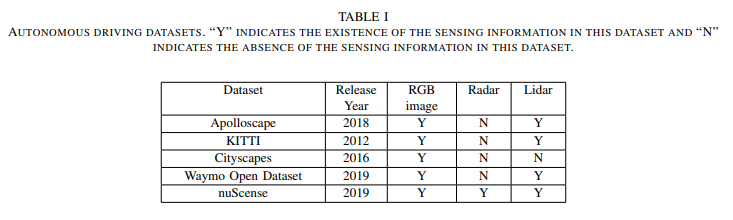

相关数据集主要包括:Apolloscape、KITTI、Cityscapes、Waymo Open Dataset、nuScenes等;

Apolloscape

百度在2017年创建的阿波罗开放平台的part,它使用Reigl激光雷达收集点云,Reigl生成的

本文综述了毫米波雷达与视觉融合在自动驾驶目标检测中的应用,探讨了融合方法及面临的挑战,强调了3D目标检测的重要性。

本文综述了毫米波雷达与视觉融合在自动驾驶目标检测中的应用,探讨了融合方法及面临的挑战,强调了3D目标检测的重要性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1437

1437

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?