**

实验报告七 Spark安装配置

**

一、首先在Windows下下载Scala和Spark

官网下载安装Spark:spark-2.4.2-bin-hadoop2.7.tgz

https://www.scala-lang.org/download/

官网下载安装Scala:Spark:spark-2.4.2-bin-hadoop2.7.tgz

https://www.scala-lang.org/download/

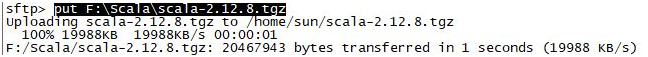

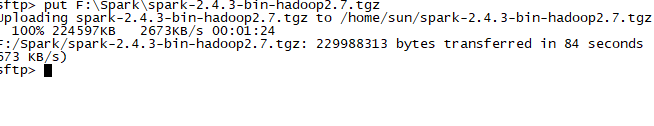

二、传输

将压缩包从Windows传输到Linux当前目录下:

put G:\spark\scala-2.12.8.tgz

put G:\spark\spark-2.4.3-bin-hadoop2.7.tgz

三、解压

tar -zxvf scala-2.12.8.tgz -C /home/shui

tar -zxvf spark-2.4.3-bin-hadoop2.7.tgz -C /home/shui

这篇实验报告详细介绍了如何在Linux环境下安装和配置Spark。首先从官方网站下载Scala和Spark的安装包,然后通过WinSCP将它们传输到Linux系统。接着进行解压并重命名,确保Scala和Spark的可执行文件路径简洁。通过执行`scala -version`验证Scala安装成功,再启动Hadoop和Spark环境。最后,使用Spark Shell进行交互式编程,演示了读取本地文件、显示内容和进行词频统计的基本操作。

这篇实验报告详细介绍了如何在Linux环境下安装和配置Spark。首先从官方网站下载Scala和Spark的安装包,然后通过WinSCP将它们传输到Linux系统。接着进行解压并重命名,确保Scala和Spark的可执行文件路径简洁。通过执行`scala -version`验证Scala安装成功,再启动Hadoop和Spark环境。最后,使用Spark Shell进行交互式编程,演示了读取本地文件、显示内容和进行词频统计的基本操作。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2841

2841

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?