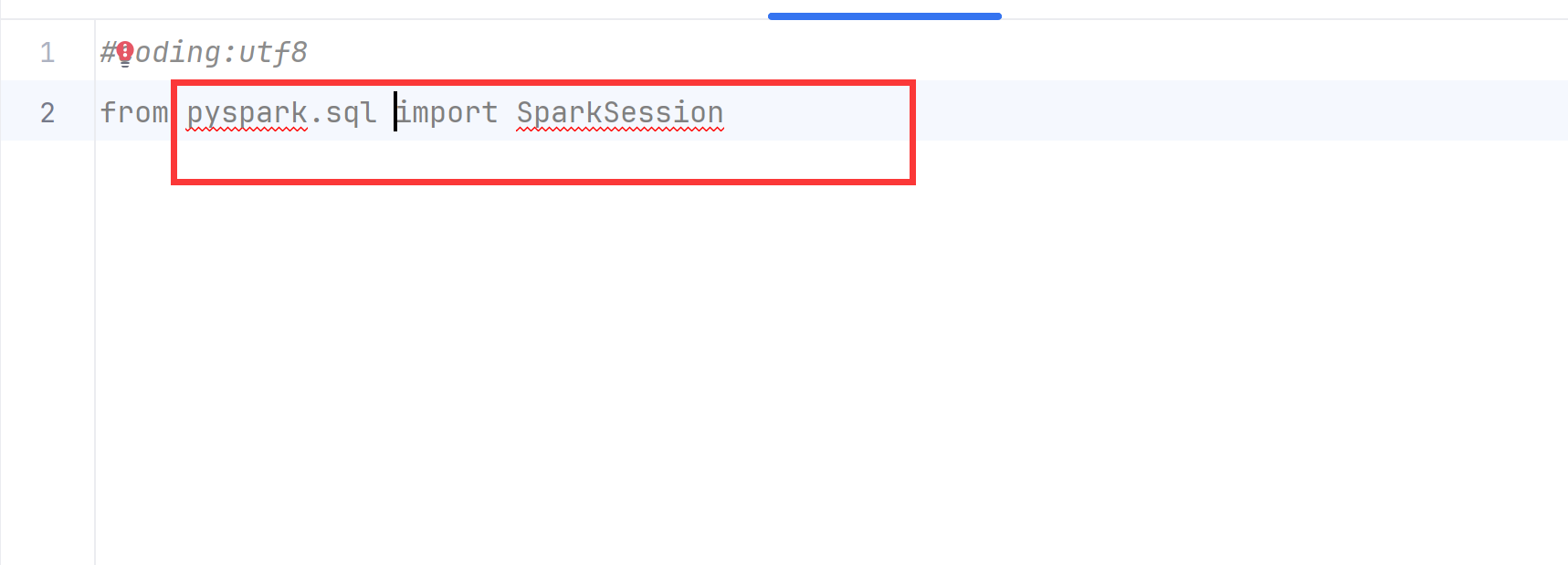

当你通过pycharm连接到虚拟机中并在虚拟机中部署好了hadoop,spark,hive等等一些环境,但是在pycharm中需要应用pyspark库,但是显示一直未下载这个库就会显示以下报错

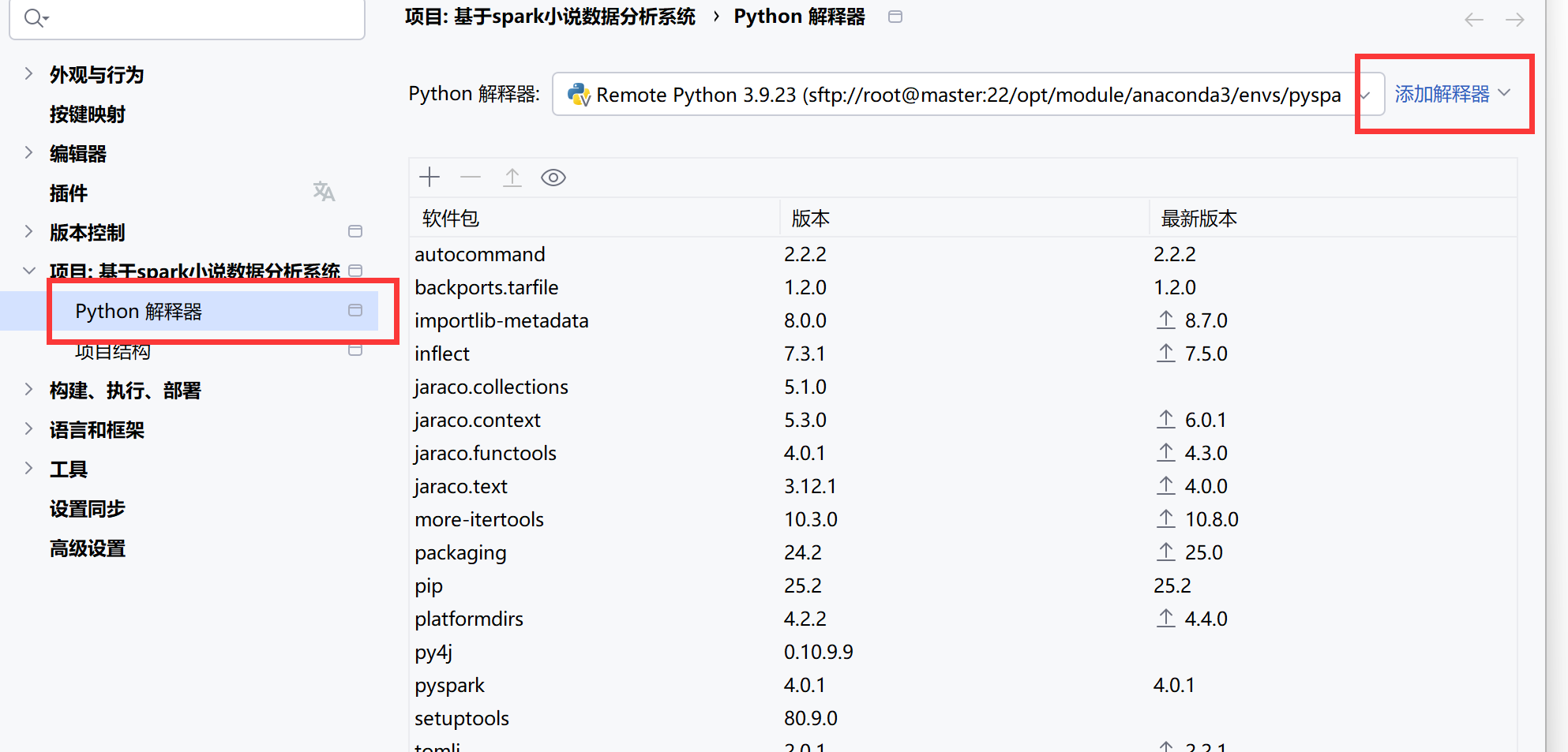

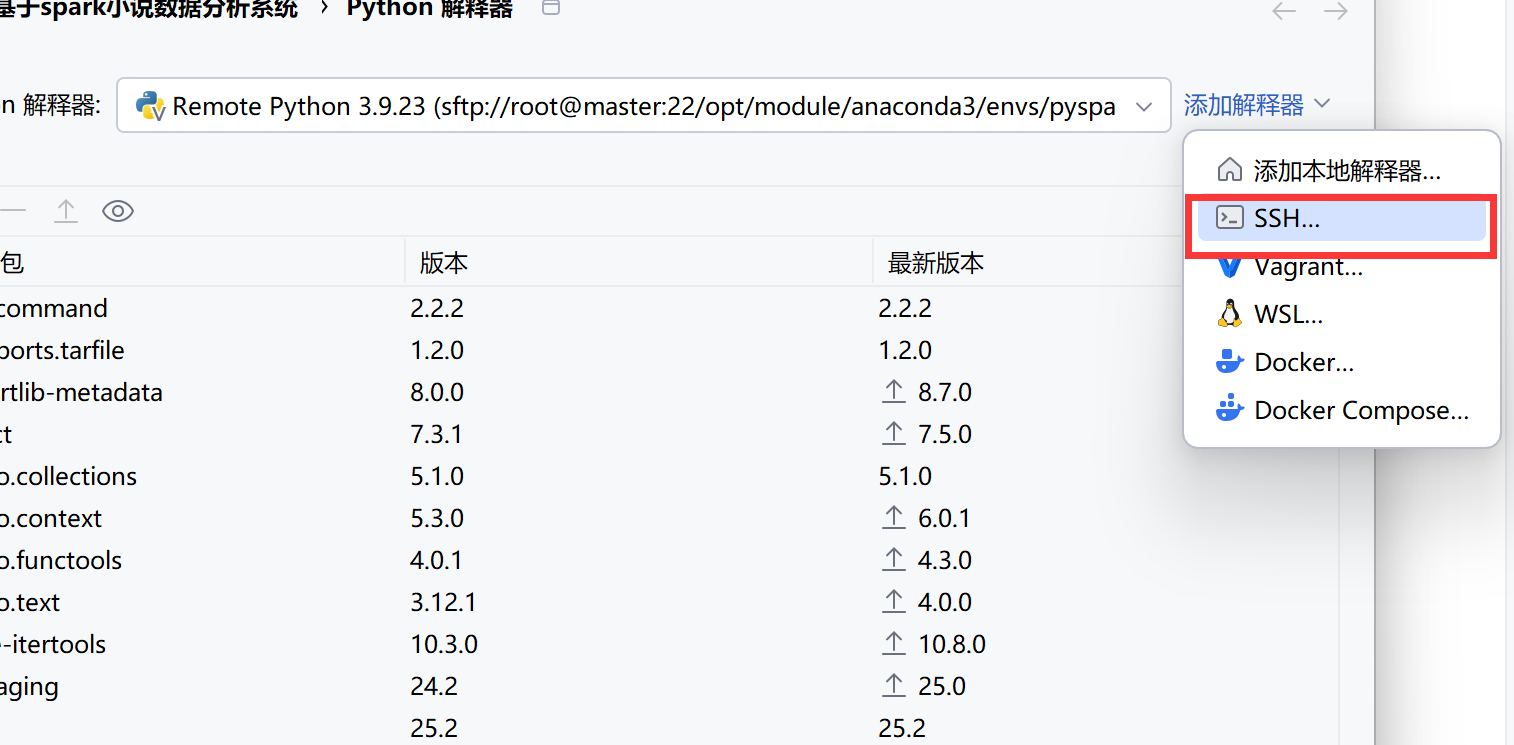

首先我们通过pycharm连接虚拟机的时候会有一个路径

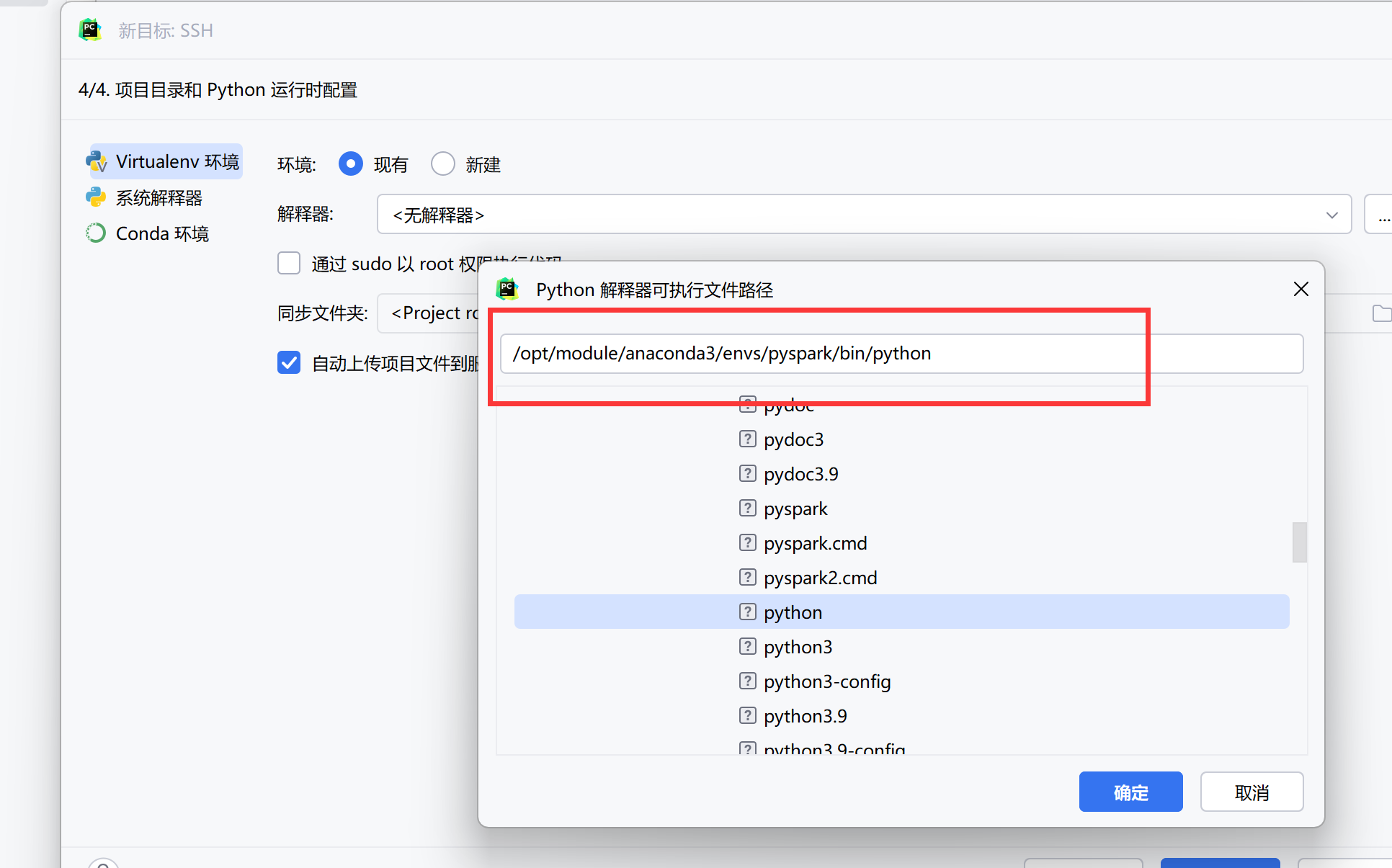

然后将主机名,密码,用户配置好之后找到你在部署集群中下载的python解释器的位置

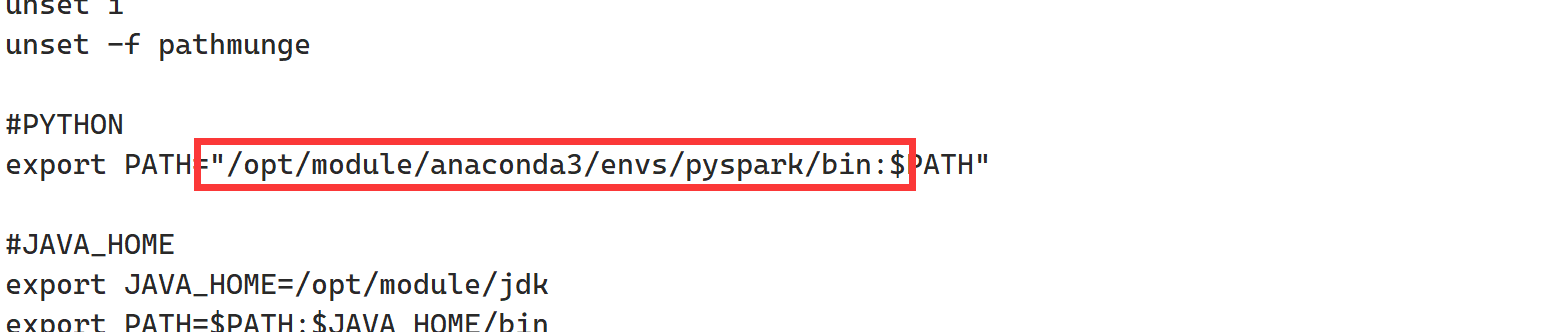

之后回到我们的虚拟机当中,在下载pyspark库中我们需要确认我们系统中python的环境变量是否一致,不一致我们需要在/etc/profirce中配置,配置完成之后source /etc/profirce刷新

!!!记住配置的这个路径要与你在pycharm中链接虚拟机的python解释器的库要一致!!!

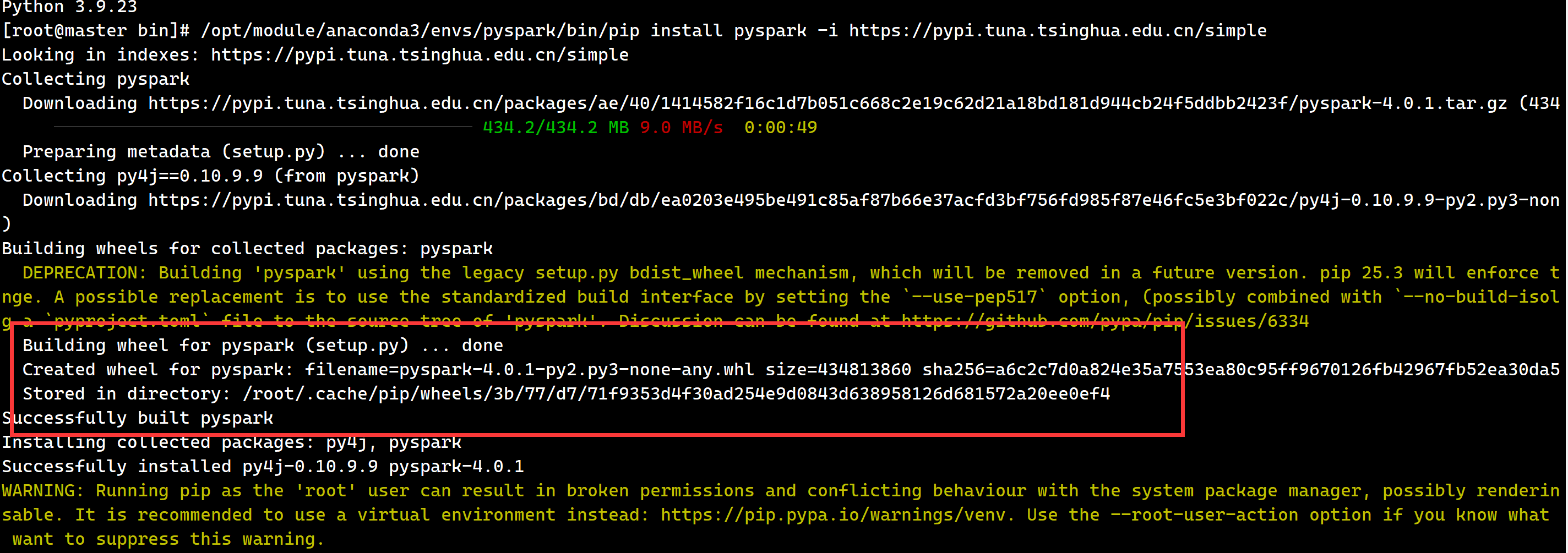

之后我们使用这个命令来下载我们的pyspark,下载时我们采用清华镜像源下载会快速一点哟

[root@master bin]# /opt/module/anaconda3/envs/pyspark/bin/pip install pyspark -i https://pypi.tuna.tsinghua.edu.cn/simple

等待下载过程看到成功

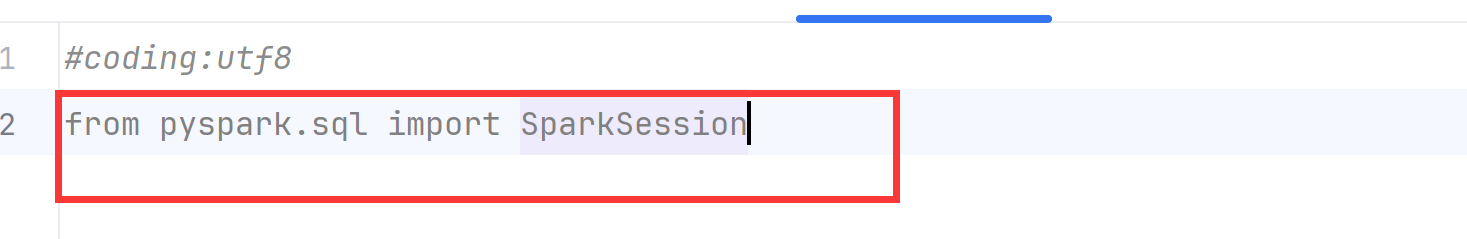

最后我们回到pycharm中查看pyspark是否安装成功

可以看到已经成功安装并且不报错啦

6505

6505

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?