LangChain 是一个功能强大的大模型应用工具, 基于它的模块化结构,我们可以方便地生成各种功能的应用程序。本篇手把手教大家如何安装和使用LangChain + Ollama。有意于用大模型搭建本地对话系统或者AI Agent 的同学可以好好体验一下,以下操作基于Linux系统,用Window系统的同学也可参考。

0****1

安装Ollama+llama3.1:8b

安装比较简单,根据官网指引,在终端中输入以下指令:

1. curl -fsSL https://ollama.com/install.sh | sh``2. ollama pull llama3.1:8b

02

安装LangChain

1. langchain 需要使用python 编写程序,记得要先安装python3

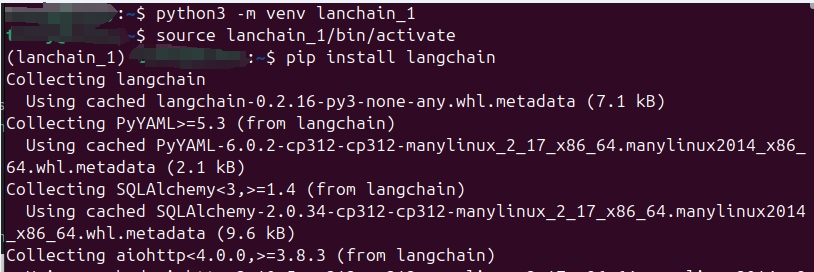

2. 建议先建立python 虚拟环境,在虚拟环境中执行,可以避免各种软件包版本依赖问题。

我们在home文件夹中建立 lanchain_1 的文件夹,作为虚拟文件夹,在终端中执行:

python3 -m venv lanchain_1``source lanchain/bin/activate

见上图,虚拟环境的文件夹名称表示为:

(lanchain_1)$xxx@xxx:~$

见上图,

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1266

1266

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?