PPO(Proximal Policy Optimization,近端策略优化)是一种常见的强化学习算法,尤其用于训练语言模型,特别是在需要进行模型优化以符合特定目标时。在语言模型的微调过程中,PPO被用来通过人类反馈、情感分析或其他奖励机制来改善模型的输出质量。在这篇文章中,我们将详细介绍PPO如何运作,特别是如何用它来微调GPT-2模型以生成积极的IMDB电影评论。

一、PPO的基本原理

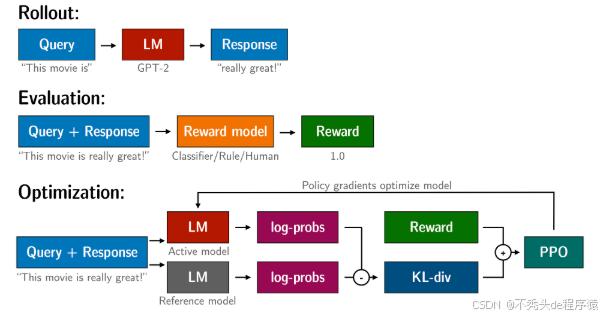

PPO 是一种基于强化学习的优化算法,它通过多个步骤来不断调整策略网络(在这里是语言模型)以生成更符合预期目标的输出。PPO的工作流程大致如下:

- Rollout(回放): 语言模型根据给定的输入(query)生成一个响应(response)。

- Evaluation(评估): 对生成的查询和响应进行评估,评估的方式可以是使用一个预训练的分类器(比如BERT进行情感分析),也可以结合人工反馈。评估结果为每个查询/响应对生成一个标量奖励值。

- Optimization(优化): 通过对生成的查询/响应对计算序列中标记的对数概率,并根据训练模型与参考模型之间的KL散度(Kullback-Leibler Divergence)来进行优化,确保生成的响应不会偏离参考语言模型太远。通过这种方式,PPO优化模型,以使其生成更符合目标的输出。

为了实现这一目标,我们需要将PPO的优化流程应用到GPT-2上,目标是使生成的电影评论更加积极。

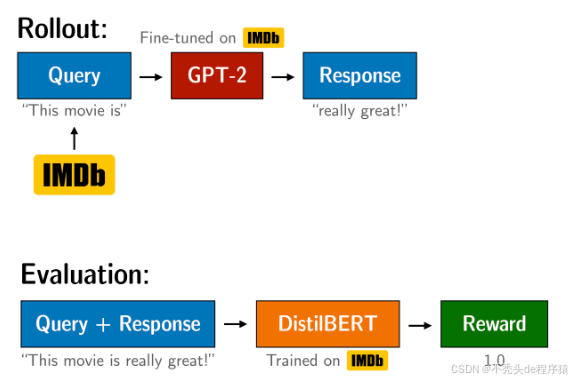

二、微调GPT-2生成积极评论

我们使用IMDB数据集进行训练,该数据集包含50,000条电影评论,已标注为“积极”或“消极”。在这个实验中,我们微调GPT-2模型,使其生成积极的电影评论。GPT-2在输入时只接受评论的开头部分,模型需要生成后续的内容。为了确保生成的评论积极,我们使用BERT情感分类器来分析生成的句子情感,并将分类器的输出作为PPO训练的奖励信号。

实验步骤

1、下载并准备数据:

首先,我们需要从Hugging Face下载IMDB数据集,并加载相应的模型。

export HF_ENDPOINT=https://hf-mirror.com

huggingface-cli download --resume-download stanfordnlp/imdb --local-dir dataset/imdb --repo-type dataset

huggingface-cli download --resume-download lvwerra/gpt2-imdb --local-dir model/gpt2-imdb

huggingface-cli download --resume-download lvwerra/distilbert-imdb --local-dir model/distilbert-imdb

2、配置PPO和训练环境:

我们通过设置PPO的配置文件来定义模型、学习率等参数,并初始化训练环境。

from trl import PPOTrainer, PPOConfig, AutoModelForCausalLMWithValueHead

config = PPOConfig(

model_name="model/gpt2-imdb",

learning_rate=1.41e-5,

log_with="wandb",

)

ppo_trainer = PPOTrainer(config, model, ref_model, tokenizer, dataset=dataset, data_collator=collator)

3、情感分析:

为了为模型提供奖励信号,我们加载一个BERT分类器,这个分类器会分析生成的文本情感,并返回一个正面或负面的评分。

sentiment_pipe = pipeline(

"sentiment-analysis", model="model/distilbert-imdb", device=device

)

4、生成文本:

对于每一个输入的查询,GPT-2将生成一段响应。为了控制生成的文本长度和多样性,我们设置了相关的生成参数,并确保使用采样(sampling)方法生成响应。

gen_kwargs = {

"min_length": -1,

"top_k": 0.0,

"top_p": 1.0,

"do_sample": True,

"pad_token_id": tokenizer.eos_token_id,

}

5、PPO优化过程:

训练的核心部分是在PPO优化的框架下执行的。每一轮训练中,PPO会使用查询和响应的三元组(query, response, reward)来更新策略网络,并计算与参考模型之间的KL散度。

for epoch, batch in enumerate(tqdm(ppo_trainer.dataloader)):

query_tensors = batch["input_ids"]

# 生成响应

response_tensors = []

for query in query_tensors:

gen_len = output_length_sampler()

query_response = ppo_trainer.generate(query, **generation_kwargs).squeeze()

response_len = len(query_response) - len(query)

response_tensors.append(query_response[-response_len:])

batch["response"] = [tokenizer.decode(r.squeeze()) for r in response_tensors]

# 计算情感得分

texts = [q + r for q, r in zip(batch["query"], batch["response"])]

pipe_outputs = sentiment_pipe(texts, **sent_kwargs)

positive_scores = [

item["score"]

for output in pipe_outputs

for item in output

if item["label"] == "POSITIVE"

]

rewards = [torch.tensor(score) for score in positive_scores]

# 进行PPO优化

stats = ppo_trainer.step(query_tensors, response_tensors, rewards)

ppo_trainer.log_stats(stats, batch, rewards)

三、结果展示

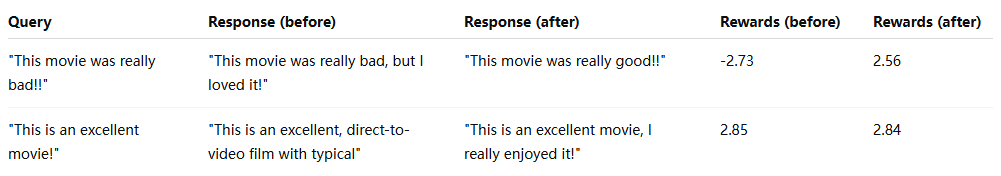

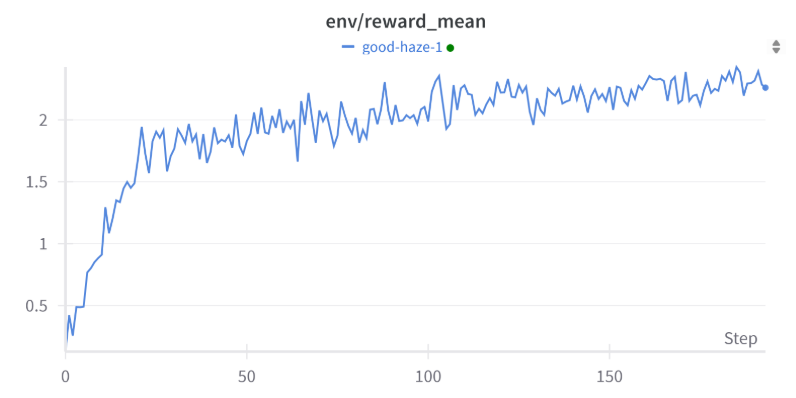

经过多轮训练后,我们观察到模型在生成的评论情感上有了显著的提高。例如,在未优化和优化后的评论之间,我们可以看到情感得分的差异。

从上表可以看出,优化后的模型生成的评论情感更加积极,奖励得分也有了明显的提升。

四、后续工作

训练完成后,我们将优化后的模型保存以供后续使用:

model.save_pretrained("model/gpt2-imdb-pos-v2")

tokenizer.save_pretrained("model/gpt2-imdb-pos-v2")

这样,微调后的GPT-2模型可以用来生成更多符合情感需求的文本,应用于各种实际场景中。

五、总结

PPO通过引入情感分析等外部奖励信号来优化语言模型,从而使得模型能够生成符合特定目标的内容。通过PPO优化,我们可以训练GPT-2等语言模型以生成积极的电影评论。在实际应用中,PPO提供了一种有效的手段来微调大规模语言模型,使其在特定任务上表现更好。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

01 教学内容

-

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

PPO微调GPT-2生成积极影评

PPO微调GPT-2生成积极影评

443

443

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?