当LangChain成为技术债:你的AI架构还撑得过明年吗?

引言

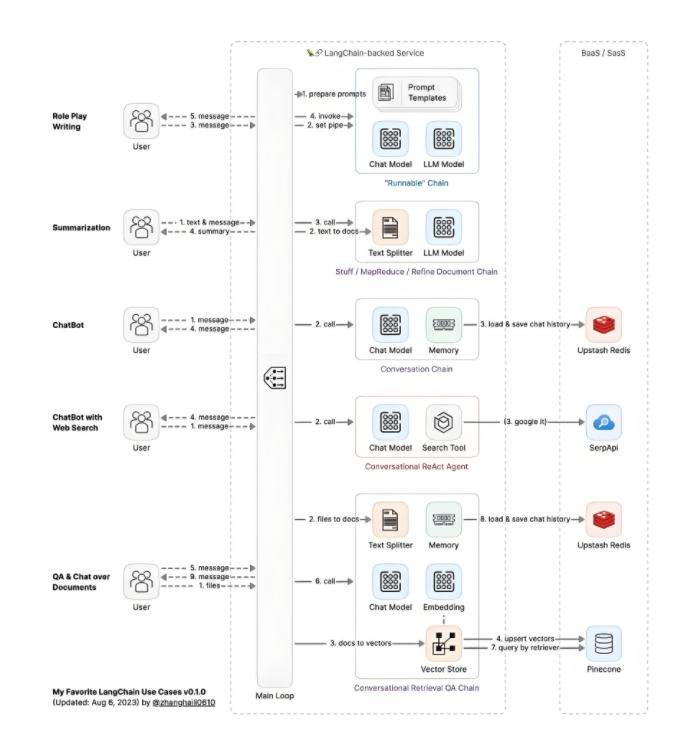

在过去的18个月里,LangChain无疑成为AI工程领域的耀眼明星——GitHub星标爆炸性增长、开发者峰会座无虚席、各种基于LangChain的创业公司如雨后春笋涌现。作为深度参与AI工程化的实践者,我亲眼见证它如何改变我们构建LLM应用的方式,但也深刻感受到整个行业正在经历一场痛苦的拐点:LangChain正从解决方案本身演变为新问题的来源。

一、LangChain的原始魅力:AI工程的“第一次抽象”

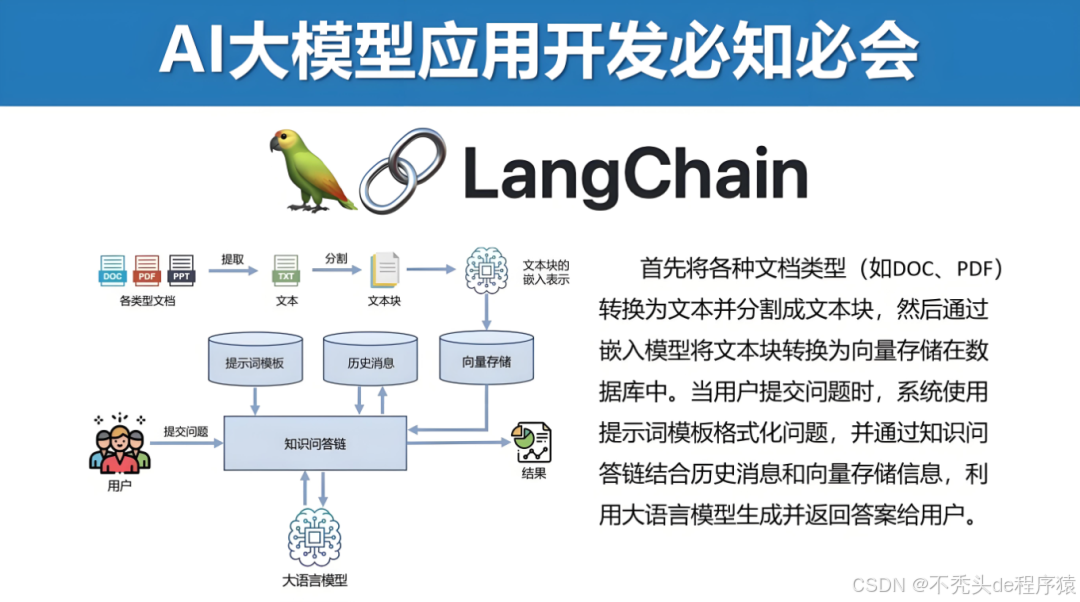

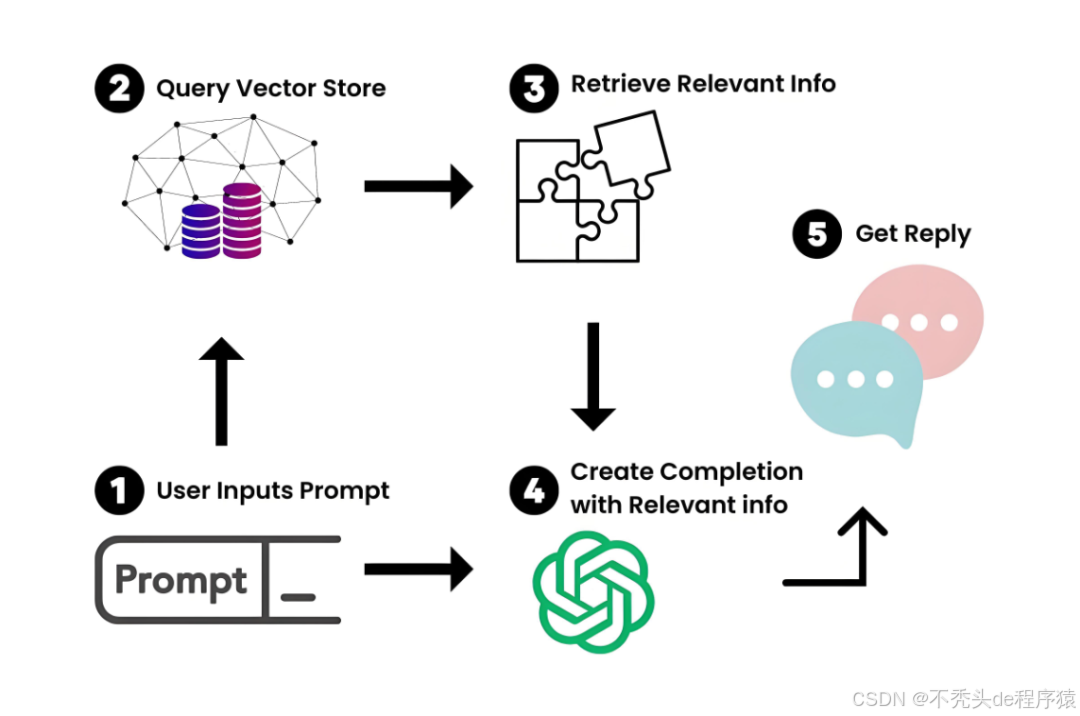

LangChain的核心价值在于解决了LLM应用的三大基础问题:

- 组件化思维:通过Chain、Agent、Memory等抽象概念,将复杂的语

言模型交互拆解为可组合单元# 经典Chain结构示例from langchain.chains import LLMChainchain = LLMChain(llm=ChatOpenAI(temperature=0),prompt=ChatPromptTemplate.from_template("将{input}翻译成{language}"),output_parser=StrOutputParser())

- 基础设施连接器:提供超过260种官方集成的数据源和工具

- 向量数据库(Pinecone, Chroma)

- 文档加载器(PDF, HTML, Markdown)

- 外部API工具(Wolfram, Wikipedia)

- 执行流水线:通过SequentialChain, TransformChain等构建复杂工作流

但在实际大型项目中,这些设计开始显露出结构性缺陷。

二、LangChain的技术债:当抽象层成为性能瓶颈

2023年LangChain的Python包月下载量突破2000万次,而同期GitHub仓库的issue数量增长了470%。其中三个致命问题日益凸显:

| 痛点维度 | 具体表现 | 实际案例 |

|---|---|---|

| 抽象泄漏 | 底层API变更导致链条崩溃 | OpenAI API版本升级造成RetrievalQA失效 |

| 嵌套黑洞 | 多层抽象导致的调试灾难 | 4层Chain结构错误定位耗时6人日 |

| 资源消耗 | 过度包装带来的性能损耗 | Agent调用延迟增加300% |

更令人担忧的是,某头部AI公司的工程效能报告显示:

- LangChain应用的平均启动时间达到17.3秒

- 内存占用比裸API实现高出42%

- debug复杂度指数级增长

三、新范式崛起:从重型框架到轻型组配

行业正在发生静默转向,两种创新模式正在重构LLM工程栈:

1. 微核架构(Microkernel Architecture)

# 轻量化链式处理示例def research_agent(question: str) -> str:search = GoogleSerpAPI()(question)processed = gpt4(clean_prompt(search))return process_output(processed)特征:

- 无全局框架依赖

- 纯函数式编排

- 显式状态管理

2. DSPy的革命(华盛顿大学新框架)

# DSPy的声明式编程class QA(dspy.Module):def __init__(self):self.generate_answer = dspy.Predict("context, question -> answer")def forward(self, context, question):return self.generate_answer(context=context, question=question)

突破点:

- 参数化提示优化

- 编译时自动调优

- 零抽象泄漏风险

四、新工程原则:LLM时代的生产力密码

基于30+个企业级AI项目的重构经验,我们提炼出四条核心原则:

- 透明性优先

- 禁止超过2层的链式嵌套

- 强制记录每个环节的输入/输出快照

- 无状态设计

# 状态显式传递def process_doc(content: str, metadata: dict) -> ProcessResult:# 避免隐式Memory依赖...

- 成本感知架构

- Token消耗实时监控

- 失败重试熔断机制

- 热拔插兼容

# 可替换LLM实现def get_llm(model_name: str) -> Callable:if model_name == "claude3":return claude3_apielif model_name == "gpt4-turbo":return gpt4_turbo

五、未来战场:AI工程生态位的重构

随着GPT-5、Claude 3等新一代模型突破百万token上下文,传统链式结构将加速解构:

- 核心理念迁移

- 从“组装链条”到“编排能力”

- 从“流程驱动”到“意图驱动”

- 基础设施变革

- 向量数据库 → 超长上下文管理

- 复杂工具链 → 原生多模态理解

- 开发范型进化

- 提示工程 → 模型自优化

- 人工编排 → 自主智能体

尾声:LangChain后的黎明

LangChain的历史功绩毋庸置疑——它像Spring框架之于Java世界,为混沌初开的LLM开发建立了第一代秩序。但当我们站在2025年回望,它的最大遗产恰恰是教会了我们何时需要打破抽象枷锁。

真正的AI工程高手已不再争论框架优劣,而是深入理解:任何技术范式都只是实现业务价值的临时脚手架。那些正在默默采用轻量级组合、声明式编程和显式状态管理的团队,正以数倍效能构建着下一代智能应用

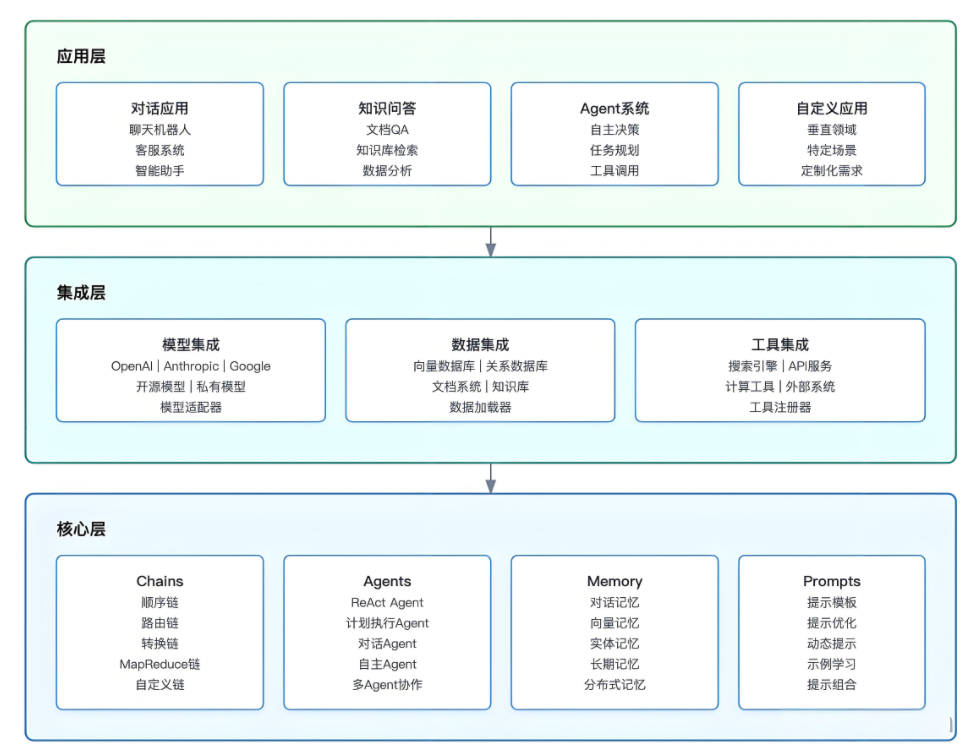

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

01 教学内容

-

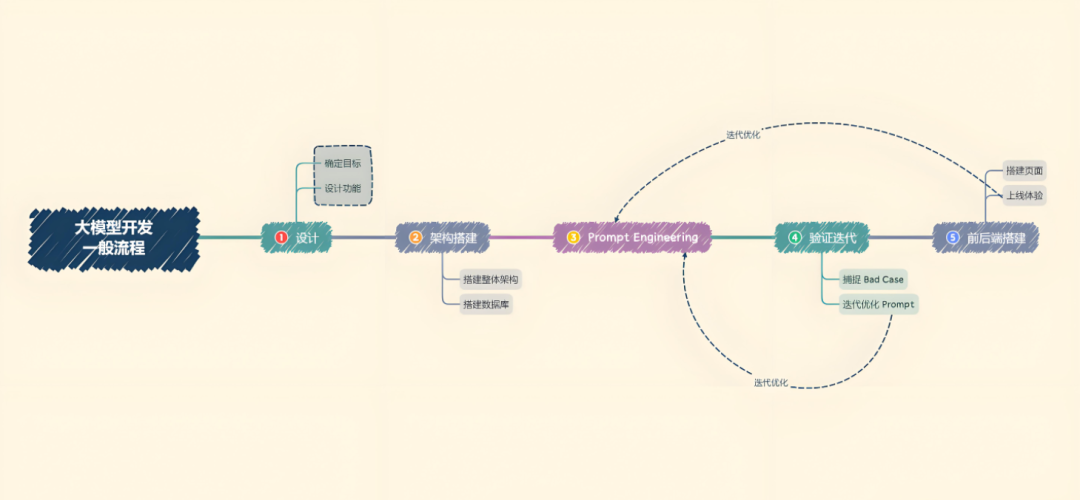

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

1323

1323

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?