前言

大型语言模型(LLM),例如GPT、DeepSeek、Kimi、Gemini和Claude等,已经展现出强大的对话和内容生成能力。然而,它们的一个核心局限在于其知识的静态性。模型“知道”的,仅限于它们训练数据截止日期前的信息。

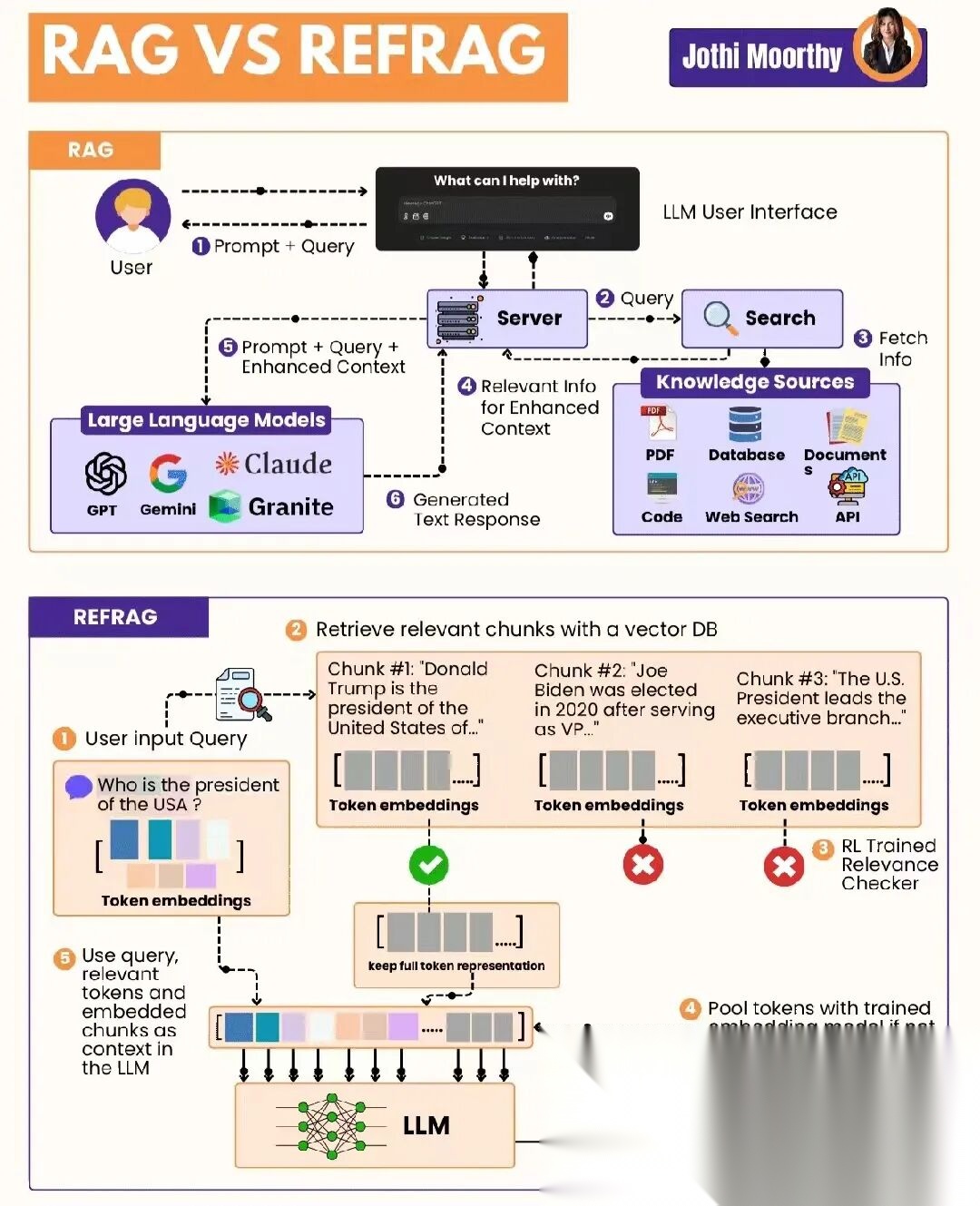

为了解决这个问题,使模型能够接触到实时的、私有的或特定的外部知识,一种强大的技术应运而生:检索增强生成(Retrieval-Augmented Generation, RAG)。

传统的RAG

想象一下,你向一个AI助手提问:“我们公司上个季度的财报表现如何?”如果这个助手仅依赖其内部训练数据,它将无法回答。RAG技术就是为了解决这个难题。

传统的RAG流程通常如下:

-

接收查询:用户输入一个问题或提示。

-

信息检索:系统(服务器)并不会立刻将问题抛给语言模型,而是首先将其发送到一个“搜索”或“检索”模块。

-

搜寻知识源:这个检索模块会连接到各种外部“知识源”。这些知识源包罗万象,可以是公司的内部PDF文档、数据库、API接口、代码库,甚至是实时的网络搜索结果。

-

提取上下文:检索系统会从这些知识源中抓取最相关的几个信息片段(或称为“文本块”)。

-

增强提示:系统会将用户的原始查询与这些抓取到的相关信息文本“拼接”在一起,形成一个内容极其丰富的“增强上下文”提示。

-

生成答案:最后,这个包含查询和所有相关背景资料的增强提示,才会被一同发送给大型语言模型。模型会阅读所有这些材料,并基于这些“新鲜”的外部知识,生成一个准确、有事实依据的回答。

RAG的出现,极大地扩展了LLM的能力,使其能够回答特定领域的问题、引用最新信息,并显著减少“一本正经地胡说八道”(即幻觉)的现象。

RAG的效率瓶颈

尽管RAG非常有效,但它也带来了一个新的、非常现实的挑战:效率和成本。

问题出在“增强提示”这一步。传统的RAG是一种“蛮力”方法,它会把检索到的所有相关文本块(无论相关性多强)都塞进语言模型的上下文窗口中。这导致输入给模型的提示变得异常冗长,动辄包含数千甚至数万个词元(tokens)。

这会引发一系列问题:

• 高延迟: 模型需要花费大量时间来“阅读”和处理所有这些附加上下文,然后才能开始生成第一个字的答案。这导致用户能明显感觉到“卡顿”,即首词元时间(TTFT)过长。

• 高成本: 在Transformer架构(LLM的基础)中,处理上下文的计算量会随着输入长度(词元数量)的增加而呈指数级增长。处理的词元越多,消耗的计算资源和费用就越高。

• 信息浪费: 并非所有检索到的信息都是同等重要的。可能检索了10个文档片段,但只有2个是真正回答问题所必需的。模型被迫浪费大量算力去处理那8个“噪音”或“死重”信息。

REFRAG的革新

为了解决RAG的效率瓶颈,研究人员(特别是来自Meta等机构的团队)提出了一种更先进的架构,被称为REFRAG(REpresentation For RAG,即“为RAG服务的表示法”)。

REFRAG的核心思想是:我们不应该强迫昂贵的大型语言模型去阅读所有检索到的原始文本,而应该先对这些信息进行智能的“压缩”和“过滤”。

REFRAG的流程是对RAG的精妙升级:

-

检索与压缩: 它同样会从向量数据库等知识源中检索信息块。但关键区别在于,它不会直接使用这些文本。相反,它会使用一个更小、更轻量级的“编码器”模型,将每一个检索到的文本块压缩成一个单一的、高密度的“区块嵌入”(chunk embedding)向量。这个向量就像是整个文本块的“数字指纹”或“浓缩摘要”。

-

智能感知与过滤:接下来,一个专门训练的“相关性检查器”登场。这个组件通常使用**强化学习(RL)**技术进行训练,它会快速“感知”和评估所有这些被压缩的“区块嵌入”。

-

选择性扩展:这个RL检查器会做出智能决策:在所有检索到的区块中,哪些是“极其重要、必须看原文”的,哪些是“相关但看看摘要就行”的。它会保留绝大多数信息的压缩向量形式,而只选择性地“解压”极少数最关键的区块,将其还原为完整的原始文本词元。

-

高效生成:大型语言模型(LLM)收到的是一个“混合型”的、极其高效的提示:它包含了用户的原始查询 + 大量代表背景信息的压缩向量 + 以及一两个被精选出来的完整文本块。

这种从“文本”到“表示”的转变,带来的是一场效率革命。REFRAG不再要求LLM去“阅读”数千个词元,而是让它去“理解”几十个浓缩的向量,同时只精读几个关键段落。

这种方法的优势:

• 惊人的速度: 由于LLM处理的实际词元数量大幅减少,其生成答案的首词元时间(TTFT)可以加快高达30倍。用户几乎可以立即得到响应。

• 极低的成本: 需要主模型处理的词元减少了2到4倍,这意味着显著的计算资源节省和更低的API调用成本。

• 变相的“无限上下文”: 因为信息被高度压缩,REFRAG使得模型在有限的上下文窗口(如4K或8K词元)内,能够等效地处理16倍甚至更多的信息量。

• 保持高质量: 最重要的是,这种极端的压缩和加速,并不会导致答案质量的下降。通过智能地保留最关键的信息,REFRAG在保持(甚至有时超越)传统RAG准确性的同时,实现了效率的飞跃。

如果说RAG是为语言模型打开了一扇连接外部世界的大门,那么REFRAG就是在这扇门上安装了一个智能管家。它不再将所有信息“野蛮”地塞给模型,而是学会了“敲门”、“总结”和“呈报”,只将最精华、最相关的内容以最高效的方式递送进去。这预示着未来的人工智能应用将变得更加迅捷、经济和强大。

最后

为什么要学AI大模型

当下,⼈⼯智能市场迎来了爆发期,并逐渐进⼊以⼈⼯通⽤智能(AGI)为主导的新时代。企业纷纷官宣“ AI+ ”战略,为新兴技术⼈才创造丰富的就业机会,⼈才缺⼝将达 400 万!

DeepSeek问世以来,生成式AI和大模型技术爆发式增长,让很多岗位重新成了炙手可热的新星,岗位薪资远超很多后端岗位,在程序员中稳居前列。

与此同时AI与各行各业深度融合,飞速发展,成为炙手可热的新风口,企业非常需要了解AI、懂AI、会用AI的员工,纷纷开出高薪招聘AI大模型相关岗位。

最近很多程序员朋友都已经学习或者准备学习 AI 大模型,后台也经常会有小伙伴咨询学习路线和学习资料,我特别拜托北京清华大学学士和美国加州理工学院博士学位的鲁为民老师给大家这里给大家准备了一份涵盖了AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频 全系列的学习资料,这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。

这份完整版的大模型 AI 学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

AI大模型系统学习路线

在面对AI大模型开发领域的复杂与深入,精准学习显得尤为重要。一份系统的技术路线图,不仅能够帮助开发者清晰地了解从入门到精通所需掌握的知识点,还能提供一条高效、有序的学习路径。

但知道是一回事,做又是另一回事,初学者最常遇到的问题主要是理论知识缺乏、资源和工具的限制、模型理解和调试的复杂性,在这基础上,找到高质量的学习资源,不浪费时间、不走弯路,又是重中之重。

AI大模型入门到实战的视频教程+项目包

看视频学习是一种高效、直观、灵活且富有吸引力的学习方式,可以更直观地展示过程,能有效提升学习兴趣和理解力,是现在获取知识的重要途径

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

海量AI大模型必读的经典书籍(PDF)

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

600+AI大模型报告(实时更新)

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

AI大模型面试真题+答案解析

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

这份完整版的大模型 AI 学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

540

540

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?