前言

Transformer可以说是大模型的基石,面试大模型相关工作,必问Transformer!所以,大家一定要在理解Transformer上多下功夫。今天的话题是:Transformer里为什么Q和K要使用不同的权重矩阵生成? 为何不能使用同一个值进行自身的点乘?

咱们可以把Q(查询)、K(键)、V(值)想象成在“图书馆查书”:

Q:就是你想问的问题(比如:“怎么减肥?”)。

K:就是书脊上贴的那些关键词标签(比如:“减肥”、“瘦身”、“运动”、“饮食”)。

V:就是书里面具体写的内容(比如:“减肥需要少吃多动,配合运动效果更好”)。

为什么Q和K要用不同的“转换器”(权重矩阵)?

问题(Q)和关键词(K)在图书馆里干的事儿完全不一样。问题是你主动发出的“询问”,关键词是书被动提供的“线索”。它们得用不同的方式“打扮”一下,才能顺利配对。

比如,你的问题是“怎么减肥?”。图书馆里书的关键词有“减肥”、“瘦身”、“运动”,也有“历史”、“地理”。

我们需要一个专门的“问题转换器”(Wᵠ),把你的问题“怎么减肥?”变成一种能“识别”关键词的“探测器”。

同时,还需要一个专门的“关键词转换器”(Wᵏ),把书上的关键词“减肥”、“瘦身”变成一种能“被识别”的“信号”。

只有当“问题探测器”(Q)和“关键词信号”(K)是专门为对方设计的,它们才能精准匹配上(“怎么减肥?”这个Q,能匹配上“减肥”这个K)。

要是它们用同一个转换器,那就等于把“问题”和“关键词”当成了一回事。结果呢?“怎么减肥?”这个Q,可能就只能匹配“怎么减肥?”这个K,根本找不到“瘦身”、“运动”这些相关的书了。不同的角色,需要不同的“适配器”才能高效工作。

为什么不能直接用同一个值(比如输入X)同时做Q和K?

如果我们为了图省事,不给Q和K用不同的转换器(Wᵠ和Wᵏ),而是直接用输入的原始信息X同时当Q和K(Q = K = X),会发生什么呢?

这就好比你在图书馆查书时,****只能用你问的那个一模一样的句子去匹配书上的关键词。

比如,你问“怎么减肥?”,系统就****只能去匹配书架上有没有一本关键词正好是“怎么减肥?”的书。书上的关键词是“减肥”、“瘦身”、“运动”?对不起,系统觉得它们和“怎么减肥?”不是完全一样的词,就不会匹配给你。

结果就是,查书的范围变得超级窄!你明明想找所有关于减肥的书,结果只能找到一本标题恰好是“怎么减肥?”的书(可能还没有),其他所有相关的书都被忽略了。模型就失去了理解“同义词”、“相关词”的能力,只能死板地匹配完全相同的词。

Transformer里Q、K、V是怎么来的?

我们可以把输入的每个词(比如“我”、“爱”、“北京”)想象成一个“原始信息包”(词向量X)。这个信息包X会同时经过三个不同的“加工厂”(权重矩阵Wᵠ、Wᵏ、Wᵛ):

1)经过Wᵠ加工厂: 出来的就是Q(查询)。这个Q代表这个词****想知道什么信息(比如“爱”这个词的Q,可能想知道“谁在爱?”和“爱的是什么?”)。

2)经过Wᵏ加工厂: 出来的就是K(键)。这个K代表这个词****能提供什么信息(比如“我”这个词的K,可能表示“我是一个主语”;“北京”这个词的K,可能表示“我是一个地点宾语”)。

3)经过Wᵛ加工厂: 出来的就是V(值)。这个V就是这个词****本身携带的具体内容(比如“我”的V就是“我”的语义,“爱”的V就是“爱”的语义,“北京”的V就是“北京”的语义)。

这三个加工厂(Wᵠ、Wᵏ、Wᵛ)都是模型自己“学习”出来的,它们知道怎么把原始信息X“翻译”成最适合做查询、键和值的样子。它们通常会把信息“浓缩”一下(比如从768维变成64维),这样计算起来更快,也更容易抓住重点。

核心原因再强调:Q和K的“身份”不同!

Q(查询)就像一个 提问者:它代表当前词(比如“爱”)需要去“关注”句子里的哪些其他词(比如“我”和“北京”),才能理解自己的意思。

K(键) 就像一个 被提问者:它代表句子里的每个词(比如“我”、“北京”)能提供什么“线索”或“信息类型”(比如“我是主语”、“我是宾语”)。

假如Q和K用了同一个加工厂(Wᵠ = Wᵏ),那么Q和K就会变得一模一样(Q = K)。****这就好比提问者(Q)和被提问者(K)说的是同一种“语言”,但问题是,这种“语言”只能表达“我自己”!

那么,“爱”这个提问者(Q)就只能去匹配和“爱”完全一样的被提问者(K)。**结果呢? “爱”就只能关注到“爱”自己,根本无法**去关注“我”或者“北京”,因为“爱”的Q和“我”的K(或者“北京”的K)不是同一种“语言”,无法沟通!模型就学不到词和词之间的关系(比如“爱”和“我”是主谓关系,“爱”和“北京”是动宾关系)。

总结一下

1)Q和K必须用不同的“转换器”(权重矩阵): 因为它们在注意力机制里干的是不同的活儿(Q是“提问者”,K是“被提问者”)。 如果用同一个转换器,它们就“鸡同鸭讲”,没法有效沟通,模型就学不到词和词之间谁跟谁有关系。

2)不能用同一个值(比如原始输入X)同时做Q和K:否则****模型就变成了“自恋狂”,每个词只关注和自己一模一样的东西,完全看不见上下文里其他重要的词(比如“爱”看不见“我”和“北京”),而且模型也学不会怎么提炼关键信息来做“提问”和“回答”,效果会非常差。

3)本质是什么? 我们可以把Wᵠ和Wᵏ想象成模型自己学会的“提问技巧”和“回答技巧”。通过给Q和K配备不同的、可学习的“技巧”(权重矩阵),模型就获得了*“定义什么是好的提问”、“定义什么是好的回答”以及“让提问和回答能精准匹配”* 的能力。 这就是Transformer模型这么强大、能理解复杂语言关系的一个核心秘诀!就像给图书馆配了个超级聪明的图书管理员,知道怎么把你模糊的问题(Q)精准匹配到书架上那些相关的关键词标签(K),然后找到你真正需要的内容(V)。

最后

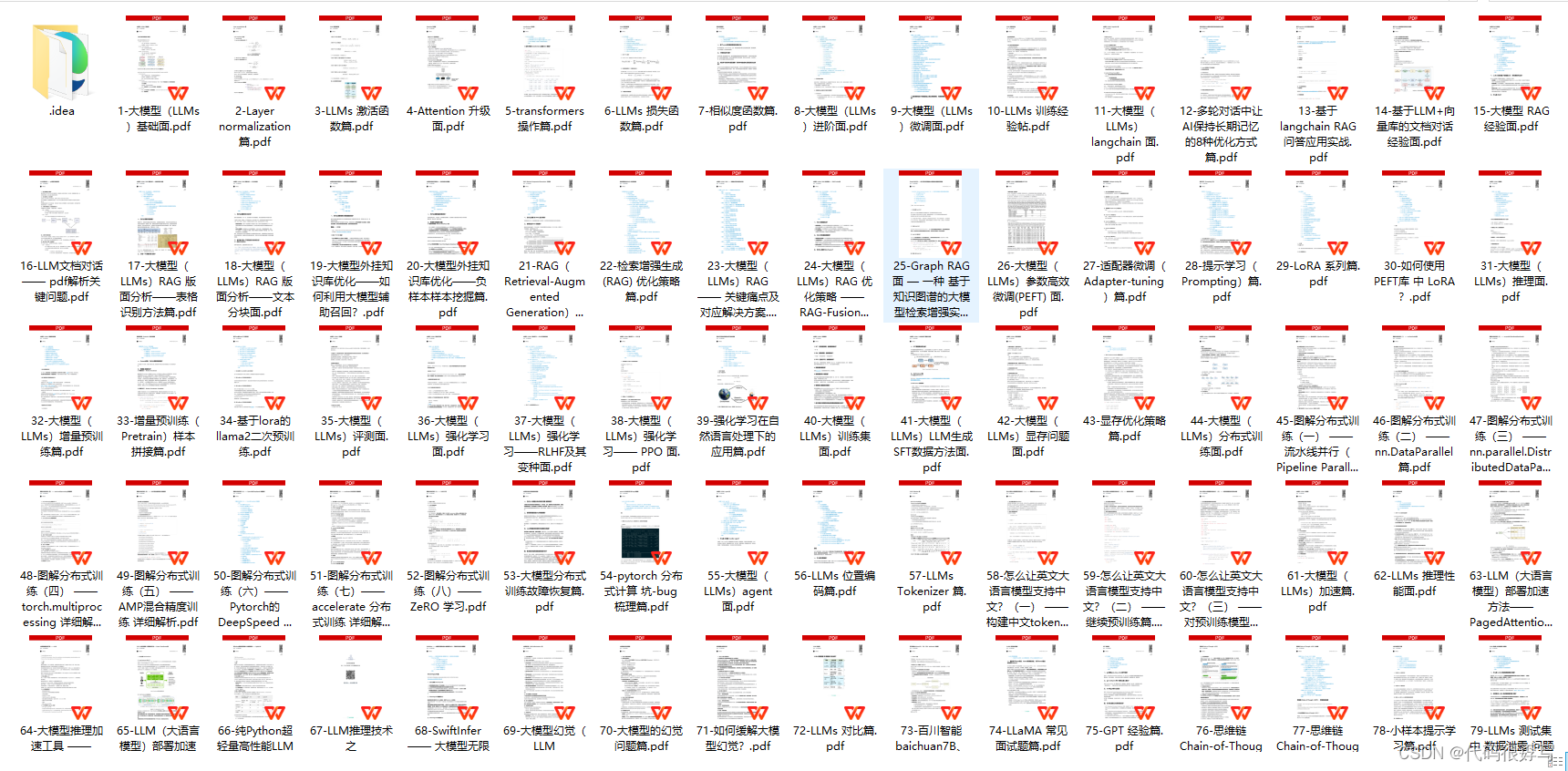

为了助力朋友们跳槽面试、升职加薪、职业困境,提高自己的技术,本文给大家整了一套涵盖AI大模型所有技术栈的快速学习方法和笔记。目前已经收到了七八个网友的反馈,说是面试问到了很多这里面的知识点。

由于文章篇幅有限,不能将全部的面试题+答案解析展示出来,有需要完整面试题资料的朋友,可以扫描下方二维码免费领取哦!!! 👇👇👇👇

面试题展示

1、请解释一下BERT模型的原理和应用场景。

答案:BERT(Bidirectional Encoder Representations from Transformers)是一种预训练的语言模型,通过双向Transformer编码器来学习文本的表示。它在自然语言处理任务中取得了很好的效果,如文本分类、命名实体识别等。

2、什么是序列到序列模型(Seq2Seq),并举例说明其在自然语言处理中的应用。

答案:Seq2Seq模型是一种将一个序列映射到另一个序列的模型,常用于机器翻译、对话生成等任务。例如,将英文句子翻译成法文句子。

3、请解释一下Transformer模型的原理和优势。

答案:Transformer是一种基于自注意力机制的模型,用于处理序列数据。它的优势在于能够并行计算,减少了训练时间,并且在很多自然语言处理任务中表现出色。

4、什么是注意力机制(Attention Mechanism),并举例说明其在深度学习中的应用。

答案:注意力机制是一种机制,用于给予模型对不同部分输入的不同权重。在深度学习中,注意力机制常用于提升模型在处理长序列数据时的性能,如机器翻译、文本摘要等任务。

5、请解释一下卷积神经网络(CNN)在计算机视觉中的应用,并说明其优势。

答案:CNN是一种专门用于处理图像数据的神经网络结构,通过卷积层和池化层提取图像特征。它在计算机视觉任务中广泛应用,如图像分类、目标检测等,并且具有参数共享和平移不变性等优势。

6、请解释一下生成对抗网络(GAN)的原理和应用。

答案:GAN是一种由生成器和判别器组成的对抗性网络结构,用于生成逼真的数据样本。它在图像生成、图像修复等任务中取得了很好的效果。

7、请解释一下强化学习(Reinforcement Learning)的原理和应用。

答案:强化学习是一种通过与环境交互学习最优策略的机器学习方法。它在游戏领域、机器人控制等领域有广泛的应用。

8、请解释一下自监督学习(Self-Supervised Learning)的原理和优势。

答案:自监督学习是一种无需人工标注标签的学习方法,通过模型自动生成标签进行训练。它在数据标注困难的情况下有很大的优势。

9、解释一下迁移学习(Transfer Learning)的原理和应用。

答案:迁移学习是一种将在一个任务上学到的知识迁移到另一个任务上的学习方法。它在数据稀缺或新任务数据量较小时有很好的效果。

10、请解释一下模型蒸馏(Model Distillation)的原理和应用。

答案:模型蒸馏是一种通过训练一个小模型来近似一个大模型的方法。它可以减少模型的计算和存储开销,并在移动端部署时有很大的优势。

11、请解释一下LSTM(Long Short-Term Memory)模型的原理和应用场景。

答案:LSTM是一种特殊的循环神经网络结构,用于处理序列数据。它通过门控单元来学习长期依赖关系,常用于语言建模、时间序列预测等任务。

12、请解释一下BERT模型的原理和应用场景。

答案:BERT(Bidirectional Encoder Representations from Transformers)是一种预训练的语言模型,通过双向Transformer编码器来学习文本的表示。它在自然语言处理任务中取得了很好的效果,如文本分类、命名实体识别等。

13、什么是注意力机制(Attention Mechanism),并举例说明其在深度学习中的应用。

答案:注意力机制是一种机制,用于给予模型对不同部分输入的不同权重。在深度学习中,注意力机制常用于提升模型在处理长序列数据时的性能,如机器翻译、文本摘要等任务。

14、请解释一下生成对抗网络(GAN)的原理和应用。

答案:GAN是一种由生成器和判别器组成的对抗性网络结构,用于生成逼真的数据样本。它在图像生成、图像修复等任务中取得了很好的效果。

15、请解释一下卷积神经网络(CNN)在计算机视觉中的应用,并说明其优势。

答案:CNN是一种专门用于处理图像数据的神经网络结构,通过卷积层和池化层提取图像特征。它在计算机视觉任务中广泛应用,如图像分类、目标检测等,并且具有参数共享和平移不变性等优势。

16、请解释一下强化学习(Reinforcement Learning)的原理和应用。

答案:强化学习是一种通过与环境交互学习最优策略的机器学习方法。它在游戏领域、机器人控制等领域有广泛的应用。

17、请解释一下自监督学习(Self-Supervised Learning)的原理和优势。

答案:自监督学习是一种无需人工标注标签的学习方法,通过模型自动生成标签进行训练。它在数据标注困难的情况下有很大的优势。

18、请解释一下迁移学习(Transfer Learning)的原理和应用。

答案:迁移学习是一种将在一个任务上学到的知识迁移到另一个任务上的学习方法。它在数据稀缺或新任务数据量较小时有很好的效果。

19、请解释一下模型蒸馏(Model Distillation)的原理和应用。

答案:模型蒸馏是一种通过训练一个小模型来近似一个大模型的方法。它可以减少模型的计算和存储开销,并在移动端部署时有很大的优势。

20、请解释一下BERT中的Masked Language Model(MLM)任务及其作用。

答案:MLM是BERT预训练任务之一,通过在输入文本中随机mask掉一部分词汇,让模型预测这些被mask掉的词汇。

由于文章篇幅有限,不能将全部的面试题+答案解析展示出来,有需要完整面试题资料的朋友,可以扫描下方二维码免费领取哦!!! 👇👇👇👇

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?