清华大学2025年11月发布《人工智能教育应用指导原则》,明确禁止将AI生成内容直接作为学业成果提交。

来源:https://www.tsinghua.edu.cn/info/1176/122770.html

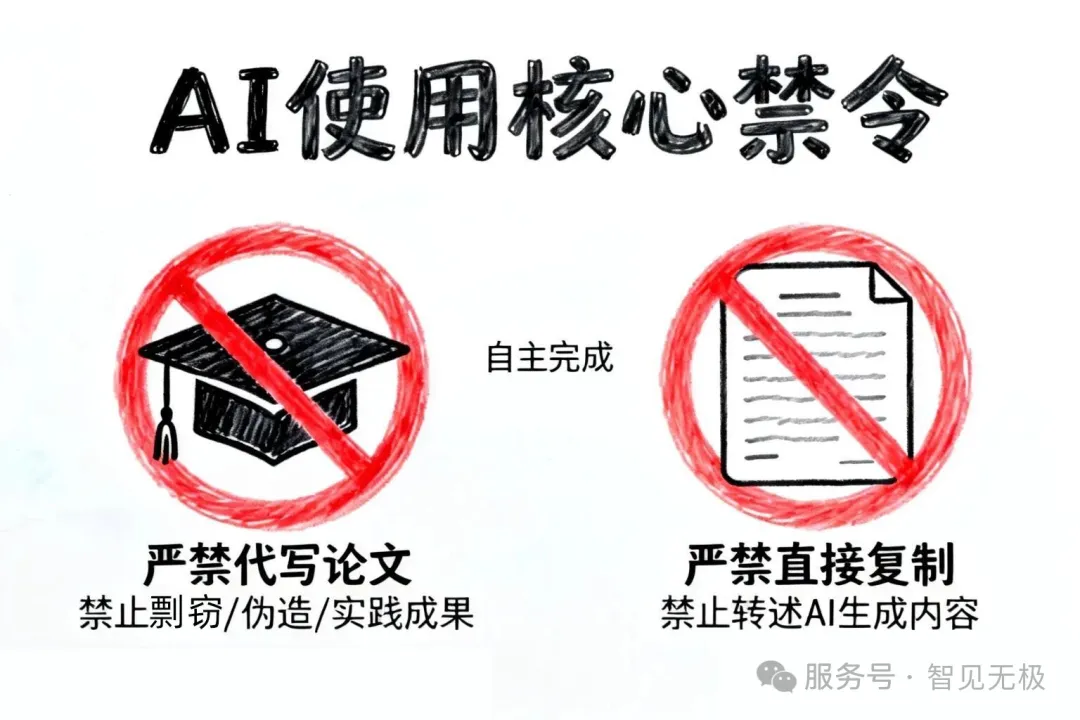

划定五大应用红线

1. 主体责任

AI必须作为辅助工具,研究者需主导学术训练全过程,对生成内容承担核查责任。禁止完全依赖AI。

2. 合规诚信

使用AI需在成果中明确披露,严禁代写、剽窃或伪造数据。未声明AI参与即构成学术不端。

3. 数据安全

禁止使用涉密、敏感或未授权数据训练AI模型,需确保数据来源合法。

4. 审慎思辨

需通过多源验证AI输出内容,防范“幻觉”误导,避免过度依赖导致思维惰化。

5.公平包容

需主动识别算法偏见,保障技术可及性,避免因技术差异造成学术不公

“那么,我们应该在学习过程中如何正确使用AI呢?

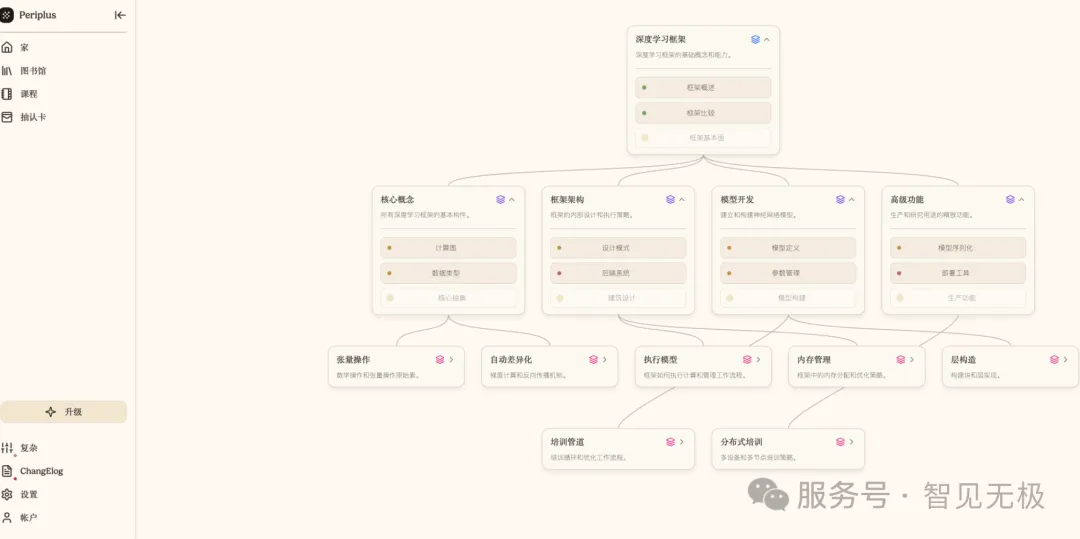

场景化应用:让AI成为“思维脚手架”

信息检索:用AI快速定位文献,但需自主筛选核心观点,避免“信息过载”。

灵感激发:在写作卡顿时,请AI提供多角度思路,或者做一些思路框架整理。

错误诊断:用AI检查代码或论文中的低级错误,但需理解错误原因并独立修正

过程可视化:让AI成为“学习记录仪”

保留交互痕迹:在作业中附上与AI的对话记录,展示从提问到优化的思考轨迹。

标注生成内容:用不同颜色区分自主完成部分与AI辅助部分,避免“隐性抄袭”。

撰写反思日志:记录AI使用的得失,如“AI提供的案例虽新颖,但与我的研究主题关联性不足”。

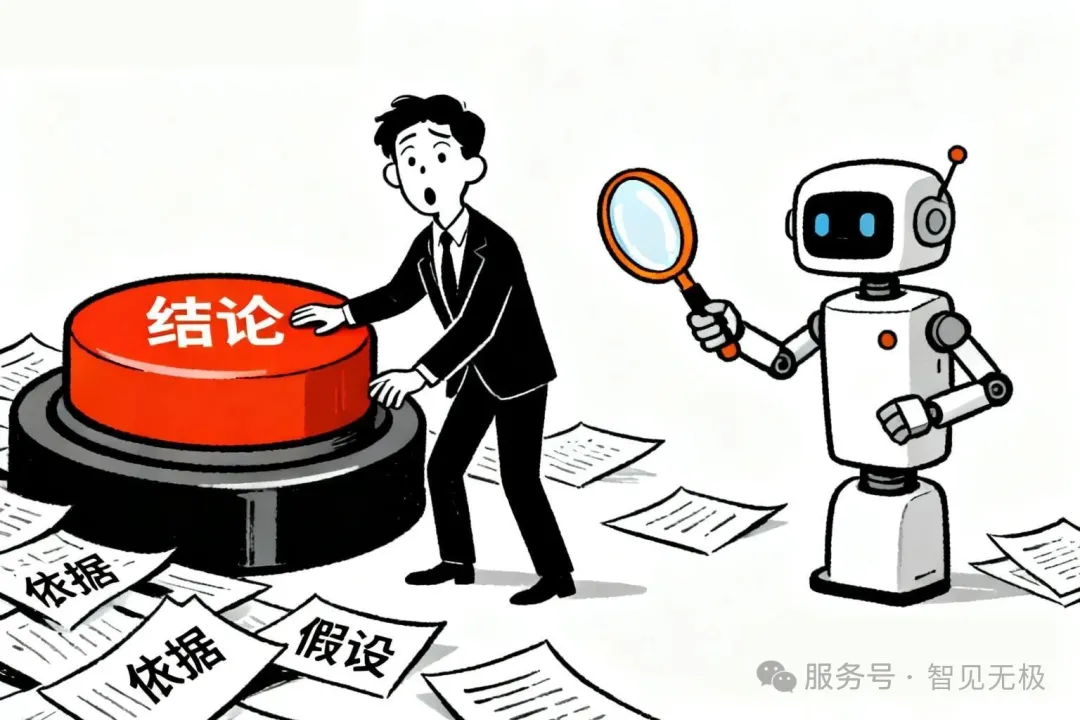

批判性使用:让AI成为“思维磨刀石”

验证AI输出:对AI提供的答案进行多源交叉验证,警惕“人工智能幻觉”(如AI虚构参考文献)。

挑战AI逻辑:当AI给出结论时,追问其依据与假设,培养“苏格拉底式质疑”能力。

对比人类与AI:在小组讨论中,比较人类与AI的解题思路,分析各自的优劣势。

当AI能写诗、解方程、甚至模拟人类对话,教育的使命愈发清晰——培养“不可替代的人类”。

729

729

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?