背景介绍

背景介绍

在游戏开发和实时渲染领域,角色的唇形同步一直是一个令人头疼的技术难题。传统的唇形同步方案往往要么计算成本高昂,要么效果不够自然。今天要介绍的Runtime MetaHuman Lip Sync插件,为虚幻引擎开发者提供了一个轻量且高效的解决方案。

插件核心功能

Runtime MetaHuman Lip Sync不仅仅是一个简单的唇形同步工具,它具备以下关键特性:

-

多源音频输入支持

- 麦克风实时输入

- 文字转语音(TTS)生成的语音

- 任何Float PCM格式的音频数据

-

跨平台兼容性

- Windows

- Android

- Meta Quest

-

灵活的集成方式 插件可以无缝集成到现有的MetaHuman角色动画蓝图中,不会破坏原有的动画系统。

技术实现原理

插件的工作流程非常巧妙:

- 接收Float PCM格式的音频数据

- 实时生成视觉语音(Viseme)

- 通过预定义的姿势资源驱动唇部动画

- 将动画实时应用到MetaHuman角色

实践指南:快速上手

准备工作

开始之前,请确保:

- MetaHuman插件已启用

- 项目中已有MetaHuman角色

- Runtime MetaHuman Lip Sync插件已安装

关键实现步骤

- 修改角色的面部动画蓝图

- 在事件图表中创建运行时语音生成器

- 设置音频输入处理

- 在动画图表中连接

Blend Runtime MetaHuman Lip Sync节点

使用场景示例

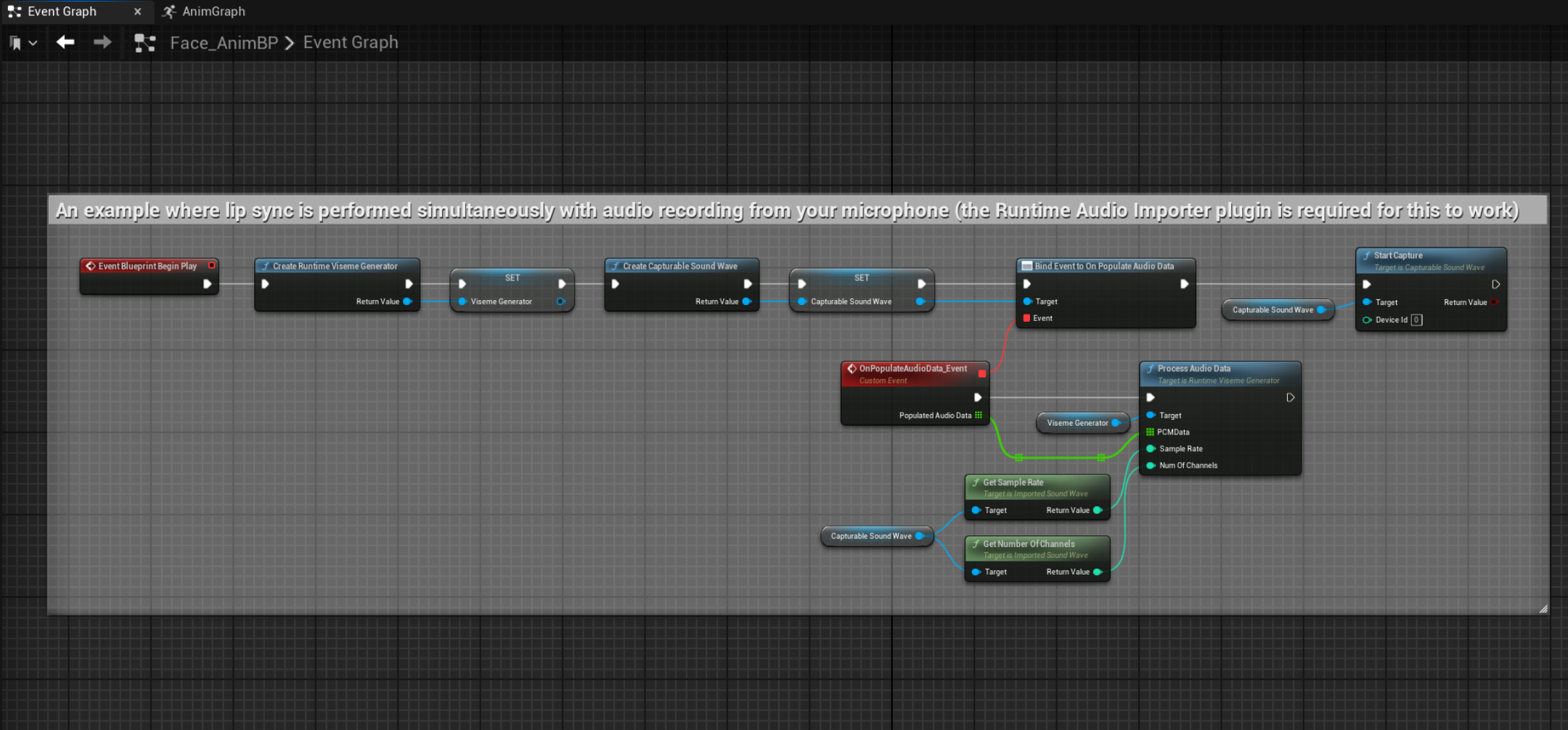

场景一:实时语音聊天

通过麦克风捕获音频,实时驱动MetaHuman角色的唇部动作,适用于在线交互应用。

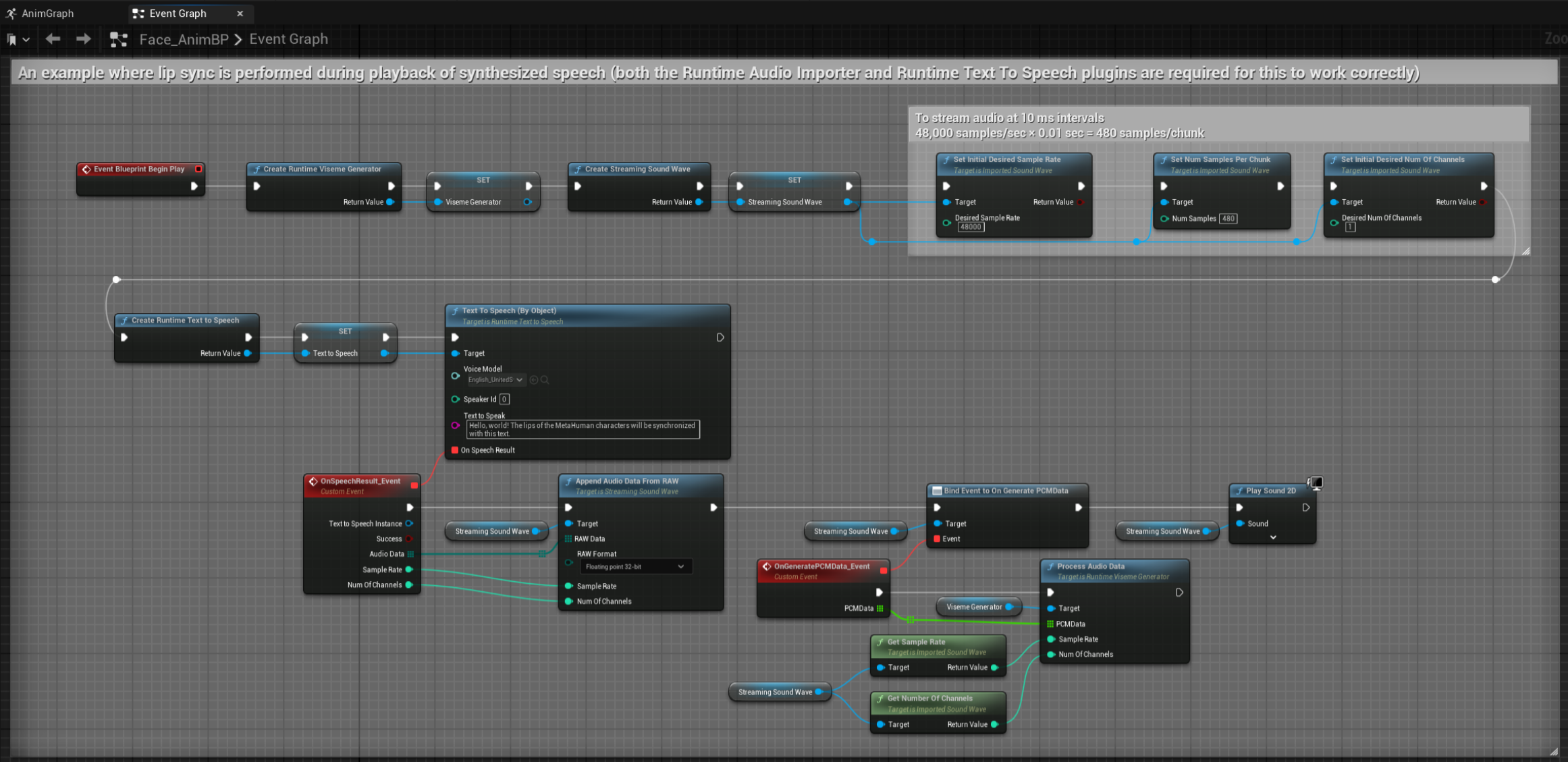

场景二:文字转语音

将生成的语音与角色唇形完美同步,可应用于游戏对话系统和交互式叙事。

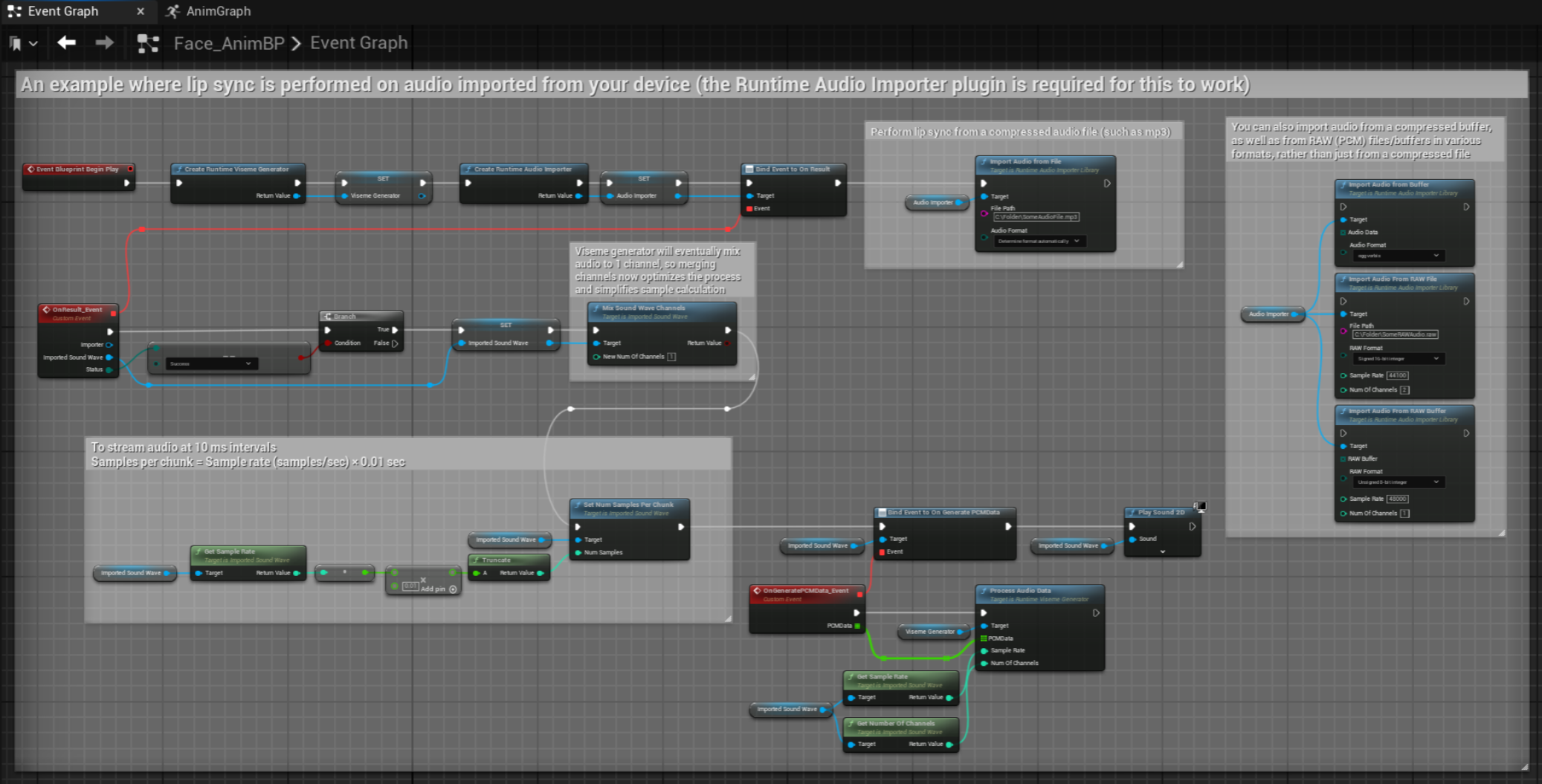

场景三:预录音频

支持从音频文件或内存缓冲区直接生成唇形动画。

性能与优化

插件设计时充分考虑了性能问题:

- 轻量级viseme生成算法

- 可配置的插值速度

- 最小化对现有动画系统的性能开销

进阶技巧

动画混合

插件支持精细的骨骼层级混合,使唇形同步可以与其他面部动画(如眨眼、表情)和谐共存。

结语

对于希望为MetaHuman角色添加逼真语音动画的开发者来说,Runtime MetaHuman Lip Sync绝对是一个值得尝试的插件。它简化了唇形同步的技术复杂性,让开发者可以专注于创造更生动的交互体验。

资源链接

1559

1559

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?