大家好!欢迎来到DeepSeek开源周的第四天!今天我们要聊的是个听起来有点“高大上”的东西——Optimized Parallelism Strategies(优化的并行策略)。别紧张,我会用大白话给你讲得明明白白,保证你看完就能懂!

并行策略是啥?为啥重要?

先说说啥叫并行策略。简单点讲,就是当你有个超级大的任务(比如训练AI模型),一台电脑或一个GPU干不过来咋办?那就把它拆成小块,让好几个处理器或者GPU一块儿干活呗!这样效率就能蹭蹭往上涨。

在AI训练里,这事儿特别关键。为啥?因为现在的AI模型越来越大,数据也越来越多,光靠一个GPU跑,那得等到猴年马月啊!所以,搞好并行策略,能让训练更快、更省时。这次DeepSeek开源周第四弹,就给大家带来了几个超实用的工具,专门解决这个问题。

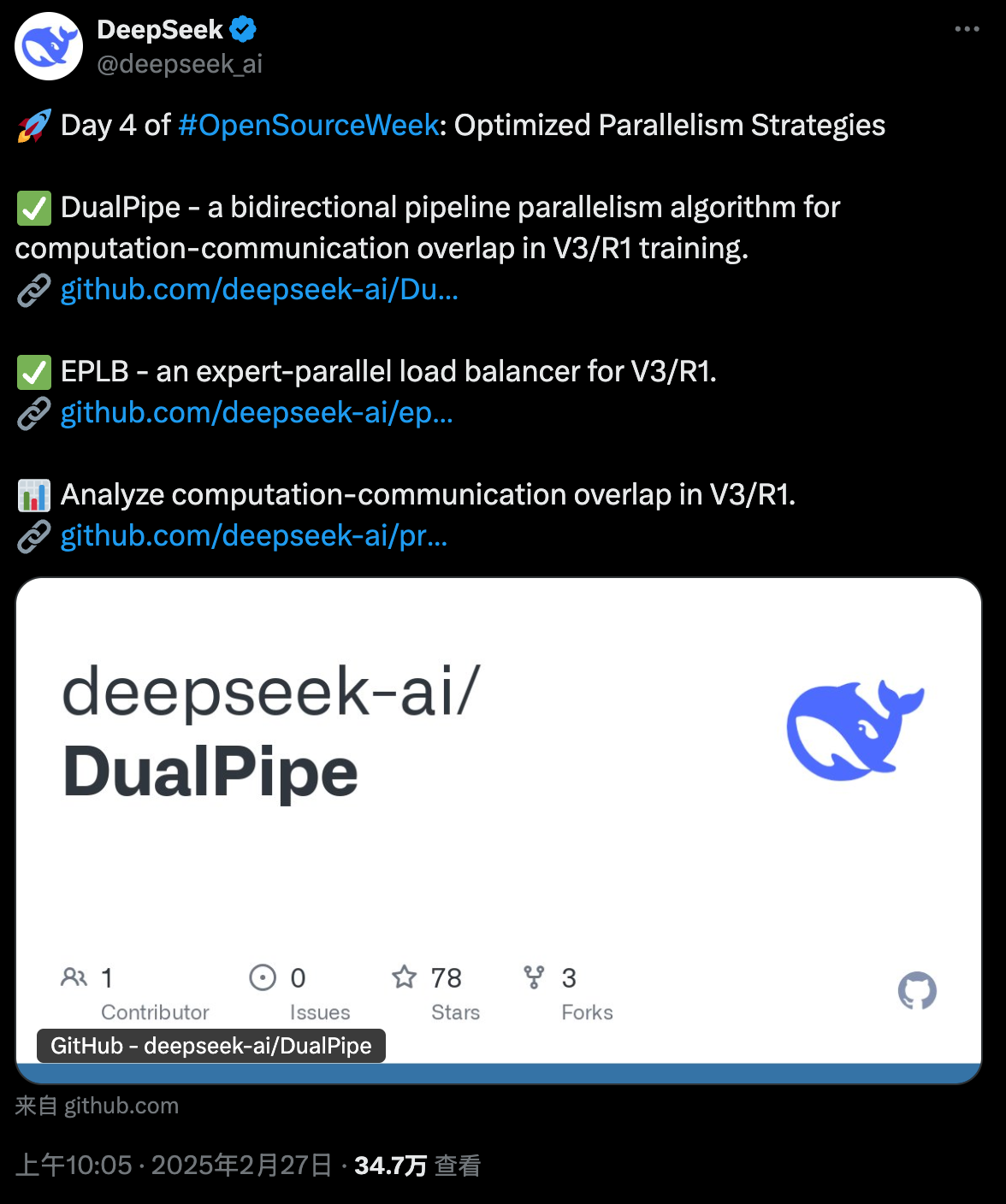

✅ DualPipe:边算边传,效率翻倍

第一个工具叫DualPipe,全名是“双向管道并行算法”。听着复杂,其实不难懂。它是专门为V3/R1训练设计的,核心亮点是能让计算和通信重叠。啥意思呢?

想象一下,你在厨房炒菜,旁边有人帮你洗菜。你不用等洗完再炒,边洗边炒一起搞定,时间不就省下来了?DualPipe就是干这个的:在AI训练时,一边算一边传数据,不用傻乎乎地等着。这样,整个训练过程就快了不少。

✅ EPLB:专家干活,别偷懒

第二个工具是EPLB,全称“专家并行负载均衡器”,也是给V3/R1训练用的。听到“专家并行”是不是有点懵?别慌,我给你解释。

在一些高级AI模型里,会有好几个“专家”模块,每个专家负责不同的任务。有点像公司里的部门:有人管财务,有人搞销售。但如果有的专家忙得要死,有的闲得发慌,那效率肯定不行。EPLB就是来解决这个问题的,它能让每个专家的工作量都差不多,忙闲均衡,这样整个团队(模型)才能跑得顺畅。

✅ 分析工具:看看哪儿能再快点

最后一个是个分析工具,专门用来研究V3/R1训练里计算和通信的重叠情况。有了它,开发者就能清楚地知道:现在并行策略咋样?哪儿还能再优化一下?就像给车做体检,找到毛病修一修,跑得更快。

GitHub传送门

👉 DualPipe:https://github.com/deepseek-ai/DualPipe

👉 EPLB:https://github.com/deepseek-ai/eplb

👉 性能分析库:https://github.com/deepseek-ai/profile-data

总结:AI训练加速器,免费拿走!

总的来说,DeepSeek这次开源的第四弹,全是围绕怎么让AI训练更快、更高效来的。DualPipe让计算和通信同时进行,EPLB保证专家们干活不偏心,再加上个分析工具帮你查漏补缺。这仨工具凑一块儿,简直是AI训练的“加速套装”!

已经有用户开始好奇第五天是否是开源deepseekr2了,让我们一起狠狠期待吧!

我是洞见君,在这里不做AI焦虑的搬运工,只做你探索路上的提灯人。

关注后点击右上角"…"设为星标🌟,每周为你筛选真正值得读的AI干货,让重要更新永不迷路。

整理了这段时间验证过的AI工具包+实战信息差+DeepSeek资料库,放在了洞见AI世界知识库,关注公众号,扫描下方二维码备注"知识库"免费获取,希望能帮你绕过80%的人正在经历的信息泥潭。 关注公众号之后回复【DeepSeek】即可免费获取DeepSeek资料库。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?