当前,大语言模型(Large Language Model, LLM)借助上下文学习(In-context Learning)和思维链提示(Chain of Thoughts Prompting),在许多复杂推理任务上展现出了强大的能力。

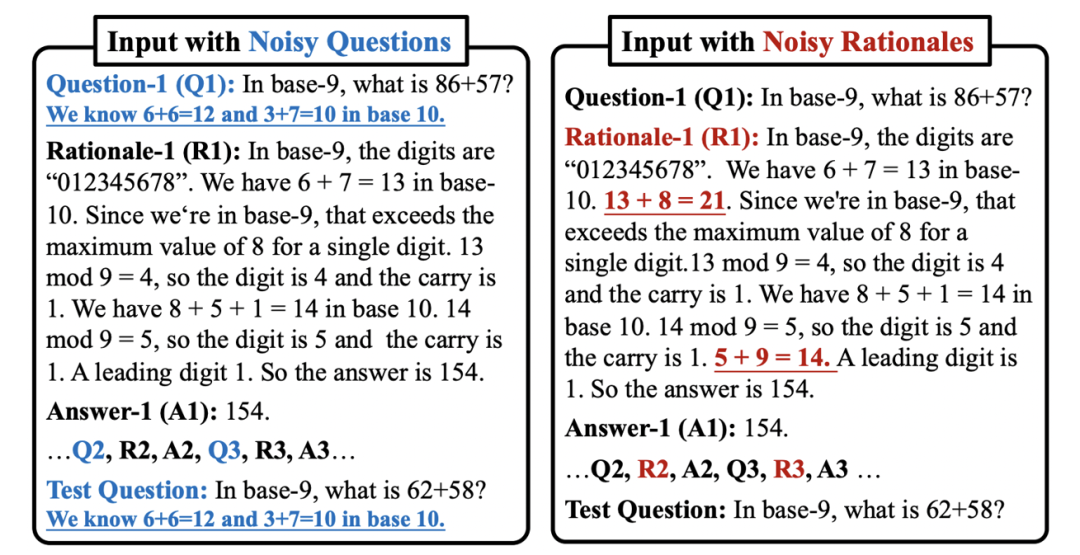

然而,现有研究表明,LLM 在应对噪声输入时存在明显不足:当输入的问题包含无关内容,或者遭到轻微修改时,模型极容易受到干扰,进而偏离正确的推理方向。如图 1 左所示,Q1 中的「We know 6+6=12 and 3+7=10 in base 10」 是关于 base-9 计算的噪声信息,该信息容易误导模型输出错误的结果。

图 1. 噪声问题(Noisy Questions)和噪声思维链(Noisy Rationales)的示例

已有的鲁棒研究大多侧重于噪声问题(Noisy Questions),然而,LLM 在噪声思维链(Noisy Rationales)下的推理还没有得到充分的探究。在本工作中,我们将噪声思维链定义为:包含不相关或者不准确推理步骤的思维链,如图 1 右侧 R1 中的「13 + 8 = 21」步骤,对于 base-9 计算来说,是错误的推理步骤。

这些噪声思维链通常源自 LLM 的实际应用,比如众包平台、对话系统、机器生成数据等场景,人类和机器在推理中都会不可避免地犯错,从而产生噪声思维链。因此,噪声思维链的实际影响和技术挑战不容小觑。当前,我们仍然不清楚 LLM 在面对噪声思维链提示时的鲁棒性能如何,也缺少有效的应对策略。因此,非常有必要构建一个新的数据集,用于系统评估当前 LLM 在噪声思维链场景下的鲁棒性,以及验证相应的鲁棒推理策略。

对此,我们构建了 NoRa 数据集,并进行了大量的实验评测。结果表明,GPT-3.5-Turbo、Gemini-Pro、Llama2-70B 和 Mixtral-8x7B 等开源或闭源 LLM 都极容易受到噪声思维链的影响。其中,GPT-3.5-Turbo 的准确率至多可降低 40.4%。因此,我们也呼吁大家更多地关注大模型推理的鲁棒性问题。

我们的主要贡献有如下三点:

-

新问题:对当前流行的思维链提示技术,我们提出了尚未充分探究的噪声思维链问题(Noisy Rationales),并给出了详细的问题定义和统一的问题建模;

-

新数据集:我们构建了 NoRa 数据集,用于评测 LLM 在噪声思维链提示下的推理鲁棒性。我们使用 NoRa 数据集对 LLM 展开系统评估,揭露了 LLM 推理的鲁棒性不足,数据去噪能力非常有限的问题;

-

新方法:我们设计了一种简单有效的方法(CD-CoT),基于单个正确的思维链示例,去纠正噪声思维链并完成推理,并通过大量实验验证了方法的有效性。

接下来将从新问题、新数据集、新方法这三个角度,简要地介绍我们关于大模型推理鲁棒性的研究结果,相关论文已发表于 NeurIPS 2024 会议。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?