Kylin如今作为大数据业内十分热门的“OLAP”引擎,在越来越多公司中得到“重用”!

具体在企业中是如何使用的,我就不在这里赘述了,感兴趣大家可以从以下链接去做学习了解。

https://www.jianshu.com/p/aae410e5a2fe 《Apache Kylin在美团数十亿数据OLAP场景下的实践》

https://www.sohu.com/a/240896646_659643 《实践 | Kylin在滴滴OLAP引擎中的应用》

HBase安装

在安装 Kylin 前需要先安装部署好 Hadoop、Hive、Zookeeper 和 HBase,并且需要在 /etc/profile 目录下配置 HADOOP_HOME 、HIVE_HOME、HBASE_HOME 环境变量,注意执行source/etc/profile命令使其生效。

(1)保证 Zookeeper 集群的正常部署,并启动它。

[root@node01 zookeeper-3.4.9]$ bin/zkServer.sh start

[root@node02 zookeeper-3.4.9]$ bin/zkServer.sh start

[root@node03 zookeeper-3.4.9]$ bin/zkServer.sh start

(2)保证 Hadoop 集群的正常部署,并启动它

[root@node01 hadoop-2.7.2]$ sbin/start-dfs.sh

[root@node01 hadoop-2.7.2]$ sbin/start-yarn.sh

(3)解压 HBase 安装包到指定目录。

[root@node01 software]$ tar -zxvf hbase-1.3.1-bin.tar.gz -C /export/servers

(4)修改 HBase 对应的配置文件

① hbase-env.sh 文件的修改内容如下

export JAVA_HOME=/opt/module/jdk1.8.0_144

export HBASE_MANAGES_ZK=false

② hbase-site.xml 文件的修改内容如下

注意:

- 修改HDFS NameNode节点名称

- 修改zookeeper服务器名称

- 修改zookeeper数据目录位置

<configuration>

<property>

<name>hbase.rootdir</name>

<value>hdfs://node01:8020/hbase_1.3.1</value>

</property>

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<!-- 0.98后的新变动,之前版本没有.port,默认端口为60000 -->

<property>

<name>hbase.master.port</name>

<value>16000</value>

</property>

<property>

<name>hbase.zookeeper.property.clientPort</name>

<value>2181</value>

</property>

<property>

<name>hbase.master.info.port</name>

<value>60010</value>

</property>

<property>

<name>hbase.zookeeper.quorum</name>

<value>node01,node02,node03</value>

</property>

<property>

<name>hbase.zookeeper.property.dataDir</name>

<value>/export/servers/zookeeper-3.4.9/zkdatas</value>

</property>

<property>

<name>hbase.thrift.support.proxyuser</name>

<value>true</value>

</property>

<property>

<name>hbase.regionserver.thrift.http</name>

<value>true</value>

</property>

</configuration>

③ 在 regionservers 文件中增加如下内容

node01

node02

node03

④ 软连接 Hadoop 配置文件到 HBase

ln -s /export/servers/hadoop-2.7.2/etc/hadoop/core-site.xml $PWD/core-site.xml

ln -s /export/servers/hadoop-2.7.2/etc/hadoop/hdfs-site.xml $PWD/hdfs-site.xml

⑤ 将 HBase 远程发送到其他集群

[root@node01 servers]$ xsync hbase_1.3.1/

(4)配置 HBase 环境变量

# Apache HBase 1.3.1

export HBASE\_HOME=/export/servers/hbase-1.3.1

export PATH=$HADOOP/sbin:$HADOOP/bin:$HBASE\_HOME/bin:$PATH

刷新环境变量

source /etc/profile

(5)启动 HBase 服务。

进入hbase shell

bin/start-hbase.sh

执行上述操作,执行list命令,如果能显示以下内容,表示安装成功。

hbase(main):002:0> list

TABLE

0 row(s) in 0.1380 seconds

=> []

当然,你也可以通过host:port的方式来访问 HBase 的页面,例如:http://node01:16010/

OK,安装完了 Hbase1.3.1,接着我们开始安装 kylin 。

Kylin安装

(1)下载 Kylin 安装包

(2)解压 apache-kylin-2.6.3-bin-hbase1x.tar.gz 到/export/servers 目录下

tar -zxf /export/softwares/apache-kylin-2.6.3-bin-hbase1x.tar.gz -C /export/servers/

注 意 : 启 动 前 需 检 查 /etc/profile 目 录 中 的 HADOOP_HOME 、 HIVE_HOME 和 HBASE_HOME 是否配置完毕

(3)启动

① 在启动 Kylin 之前,需要先启动 Hadoop(HDFS、YARN、JobHistoryServer)、Zookeeper 和 HBase。需要注意的是,要同时启动 Hadoop 的历史服务器,对 Hadoop 集群配置进行如下修改。

配置 mapred-site.xml 文件。

[root@node01 hadoop]$ vim mapred-site.xml

<property>

<name>mapreduce.jobhistory.address</name>

<value>node01:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>node01:19888</value>

</property>

配置 yarn-site.xml 文件。

[root@node01 hadoop]$ vim yarn-site.xml

<!-- 日志聚集功能开启 -->

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<!-- 日志保留时间设置为 7 天 -->

<property>

<name>yarn.log-aggregation.retain-seconds</name>

<value>604800</value>

</property>

修改配置后,分发配置文件,重启 Hadoop 的 HDFS 和 YARN 的所有进程。

启动 Hadoop 历史服务器。

[root@node01 hadoop-2.6.0-cdh5.14.0]$ sbin/mr-jobhistory-daemon.sh start historyserver

② 启动 Kylin

[root@node01 kylin]$ bin/kylin.sh start

启动之后查看各台节点服务器的进程。

--------------------- node01 ----------------

3360 JobHistoryServer

31425 HMaster

3282 NodeManager

3026 DataNode

53283 Jps

2886 NameNode

44007 RunJar

2728 QuorumPeerMain

31566 HRegionServer

--------------------- node02 ----------------

5040 HMaster

2864 ResourceManager

9729 Jps

2657 QuorumPeerMain

4946 HRegionServer

2979 NodeManager

2727 DataNode

--------------------- node03 ----------------

4688 HRegionServer

2900 NodeManager

9848 Jps

2636 QuorumPeerMain

2700 DataNode

2815 SecondaryNameNode

在浏览器地址栏中输入node01:7070/kylin/login,查看 Web 页面,如图所示:

用户名为 ADMIN,密码为 KYLIN(系统已填)

(4)关闭Kylin

如果我们想要关闭 Kylin,只需要执行下面的命令:

[root@node01 apache-kylin-2.6.3]# bin/kylin.sh stop

Kylin的使用

到了这一步,我们终于将 Kylin 安装好了,下面我们来讲一下 Kylin 的具体使用。

准备测试数据表

为了让最终的演示更具有说明力,同时也为了方便后续的学习,接下来我们需要先准备几张测试数据表。

1、(事实表)dw_sales

| 列名 | 列类型 | 说明 |

|---|---|---|

| id | string | 订单id |

| date1 | string | 订单日期 |

| channelid | string | 订单渠道(商场、京东、天猫) |

| productid | string | 产品id |

| regionid | string | 区域名称 |

| amount | int | 商品下单数量 |

| price | double | 商品金额 |

2、(维度表_渠道方式)dim_channel

| 列名 | 列类型 | 说明 |

|---|---|---|

| channelid | string | 渠道id |

| channelname | string | 渠道名称 |

3、(维度表_产品名称)dim_product

| 列名 | 列类型 | 说明 |

|---|---|---|

| productid | string | 产品id |

| productname | string | 产品名称 |

4、(维度表_区域)dim_region

| 列名 | 列类型 | 说明 |

|---|---|---|

| regionid | string | 区域id |

| regionname | string | 区域名称 |

导入测试数据

准备好了测试数据之后,我们需要将在 Hive 中 建好对应的表,这里我采取的是执行已经写好的脚本hive.sql文件,创建测试表。

对应的数据文件和sql脚本不方便在这里展示,需要的同学可以添加我的微信:zwj_bigdataer 获取

操作步骤:

1、使用 beeline 连接Hive

!connect jdbc:hive2://node1:10000

2、创建并切换到 itcast_dw 数据库

create database itcast_kylin_dw;

use itcast_kylin_dw;

3、执行上面我们提到的hive.sql文件,执行sql、创建测试表

-- 执行sql文件

source hive.sql

-- 查看表是否创建成功

show tables;

4、在home目录创建~/dat_file 文件夹,并将测试数据文件上传到该文件夹中

mkdir ~/dat_file

导入数据到表中

-- 导入数据

LOAD DATA LOCAL INPATH '/root/dat\_file/dw\_sales\_data.txt' OVERWRITE INTO TABLE dw_sales;

LOAD DATA LOCAL INPATH '/root/dat\_file/dim\_channel\_data.txt' OVERWRITE INTO TABLE dim_channel;

LOAD DATA LOCAL INPATH '/root/dat\_file/dim\_product\_data.txt' OVERWRITE INTO TABLE dim_product;

LOAD DATA LOCAL INPATH '/root/dat\_file/dim\_region\_data.txt' OVERWRITE INTO TABLE dim_region;

5、执行一条SQL语句,确认数据是否已经成功导入

指标和维度

在确认完成了上面的数据准备操作之后,我们就可以对 kylin 进行实际操作了。但我们还需要先了解一下,什么是指标和维度?

首先来看下面的 demo

相信各位朋友已经有了自己的想法和答案,这里提供一种思考方式:

红色字体是指标/度量?还是维度?

答案:指标/度量【到底要看什么?获取什么?】蓝色字体是指标/度量?还是维度?

答案:维度【怎么看!怎么获取!】

结论:需求决定哪些是维度,哪些是指标。

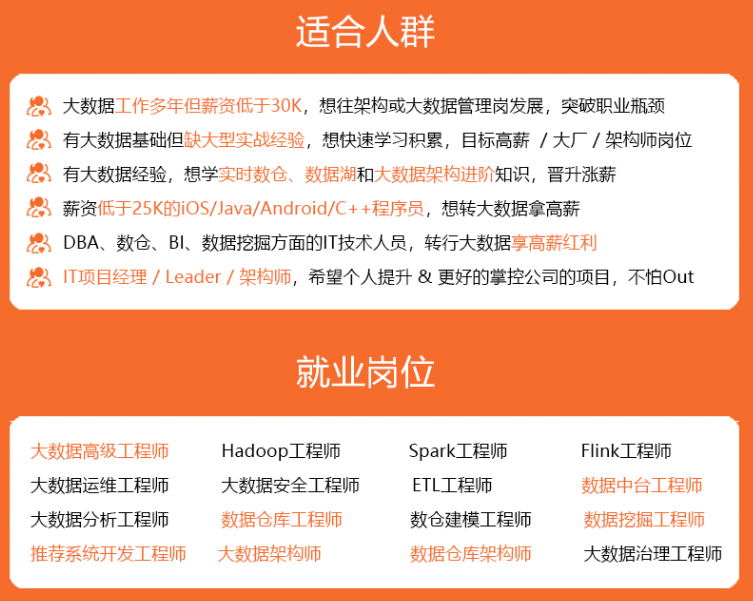

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

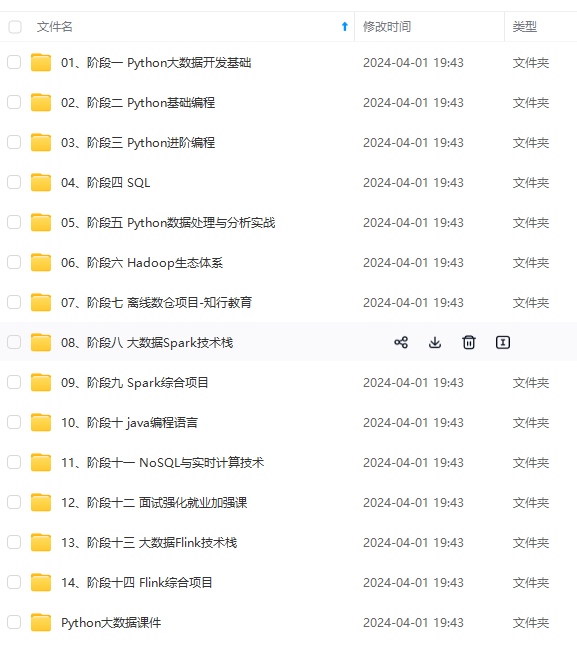

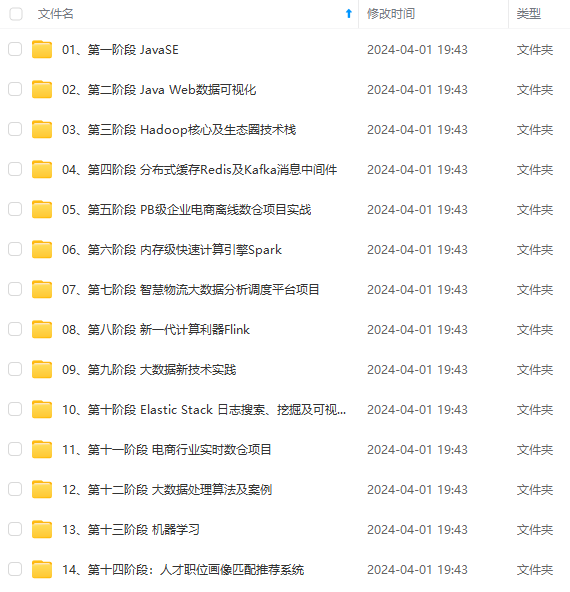

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

考方式:

红色字体是指标/度量?还是维度?

答案:指标/度量【到底要看什么?获取什么?】蓝色字体是指标/度量?还是维度?

答案:维度【怎么看!怎么获取!】

结论:需求决定哪些是维度,哪些是指标。

[外链图片转存中…(img-X9JSAufd-1714793332374)]

[外链图片转存中…(img-geWc3OTa-1714793332374)]

[外链图片转存中…(img-NdOjJzRd-1714793332375)]

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?