Hugging Face Hub 上了一个新功能,让开发者可以轻松地将数千个基础模型使用 Vertex AI 或 Google Kubernetes Engine (GKE) 部署到 Google Cloud。

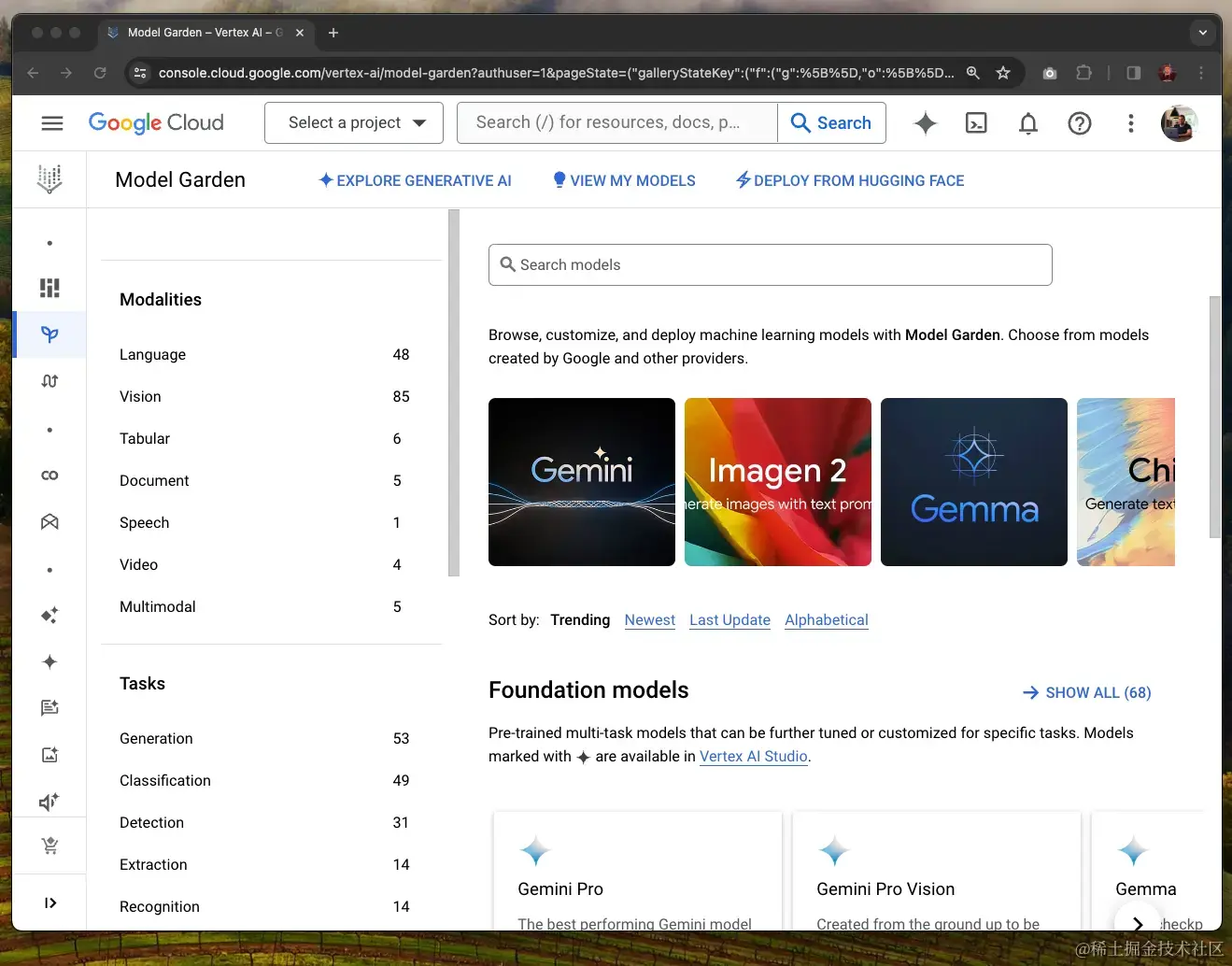

Model Garden (模型库) 是 Google Cloud Vertex AI 平台的一个工具,用户能够发现、定制和部署来自 Google 及其合作伙伴的各种模型。不论是在 Hugging Face 模型页面还是在 Vertex AI 模型库页面,开发者们都可以轻松简单地将开放模型作为 API 端点部署在自己的 Google Cloud 账户内。我们也将启用 Hugging Face 上最受欢迎的开放模型进行推理,这一切都得益于我们的生产级解决方案 文本生成推理。

借助“在 Google Cloud 上部署”,开发者可以在自己的安全 Google Cloud 环境中直接构建准备就绪的生成式 AI 应用,无需自行管理基础设施和服务器。

为 AI 开发者构建

这一全新的体验是基于我们今年早些时候宣布的 战略合作关系 进一步扩展的,目的是简化 Google 客户访问和部署开放生成式 AI 模型的过程。开发者和机构面临的一个主要挑战是,部署模型需要投入大量时间和资源,且必须确保部署的安全性和可靠性。

“在 Google Cloud 上部署”提供了一个简单且管理化的解决方案,专为 Hugging Face 模型提供了专门的配置和资源。只需简单点击几下,就可以在 Google Cloud 的 Vertex AI 上创建一个准备就绪的端点。

Google 产品经理 Wenming Ye 表示:“Vertex AI 的 Model Garden 与 Hugging Face Hub 的集成,让在 Vertex AI 和 GKE 上发现和部署开放模型变得无缝衔接,无论您是从 Hub 开始,还是直接在 Google Cloud 控制台中。我们迫不及待想看到 Google 开发者们将会用 Hugging Face 模型创建出什么样的创新。”

从 HF Hub 开启模型部署

在 Google Cloud 上部署 Hugging Face 模型变得非常简单。以下是如何部署 Zephyr Gemma 的步骤指导。从今天开始,所有带有 text-generation-inference 标签的模型都将受到支持。

只需打开“部署”菜单,选择“Google Cloud”即可。这将直接带您进入 Google Cloud 控制台,您可以在 Vertex AI 或 GKE 上轻松一键部署 Zephyr Gemma。

进入 Vertex AI 模型库之后,您可以选择 Vertex AI 或 GKE 作为部署环境。如果选择 Vertex AI,您可以通过点击“部署”一键完成部署过程。如果选择 GKE,您可以根据提供的指南和模板,在新建或现有的 Kubernetes 集群上部署模型。

从 Vertex AI 模型库开启模型部署

Vertex AI 模型库是 Google 开发者寻找可用于生成式 AI 项目的现成模型的理想场所。从今天开始,Vertex Model Garden 将提供一种全新的体验,使开发者能够轻松部署 Hugging Face 上可用的最流行的开放大语言模型!

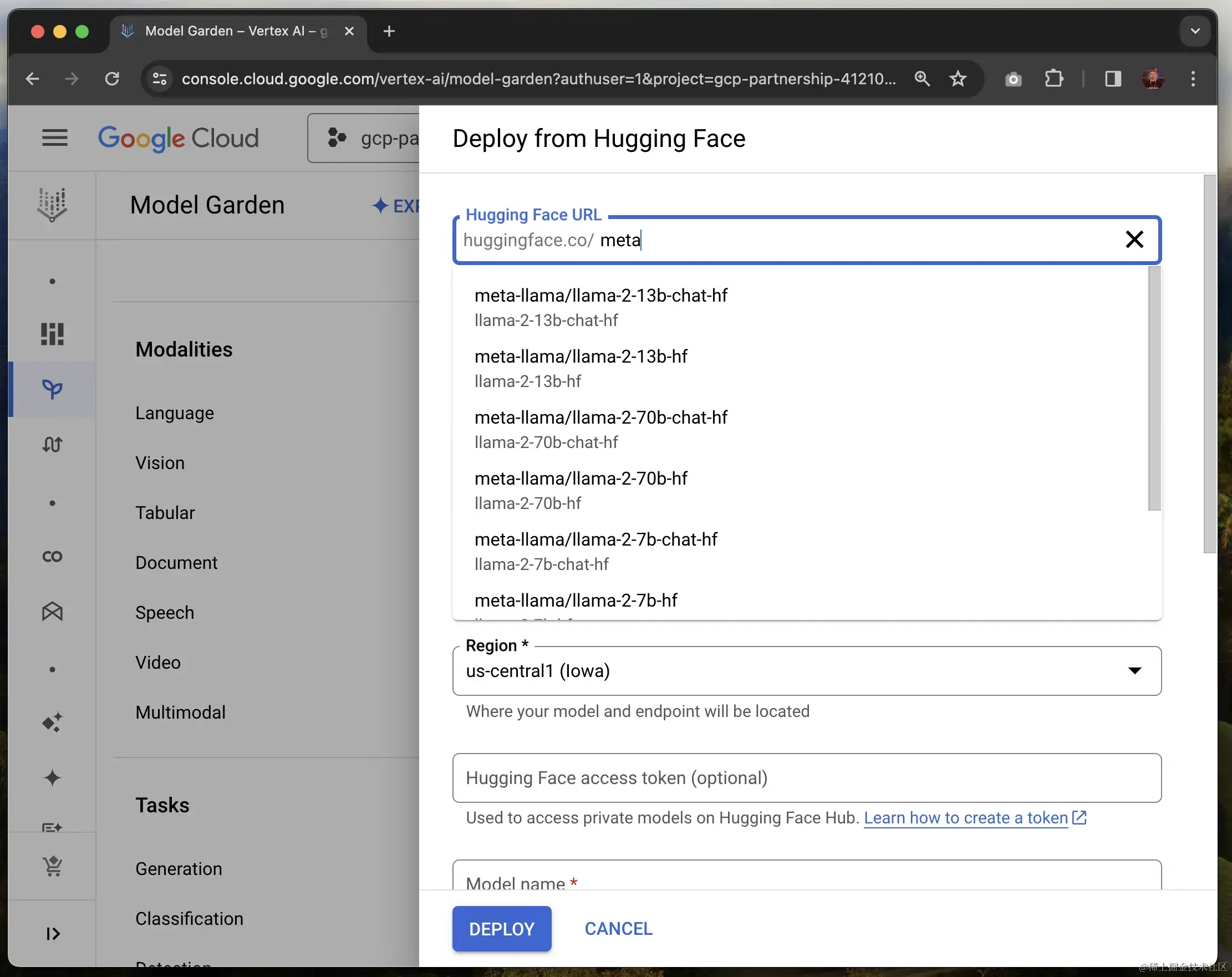

在 Google Vertex AI 模型库中,您会发现一个新的“从 Hugging Face 部署”选项,允许您直接在 Google Cloud 控制台内搜索并部署 Hugging Face 模型。

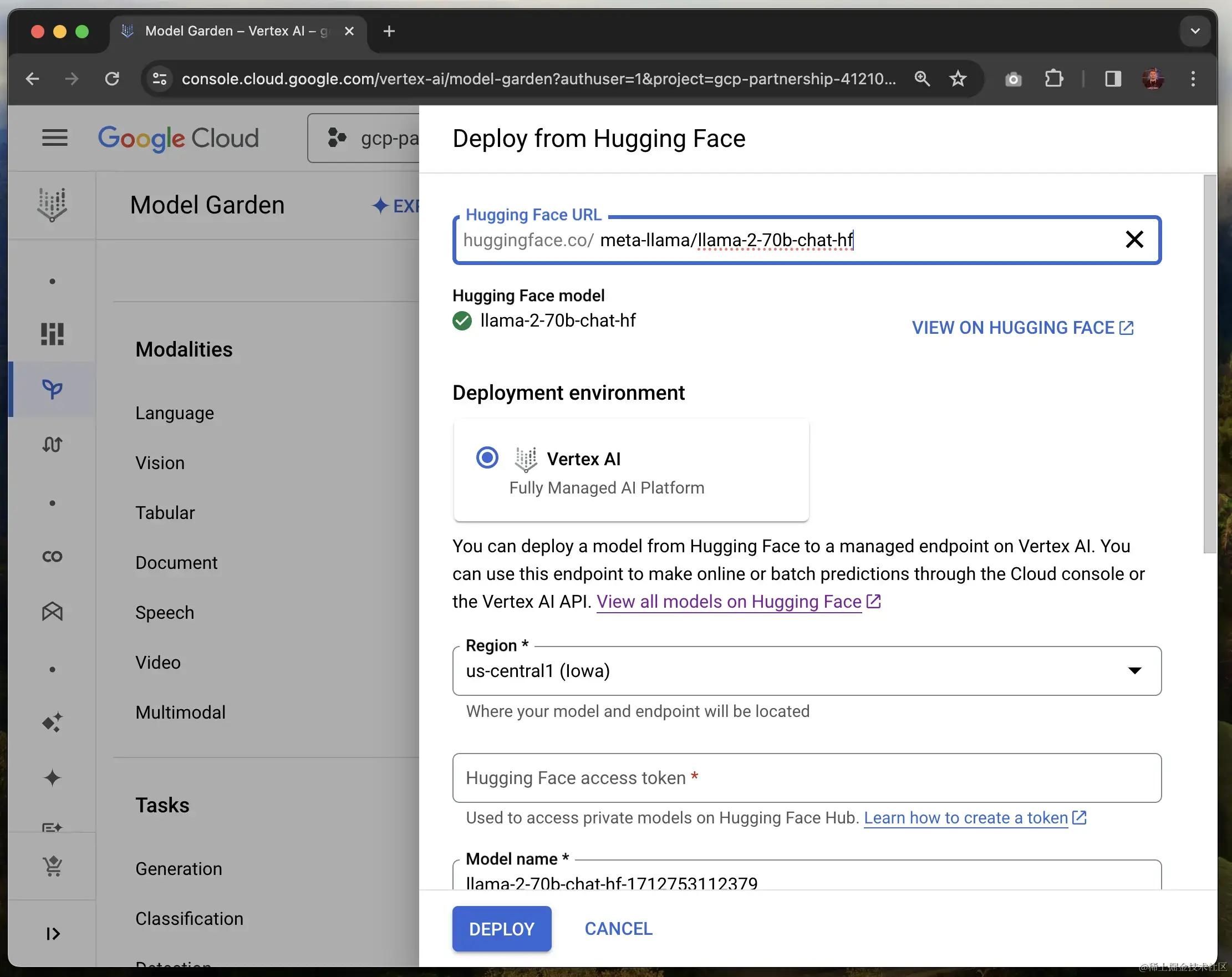

点击“从 Hugging Face 部署”后,将显示一个表单,您可以在其中快速查找模型 ID。Hugging Face 上数以百计最受欢迎的开放大语言模型已经准备就绪,提供了经过测试的硬件配置。

找到想要部署的模型后,选择该模型,Vertex AI 会自动填充所有必要的配置,以便您将模型部署到 Vertex AI 或 GKE 上。通过“在 Hugging Face 上查看”功能,您甚至可以确认选择的模型是否正确。如果您使用的是受限模型,请确保提供您的 Hugging Face 访问令牌,以授权下载模型。

就是这样!从 Vertex AI 模型库直接将模型如 Zephyr Gemma 部署到您的 Google Cloud 账户,只需简单几步。

这只是开始

我们很高兴能够与 Google Cloud 合作,让 AI 更加开放和易于访问。无论是从 Hugging Face Hub 开始,还是在 Google Cloud 控制台内,部署开放模型到 Google Cloud 上都变得前所未有的简单。但我们不会止步于此——敬请期待,我们将开启更多在 Google Cloud 上利用开放模型构建 AI 的新体验!

如何系统的去学习大模型LLM ?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

事实上,抢你饭碗的不是AI,而是会利用AI的人。

继科大讯飞、阿里、华为等巨头公司发布AI产品后,很多中小企业也陆续进场!超高年薪,挖掘AI大模型人才! 如今大厂老板们,也更倾向于会AI的人,普通程序员,还有应对的机会吗?

与其焦虑……

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高。

基于此,我用做产品的心态来打磨这份大模型教程,深挖痛点并持续修改了近70次后,终于把整个AI大模型的学习门槛,降到了最低!

在这个版本当中:

第一您不需要具备任何算法和数学的基础

第二不要求准备高配置的电脑

第三不必懂Python等任何编程语言

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型教程已经给大家整理并打包,现在将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、LLM大模型经典书籍

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套LLM大模型报告合集

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、LLM大模型系列视频教程

四、LLM大模型开源教程(LLaLA/Meta/chatglm/chatgpt)

五、AI产品经理大模型教程

LLM大模型学习路线 ↓

阶段1:AI大模型时代的基础理解

-

目标:了解AI大模型的基本概念、发展历程和核心原理。

-

内容:

- L1.1 人工智能简述与大模型起源

- L1.2 大模型与通用人工智能

- L1.3 GPT模型的发展历程

- L1.4 模型工程

- L1.4.1 知识大模型

- L1.4.2 生产大模型

- L1.4.3 模型工程方法论

- L1.4.4 模型工程实践

- L1.5 GPT应用案例

阶段2:AI大模型API应用开发工程

-

目标:掌握AI大模型API的使用和开发,以及相关的编程技能。

-

内容:

- L2.1 API接口

- L2.1.1 OpenAI API接口

- L2.1.2 Python接口接入

- L2.1.3 BOT工具类框架

- L2.1.4 代码示例

- L2.2 Prompt框架

- L2.3 流水线工程

- L2.4 总结与展望

阶段3:AI大模型应用架构实践

-

目标:深入理解AI大模型的应用架构,并能够进行私有化部署。

-

内容:

- L3.1 Agent模型框架

- L3.2 MetaGPT

- L3.3 ChatGLM

- L3.4 LLAMA

- L3.5 其他大模型介绍

阶段4:AI大模型私有化部署

-

目标:掌握多种AI大模型的私有化部署,包括多模态和特定领域模型。

-

内容:

- L4.1 模型私有化部署概述

- L4.2 模型私有化部署的关键技术

- L4.3 模型私有化部署的实施步骤

- L4.4 模型私有化部署的应用场景

这份 LLM大模型资料 包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

601

601

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?