文章目录

网络爬虫

1. HTTP请求与响应

# 请求行

method"提出什么请求" /URL/info"资源路径" HTTP/1.1"协议类型"

# 请求头

HOST:www.baidu.com # 对应网址URL中的Web名称和端口号

User-Agent:python-requests/2.25.1 # 是客户浏览器名称

Accept:*/*

# 指浏览器或其他客户可以接爱的MIME文件格式。Servlet可以根据它判断并返回适当的文件格式。

# 请求体

GET方法的请求体一般是空的

| 请求方法 | 作用 |

|---|---|

| GET | 通过请求URI获得资源 |

| POST | 用于添加新的资源,用于表单提交 |

# GET/POST用法解析

import requests

url = "此处填入网址"

----------------------------------------------------------------------------------

# 请求头

header = {

"User-Agent": "~~~"

}

res = requests.get(url, headers=header) # 直接输出的结果是状态码

print(res.text) # 输出页面的源代码

res.close() # 关掉resps

----------------------------------------------------------------------------------

s = input("请输入你想翻译的英文单词")

# 用户想要获取的信息

dat = {

"kw": s

}

res = requests.post(url, data=dat) # 将data传给网址

print(res.json()) # 将服务器返回的内容直接处理成json() => dict

res.close() # 关掉resp

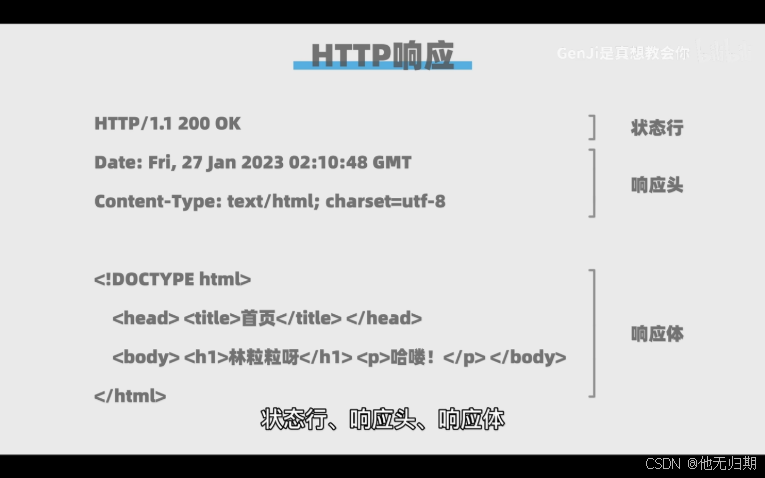

# 状态行

HTTP/1.1"协议类型" 200"状态码" OK"状态码的文本描述"

# 响应头

包含服务器类型,日期,长度,内容类型等

# 相应体

响应正文响应正文就是服务器返回的HTML页面,HTTP响应头与响应正文之间也必须以空行分隔

| 状态码类型 | 表达意义 |

|---|---|

| 1xx | 指示信息–表示请求已接收,继续处理 |

| 2xx | 成功–表示请求已被成功接收、理解、接受 |

| 3xx | 重定向–要完成请求必须进行更进一步的操作 |

| 4xx | 客户端错误–请求有语法错误或请求无法实现 |

| 5xx | 服务器端错误–服务器未能实现合法的请求 |

2. 相关库的安装

1)requests

pip install requests

import requests

headers = {

"User-Agent": "..."

}

response = requests.get("URL")

2)beautifulsoup

pip install bs4

3)re

pip install re

3. 网页数据的展示方式

服务器渲染

在数据那边把数据和html整合在一起,统一返回浏览器

在页面源代码中能看到数据

客户端渲染

第一次请求只要一个html骨架,第二次请求拿到数据,进行数据展示

在页面源代码中看不到数据

4. 数据解析概述

共学习三种解析方式:

- re解析

- bs4解析

- xpath解析

1)re解析

学习正则表达式网址:在线正则表达式测试

下面图片为转存博主LLLLOZ

| 匹配类型 | 描述 |

|---|---|

| .*? | 尽可能少的匹配内容(惰性匹配) |

| .* | 尽可能多的匹配内容(贪婪匹配) |

2)bs4解析

通过对界面html信息的解析,来拿到指定的数据

import requests

from bs4 import BeautifulSoup

url = "https://www.umeituku.com/bizhitupian/weimeibizhi/"

res = requests.get(url)

res.encoding = "utf-8"

# 利用bs4解析

main_page = BeautifulSoup(res.text, "html.parser")

res.close()

3)X_path解析

5. 实战

1)豆瓣评分榜(喜剧类)

import requests

# GET/POST用法解析

url = "https://movie.douban.com/j/chart/top_list"

# 请求头

param = {

"type": 24,

"interval_id": "100:90",

"action": "",

"start": 0,

"limit": 20

}

headers = {

"User-Agent": "Mozilla/5.0 (Linux; Android 6.0; Nexus 5 Build/MRA58N) AppleWebKit/537.36 (KHTML, like Gecko) Chrome"

"/134.0.0.0 Mobile Safari/537.36 Edg/134.0.0.0"

}

res = requests.get(url, params=param, headers=headers) # 直接输出的结果是状态码

print(res.json())

res.close() # 关掉resp

2)手刃豆瓣Top250排行榜

import requests

import re

# 可以把结果存入csv文件

import csv

# GET/POST用法解析

url = "https://movie.douban.com/top250"

# 请求头

headers = {

"User-Agent": "Mozilla/5.0 (Linux; Android 6.0; Nexus 5 Build/MRA58N) AppleWebKit/537.36 (KHTML, like Gecko) Chrome"

"/134.0.0.0 Mobile Safari/537.36 Edg/134.0.0.0"

}

res = requests.get(url, headers=headers) # 直接输出的结果是状态码

page_content = res.text

res.close() # 关掉resp

# 解析数据

obj = re.compile(r'<li>.*?<div class="item">.*?<span class="title">(?P<name>.*?)</span>'

r'.*?<div class="bd">.*?<br>(?P<year>.*?) '

r'.*?<span class="rating_num" property="v:average">(?P<rate>.*?)</span>'

r'.*?<span>(?P<judge>.*?)</span>', re.S)

# 开始匹配

result = obj.finditer(page_content)

for it in result:

# print(it.groupdict())

# print(it.group("name"))

# print(it.group("year").strip())

# print(it.group("rate"))

# print(it.group("judge"), "\n")

dic = it.groupdict()

dic["year"] = dic["year"].strip()

print(dic)

3)屠戮盗版天堂电影信息(re)

# html中a标签表示超链接

# <a herf="http://www.baidu.com">周杰伦</a>

import requests

import re

domain = "https://www.dytt8899.com/"

res1 = requests.get(domain)

res1.encoding = 'gb2312' # 指定字符集

obj1 = re.compile(r'2025必看热片.*?<ul>(?P<ul>.*?)</ul>', re.S)

obj2 = re.compile(r"<a href='(?P<href>.*?)'", re.S)

obj3 = re.compile(r'◎片 名(?P<movie>.*?)<br />.*?<td style="WORD-WRAP: break-word" bgcolor="#fdfddf">'

r'<a href="(?P<download>.*?)">', re.S)

result1 = obj1.finditer(res1.text)

child_href_list = []

for it in result1:

ul = it.group('ul')

# 提取子页面链接

result2 = obj2.finditer(ul) # 适用场景:当你需要获取字符串中所有匹配项时,使用 re.finditer 更合适

for itt in result2:

# 拼接子页面的url地址:域名+子页面地址

child_href = domain + itt.group('href').strip("/")

child_href_list.append(child_href) # 保存子页面链接

# 获取子页面内容

for href in child_href_list:

res2 = requests.get(href)

res2.encoding = 'gb2312'

result3 = obj3.search(res2.text) # 适用场景:当你只需要找到第一个匹配项时,使用 re.search 更高效

print(result3.group('movie').strip())

print(result3.group('download'))

res2.close()

res1.close()

4)抓取优美图库图片(bs4)

import requests

from bs4 import BeautifulSoup

url = "https://www.umeituku.com/bizhitupian/weimeibizhi/"

res = requests.get(url)

res.encoding = "utf-8"

# 利用bs4解析

main_page = BeautifulSoup(res.text, "html.parser")

res.close()

# 获取图片链接地址

alist = main_page.find("div", class_="TypeList").find_all("a")

# print(alist)

for a in alist:

# print(a.get("href"))

# 拿到子页的源代码

child_page_res = requests.get(a.get("href"))

child_page_res.encoding = "utf-8"

child_page_text = child_page_res.text

child_page_res.close()

# 从子页面拿到图片的下载路径

child_page = BeautifulSoup(child_page_text, "html.parser")

p = child_page.find("p", align="center")

src = p.find("img")

# print(src)

img_name = src.get("alt")

# img_name = src.split("/")[-1] # 拿到url最后一个/以后的内容

img_path = src.get("src")

# print(img_name, img_path)

# 下载图片

img_res = requests.get(img_path)

with open(fr"C:\Users\24468\Desktop\网络安全\网络爬虫\umeituku\{img_name}", mode="wb") as f:

f.write(img_res.content) # 图片内容写入文件

f.close()

img_res.close()

print("over", img_name)

# 获得图片发布日期

# alist = main_page.find("div", class_="TypeList").find_all("em", class_="IcoTime")

# for a in alist:

# print(a.get_text())

6)网页小技巧

1. 被禁止查看源代码

可以先按F12,再访问网站

2. 网页调试Debugger 不运行

可以在F12的源代码栏关闭断点调试,或者直接按Ctrl+F8关闭

3. JS的数据被处理过,无法查看

用Selenium处理数据异步加载

4. F12捕获不到登录接口的原因

F12经常看不到login接口,这是因为在发出 post 请求之后,页面会进行跳转,请求被清空导致

这时候我们在F12的网络栏勾选上“保留日志”即可

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?