Transformer中的Layernormal是将单词的词向量进行归一化

在一个句子(一个batch)将不同单词的词向量作为整体归一化之后,仍然保留了不同单词之间的比较关系,这样可以理解为保留了上下文关系。(有的人说是将单个单词的词向量分别进行归一化,但是个人觉得这样不太对)

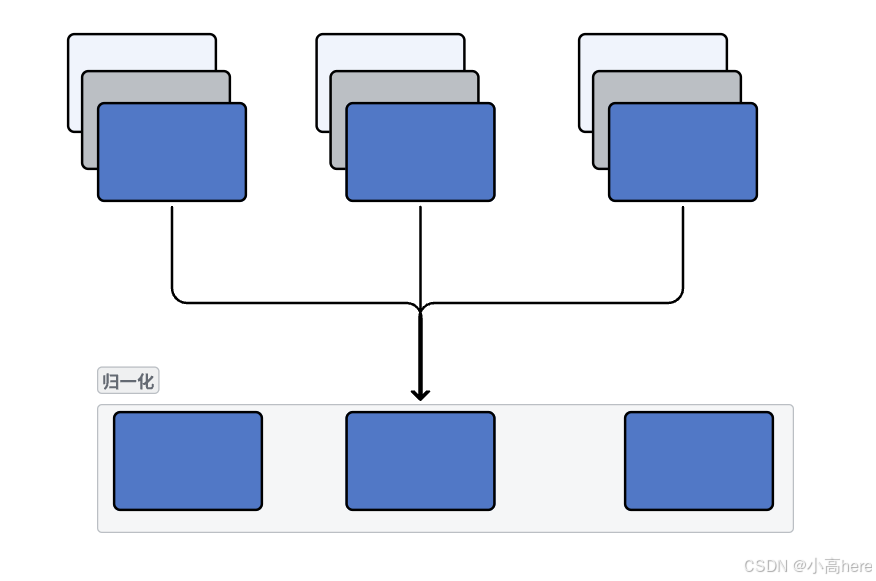

CV中的Batchnormal是将不同通道的同一特征进行归一化

在3张图片中分别分离出了3个不同的特征,不同颜色代表不同特征(也可以叫做通道)。以下面图像解释为例,将深蓝色的特征都考虑了然后进行归一化得到归一化后的的三个特征。这三个特征之间的比较关系不变,但是跟天蓝色和灰色特征没有可比性。但是注意本来同一个图片的不同特征就不需要比较,所以Batchnormal不影响图像处理的工作。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?