1)案例需求

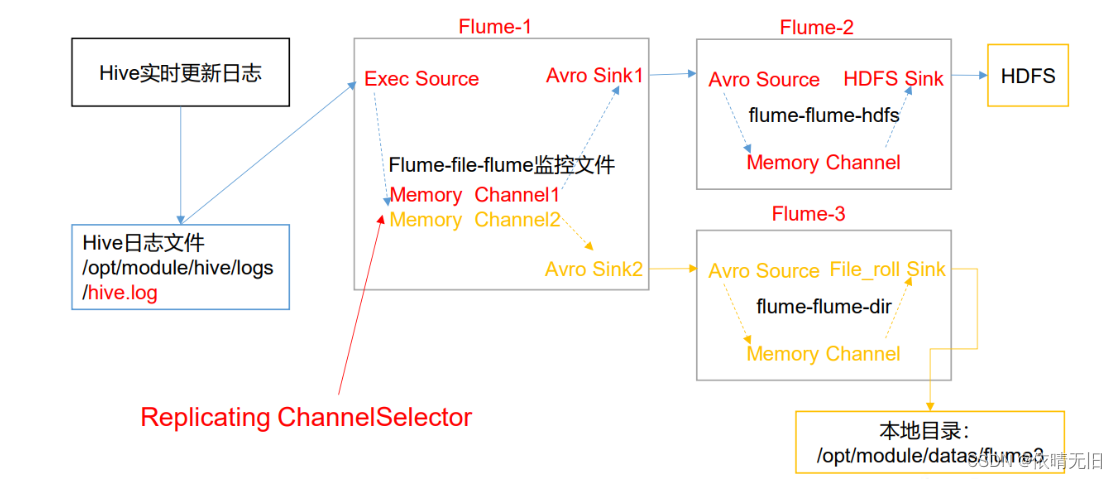

使用 Flume-1 监控文件变动,Flume-1 将变动内容传递给 Flume-2,Flume-2 负责存储 到 HDFS。同时 Flume-1 将变动内容传递给 Flume-3,Flume-3 负责输出到 Local FileSystem。

2)需求分析:

3)实现步骤:

(1)准备工作

在/opt/module/flume/job 目录下创建 group1 文件夹

[root@hadoop102 job]$ cd group1/在/opt/module/datas/目录下创建 flume3 文件夹

[root@hadoop102 datas]$ mkdir flume3(2)创建 flume-file-flume.conf

配置 1 个接收日志文件的 source 和两个 channel、两个 sink,分别输送给 flume-flume-hdfs 和 flume-flume-dir。 编辑配置文件

[root@hadoop102 group1]$ vim flume-file-flume.conf 添加如下内容

# Name the components on this agent

a1.sources = r1

a1.sinks = k1 k2

a1.channels = c1 c2

# 将数据流复制给所有 channel

a1.sources.r1.selector.type

本文详细描述了如何通过Flume将文件变动实时监控并分发至HDFS和LocalFileSystem,涉及Flume的配置、源、通道和Sink的设置,以及Hadoop和Hive环境的准备和启动过程。

本文详细描述了如何通过Flume将文件变动实时监控并分发至HDFS和LocalFileSystem,涉及Flume的配置、源、通道和Sink的设置,以及Hadoop和Hive环境的准备和启动过程。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1730

1730

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?