免费链接: Blogger(需翻Q)

文章目录

论文信息

论文地址:https://arxiv.org/pdf/2210.17168.pdf

Abstract

论文提出了一种token-level的自蒸馏对比学习(self-distillation contrastive learning)方法。

1. Introduction

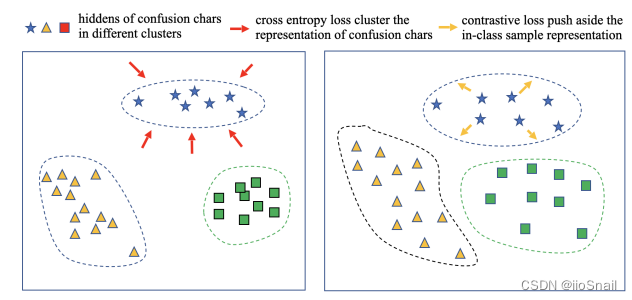

传统方法使用BERT后,会对confusion chars进行聚类,但使用作者提出的方法,会让其变得分布更均匀。

confusion chars: 指的应该是易出错的字。

论文介绍了一种利用MacBERT和对比学习策略改进的模型,通过对比错误字符和正确字符的特征向量来提高BERT在识别易错字符上的性能。模型结合了BERT隐藏状态和词嵌入,并使用ContrastiveLoss进行训练,优化了错字的预测和复制粘贴任务。

论文介绍了一种利用MacBERT和对比学习策略改进的模型,通过对比错误字符和正确字符的特征向量来提高BERT在识别易错字符上的性能。模型结合了BERT隐藏状态和词嵌入,并使用ContrastiveLoss进行训练,优化了错字的预测和复制粘贴任务。

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?