maxout来源论文《Maxout Networks》读后总结

前言

这是一些对于论文《Maxout Networks》的简单的读后总结,首先先奉上该文章的下载超链接:maxout

这篇文章是由D´epartement d’Informatique et de Recherche Op´erationelle, Universit´e de Montr´eal的人员合作完成的,作者分别是Ian J. Goodfellow、David Warde-Farley、Mehdi Mirza、Aaron Courville和Yoshua Bengio。其是Maxout的来源文章,该文章提出了一种新的与众不同的激活函数(maxout),使得网络的性能更加优异,且网络能做得更深。

文章主要内容与贡献

该文章的贡献为:

- 提出了maxout;

- 说明了maxout能近似任何函数。

提出了maxout

maxout其实很简单,公式如下所示:

其中,

![]()

![]()

![]()

,简而言之就是仅输出前k个最大的神经元,使用maxout来作为激活函数,相比于ReLU来说,maxout有可能会输出负值。

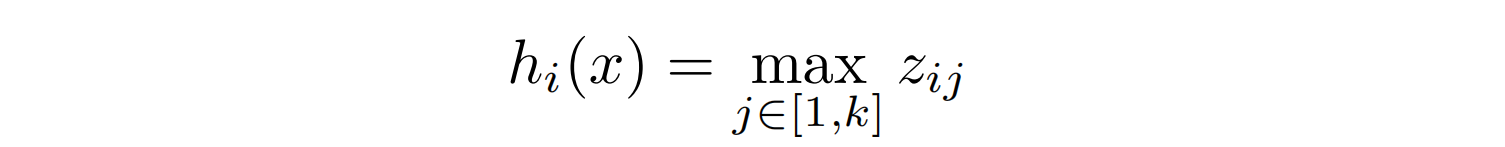

说明了maxout能近似任何函数

这点就不多说了,直接上图:

实验结果

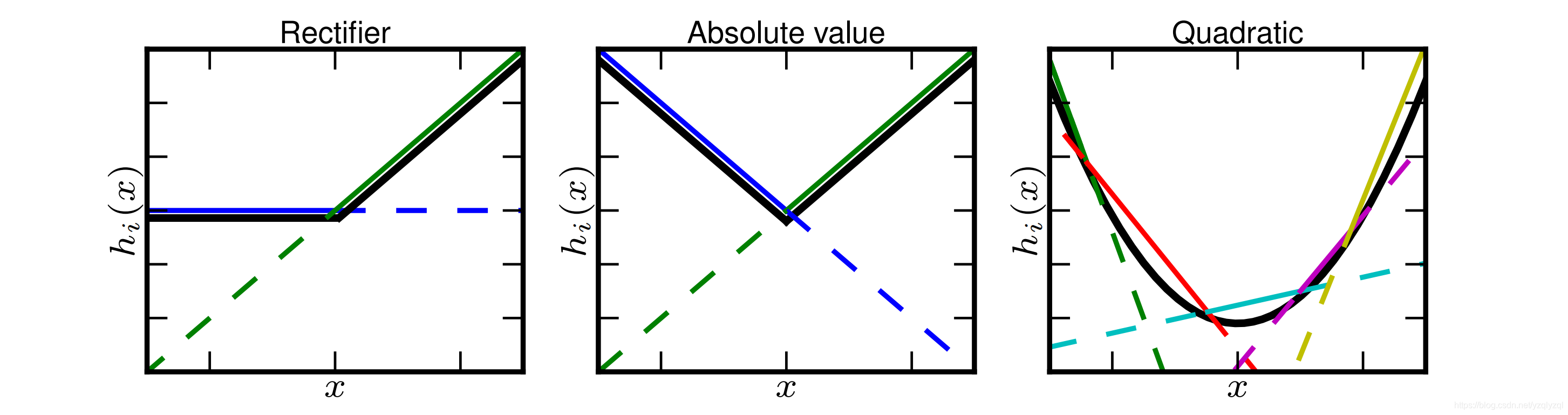

下表是排列不变MNIST数据集上最佳方法的测试集错误分类率,只有通过建模输入分布来实现正则化的方法才优于maxout MLP。

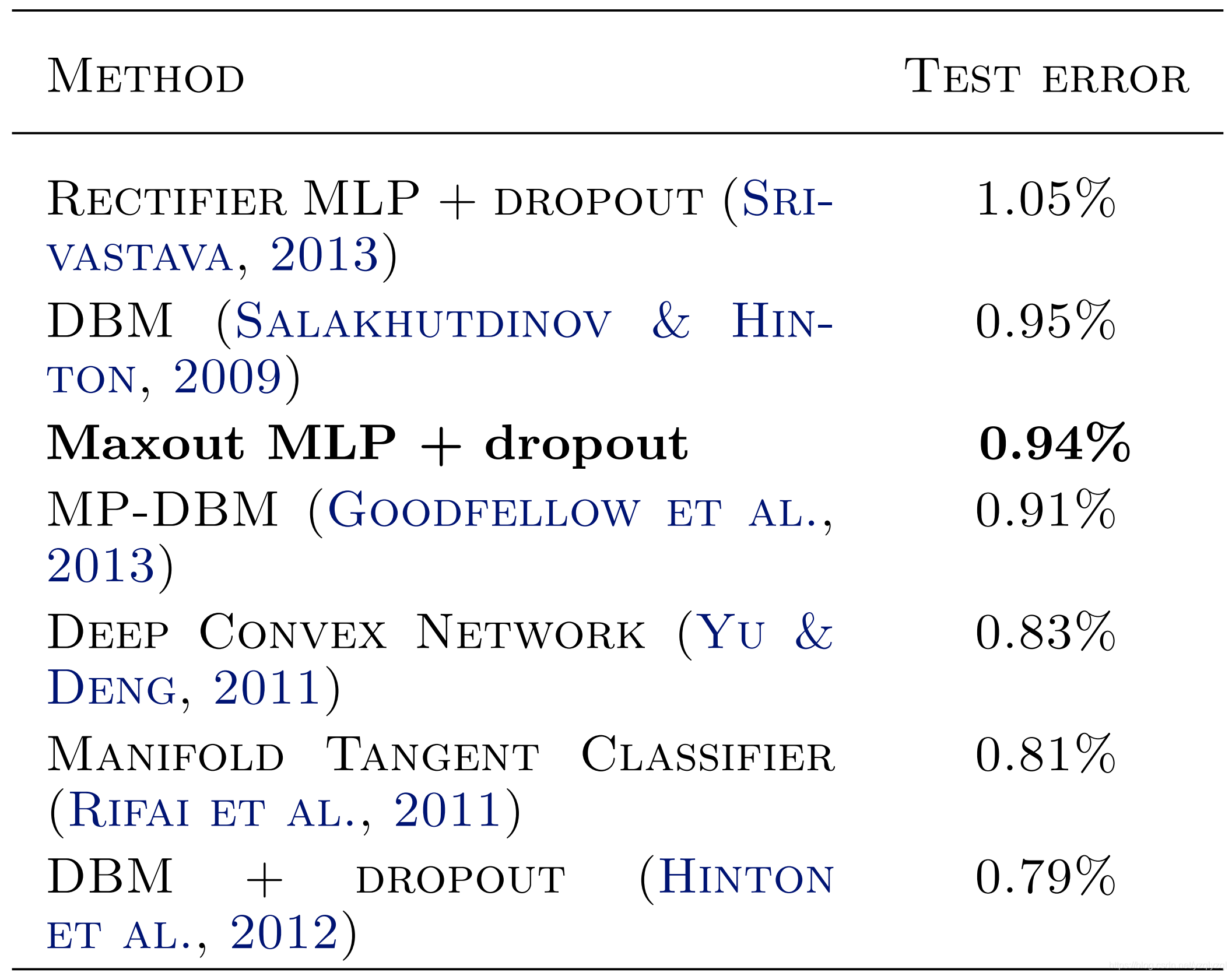

下表是在一般的MNIST数据集上测试最佳方法的错误分类率,不包括增加训练数据的方法:

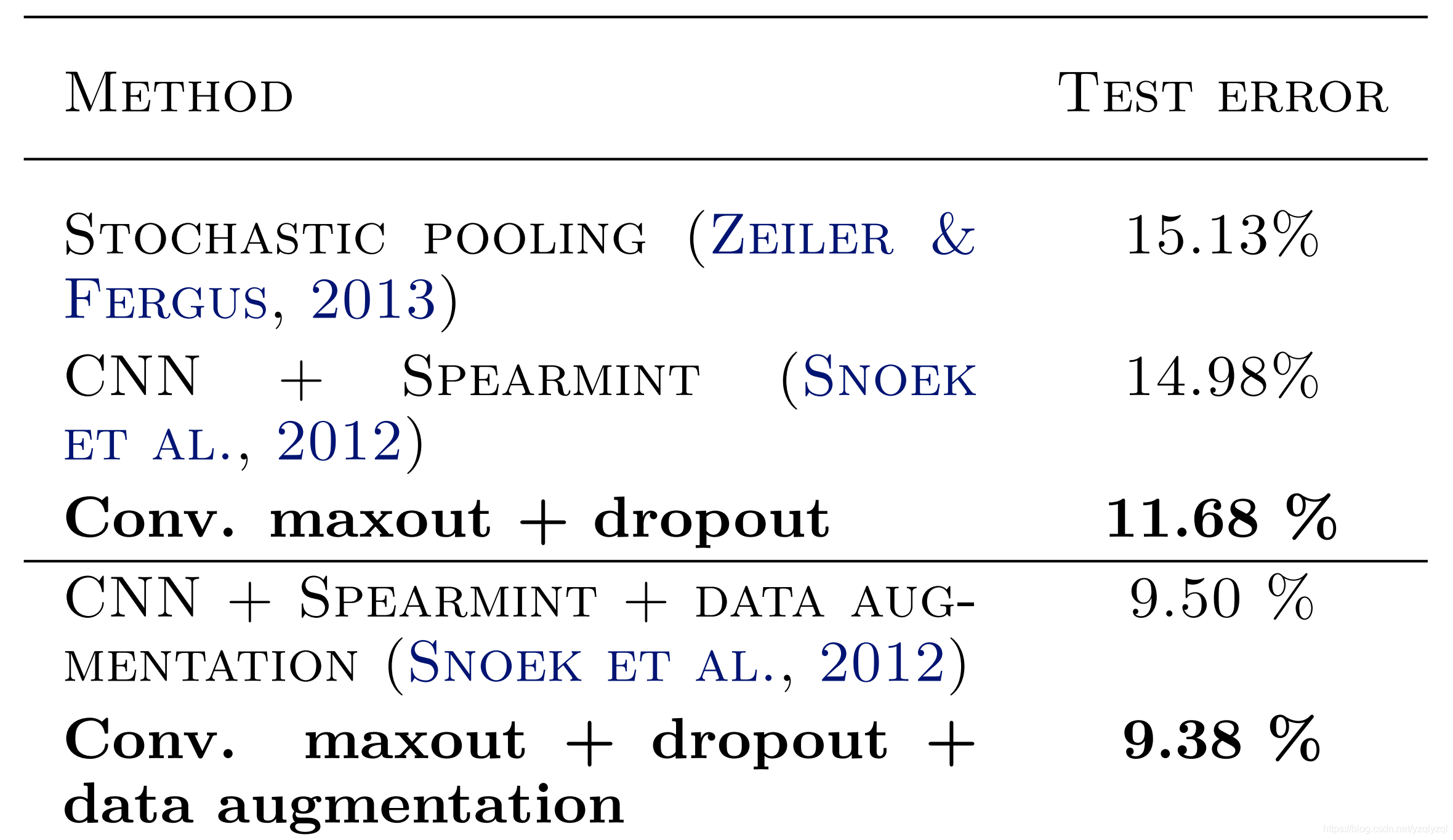

下表是在CIFAR-10数据集上最佳方法的测试集错误分类率:

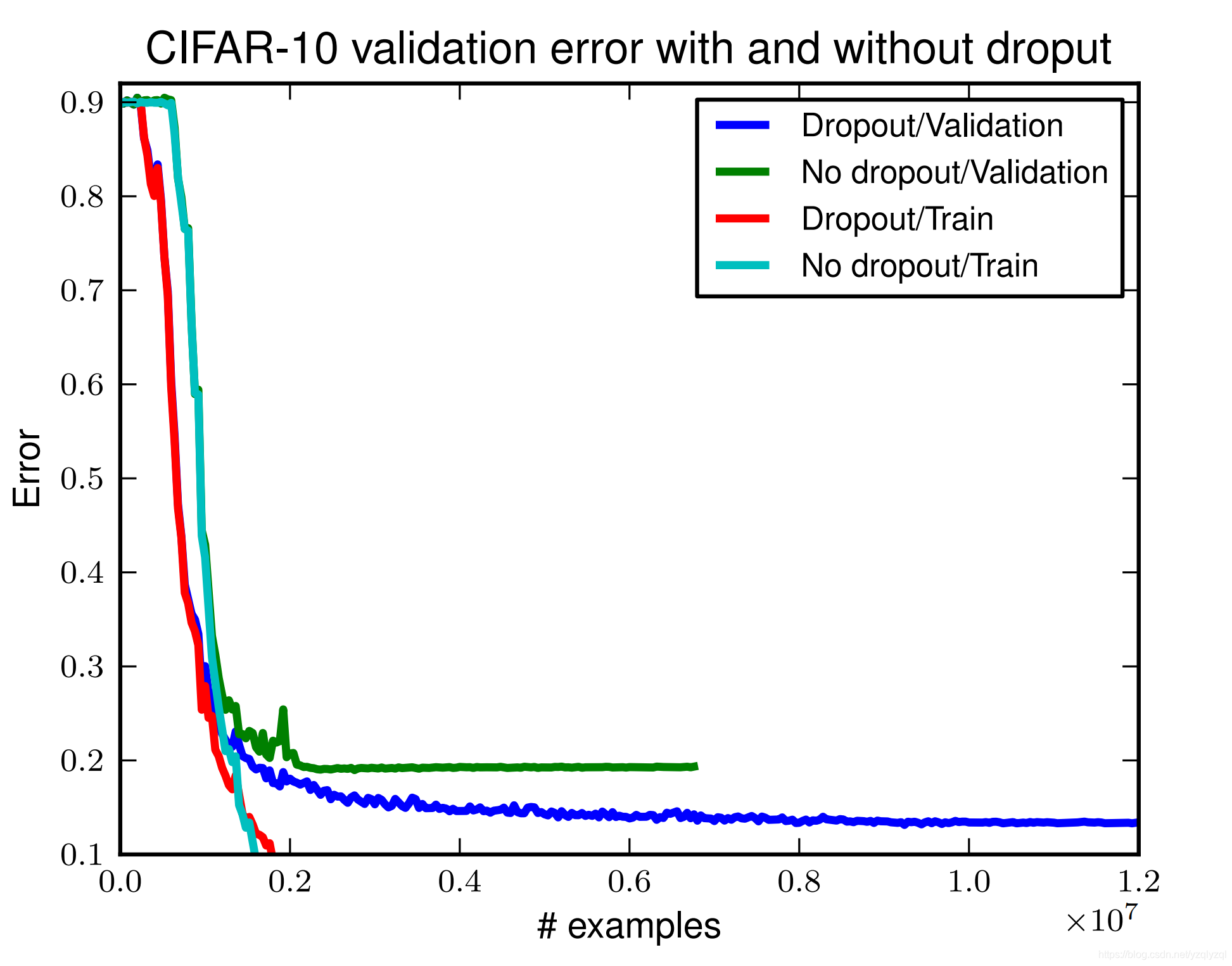

下图探究了maxout与dropout的联动效果:

可以发现,dropout对maxout是至关重要的。

下表是在SVHN数据集上测试最佳方法的错误分类率:

本文介绍了Maxout网络,一种由Ian J. Goodfellow等人提出的新型激活函数,它能近似任何函数并提升深层网络性能。文章详细解释了Maxout的工作原理,展示了其在MNIST、CIFAR-10等数据集上的实验结果,并讨论了与dropout结合的效果。

本文介绍了Maxout网络,一种由Ian J. Goodfellow等人提出的新型激活函数,它能近似任何函数并提升深层网络性能。文章详细解释了Maxout的工作原理,展示了其在MNIST、CIFAR-10等数据集上的实验结果,并讨论了与dropout结合的效果。

4584

4584

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?