介绍

- llama:LLaMA(Large Language Model Meta AI)是由 Meta(原Facebook公司)发布的一系列大型语言模型。这些模型旨在处理和生成自然语言文本,能够执行多种任务,如文本摘要、翻译、问答、文本生成等。LLaMA 模型因其高效的性能和较小的模型尺寸而受到关注,这使得它们能够在资源有限的环境中运行,例如个人计算机或移动设备。

- Ollama:是一个开源的大型语言模型服务工具,由 Meta发布。

前排提示,文末有大模型AGI-优快云独家资料包哦!

平台功能

- 模型运行和管理:Ollama 允许用户在本地机器上运行大型语言模型,提供了简单的 API 来创建、运行和管理模型 。

- 模型库:Ollama 拥有一个丰富的预构建模型库,这些模型可以轻松地集成到各种应用程序中 。

- 多模态模型支持:Ollama 支持多模态模型,能够理解和生成与图像相关的描述 。

- REST API:Ollama 提供了一个 REST API,用于运行和管理模型,包括生成响应和与模型进行聊天 。

- 跨平台支持:Ollama 支持 macOS、Linux 和 Windows 操作系统,并且可以通过 Docker 容器进行部署 。

- 硬件加速:Ollama 能够识别正在运行的硬件,并在可能的情况下调用 GPU 加速模型的运行 。

- 易用性:Ollama 提供了多种安装方式,简化了安装和配置过程,使得用户即使没有专业背景也能轻松使用 。

- 社区集成:Ollama 拥有丰富的社区生态,提供了多种交互界面和插件,如网页、桌面、终端等,以及 Raycast 插件等 。

- 模型自定义:用户可以通过 Modelfile 自定义模型参数,包括系统提示词、对话模板、模型推理温度等 。

- 开源:作为一个开源项目,Ollama 允许用户查看、修改和贡献代码,促进了社区的协作和发展 。

平台优势

Ollama 平台在性能、稳定性和灵活性等方面相比其他 AI 平台具有一些显著的优势:

- 性能:Ollama 支持 GPU 加速,这使得它在处理大型语言模型(LLMs)时能够提供更快的推理速度。此外,Ollama 允许并发请求,更好地利用 GPU 资源,从而提高吞吐量。

- 稳定性:Ollama 提供了强大的模型管理功能,包括多版本控制和自动更新,这有助于确保平台的稳定性和模型的持续改进。

- 灵活性:Ollama 设计上考虑了未来模型的扩展性,易于添加新模型或更新现有模型。它还提供了灵活的安装方式,支持 macOS、Windows 和 Linux 操作系统,并且可以通过 Docker 容器进行部署。

- 易用性:Ollama 提供了简单的安装和配置过程,使得用户即使没有专业背景也能轻松使用。它还提供了多种交互界面和插件,如网页、桌面、终端等,以及 Raycast 插件等,增加了使用的灵活性。

- 本地化部署:Ollama 允许在本地机器上运行复杂的 AI 模型,降低了对网络的依赖,提高了数据处理的隐私性。

- 社区支持:Ollama 拥有活跃的社区和丰富的文档,便于用户学习和交流。

- 跨平台应用:Ollama 不仅限于 Linux,还提供了跨平台支持,无论使用 Windows、macOS 还是 Linux,都能满足用户的需求。

- 与 Python 的集成:Ollama 与 Python 的无缝集成,只需几行代码,就可以运行本地语言模型并将其集成到 Python 项目中。

- 隐私保护:OLLAMA 使所有数据处理在本地设备上完成,这对于用户隐私来说是一大胜利。

- 多功能性:OLLAMA 不仅适用于 Python 爱好者,其灵活性还使其适用于各种应用,包括 Web 开发。

部署流程

step1 安装Ollama

OLLAMA_MODELS = E:/xxx

OLLAMA_HOST = 0.0.0.0:11434

OLLAMA_ORIGINS = *

step2 下载模型

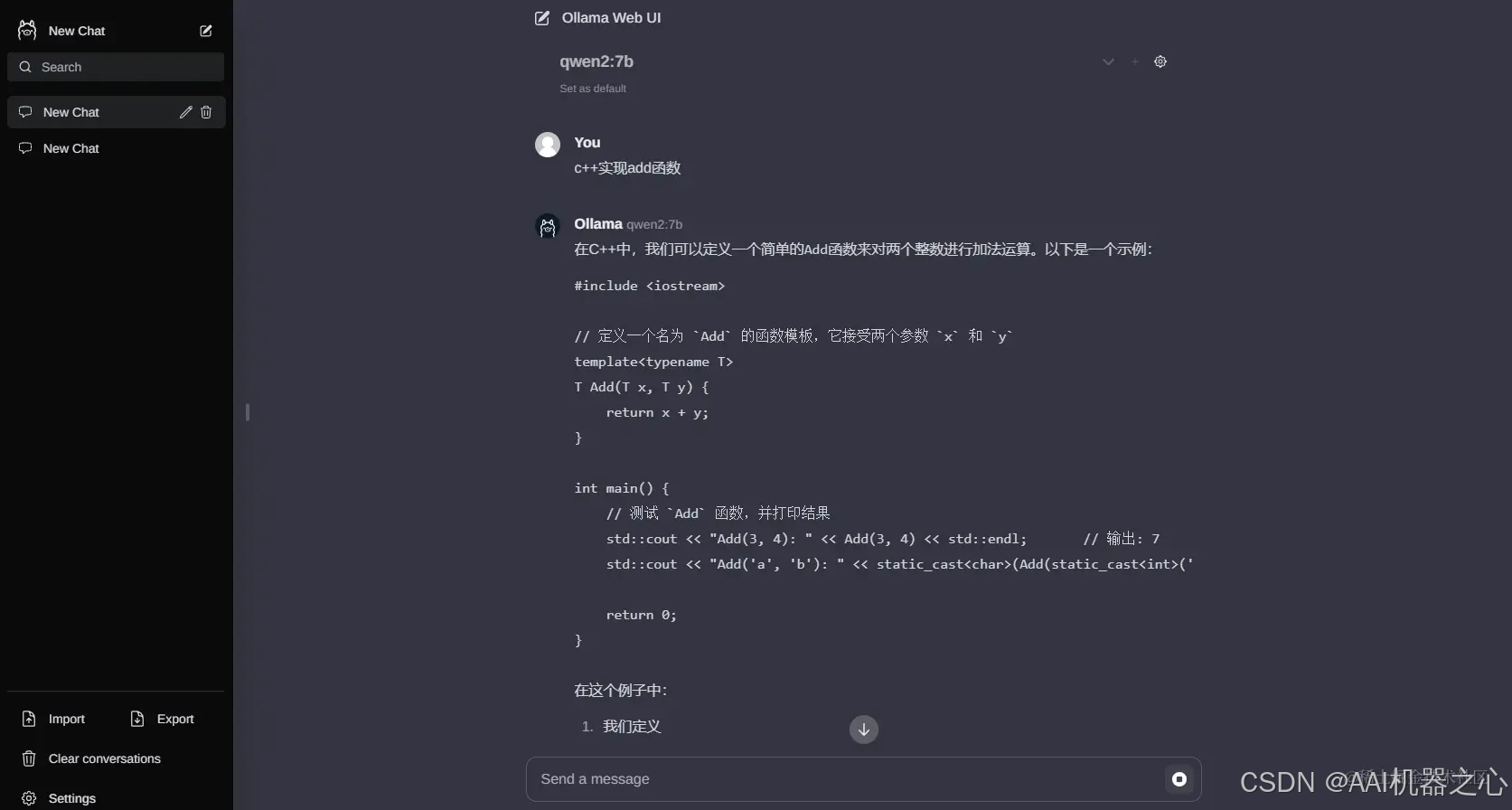

step3 安装ollama-webui-lite

https://github.com/ollama-webui/ollama-webui-lite

api接口访问ollama

curl -X POST http://localhost:11434/api/generate -d '{

"model": "llama3",

"prompt":"Why is the sky blue?"

}'

注意:为了其他电脑能够访问,修改源码文件:src/lib/constants.ts,将localhost改为本机IP

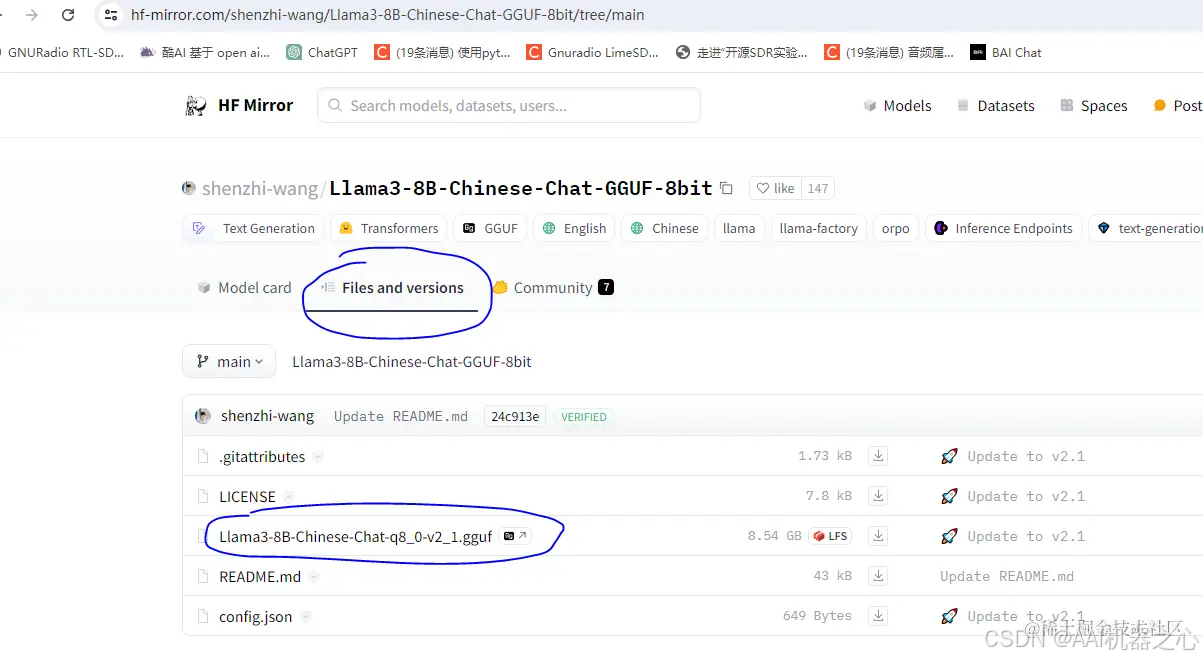

在社区获取更多模型

https://huggingface.co/

https://hf-mirror.com/models

选择library-gguf,可通过Chinese进行筛选支持中文的模型。

下载gguf文件后,使用ollama提供的指令进行加载模型。

https://github.com/ollama/ollama

读者福利:如果大家对大模型感兴趣,这套大模型学习资料一定对你有用

对于0基础小白入门:

如果你是零基础小白,想快速入门大模型是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以根据这些资料规划好学习计划和方向。

包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学习、大模型书籍PDF。带你从零基础系统性的学好大模型!

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

👉AI大模型学习路线汇总👈

大模型学习路线图,整体分为7个大的阶段:(全套教程文末领取哈)

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

397

397

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?