1. 运行准备

环境搭建请移步:https://blog.youkuaiyun.com/wyw0000/article/details/145105081

1.1 安装nfs服务

服务端安装nfs服务,用于将yolo相关目录及依赖库挂在到板端

apt-get install nfs-kernel-server

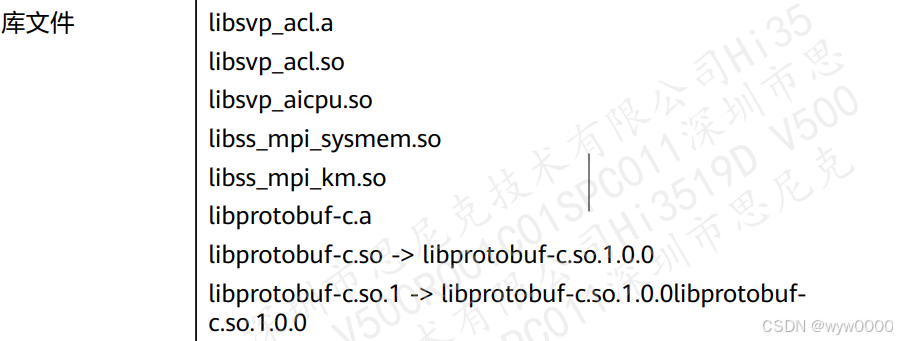

1.2 依赖库

这些库位于Hi3519DV500_SDK_V1.0.1.1\smp\smp\a55_linux\source\out\lib目录下

将其挂在到板端,并添加到环境变量中:

telnet 192.168.0.11

mount -t nfs -o nolock 192.168.0.248:/home/zm/wyw/Hi3519DV500_SDK_V1.0.1.1/smp/smp/a55_linux/source/out/lib /tmp/lib

export LD_LIBRARY_PATH=$LD_LIBRARY_PATH:/tmp/lib

1.3 opencv库

位于SVP_NNN_PC_V3.0.2.1/Sample/samples/third_party/musl/opencv目录下

将其挂在到板端,并添加到环境变量中:

mkdir /tmp/opencv-lib

mount -t nfs -o nolock 192.168.0.248:/home/zm/wyw/SVP_NNN_PC_V3.0.2.1/Sample/samples/third_party/musl/opencv/lib /tmp/opencv-lib

export LD_LIBRARY_PATH=$LD_LIBRARY_PATH:/tmp/opencv-lib

1.4 挂载yolo目录

telnet 192.168.0.11

mkdir /tmp/yolo

mount -t nfs -o nolock,tcp 192.168.0.148 /home/xx/work/yolo /tmp/yolo

2. 运行yolov5demo

./board_musl_main 5 ../model/yolov5_original.om ../../dog_bike_car_yolov5.bin

[INFO] ./main param

param is model and input image bin pair(default 1)

[INFO] param 1: yolov1.om and dog_bike_car_yolov1.bin

[INFO] param 2: yolov2.om and dog_bike_car_yolov2.bin

[INFO] param 3: yolov3.om and dog_bike_car_yolov3.bin

[INFO] param 4: yolov4.om and dog_bike_car_yolov4.bin

[INFO] param 5: yolov5.om and dog_bike_car_yolov5.bin

[INFO] param 5_cpu: yolov5_cpu.om and dog_bike_car_yolov5.bin

[INFO] param 7: yolov7.om and dog_bike_car_yolov7.bin

[INFO] param 8: yolov8.om and dog_bike_car_yolov8.bin

[INFO] param x: yolox.om and dog_bike_car_yolovx.bin

[INFO] yolo v5

[INFO] acl init success

[INFO] open device 0 success

[INFO] set op wait time success

[INFO] create context success

[INFO] create stream success

[INFO] get run mode success

[INFO] load model ../model/yolov5_original.om success

[INFO] create model description success

[INFO] create model output success

[INFO] start to process file:../data/dog_bike_car_yolov5.bin

[INFO] model execute success

[INFO] dump data success

[INFO] input image width[640]; height[640]

[INFO] current class valid box number is: 1

[INFO] lx: 0.000000, ly: 409.000000, rx: 312.250000, ry: 622.000000, score: 0.918945; class id: 1

[INFO] current class valid box number is: 1

[INFO] lx: 21.625000, ly: 188.875000, rx: 261.500000, ry: 279.000000, score: 0.926270; class id: 2

[INFO] current class valid box number is: 1

[INFO] lx: 388.250000, ly: 405.500000, rx: 574.000000, ry: 629.500000, score: 0.910645; class id: 14

[INFO] current class valid box number is: 1

[INFO] lx: 386.500000, ly: 21.750000, rx: 584.000000, ry: 287.750000, score: 0.880859; class id: 16

[INFO] output data success

[INFO] unload model success, modelId is 34

[INFO] execute sample success

[INFO] end to destroy stream

[INFO] end to destroy context

[INFO] end to reset device is 0

[INFO] end to finalize acl

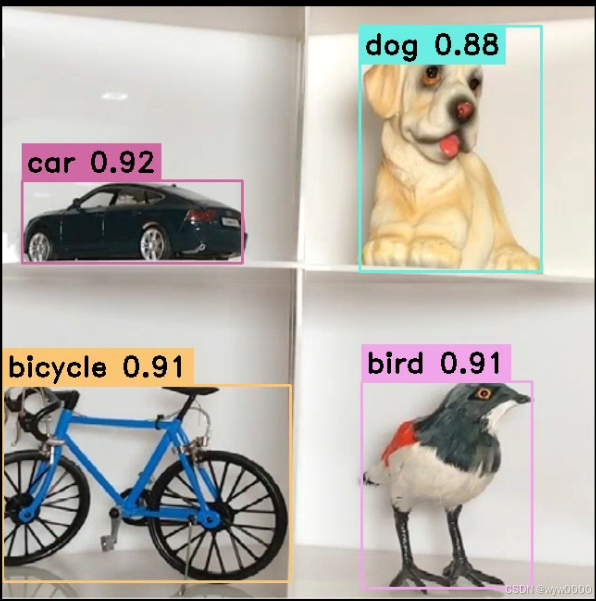

无报错的话,结果输出在yolo/out目录名为out_img_yolov5.jpg

结果如下:

2121

2121

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?