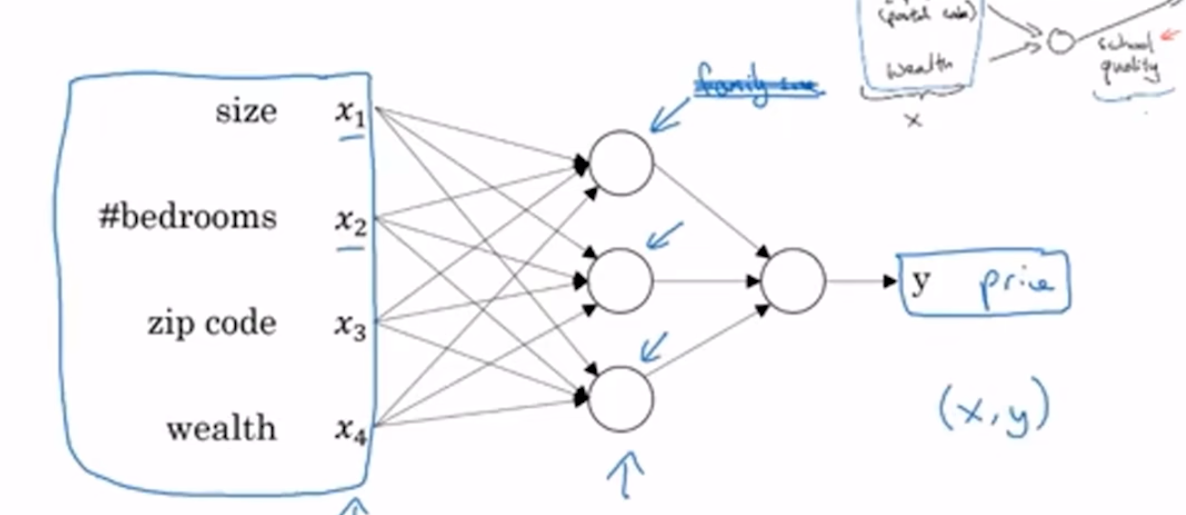

深度学习就是神经网络

只要输入x特征,即可得到计算结果y,中间的圆圈为中间层

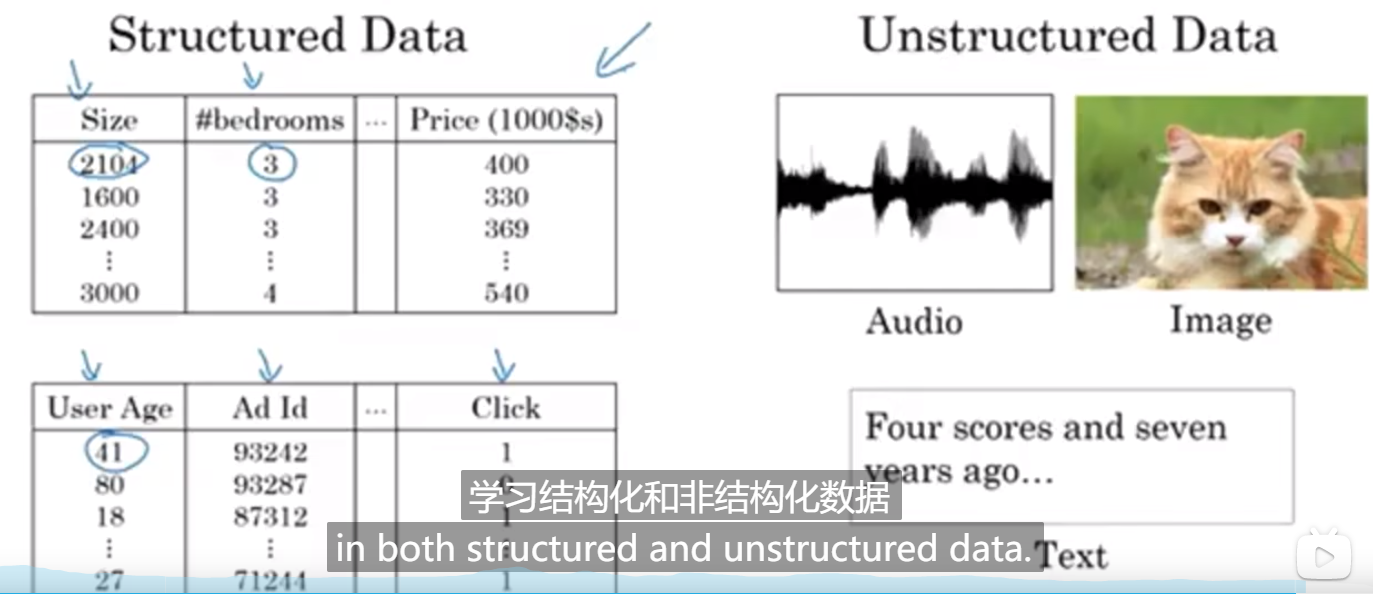

结构化与非结构化数据

左端为结构化数据,右端为非结构化数据

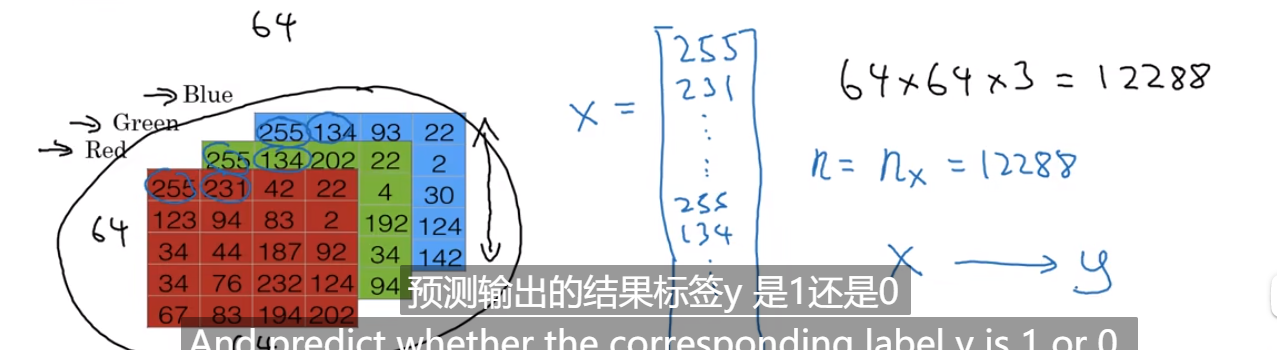

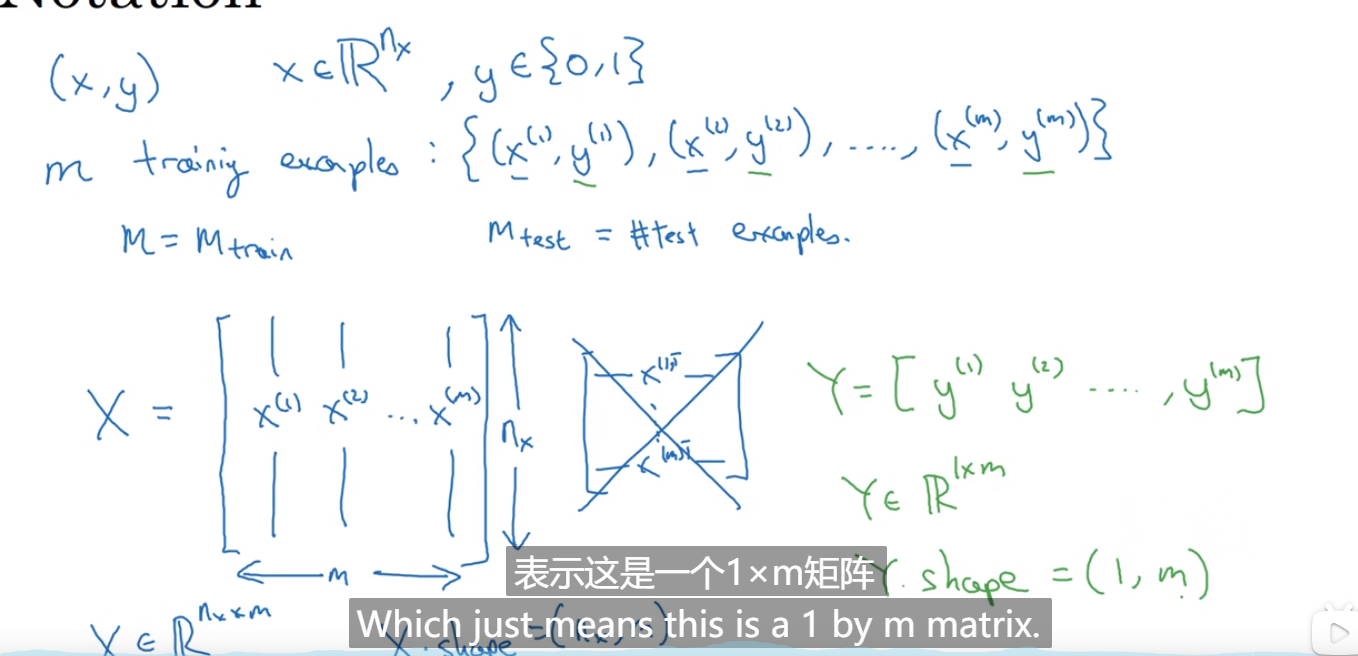

矩阵向量化

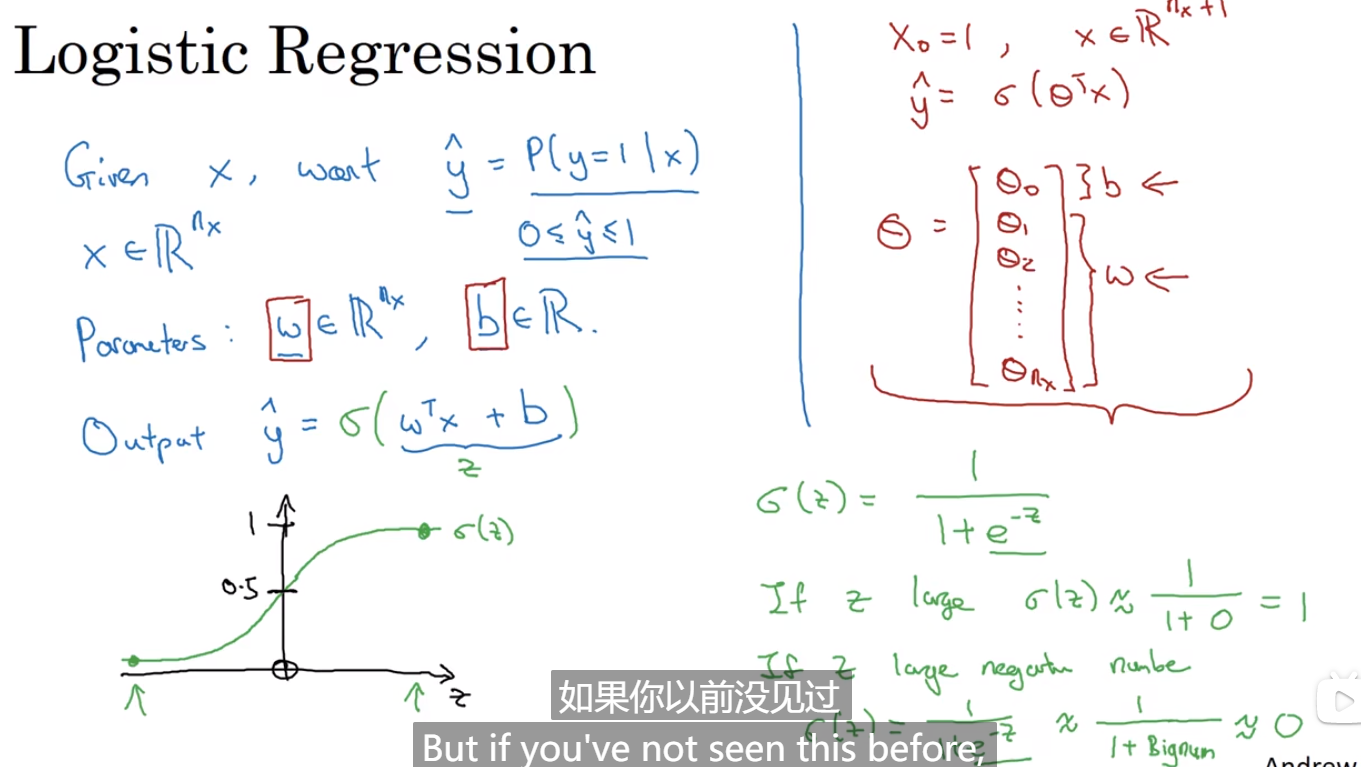

logic回归算法:一个用在监督学习问题(SVM)中输出y标签是0还是1的二元分类问题

logistic回归模型和sigmiod函数

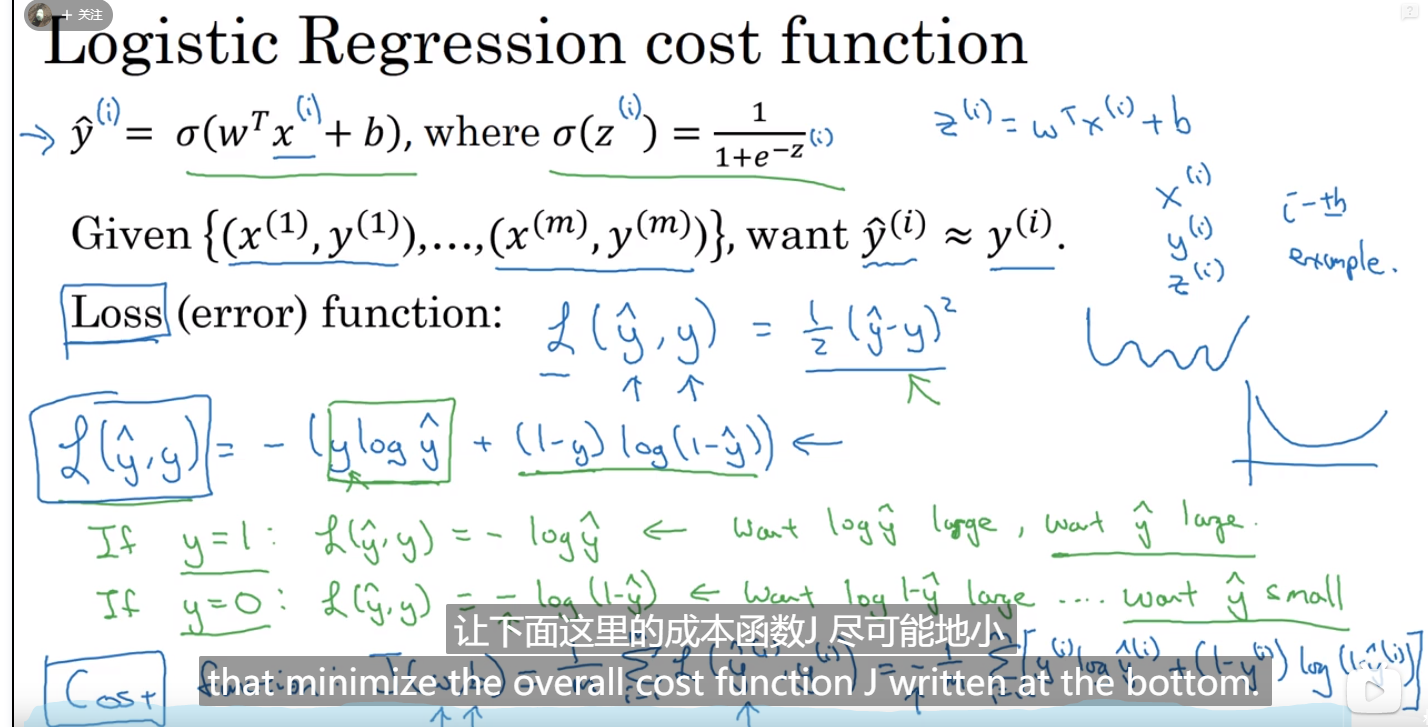

损失函数(loss function):

coss function工作原理

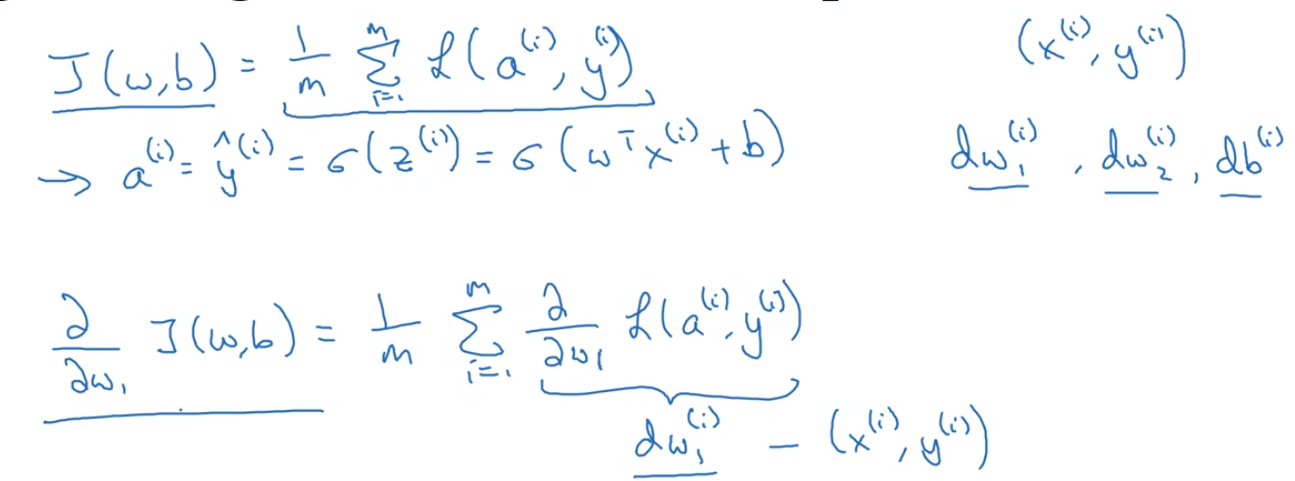

logic回归公式

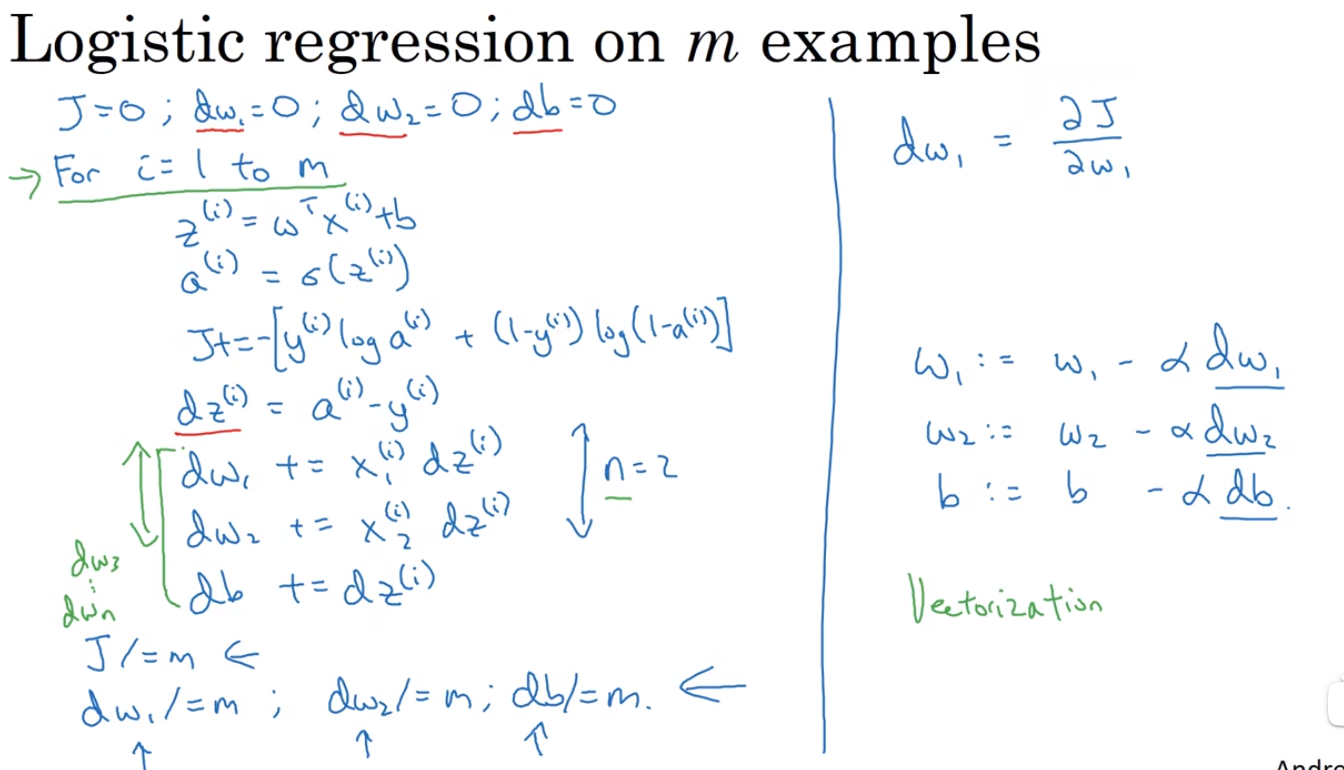

应用于多样本中

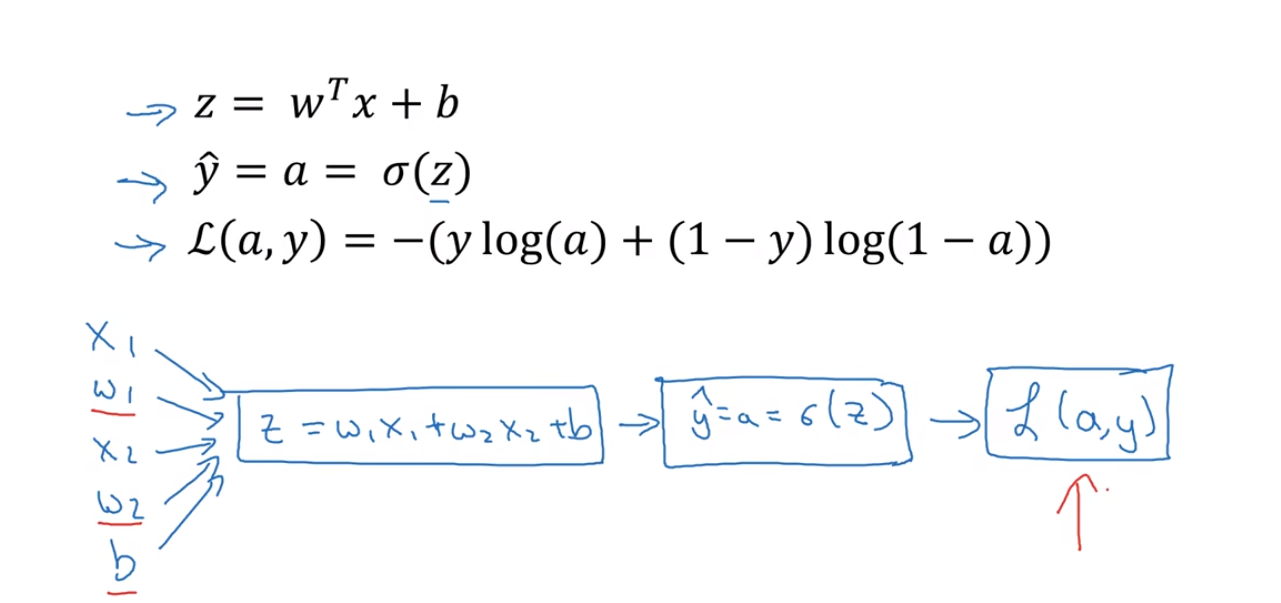

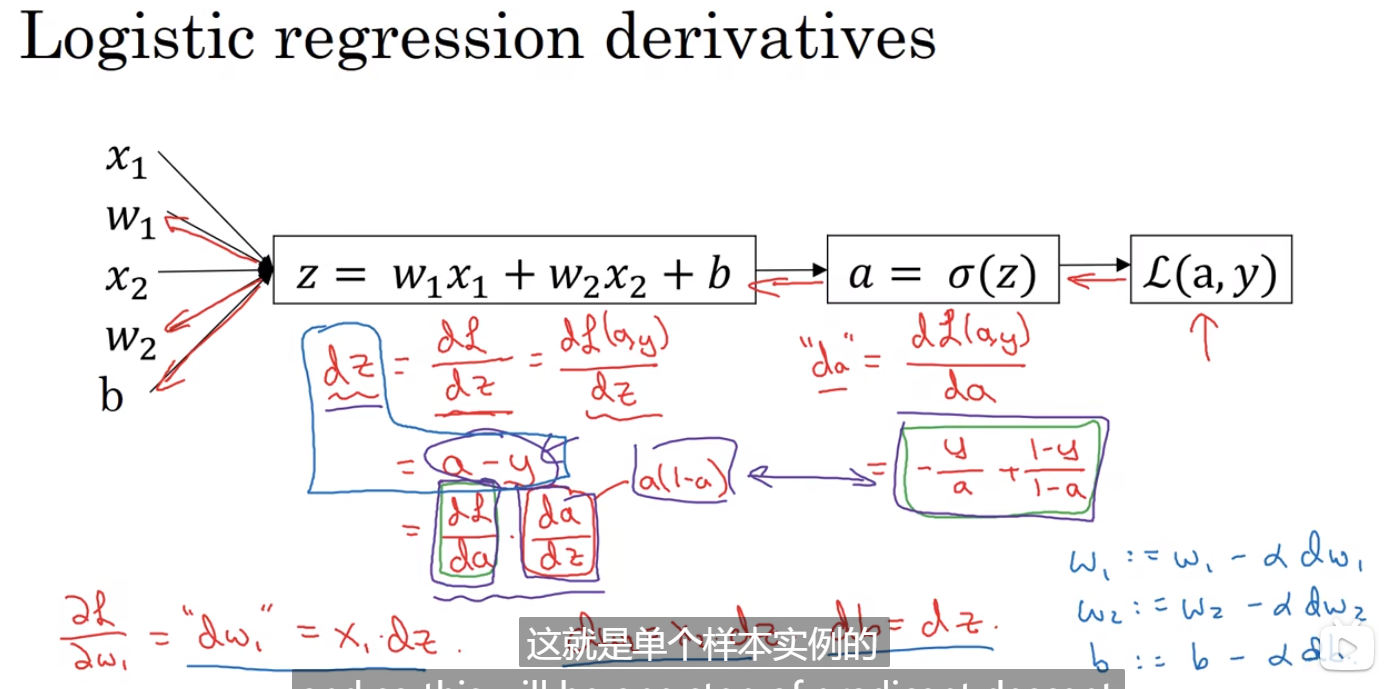

向后传播公式

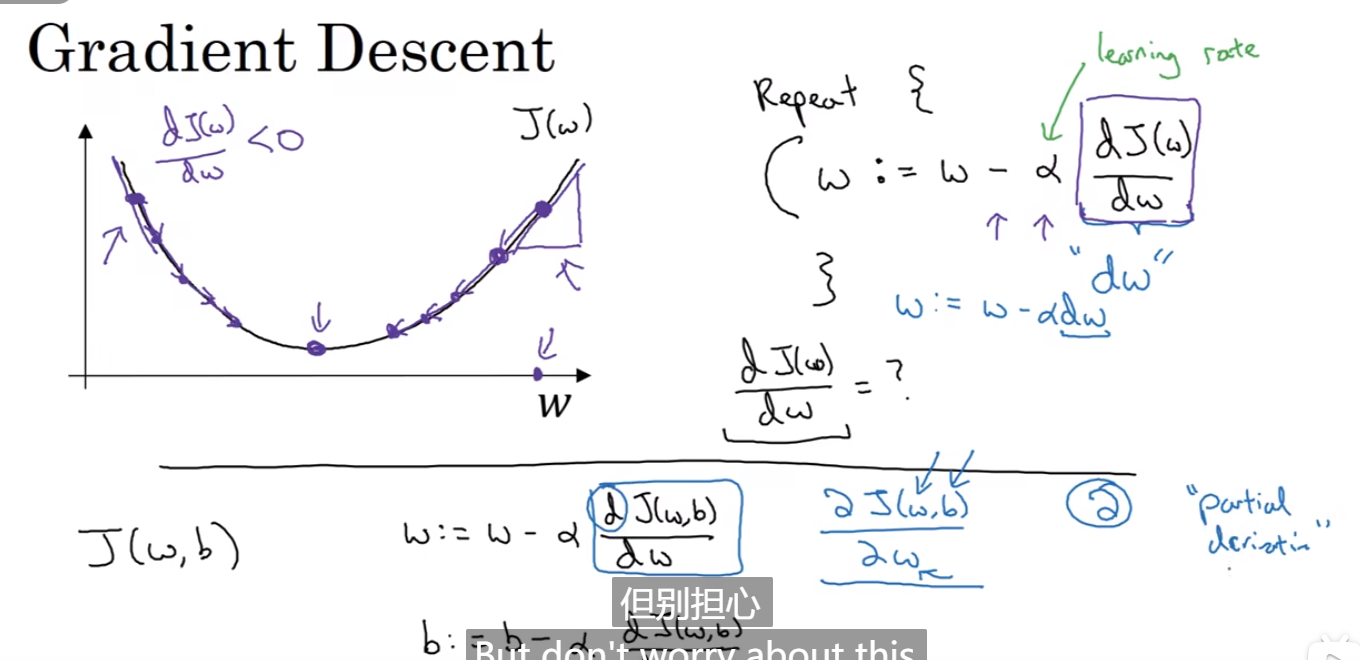

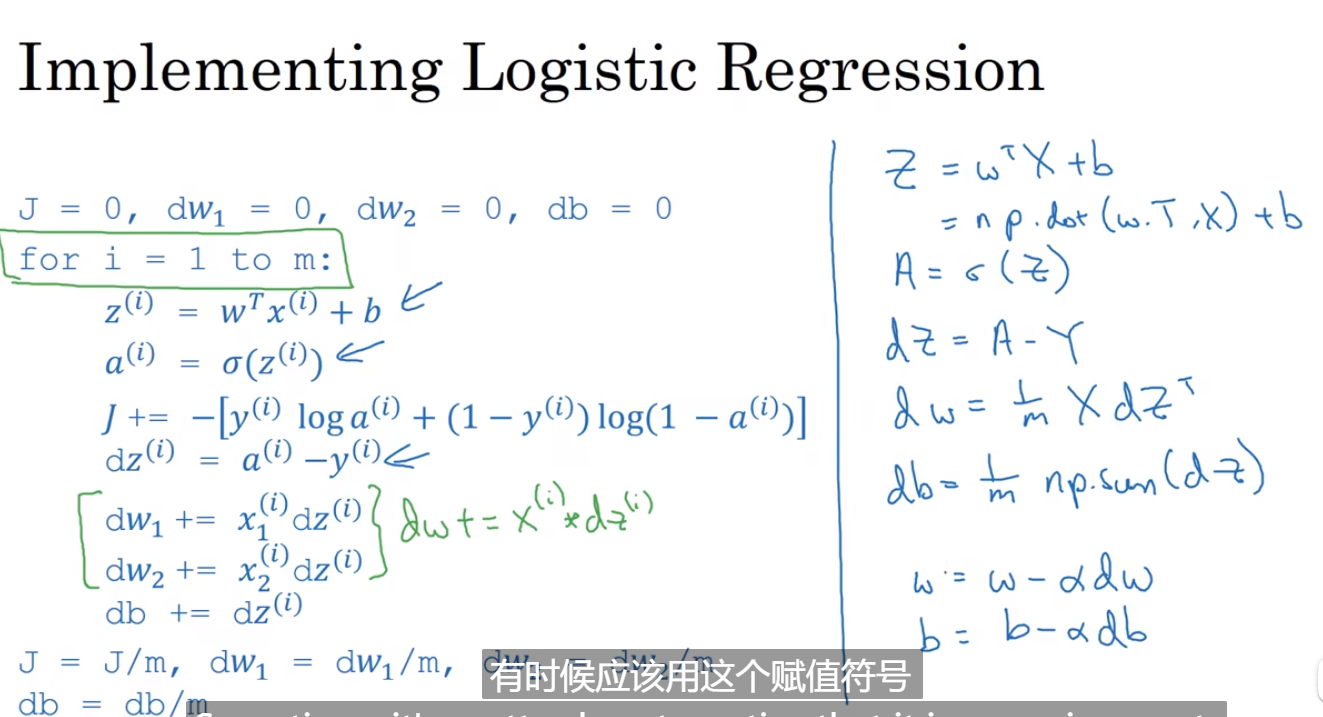

对logistic回归应用梯度下降法

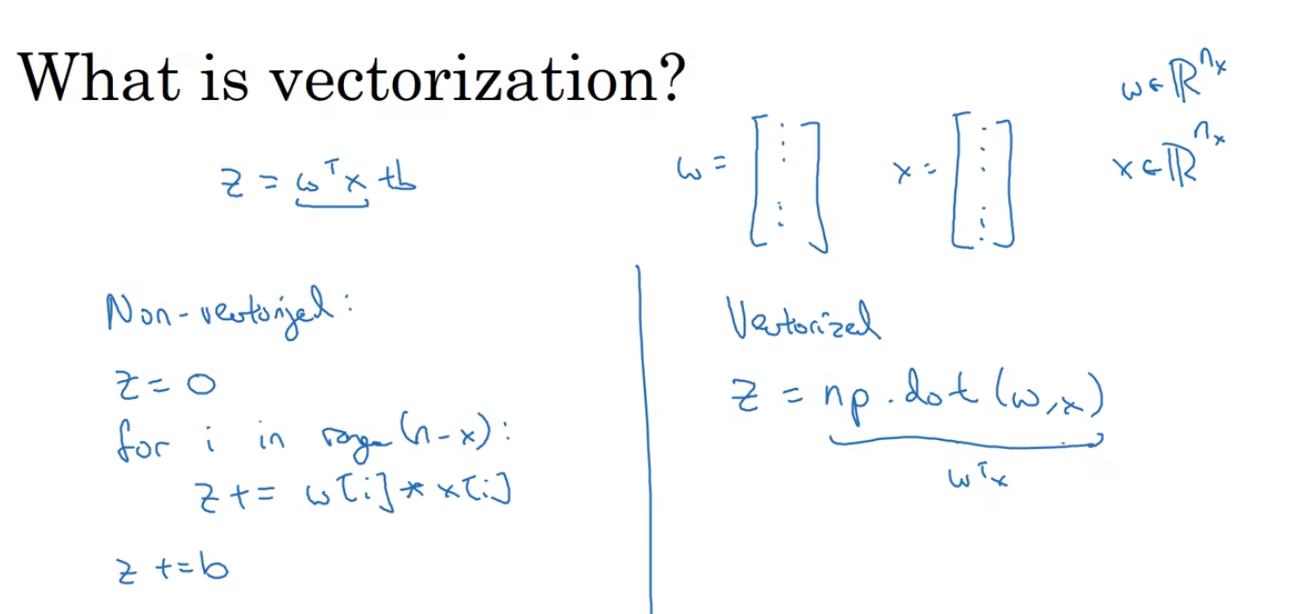

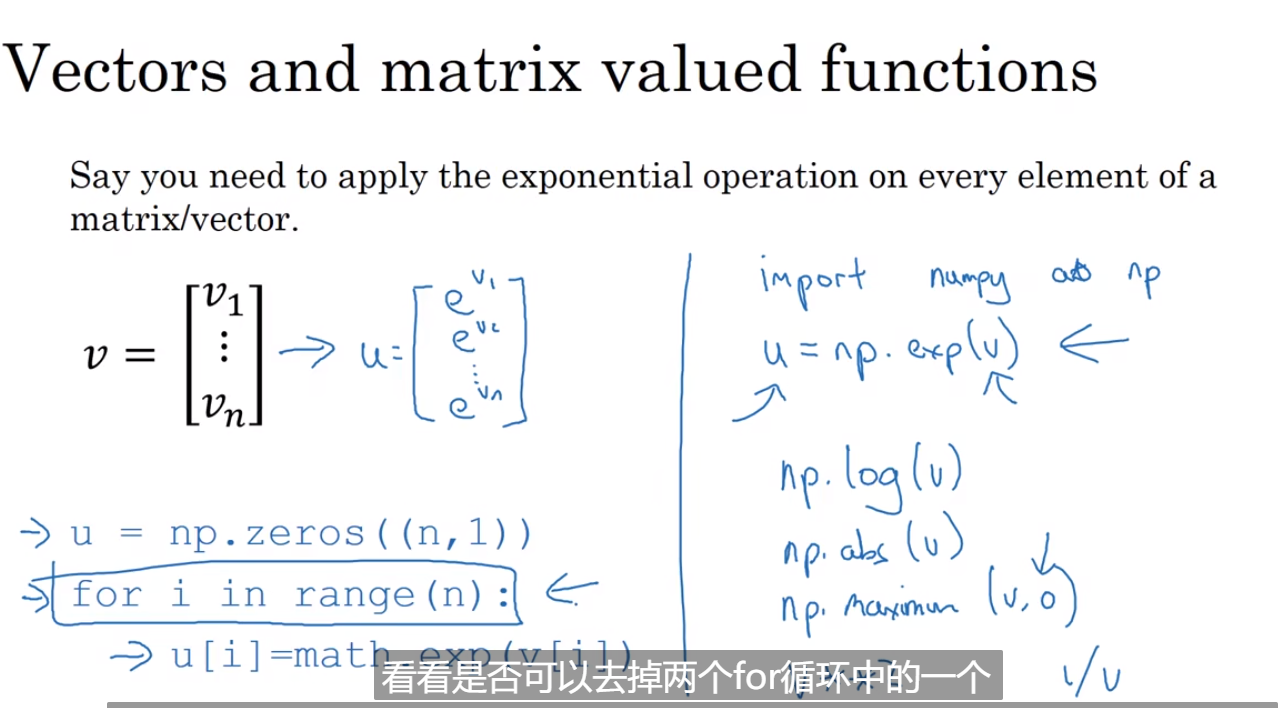

向量化可以消除代码中显式for循环的部分,让代码运行更加快速

pyhon中的np函数

向量化细节及其代码

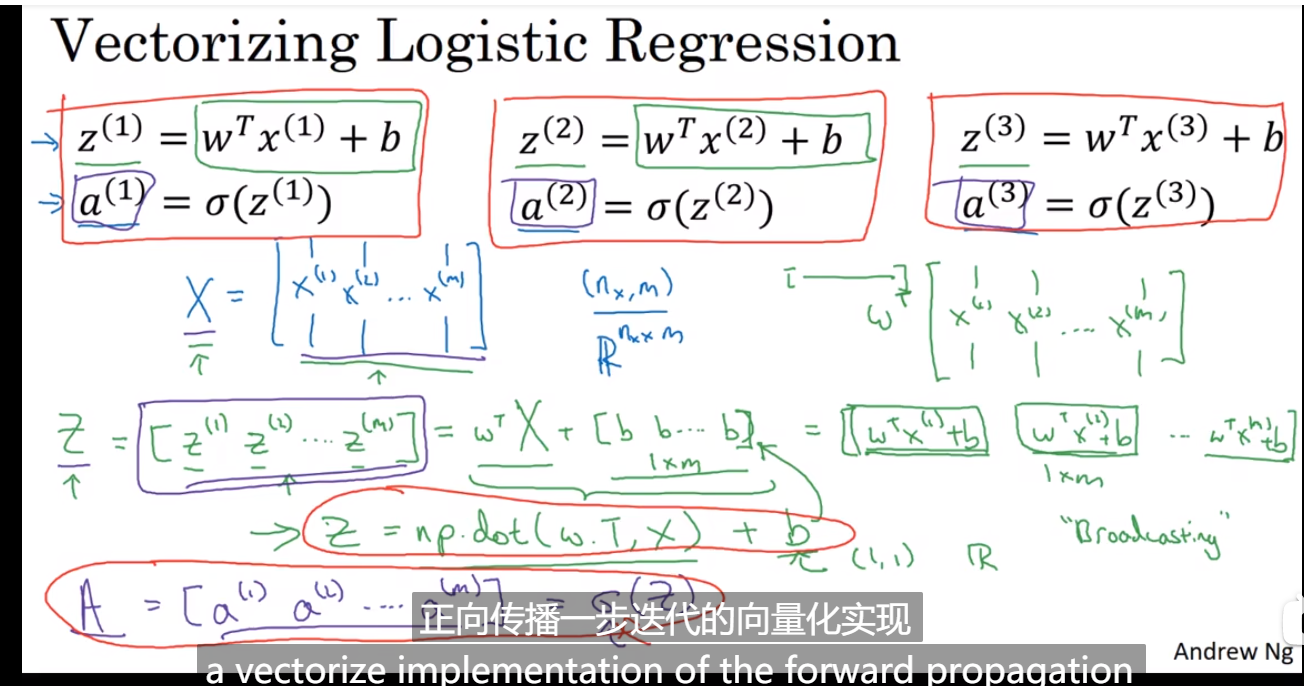

正向传播

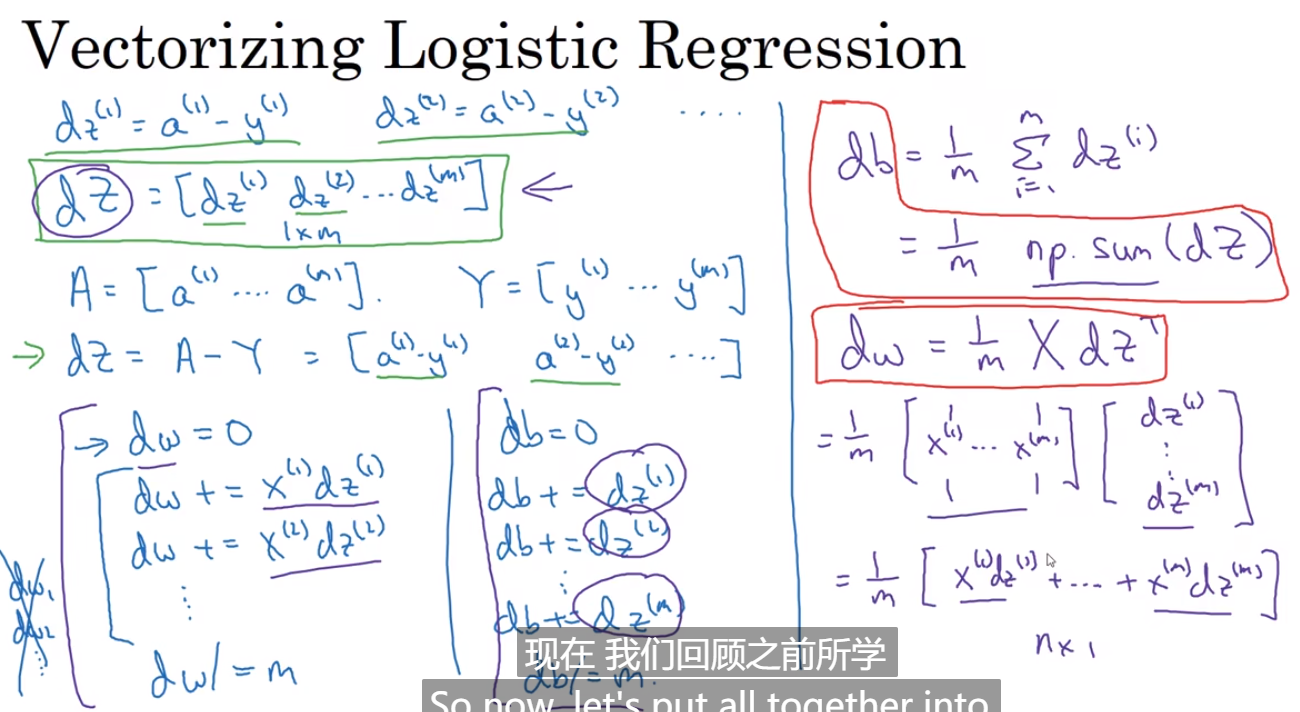

反向传播

左端是for循环,右端是向量化实现

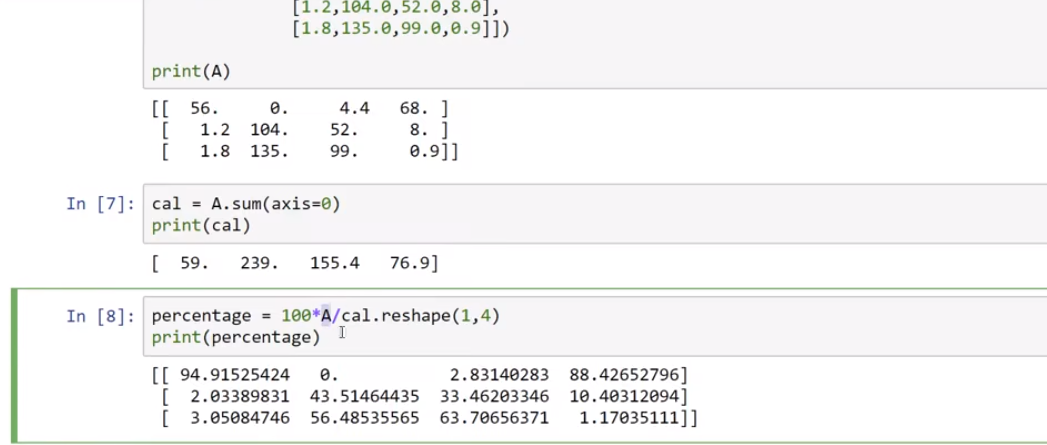

代码展示

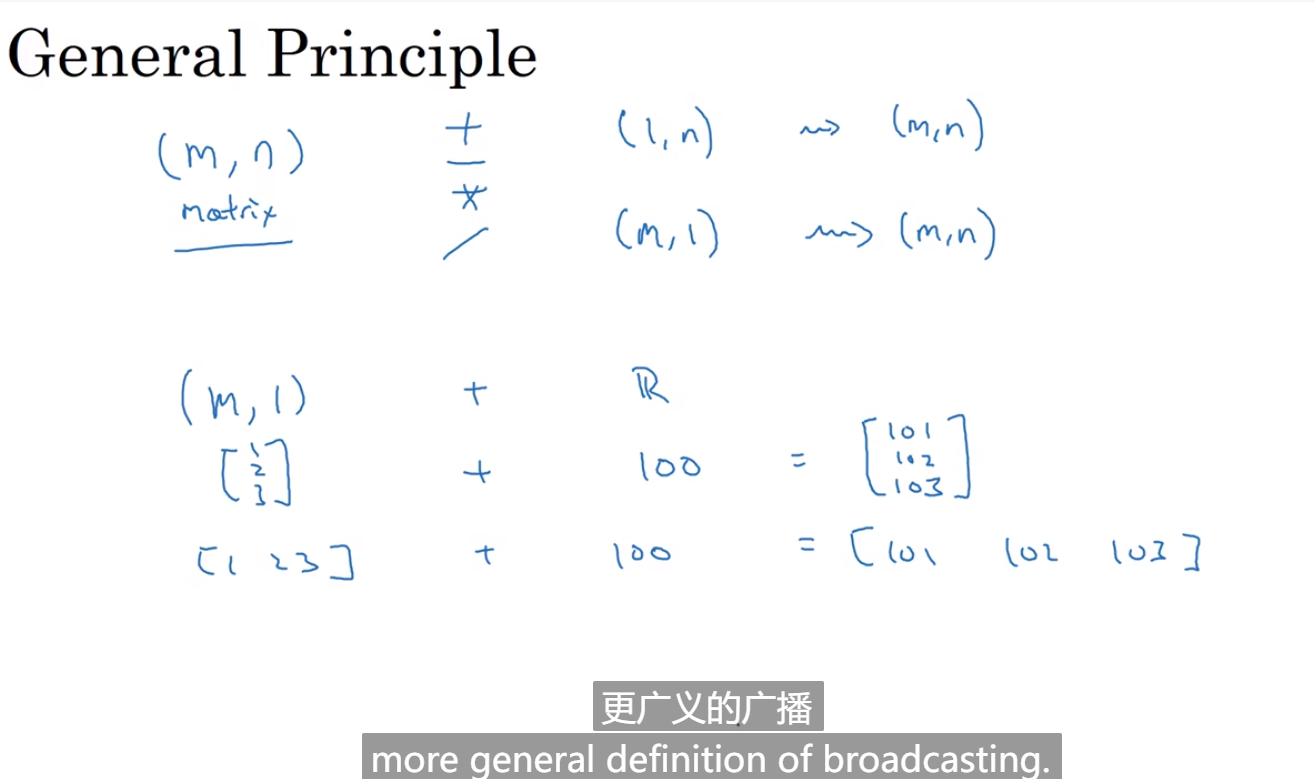

Python中的传播:在进行矩阵加减乘除运算时,会自动进行矩阵的扩充

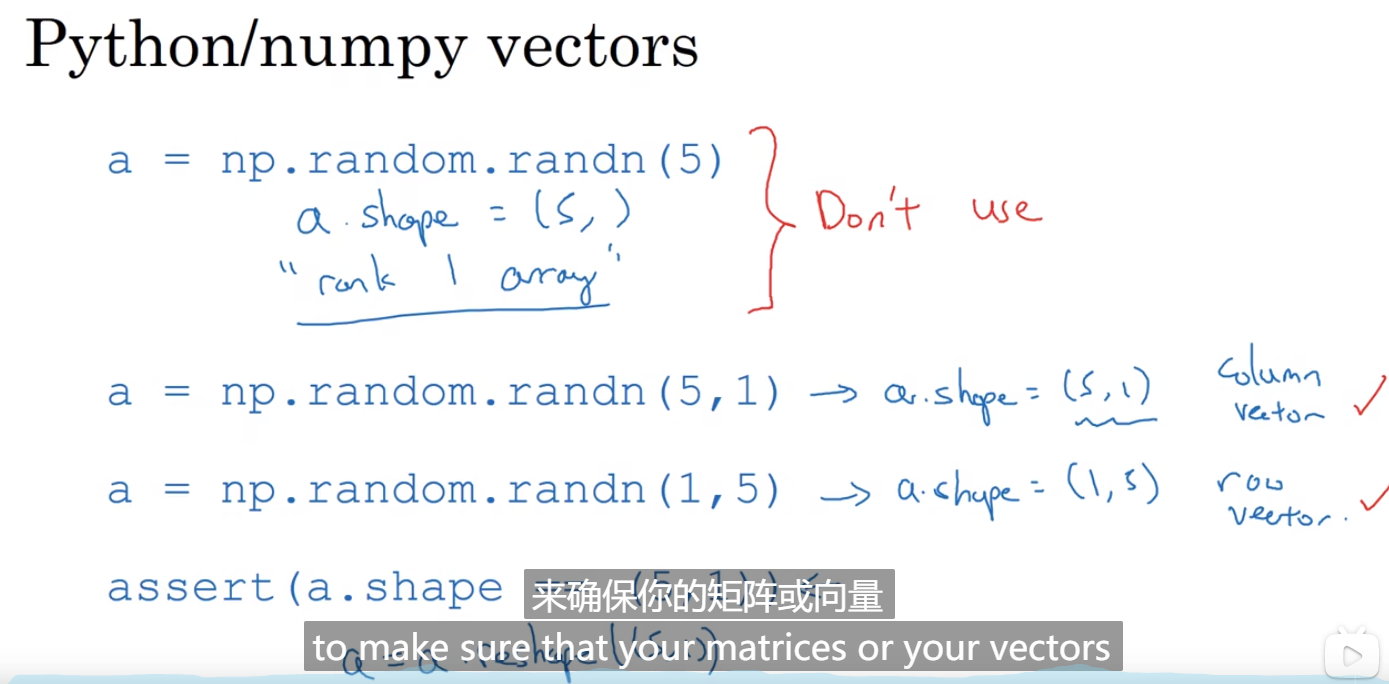

行向量或者列向量的编程习惯

这篇博客深入探讨了深度学习与神经网络的关系,阐述了如何通过输入特征x得到输出y的过程。同时,文章对比了结构化和非结构化数据的特点,并详细介绍了逻辑回归算法在二元分类问题中的应用,包括模型、损失函数和梯度下降法的实现。此外,还强调了向量化在提高代码效率中的作用,并展示了Python中的向量化操作实例。

这篇博客深入探讨了深度学习与神经网络的关系,阐述了如何通过输入特征x得到输出y的过程。同时,文章对比了结构化和非结构化数据的特点,并详细介绍了逻辑回归算法在二元分类问题中的应用,包括模型、损失函数和梯度下降法的实现。此外,还强调了向量化在提高代码效率中的作用,并展示了Python中的向量化操作实例。

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?