目录

一、程序及算法内容介绍:

基本内容:

-

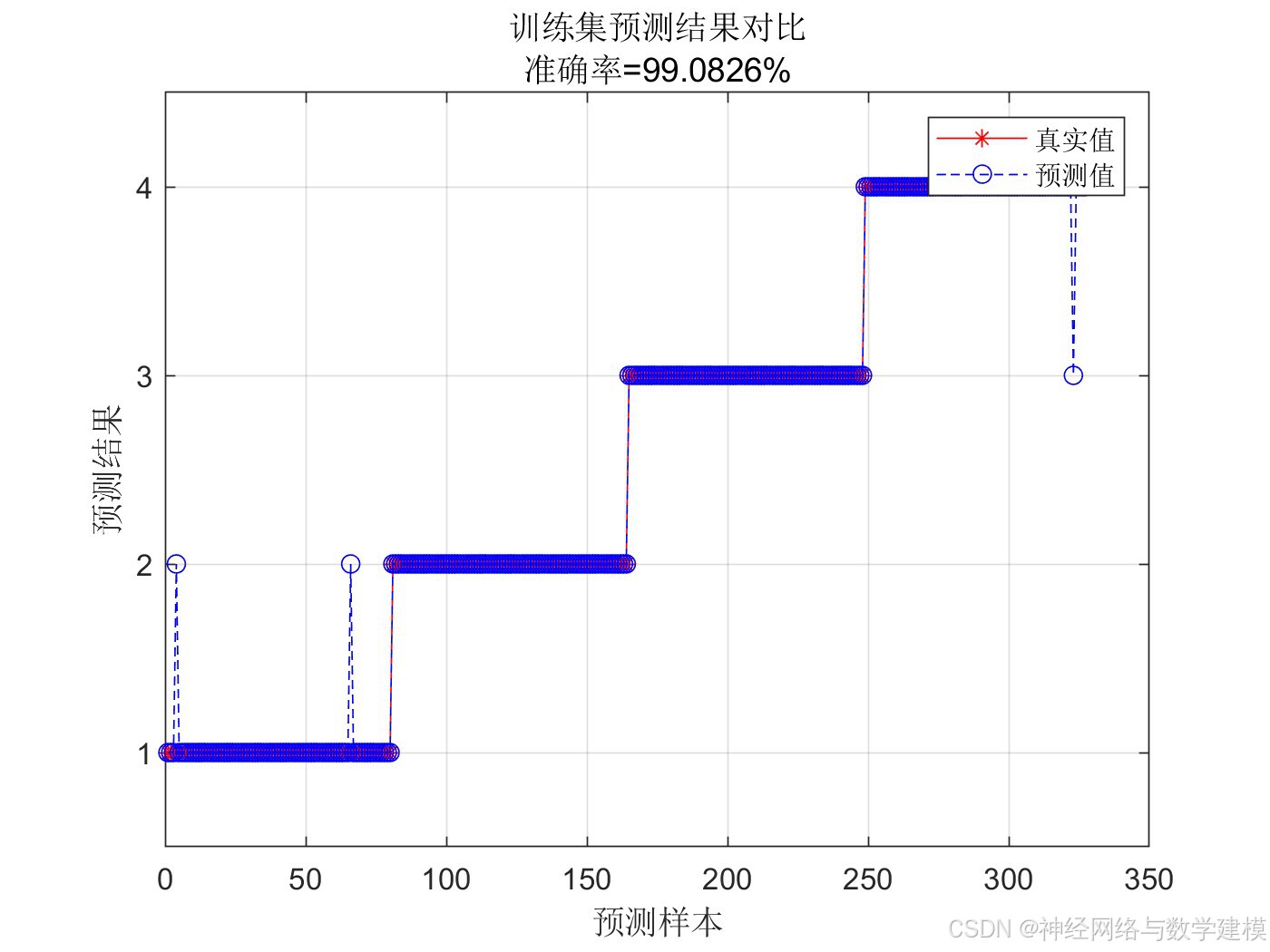

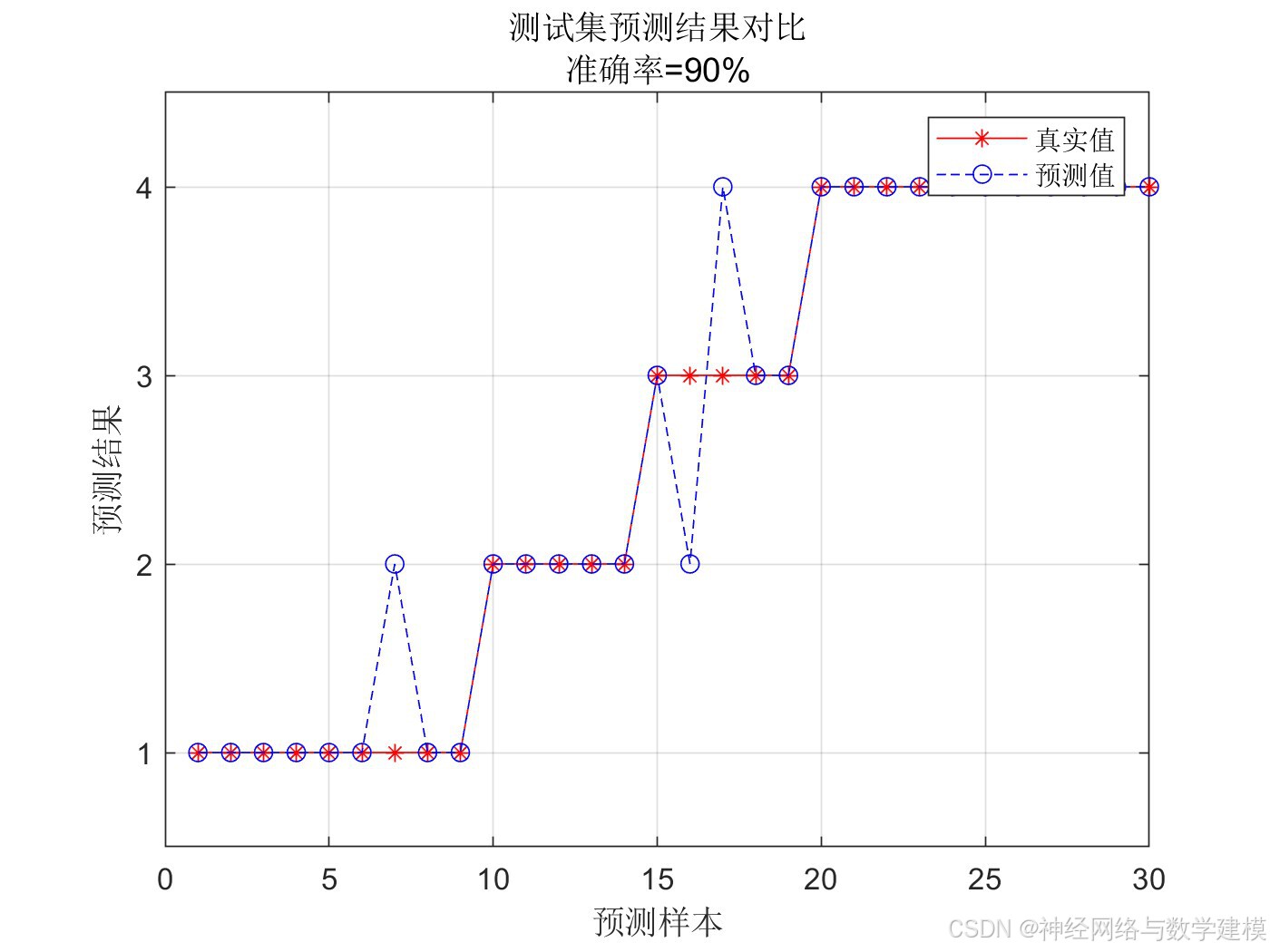

本代码基于Matlab平台编译,将AsyLnCPSO(学习因子异步化的粒子群算法)与CNN(卷积神经网络)-LSTM(长短期记忆神经网络)结合,进行多输入数据分类预测。(多变量分类预测,个数可自行指定)

-

输入训练的数据包含12个特征,1个响应值,即通过12个输入值预测1个输出值。(数据导入后自动归一化,提升泛化性)

-

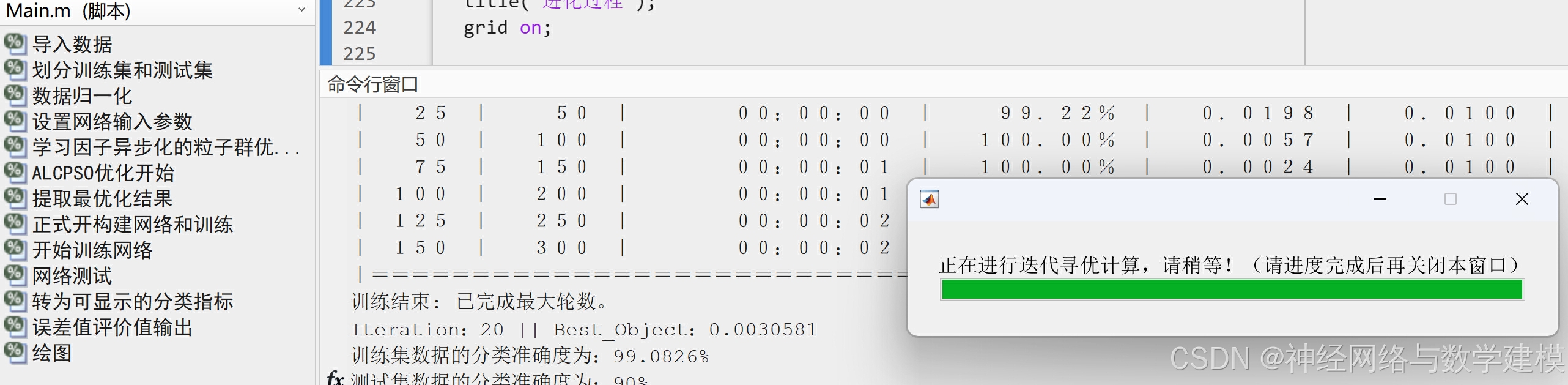

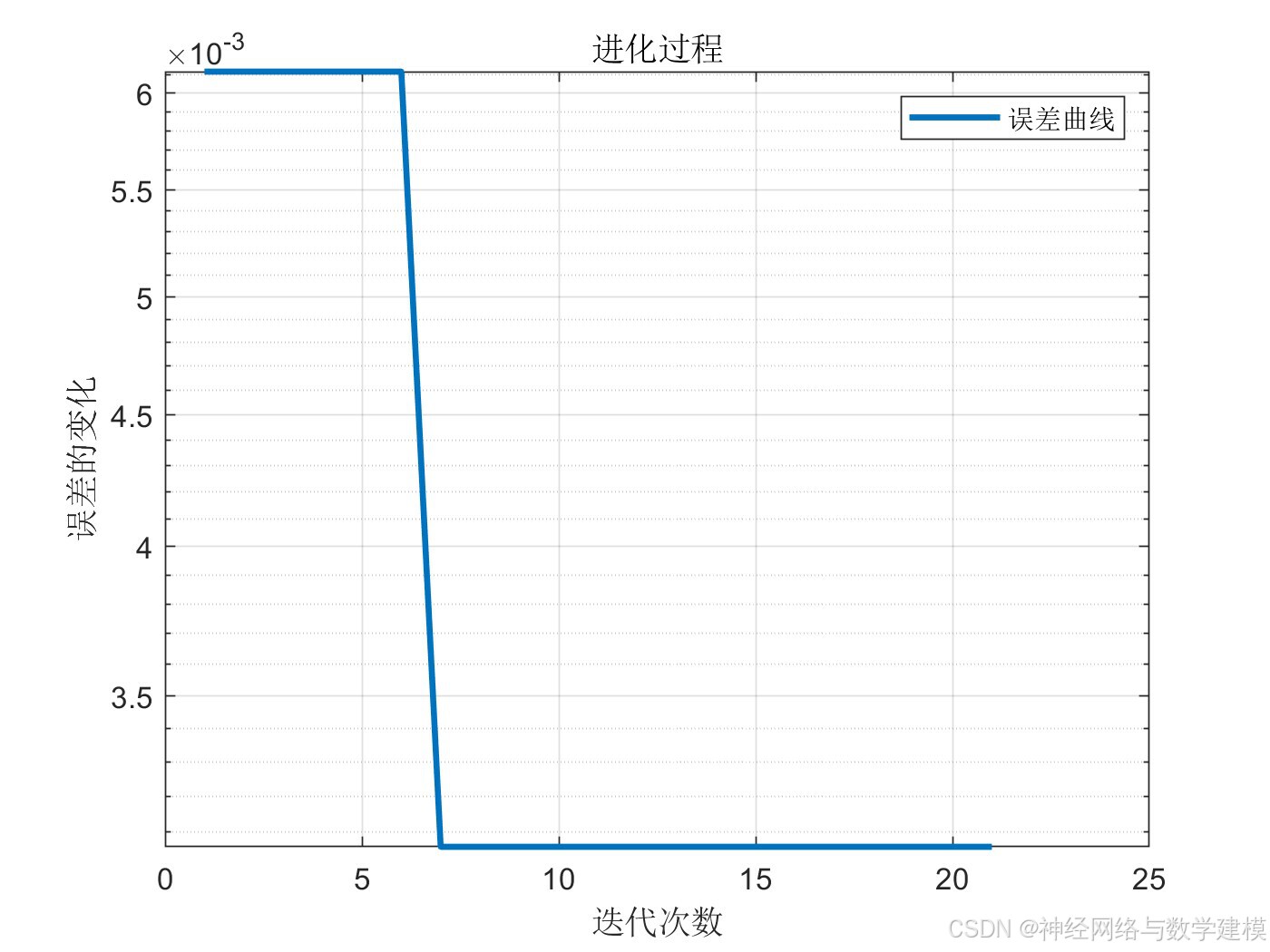

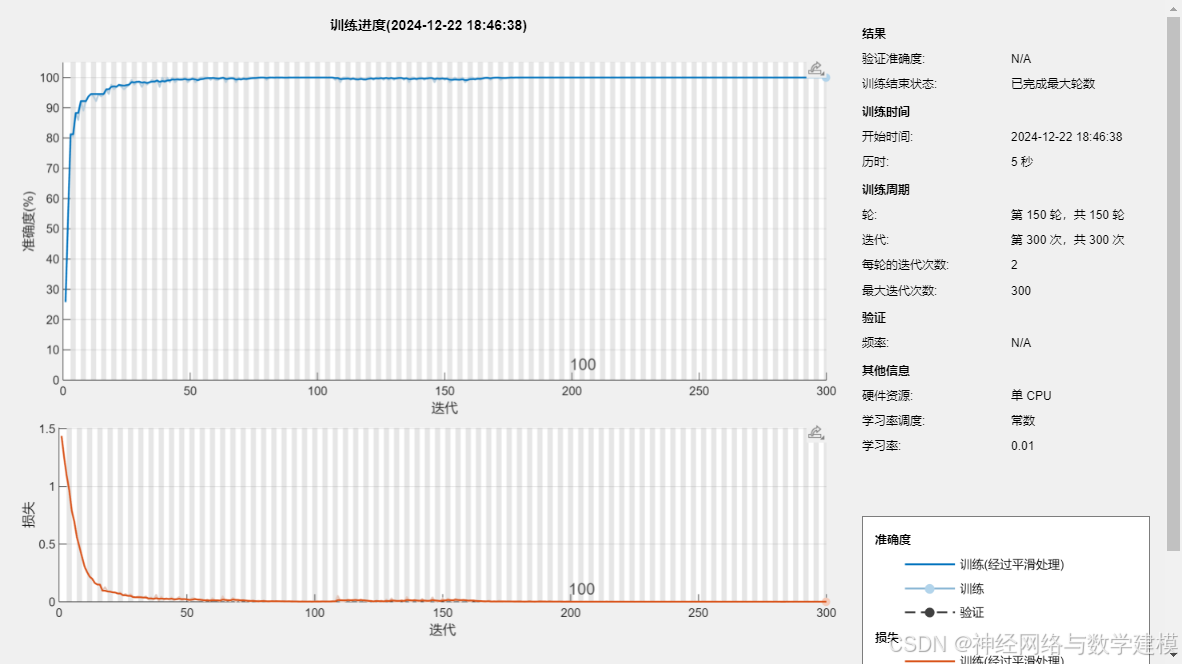

通过ALCPSO算法优化CNN-LSTM的学习率、神经元个数、卷积核个数参数,记录下最优的网络参数作为后续的应用网络。

-

迭代计算过程中,自动显示优化进度条,实时查看程序运行进展情况

-

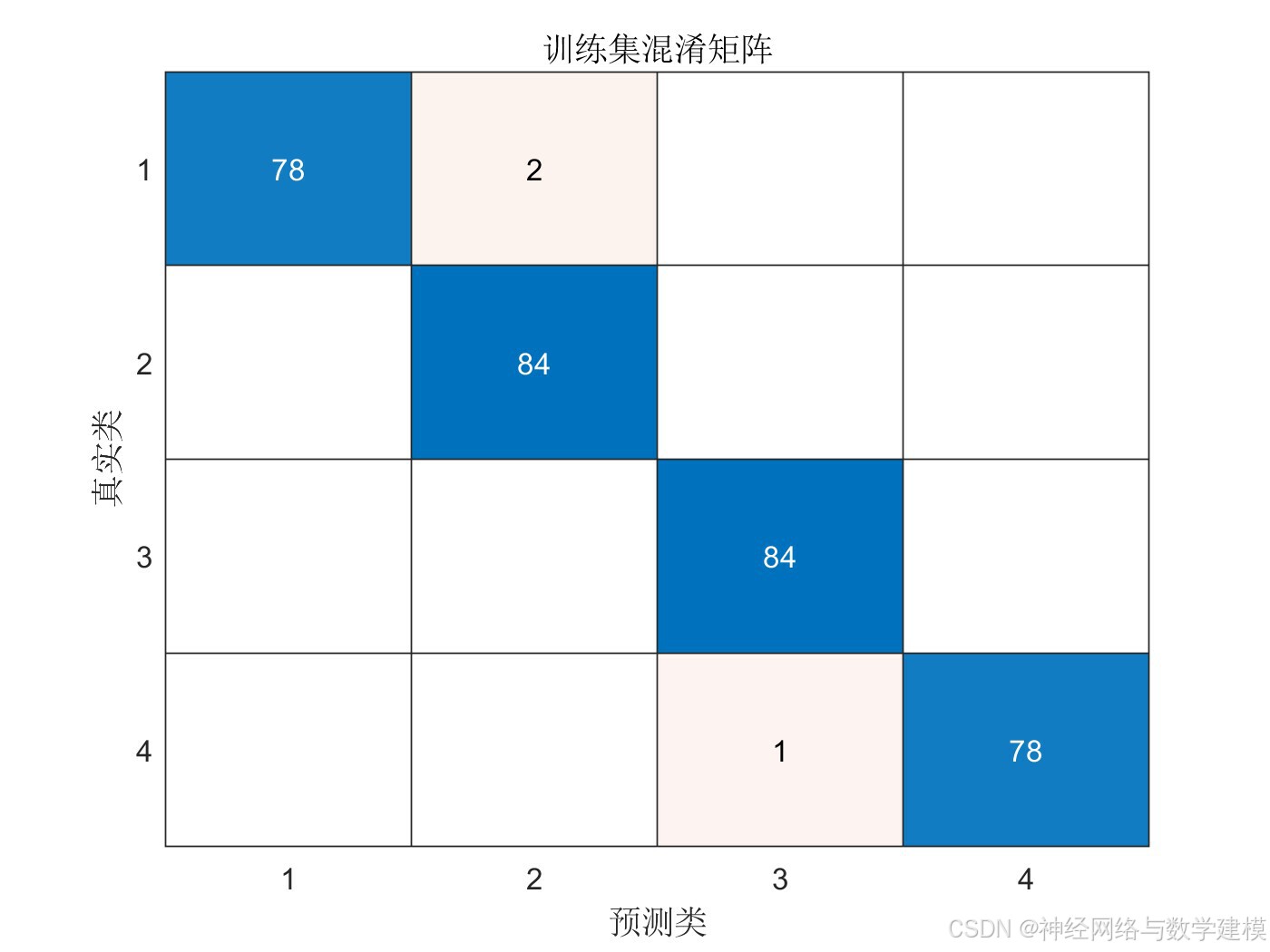

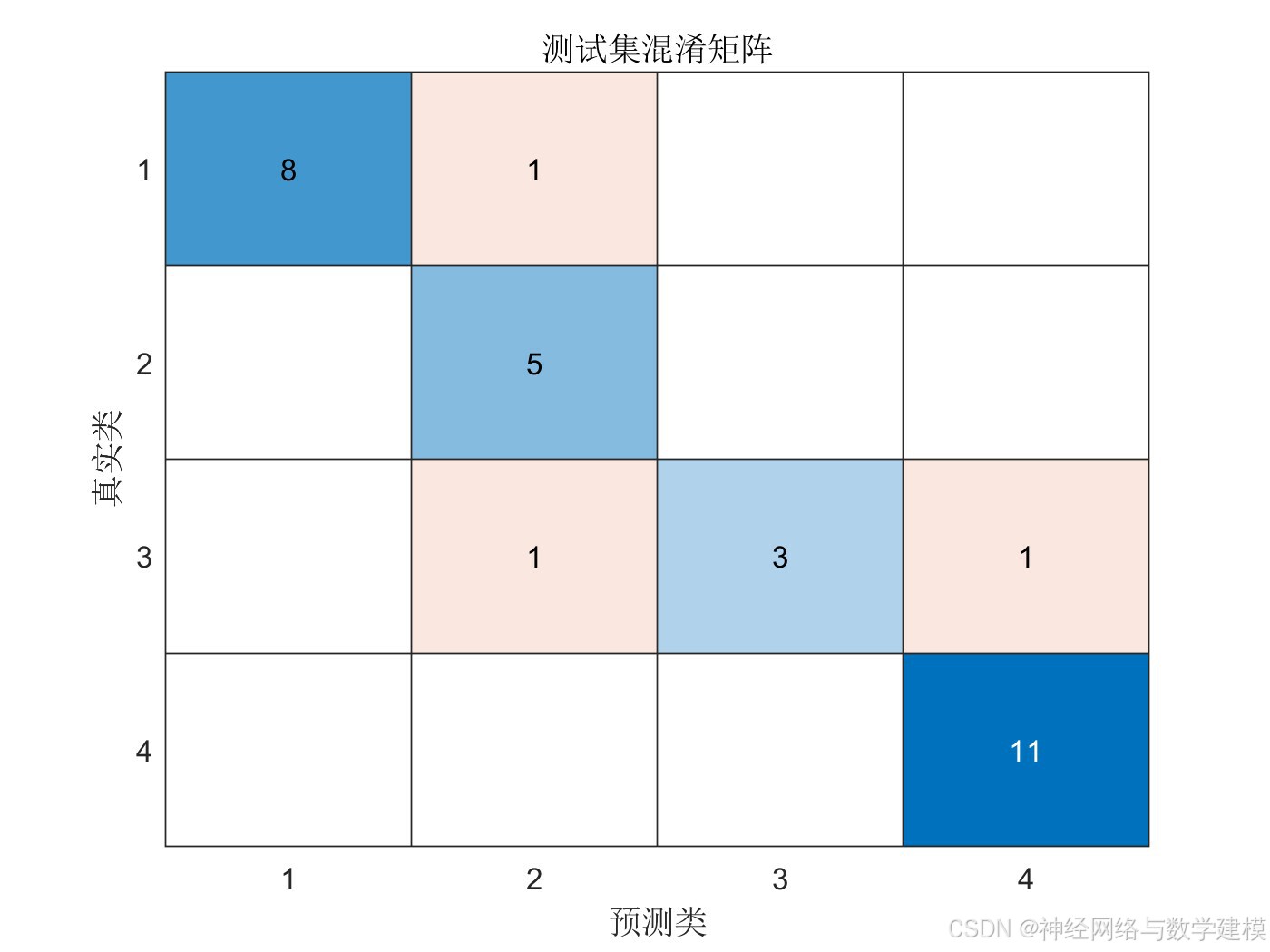

自动输出多种多样的的误差评价指标,自动输出大量实验效果图片

亮点与优势:

-

注释详细,几乎每一关键行都有注释说明,适合小白起步学习

-

直接运行Main函数即可看到所有结果,使用便捷

-

编程习惯良好,程序主体标准化,逻辑清晰,方便阅读代码

-

所有数据均采用Excel格式输入,替换数据方便,适合懒人选手

-

出图详细、丰富、美观,可直观查看运行效果

-

附带详细的说明文档(下图),其内容包括:算法原理+使用方法说明

二、实际运行效果:

三、方法原理介绍:

在传统的PSO中,粒子的速度更新依赖于两个固定的学习因子:个体学习因子(c1)和群体学习因子(c2)。这两个因子决定了粒子在更新速度时对自身历史最优解和全局最优解的依赖程度。虽然这种方法在许多情况下有效,但在某些复杂的优化问题中,固定的学习因子可能导致以下问题:

-

收敛速度慢:在搜索初期,粒子可能过于依赖个体历史最优解,导致探索不足。

-

局部最优:在搜索后期,粒子可能过于依赖全局最优解,导致陷入局部最优解。

AsyLnCPSO通过动态调整学习因子来解决这些问题。具体来说,随着迭代次数的增加,个体学习因子和群体学习因子逐渐减小,使得粒子在搜索后期更加注重全局最优解的探索,而在搜索初期则更关注个体历史最优解的利用。

四、完整程序下载:

144

144

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?