一、什么是大模型?

简单说,大模型是一种超级聪明的 “AI 大脑”。它就像一个学了海量知识的学霸,能理解人类语言,还能根据输入的信息给出靠谱的回应。

比如你问它 “怎么做番茄炒蛋”,它会一步一步教你;让它写一封请假条,分分钟就能搞定。和我们平时用的计算器、美图软件不同,大模型不是只能做单一任务,而是像人类一样 “懂很多事”,这也是它被称为 “通用人工智能雏形” 的原因。

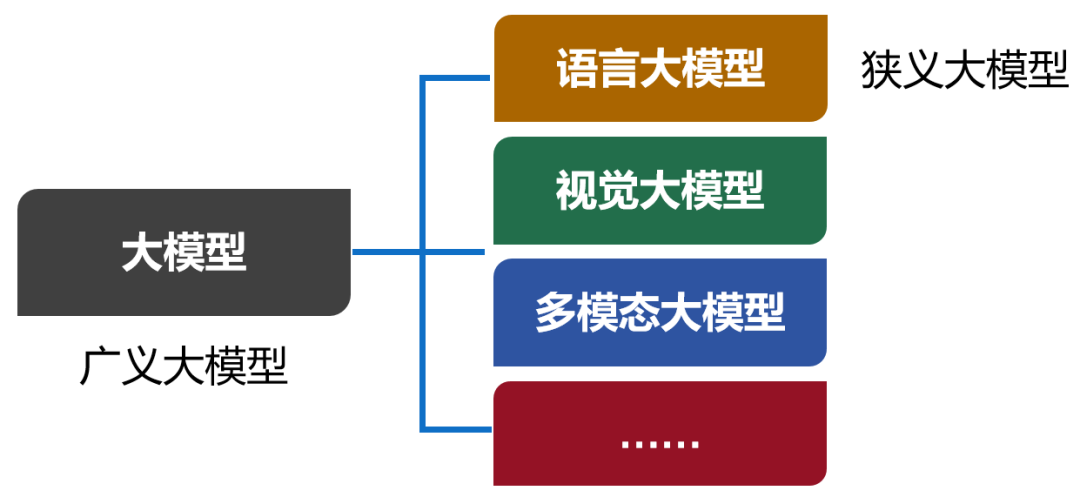

我们现在口头上常说的大模型,实际上特指大模型的其中一类,也是用得最多的一类——语言大模型(Large Language Model,也叫大语言模型,简称LLM)。

除了语言大模型之外,还有视觉大模型、多模态大模型等。现在,包括所有类别在内的大模型合集,被称为广义的大模型。而语言大模型,被称为狭义的大模型。

从本质来说,大模型,是包含超大规模参数(通常在十亿个以上)的神经网络模型。

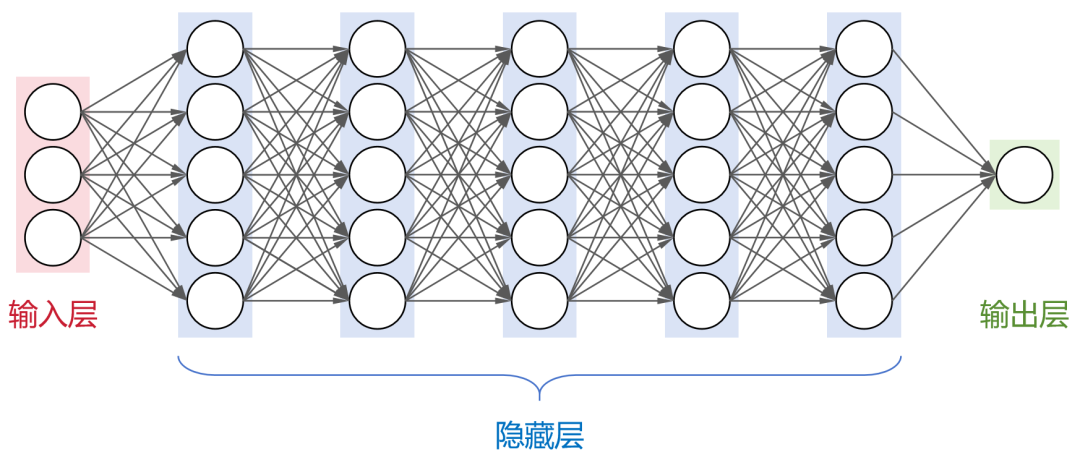

之前给大家科普人工智能的时候,小枣君介绍过,神经网络是人工智能领域目前最基础的计算模型。它通过模拟大脑中神经元的连接方式,能够从输入数据中学习并生成有用的输出。

这是一个全连接神经网络(每层神经元与下一层的所有神经元都有连接),包括1个输入层,N个隐藏层,1个输出层。

大名鼎鼎的卷积神经网络(CNN)、循环神经网络(RNN)、长短时记忆网络(LSTM)以及transformer架构,都属于神经网络模型。

目前,业界大部分的大模型,都采用了transformer架构。

刚才提到,大模型包含了超大规模参数。实际上,大模型的“大”,不仅是参数规模大,还包括:架构规模大、训练数据大、算力需求大。

以OpenAI公司的GPT-3为例。这个大模型的隐藏层一共有96层,每层的神经元数量达到2048个。

整个架构的规模就很大(我可画不出来),神经元节点数量很多。

大模型的参数数量和神经元节点数有一定的关系。简单来说,神经元节点数越多,参数也就越多。例如,GPT-3的参数数量,大约是1750亿。

大模型的训练数据,也是非常庞大的。

同样以GPT-3为例,采用了45TB的文本数据进行训练。即便是清洗之后,也有570GB。具体来说,包括CC数据集(4千亿词)+WebText2(190亿词)+BookCorpus(670亿词)+维基百科(30亿词),绝对堪称海量。

最后是算力需求。

这个大家应该都听说过,训练大模型,需要大量的GPU算卡资源。而且,每次训练,都需要很长的时间。

GPU算卡

根据公开的数据显示,训练GPT-3大约需要3640PFLOP·天(PetaFLOP·Days)。如果采用512张英伟达的A100 GPU(单卡算力195 TFLOPS),大约需要1个月的时间。训练过程中,有时候还会出现中断,实际时间会更长。

总而言之,大模型就是一个虚拟的庞然大物,架构复杂、参数庞大、依赖海量数据,且非常烧钱。

相比之下,参数较少(百万级以下)、层数较浅的模型,是小模型。小模型具有轻量级、高效率、易于部署等优点,适用于数据量较小、计算资源有限的垂直领域场景。

二、 大模型是如何训练出来的?

接下来,我们了解一下大模型的训练过程。

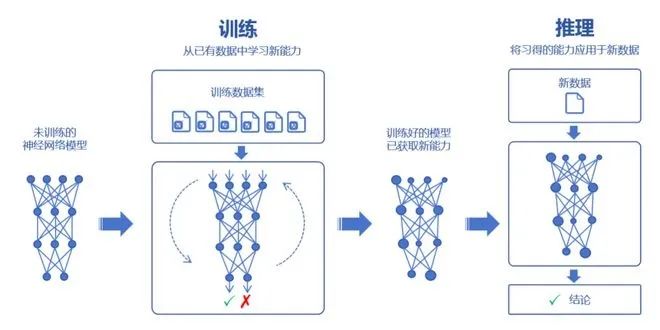

大家都知道,大模型可以通过对海量数据的学习,吸收数据里面的“知识”。然后,再对知识进行运用,例如回答问题、创造内容等。

学习的过程,我们称之为训练。运用的过程,则称之为推理。

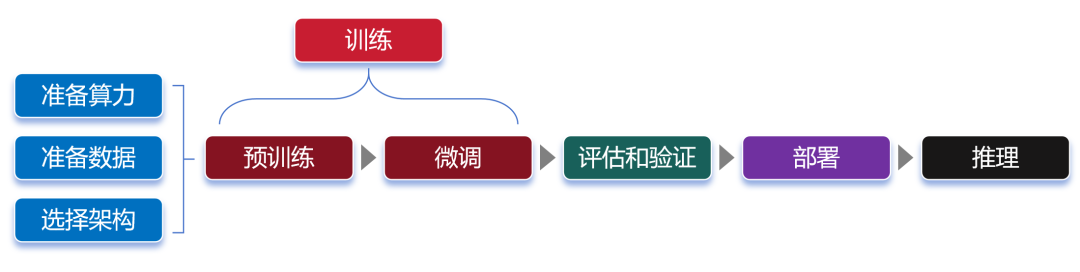

训练,又分为预训练(Pre-trained)和微调(Fine tuning)两个环节。

- 预训练

在预训练时,我们首先要选择一个大模型框架,例如transformer。然后,通过“投喂”前面说的海量数据,让大模型学习到通用的特征表示。

那么,为什么大模型能够具有这么强大的学习能力?为什么说它的参数越多,学习能力就越强?

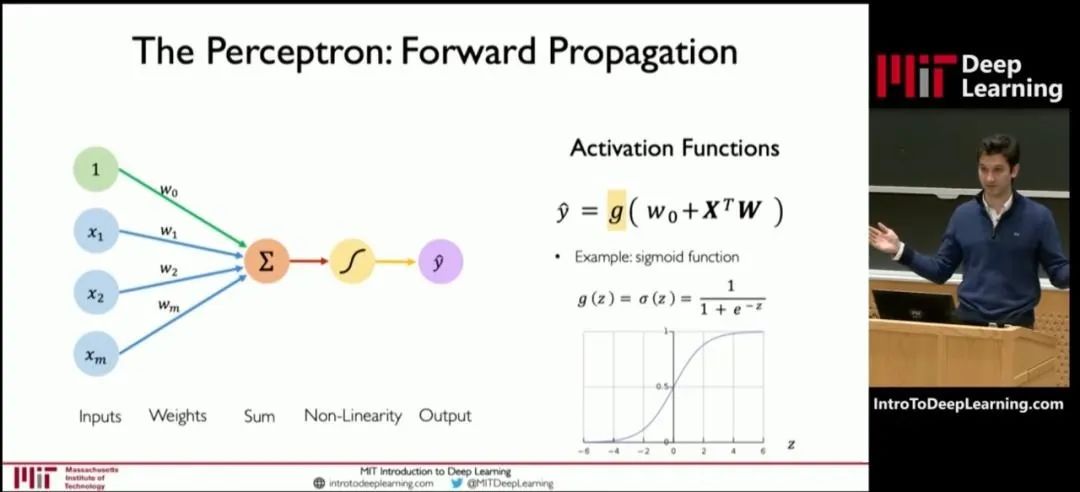

我们可以参考MIT(麻省理工)公开课的一张图:

这张图是深度学习模型中一个神经元的结构图。

神经元的处理过程,其实就是一个函数计算过程。算式中,x是输入,y是输出。预训练,就是通过x和y,求解W。W是算式中的“权重(weights)”。

权重决定了输入特征对模型输出的影响程度。通过反复训练来获得权重,这就是训练的意义。

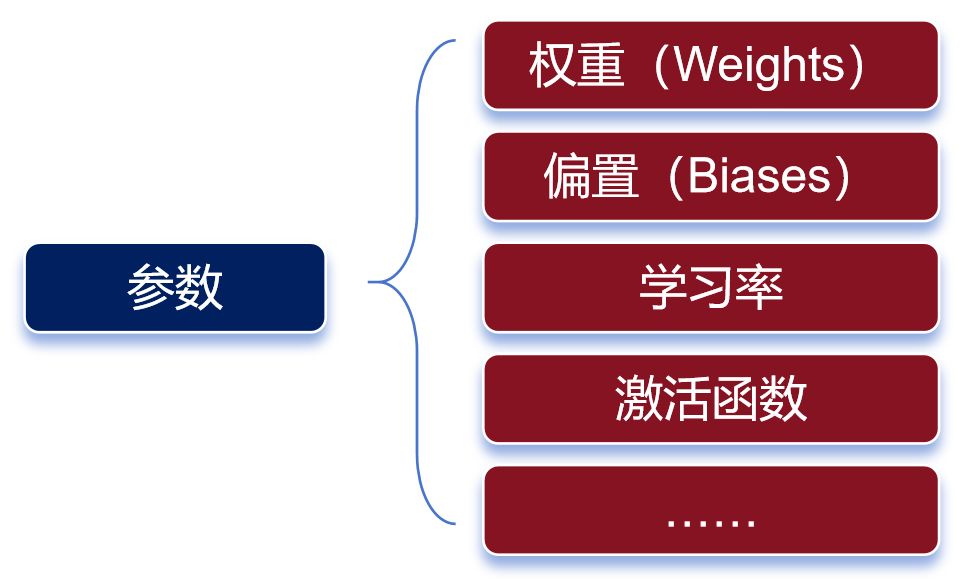

权重是最主要的参数类别之一。除了权重之外,还有另一个重要的参数类别——偏置(biases)。

参数有很多种类

权重决定了输入信号对神经元的影响程度,而偏置则可以理解为神经元的“容忍度”,即神经元对输入信号的敏感程度。

简单来说,预训练的过程,就是通过对数据的输入和输出,去反复“推算”最合理的权重和偏置(也就是参数)。训练完成后,这些参数会被保存,以便模型的后续使用或部署。

参数越多,模型通常能够学习到更复杂的模式和特征,从而在各种任务上表现出更强的性能。

我们通常会说大模型具有两个特征能力——涌现能力和泛化能力。

当模型的训练数据和参数不断扩大,直到达到一定的临界规模后,会表现出一些未能预测的、更复杂的能力和特性。模型能够从原始训练数据中,自动学习并发现新的、更高层次的特征和模式。这种能力,被称为“涌现能力”。

“涌现能力”,可以理解为大模型的脑子突然“开窍”了,不再仅仅是复述知识,而是能够理解知识,并且能够发散思维。

泛化能力,是指大模型通过“投喂”海量数据,可以学习复杂的模式和特征,可以对未见过的数据做出准确的预测。

简单来说,就像董宇辉一样,书读得多了,有些书虽然没读过,他也能瞎掰几句。

*参数规模越来越大,虽然能让大模型变得更强,但是也会带来更庞大的资源消耗,甚至可能增加“过拟合**”*的风险。

过拟合,是指模型对训练数据学习得过于精确,以至于它开始捕捉并反映训练数据中的噪声和细节,而不是数据的总体趋势或规律。说白了,就是大模型变成了“书呆子”,只会死记硬背,不愿意融会贯通。

预训练所使用的数据,我们也需要再说明一下。

预训练使用的数据,是海量的未标注数据(几十TB)。

之所以使用未标注数据,是因为互联网上存在大量的此类数据,很容易获取。而标注数据(基本上靠人肉标注)需要消耗大量的时间和金钱,成本太高。

预训练模型,可以通过无监督学习方法(如自编码器、生成对抗网络、掩码语言建模、对比学习等,大家可以另行了解),从未标注数据中,学习到数据的通用特征和表示。

这些数据,也不是随便网上下载得来的。整个数据需要经过收集、清洗、脱敏和分类等过程。这样可以去除异常数据和错误数据,还能删除隐私数据,让数据更加标准化,有利于后面的训练过程。

获取数据的方式,也是多样化的。

如果是个人和学术研究,可以通过一些官方论坛、开源数据库或者研究机构获取。如果是企业,既可以自行收集和处理,也可以直接通过外部渠道(市场上有专门的数据提供商)购买。

- 微调

预训练学习之后,我们就得到了一个通用大模型。这种模型一般不能直接拿来用,因为它在完成特定任务时往往表现不佳。

这时,我们需要对模型进行微调。

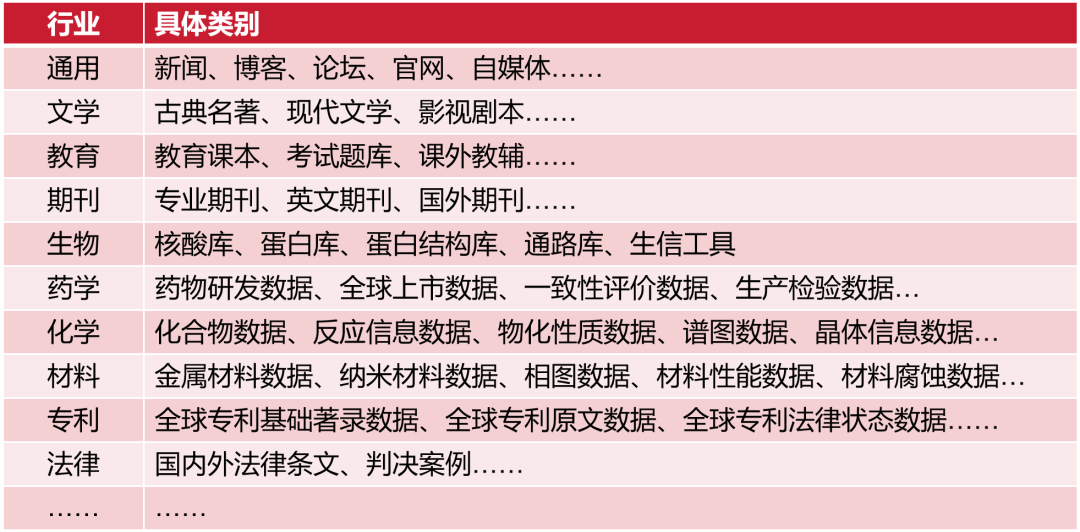

微调,是给大模型提供特定领域的标注数据集,对预训练的模型参数进行微小的调整,让模型更好的完成特定任务。

行业数据类别

微调之后的大模型,可以称之为行业大模型。例如,通过基于金融证券数据集的微调,可以得到一个金融证券大模型。

如果再基于更细分的专业领域进行微调,就是专业大模型(也叫垂直大模型)。

我们可以把通用大模型理解为中小学生,行业大模型是大学本科生,专业大模型是研究生。

微调阶段,由于数据量远小于预训练阶段,所以对算力需求小很多。

大家注意,对于大部分大模型厂商来说,他们一般只做预训练,不做微调。而对于行业客户来说,他们一般只做微调,不做预训练。

“预训练+微调”这种分阶段的大模型训练方式,可以避免重复的投入,节省大量的计算资源,显著提升大模型的训练效率和效果。

预训练和微调都完成之后,需要对这个大模型进行评估。通过采用实际数据或模拟场景对大模型进行评估验证,确认大模型的性能、稳定性和准确性等是否符合设计要求。

等评估和验证也完成,大模型基本上算是打造成功了。接下来,我们可以部署这个大模型,将它用于推理任务。

换句话说,这时候的大模型已经“定型”,参数不再变化,可以真正开始干活了。

大模型的推理过程,就是我们使用它的过程。通过提问、提供提示词(Prompt),可以让大模型回答我们的问题,或者按要求进行内容生成。

最后,画一张完整的流程图:

三、大模型究竟有什么作用?

大模型的用处早就渗透到我们生活的方方面面,总结起来有三大类:

- 解放重复劳动:写报告、做表格、整理数据这些耗时的工作,大模型能快速搞定。比如职场人用它生成会议纪要,学生用它整理课堂笔记,效率能提升好几倍。

- 辅助专业领域:在医疗领域,它能帮忙分析 CT 影像,给医生提供参考;在编程领域,它能自动补全代码,帮程序员少加班。

- 提升生活便捷度:手机里的智能助手、语音翻译软件、甚至短视频的自动字幕,背后都可能有大模型的影子。

四、大模型的发展趋势?

未来的大模型,会朝着两个方向进化:

- 更 “懂” 人类:现在的大模型偶尔会说些 “蠢话”,比如答非所问。以后它会更理解人类的语气、情绪,甚至能听懂玩笑和潜台词。

- 更 “专” 领域:除了通用大模型,还会出现针对教育、法律、农业等细分领域的 “专家型” 大模型。比如农民可以直接问它 “小麦叶子发黄怎么办”,它能给出精准的解决方案。

另外,大模型的使用门槛会越来越低,可能就像现在用微信一样,普通人不用学复杂知识也能轻松上手。

五、大模型会带来哪些挑战?

虽然大模型很厉害,但也藏着不少问题:

- 信息真假难辨:大模型可能会 “一本正经地胡说八道”,比如编造不存在的历史事件或科学结论,普通人很难分辨。

- 隐私安全风险:如果我们在使用时输入了身份证号、病历等私密信息,可能会被泄露或滥用。

- 冲击部分职业:像基础文案、数据录入、简单翻译等工作,可能会被大模型取代,需要人们学习新技能来适应变化。

六、总结

大模型不是遥不可及的科技神话,而是正在悄悄改变我们生活的工具。对新手来说,不用害怕它的复杂,先从日常使用开始 —— 比如用它写一段朋友圈文案,或者查一个生活小问题,慢慢就能感受到它的价值。当然,在享受便利的同时,也要记得擦亮眼睛,避开它可能带来的 “坑”。跟着科技的脚步慢慢学,你会发现,大模型其实没那么难理解。

那么,如何系统的去学习大模型LLM?

作为一名从业五年的资深大模型算法工程师,我经常会收到一些评论和私信,我是小白,学习大模型该从哪里入手呢?我自学没有方向怎么办?这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!这些问题啊,也不是三言两语啊就能讲明白的。

所以我综合了大模型的所有知识点,给大家带来一套全网最全最细的大模型零基础教程。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实战项目相结合的教学方式,历时3个月,终于完成了这样的课程,让你真正体会到什么是每一秒都在疯狂输出知识点。

由于篇幅有限,⚡️ 朋友们如果有需要全套 《2025全新制作的大模型全套资料》,扫码获取~

👉大模型学习指南+路线汇总👈

我们这套大模型资料呢,会从基础篇、进阶篇和项目实战篇等三大方面来讲解。

👉①.基础篇👈

基础篇里面包括了Python快速入门、AI开发环境搭建及提示词工程,带你学习大模型核心原理、prompt使用技巧、Transformer架构和预训练、SFT、RLHF等一些基础概念,用最易懂的方式带你入门大模型。

👉②.进阶篇👈

接下来是进阶篇,你将掌握RAG、Agent、Langchain、大模型微调和私有化部署,学习如何构建外挂知识库并和自己的企业相结合,学习如何使用langchain框架提高开发效率和代码质量、学习如何选择合适的基座模型并进行数据集的收集预处理以及具体的模型微调等等。

👉③.实战篇👈

实战篇会手把手带着大家练习企业级的落地项目(已脱敏),比如RAG医疗问答系统、Agent智能电商客服系统、数字人项目实战、教育行业智能助教等等,从而帮助大家更好的应对大模型时代的挑战。

👉④.福利篇👈

最后呢,会给大家一个小福利,课程视频中的所有素材,有搭建AI开发环境资料包,还有学习计划表,几十上百G素材、电子书和课件等等,只要你能想到的素材,我这里几乎都有。我已经全部上传到优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

相信我,这套大模型系统教程将会是全网最齐全 最易懂的小白专用课!!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?