目录

一、简单线性回归

1、表达式

2、估计系数

(1)方法:最小二乘法

(2)实质:

(3)结果

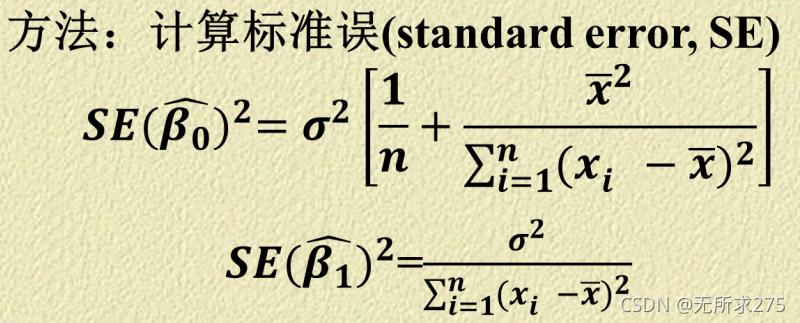

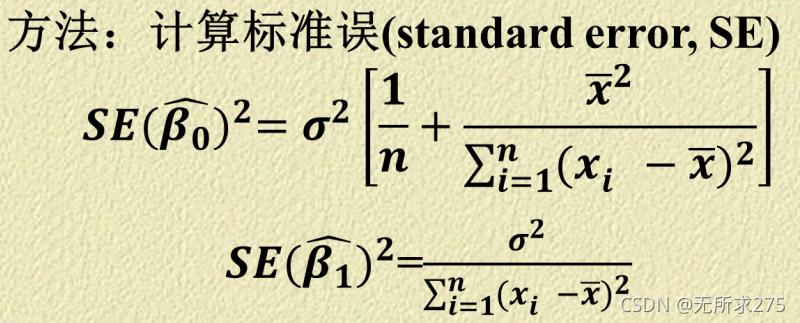

(4)评估系数估计的准确性

3、评估模型的准确性

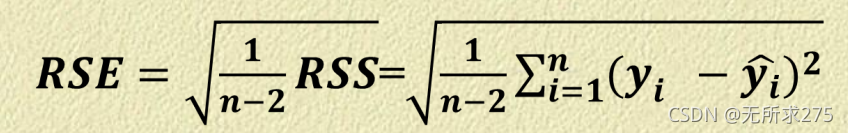

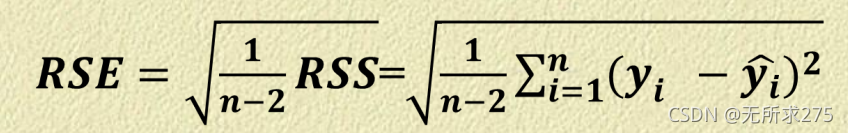

方法一:RSE(对模型失拟的度量,越小越好)

方法二:

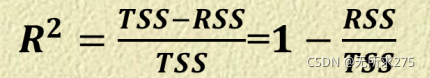

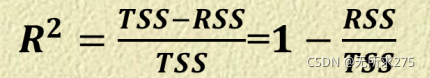

方法二:统计量(越接近1越好)

二、多元线性回归

1、表达式

2、估计系数

(1)方法:最小二乘法

(2) 实质:残差平方和最小

3、响应变量与预测变量的关系

在简单的线性回归中ÿ

目录

方法一:RSE(对模型失拟的度量,越小越好)

方法二:

方法二:统计量(越接近1越好)

(1)方法:最小二乘法

(2) 实质:残差平方和最小

在简单的线性回归中ÿ

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?