论文链接:https://openaccess.thecvf.com/content_cvpr_2016/papers/He_Deep_Residual_Learning_CVPR_2016_paper.pdf

参考学习视频:【精读AI论文】ResNet深度残差网络_哔哩哔哩_bilibili

目录

2.2.2 当x和F(x)数据结构不相同难以相加时的处理方法

3.2 ResNet网络层数变高会产生过拟合,模型效果会变差

1. 介绍

1.1 痛点——退化问题

1.1.1 问题描述

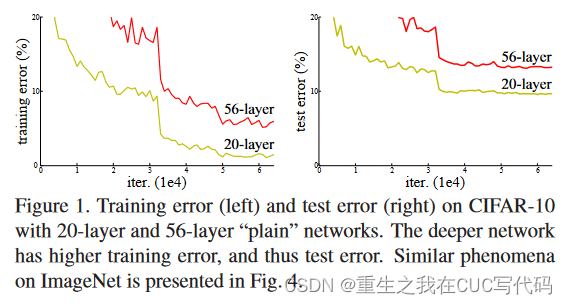

退化问题指的是当网络变深后性能还不如浅层的网络。如Figure 1. 所示,56层的训练和测试误差比20层还大。

1.1.2 解决方法

ResNet引入残差模块解决了网络退化的问题

1.2 残差

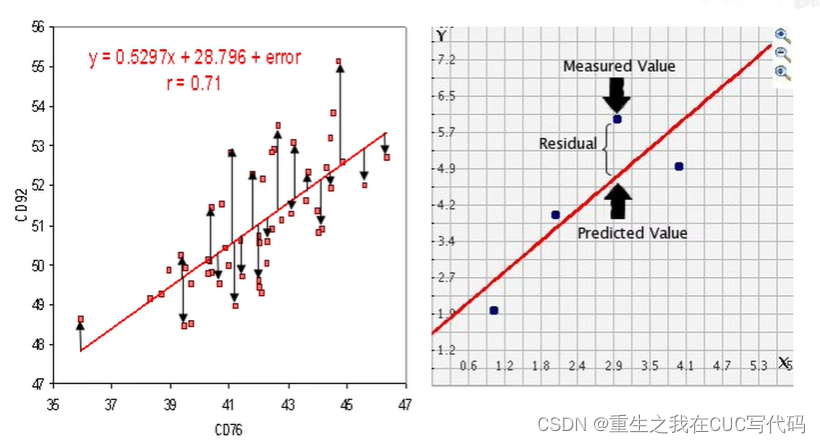

残差,即预测值和真实值之间的偏差。

如下图所示,红点为真实值,红线为预测值(相当于恒等映射),真实值与预测值之间的偏差就是残差。预测值x+偏差F(x)=真实值H(x)

2. 方法

2.1 残差结构

残差结构,如Figure 2. 所示

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

107

107

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?