这里写目录标题

LangChain4j入门

LangChain4j 是一个用于构建基于大型语言模型(LLM)应用的 Java 框架,它简化了与 OpenAI、Hugging Face 等 LLM 服务的集成,并提供了工具链来构建复杂的 LLM 应用。

配置

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-open-ai-spring-boot-starter</artifactId>

<version>1.0.0-beta3</version>

</dependency>

在yml配置api_key,base_ur,model_name必需项

一般将APIKEY保存在系统环境变量中,用System.getenv()获取

测试

@Autowired

private OpenAiChatModel openAiChatModel;

@Test

public void testChat() {

String question = "java的特性";

String ans = openAiChatModel.chat(question);

System.out.println(ans);

}

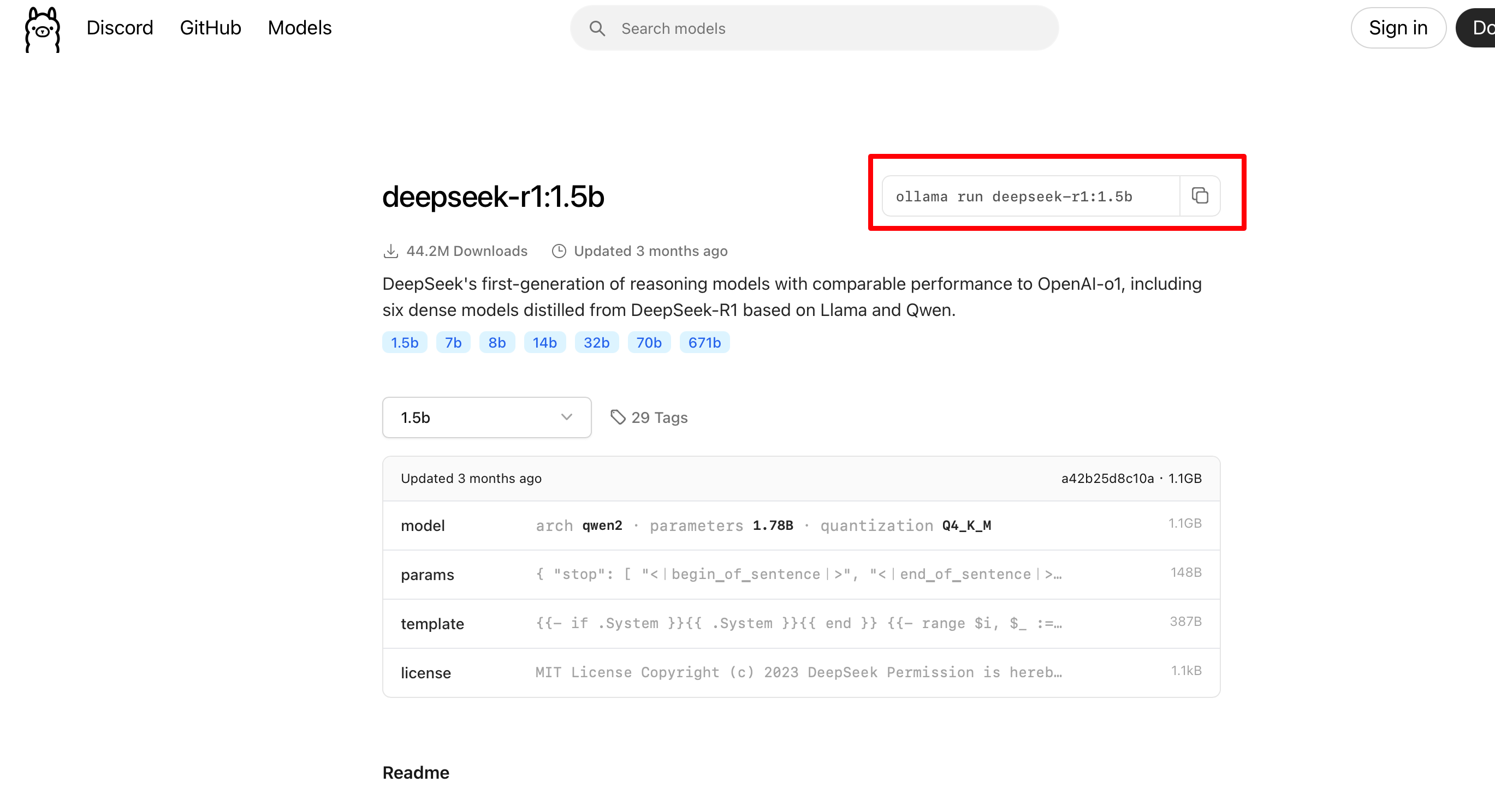

Ollama

Ollama是一个允许开发者在本地计算环境中运行模型的工具。

- 选择模型:

- 输入命令行 ollama run deepseek-r1:1.5b

- 本地项目配置

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-ollama</artifactId>

<version>1.0.0-beta3</version>

</dependency>

阿里云百炼平台

在线集成了阿里的通义系列大模型和第三方大模型,涵盖文本、

图像、音视频等不同模态。

依赖

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-community-dashscope-spring-boot-starter</artifactId>

</dependency>

在官网申请API-Key

langchain4j:

community:

dashscope:

chat-model:

api-key: sk-66xxxxxxx

model-name: qwen-max

AIService

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-spring-boot-starter</artifactId>

</dependency>

AIService用于格式化输入,解析输出,记忆聊天等功能。

- 创建接口

package com.atguigu.java.ai.langchain4j.assistant;

public interface Assistant {

String chat(String userMessage);

}

- 创建类测试

@Autowired

private QwenChatModel qwenChatModel;

@Test

public void testChat() {

//创建AIService

Assistant assistant = AiServices.create(Assistant.class, qwenChatModel);

//调用service的接口

String answer = assistant.chat("Hello");

System.out.println(answer

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?