信息增益

信息增益比(C4.5算法)——分类树,分类的标签是离散的,如 好/不好

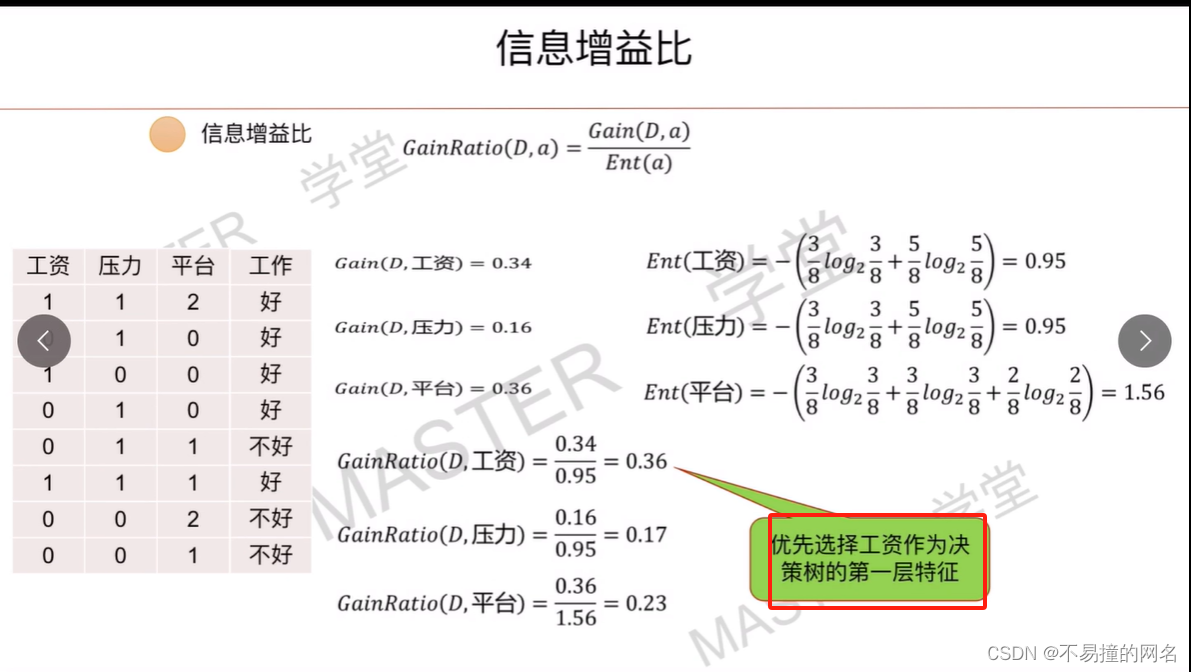

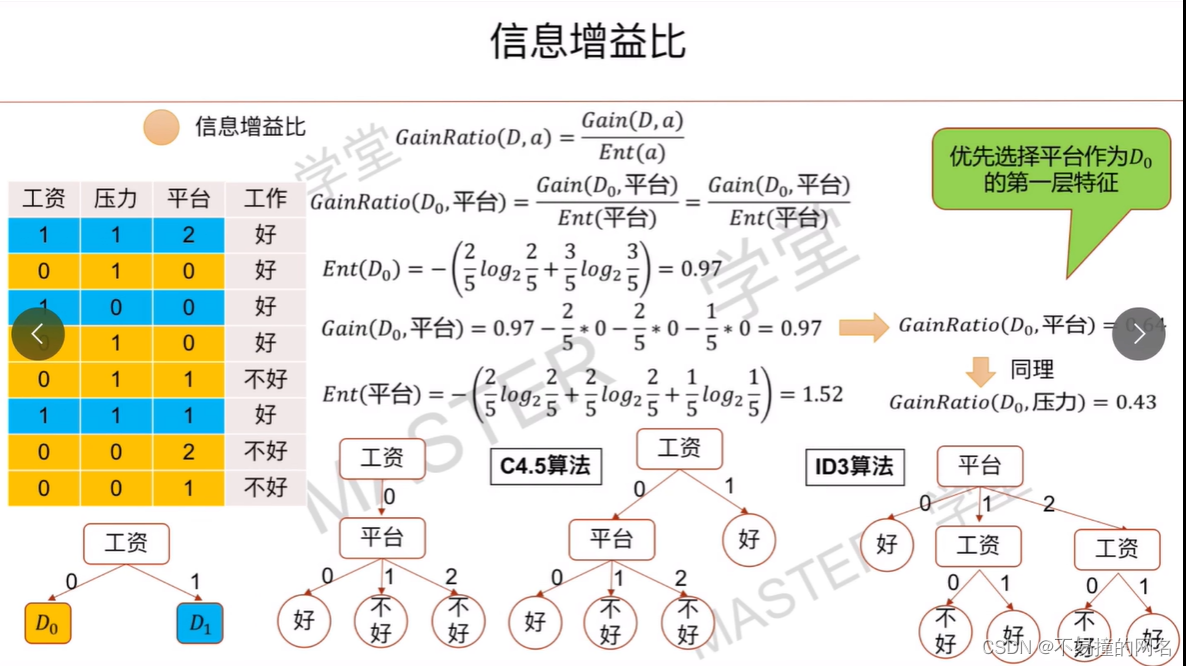

信息增益比(Information Gain Ratio)是机器学习中特别是在决策树算法中用于特征选择的一个指标,它是对信息增益的一种修正方法,旨在解决信息增益在处理具有大量值的属性时可能出现的偏斜问题。

信息增益本身衡量的是在给定特征条件下,数据集不确定性减少的程度,但是它倾向于选择取值多的属性,因为这类属性有更多的机会使得数据集被分割得更细,即使这种分割对于分类并不十分有用。

信息增益比通过引入一个惩罚项来调整信息增益,这个惩罚项通常是属性的固有值(Intrinsic Value),也称为固有熵或属性熵,记作 ( IV(a) )。

属性 ( a ) 的固有值 ( IV(a) ) 反映了该属性本身的复杂度或不确定性,计算方式通常为基于属性 ( a ) 的取值个数 ( V ) 的熵。属性的取值越多,其固有熵通常越高。

信息增益比的计算公式可以表示为:

信息增益比

=

信息增益

固有值

(

I

V

)

=

熵

(

D

)

−

熵

(

D

∣

A

)

I

V

(

A

)

\text{信息增益比} = \frac{\text{信息增益}}{\text{固有值}(IV)} = \frac{\text{熵}(D) - \text{熵}(D|A)}{IV(A)}

信息增益比=固有值(IV)信息增益=IV(A)熵(D)−熵(D∣A)

其中,

- 熵 ( D ) \text{熵}(D) 熵(D) 表示数据集 ( D ) 的熵,即数据集的整体不确定性。

-

熵

(

D

∣

A

)

\text{熵}(D|A)

熵(D∣A) 表示在给定属性 ( A ) 的

条件下,数据集的条件熵,即根据属性 ( A ) 分割后数据集的不确定性。 - I V ( A ) IV(A) IV(A) 表示属性 ( A ) 的固有值,用来惩罚属性取值较多的情况。

通过使用信息增益比,我们可以更公平地比较不同属性对于数据集划分的优劣,因为它考虑了属性本身的复杂度,避免了仅仅因为一个属性有更多可能的取值就给予其更高的评价。在实际应用中,信息增益比较高的属性更适合作为决策树的分裂标准。

2421

2421

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?