Kafka架构与实战

文章目录

1.2 Kafka安装与配置

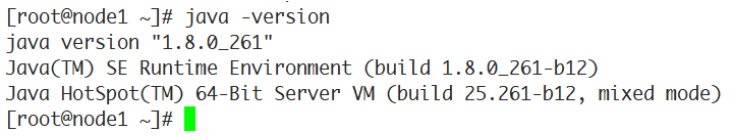

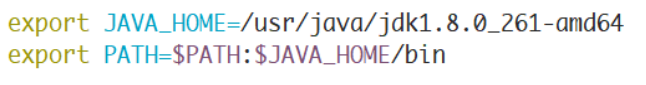

1.2.1 Java环境为前提

1、上传jdk-8u261-linux-x64.rpm到服务器并安装:

rpm -ivh jdk-8u261-linux-x64.rpm

2、配置环境变量:

rpm -ivh jdk-8u261-linux-x64.rpm 1 vim /etc/profile

#生效 source /etc/profile

#验证 java -version

1.2.2 Zookeeper的安装配置

1、上传zookeeper-3.4.14.tar.gz到服务器

2、解压到/opt:

tar -zxf zookeeper-3.4.14.tar.gz -C /opt cd /opt/zookeeper-3.4.14/conf

#复制zoo_sample.cfg命名为zoo.cfg

cp zoo_sample.cfg zoo.cfg

#编辑zoo.cfg文件

vim zoo.cfg

3、修改Zookeeper保存数据的目录,dataDir:

dataDir=/var/lagou/zookeeper/data

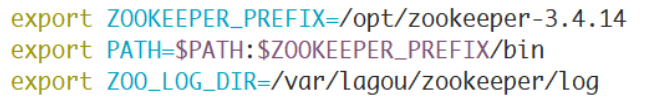

4、编辑/etc/profile:

- 设置环境变量ZOO_LOG_DIR,指定Zookeeper保存日志的位置;

- ZOOKEEPER_PREFIX指向Zookeeper的解压目录;

- 将Zookeeper的bin目录添加到PATH中:

5、使配置生效:

source /etc/profile

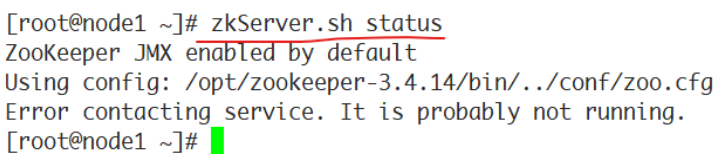

6、验证:

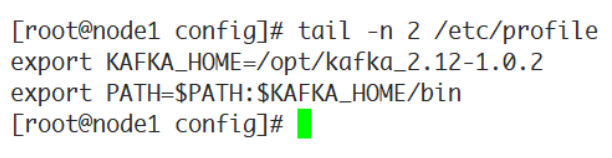

1.2.3 Kafka的安装与配置

1、上传kafka_2.12-1.0.2.tgz到服务器并解压:

tar -zxf kafka_2.12-1.0.2.tgz -C /opt

2、配置环境变量并生效:

vim /etc/profile

3、配置/opt/kafka_2.12-1.0.2/config中的server.properties文件:

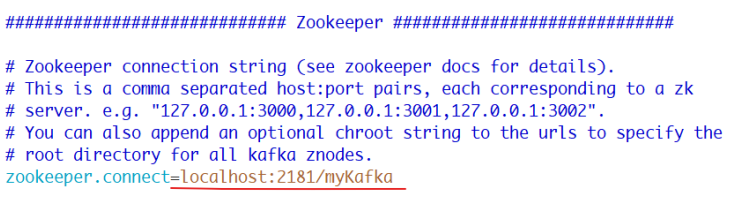

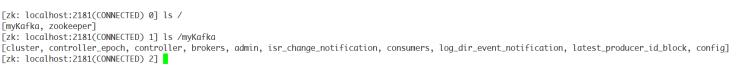

Kafka连接Zookeeper的地址,此处使用本地启动的Zookeeper实例,连接地址是localhost:2181,后面的 myKafka 是Kafka在Zookeeper中的根节点路径:

4、启动Zookeeper:

zkServer.sh start

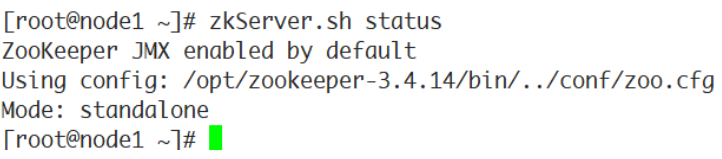

5、确认Zookeeper的状态:

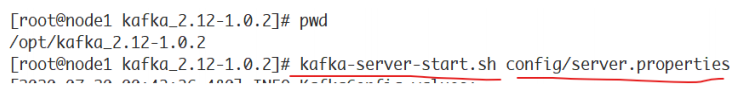

6、启动Kafka:

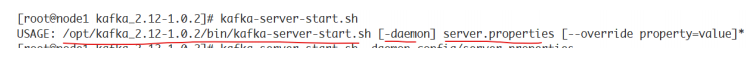

进入Kafka安装的根目录,执行如下命令:

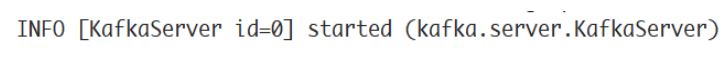

启动成功,可以看到控制台输出的最后一行的started状态:

7、查看Zookeeper的节点:

8、此时Kafka是前台模式启动,要停止,使用Ctrl+C。

如果要后台启动,使用命令:

kafka-server-start.sh -daemon config/server.properties

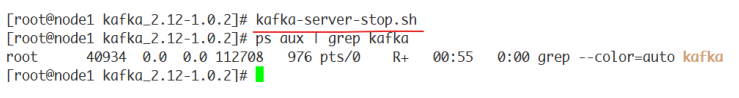

查看Kafka的后台进程:

ps aux | grep kafka

停止后台运行的Kafka:

1.2.4 生产与消费

1、kafka-topics.sh 用于管理主题。

# 列出现有的主题

[root@node1 ~]# kafka-topics.sh --list --zookeeper localhost:2181/myKafka

# 创建主题,该主题包含一个分区,该分区为Leader分区,它没有Follower分区副本。

[root@node1 ~]# kafka-topics.sh --zookeeper localhost:2181/myKafka --create --topic topic_1 --partitions 1 --replication-factor 1

# 查看分区信息

[root@node1 ~]# kafka-topics.sh --zookeeper localhost:2181/myKafka --list

# 查看指定主题的详细信息

[root@node1 ~]# kafka-topics.sh --zookeeper localhost:2181/myKafka -- describe --topic topic_1

# 删除指定主题

[root@node1 ~]# kafka-topics.sh --zookeeper localhost:2181/myKafka --delete --topic topic_1

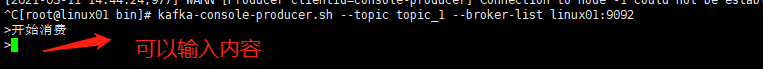

2、kafka-console-producer.sh用于生产消息:

# 开启生产者

[root@node1 ~]# kafka-console-producer.sh --topic topic_1 --broker-list localhost:9092

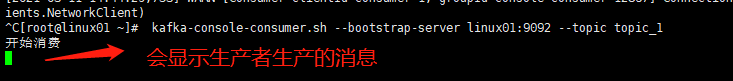

3、kafka-console-consumer.sh用于消费消息:

# 开启消费者

[root@node1 ~]# kafka-console-consumer.sh --bootstrap-server localhost:9092 - -topic topic_1

# 开启消费者方式二,从头消费,不按照偏移量消费

[root@node1 ~]# kafka-console-consumer.sh --bootstrap-server localhost:9092 - -topic topic_1 --from-beginning

1.3 Kafka开发实战

1.3.1 消息的发送与接收

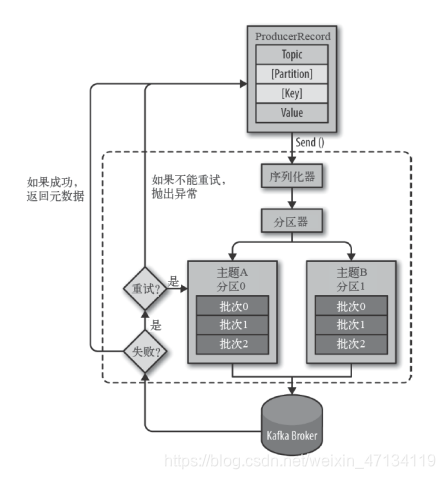

生产者主要的对象有: KafkaProducer , ProducerRecord 。

其中 KafkaProducer 是用于发送消息的类, ProducerRecord 类用于封装Kafka的消息。

KafkaProducer 的创建需要指定的参数和含义:

其他参数可以从 org.apache.kafka.clients.producer.ProducerConfig 中找到。我们后面的内容会介绍到。

消费者生产消息后,需要broker端的确认,可以同步确认,也可以异步确认。

同步确认效率低,异步确认效率高,但是需要设置回调对象。

客户端连接

pom.xml中添加

<dependencies>

<dependency>

<groupId>org.apache.kafka</groupId>

<artifactId>kafka-clients</artifactId>

<version>1.0.2</version>

</dependency>

</dependencies>

生产者:

package com.lagou.kafka;

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.ProducerRecord;

import java.util.HashMap;

import java.util.Map;

import java.util.concurrent.ExecutionException;

import java.util.concurrent.TimeUnit;

import java.util.concurrent.TimeoutException;

public class MyProducer1 {

public static void main(String[] args) throws InterruptedException, ExecutionException, TimeoutException {

Map<String, Object> configs = new HashMap<>();

// 设置连接Kafka的初始连接用到的服务器地址

// 如果是集群,则可以通过此初始连接发现集群中的其他broker

configs.put("bootstrap.servers", "linux01:9092");

// 设置key的序列化器

configs.put("key.serializer", "org.apache.kafka.common.serialization.IntegerSerializer");

// 设置value的序列化器

configs.put("value.serializer", "org.apache.kafka.common.serialization.StringSerializer");

configs.put("acks", "1");

KafkaProducer<Integer, String> producer = new KafkaProducer<Integer, String>(configs);

// 用于封装Producer的消息

ProducerRecord<Integer, String> record = new ProducerRecord<Integer, String>(

"topic_1", // 主题名称

0, // 分区编号,现在只有一个分区,所以是0

0, // 数字作为key

"message 0" // 字符串作为value

);

// 发送消息,同步等待消息的确认

producer.send(record).get(3_000, TimeUnit.MILLISECONDS);

// 关闭生产者

producer.close();

}

}

生产者2:

package com.lagou.kafka;

import org.apache.kafka.clients.producer.Callback;

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.ProducerRecord;

import org.apache.kafka.clients.producer.RecordMetadata;

import java.util.HashMap;

import java.util.Map;

public class MyProducer2 {

public static void main(String[] args) {

Map<String, Object> configs = new HashMap<>();

configs.put("bootstrap.servers", "linux121:9092");

configs.put("key.serializer", "org.apache.kafka.common.serialization.IntegerSerializer");

configs.put("value.serializer", "org.apache.kafka.common.serialization.StringSerializer");

KafkaProducer<Integer, String> producer = new KafkaProducer<Integer, String>(configs);

ProducerRecord<Integer, String> record = new ProducerRecord<Integer, String>("topic_1", 0, 1, "lagou message 2");

// 使用回调异步等待消息的确认

producer.send(record, new Callback() {

@Override

public void onCompletion(RecordMetadata metadata, Exception exception) {

if (exception == null) {

System.out.println("主题:" + metadata.topic() + "\n" + "分区:" + metadata.partition() + "\n" +

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

973

973

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?