前言

随着信息时代数据量的快速增加,一门通过对大量数据进行分析,以发现和提取隐含在其中的具有价值的信息和知识的学科——数据挖掘发展起来。

提示:以下是本篇文章正文内容,主要介绍特征工程中常用技术所涉及到的方法,特征选择、降维和不平衡数据处理

一、特征选择

概念:特征选择是从原始特征中挑选出一组最有代表性、分类性能好的特征子集。

作用:特征选择可以降低维数灾难出现的可能;去除不相关特征,降低学习难度。

原则:

1、特征是否发散:如果不发散,说明特征对样本的区分作用不高

2、特征之间的相关性:去除相关性高的特征

3、特征与目标的相关性:优先选择相关性高的特征

常用方法:

1、特征减少(机器学习的剪枝?)

- 单变量特征选择方法:filter(过滤法)

-

方差选择法

-

相关系数法

-

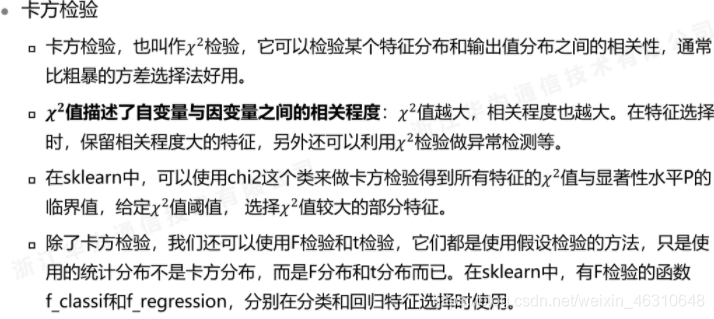

卡方检验(这个不太理解,显著性水平p?)

- 基于模型的特征选择方法:

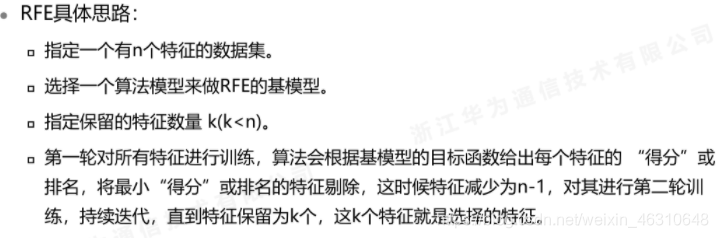

- Wrapper(包装法):确定算法模型后,把模型本身的性能作为评价准则。需要结合后续的机器学习算法,选择出使性能最优的特征子集。根据目标函数,每次选择或排除部分特征。常用递归特征消除法(Recursive Feature Elimination, REF)

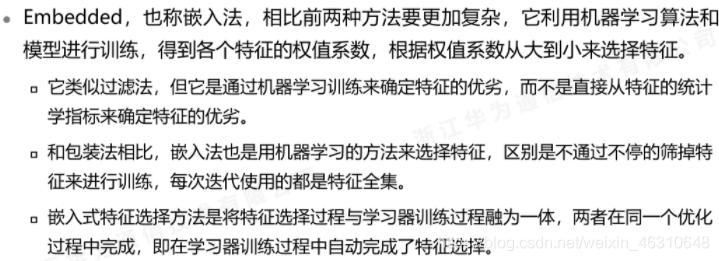

- Embedded(嵌入法)

在sklearn中,用SelectFromModel来选择特征,常用嵌入法技术有:

2.1 基于线性回归模型方法

2.2 基于L1的正则化方法(容易获得稀疏数据)

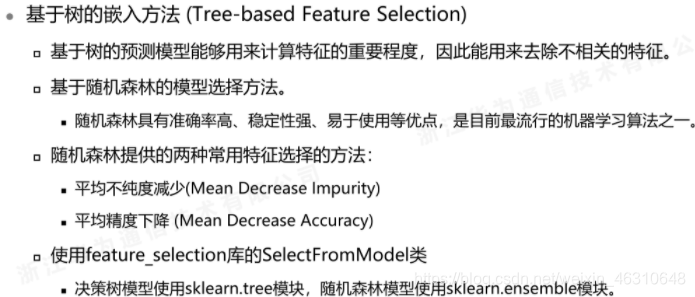

2.3 基于随机森林的嵌入方法

#基于惩罚项的特征选择法

from sklearn.feature_selection import SelectFromModel

from sklearn.linear_model import LogisticRegression

#带L1惩罚项的逻辑回归作为基模型的特征选择

SelectFromModel(LogisticRegression(penalty='l1',C=0.1)).fit_transform(iris.data,iris.target)

#通过加入penalty,将许多系数压缩至0以实现特征筛选

#基于树模型的特征选择法

#树模型中的GBDT也可用来作为基模型

from sklearn.feature_selection import SelectFromModel

from sklearn.ensemble import GradientBoostingClassifier

SelectFromModel(GradientBoostingClassifier()).fit_transform(iris.data,iris.target)

2、特征扩增

- 在原有特征上构造新的特征

二、降维

常见降维方法

- SVD——奇异值分解

- PCA——主成分分析

- LDA——线性判别分析(用到Fisher的思想,类内散度最小,类间散度最大)

- LLE——局部线性嵌入(Locally Linear Enbedding)。LLE在降维时保持样本局部的线性特性,广泛用于图像识别、高维数据可视化

三、不均衡数据处理

如果存在分类数据不均衡,要先考虑背景和适用场景,再选择是否进行处理。不均衡数据处理的方法有:

- 重新采样数据(python中SMOTH算法):欠采样适用于大数据集、过采样适用于小数据集

- K-fold交叉验证

- 一分类:样本分布及其不平衡时,可以转换成异常检测问题或一分类问题,典型运用one class SVM

- 组合不同的重采样数据

总结

以上就是今天记录的内容,刚刚大二,涉及到的很多算法和数学理论还不了解,希望暑假有时间补充。所以仅仅简单介绍了常见的特征工程方法,结合上篇数据预处理均为整体数据挖掘项目的基础。

最后, ,

,

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?