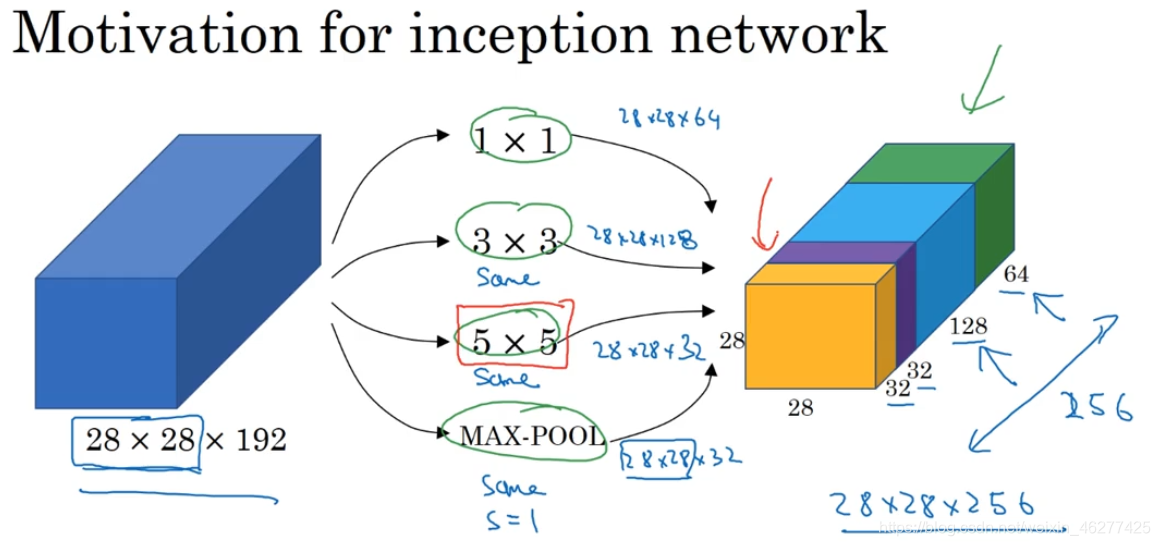

inception network

一个例子

inception network

指的是与其去考虑该使用多大的filter乃至去考虑需要一个卷积层或池化层,不如全部都做。

可以使用1x1的卷积核,会得到28x28x64的输出;

为了保证维度相同,把得到的输出使用same padding 的方法堆积在一起,所以得到的仍然是28x28的维度;

也可以使用3x3的卷积核,得到20x20x128的输出;

也可以使用5x5的卷积核,得到28x28x32的输出

再使用池化层,会得到其他的输出,在这里是28x28x32。

所以用一个inception 模块,使输入的28x28x192,输出为28x28x256。

这就是inception network的核心。

特点是:不用去只挑选一个卷积核的大小或pooling,可以所有都做,把输出的结果连接起来,然后让神经网络去学习他想用到的参数以及他想用到的卷积核大小。

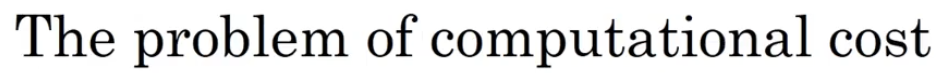

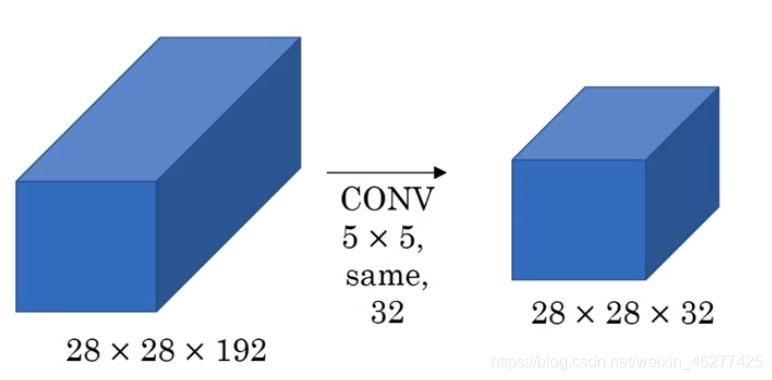

以上也引出一个计算成本问题

计算成本的例子

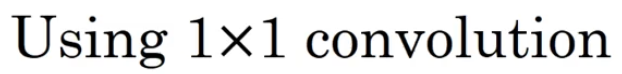

这里关注f = 5的情况,使用32个5x5的卷积核,使用same填充,输出28x28x32

另一种方法

在这种方法中将大的输入量减小成一个较小的中间量,只有16个通道,叫做瓶颈层'bottleneck layer'

计算成本小于第一种

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?