2000年初期最主要的机器学习算法是核方法。其核心是特征提取、选择和函数来计算相关性、凸优化问题(凸优化问题指的是在定义域内具有全局最优解的问题)、漂亮的定理。

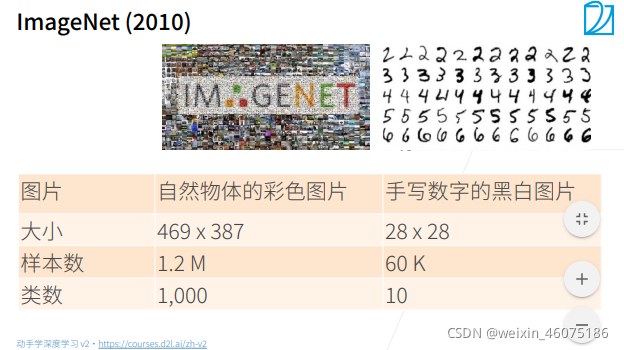

ImageNet(2010)

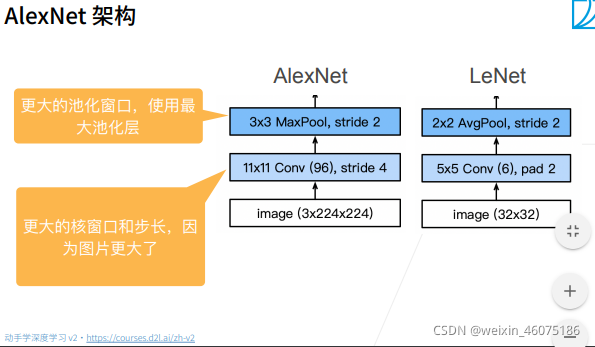

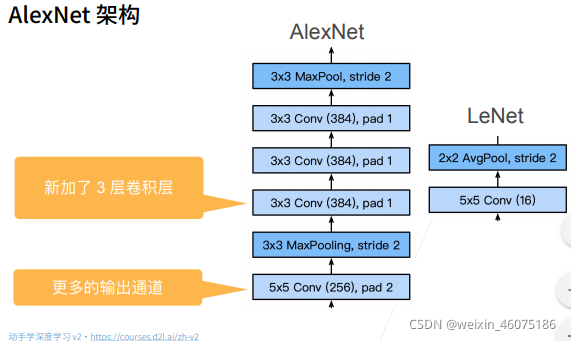

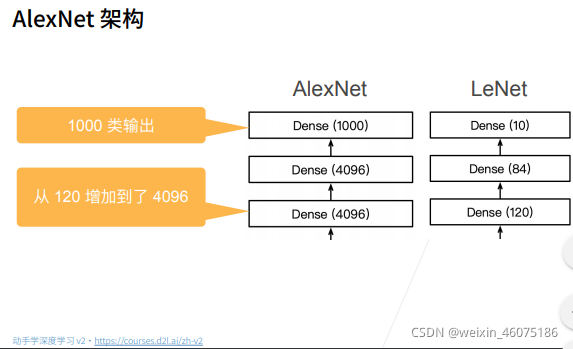

AlexNet

正是因为ImageNet变大,才使得AlexNet神经网络可以更深更大。

上图右边两张部分分别是深度学习神经网络前后对图片的处理。在深度学习神经网络之后的优点是CNN更易学习,不必了解过多计算机视觉的知识;CNN与softmax一起训练,效率更高。

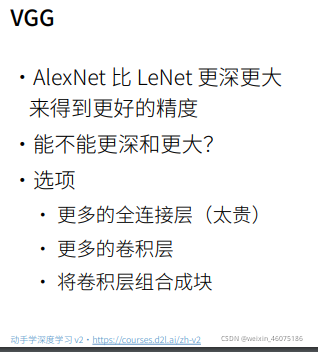

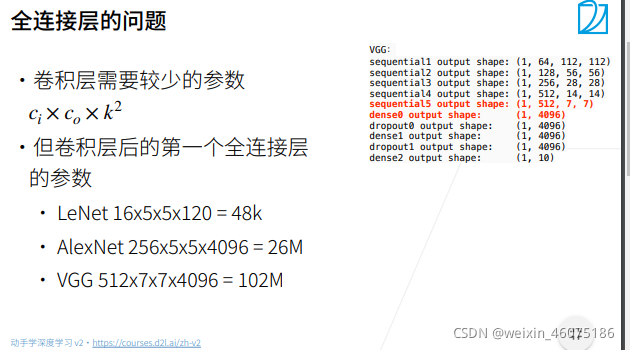

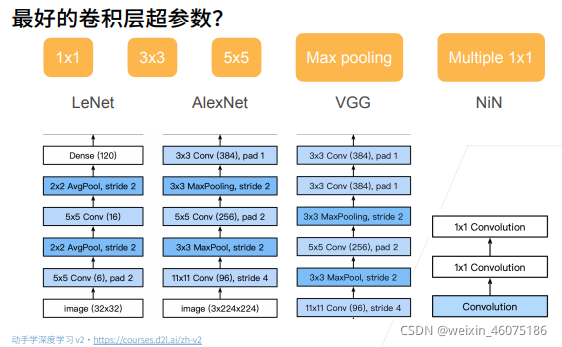

VGG

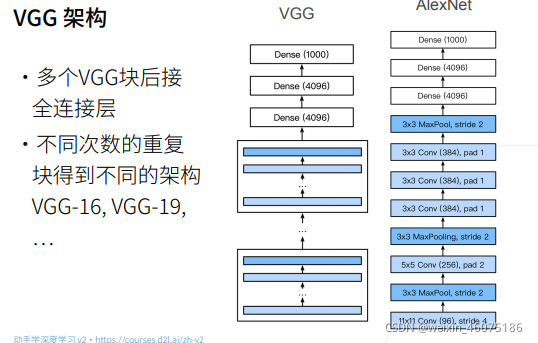

VGG16是13层卷积层+3层全连接层

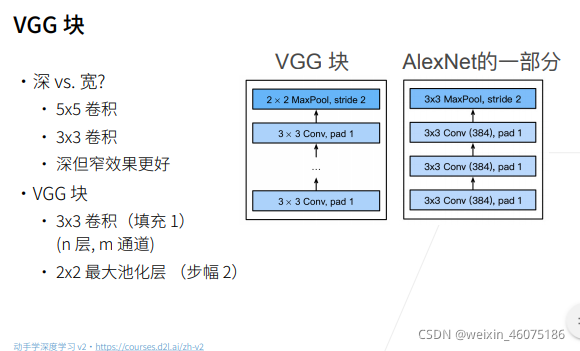

VGG使用可重复的卷积块来构建深度卷积神经网络。

不同的卷积块个数和超参数可以得到不同复杂度的变种。

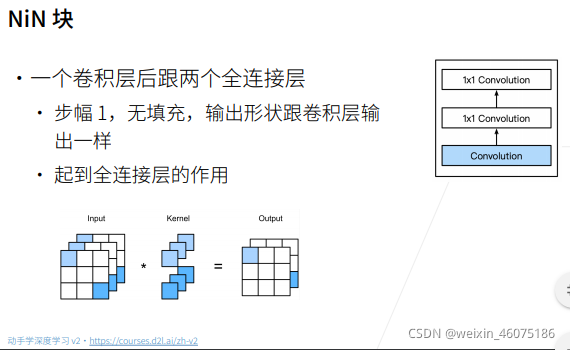

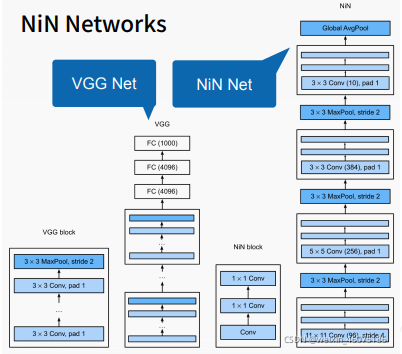

NiN

1X1卷积唯一就是可以进行通道数的改变。

使用全局平均池化,即当输入通道数是类别数时,全局平均池化后相当于每个通道取出一个平均值作为结果。

GoogLeNet

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4208

4208

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?