b站的up主刘二大人的《PyTorch深度学习实践》P3作业+笔记+代码,视频链接。

目录

1、为什么要加激活函数(非线性函数)?

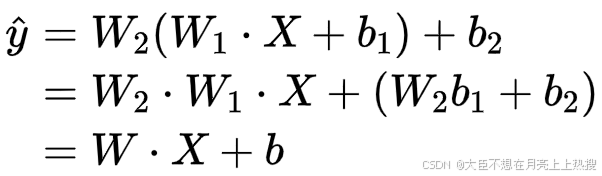

介绍:激活函数(Activation Function)是神经网络中用于引入非线性特性的函数,它帮助神经网络处理和学习复杂的非线性关系。激活函数的主要作用是在神经元的加权输入基础上进行非线性转换,使得神经网络能够拟合任意复杂的函数和模式。

一个解释:

所以要加一个非线性函数,使得网络能够拟合任意复杂的函数和模式 。

常用激活函数:Sigmoid函数、Tanh(双曲正切)函数、ReLU、Leaky ReLU、Softmax函数

2、Tensor(张量)

介绍:在深度学习框架中,张量(Tensor)是数据的基本结构,它是多维数组的扩展形式,可以看作是标量、向量、矩阵的高维推广。张量可以包含不同的维度,并支持多种操作,如加法、乘法、转置、切片等。深度学习框架(如PyTorch和TensorFlow)将张量作为数据存储和运算的核心结构。

Tensor和tensor:

torch.Tensor是 PyTorch 中张量类的名称。可以使用这个类来直接创建一个张量,但不常这样做,因为它没有指定默认的数据类型(dtype),具体的行为取决于 PyTorch 的默认设置。torch.tensor()是一个函数,用来创建张量。这是 PyTorch 中最常用的方式,允许更灵活地指定数据类型、设备(CPU 或 GPU)等。与torch.Tensor不同,torch.tensor()会默认将传入的数据转换为精确类型(默认是torch.float32)。

创建张量:通过torch.tensor()创建张量。

import torch

# 创建一个1维张量

tensor_1d = torch.tensor([1.0, 2.0, 3.0])

# tensor([1., 2.,

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?