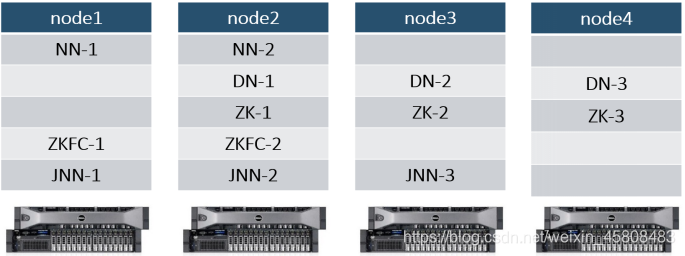

规划

搭建步骤

1、zookeeper集群搭建

a) 将zookeeper.tar.gz上传到node2、node3、node4

b) 解压到/opt

tar -zxf zookeeper-3.4.6.tar.gz -C /opt

c) 配置环境变量:

export ZOOKEEPER_PREFIX=/opt/zookeeper-3.4.6

export PATH=$PATH:$ZOOKEEPER_PREFIX/bin

然后. /etc/profile让配置生效

d) 到$ZOOKEEPER_PREFIX/conf下

复制zoo_sample.cfg为zoo.cfg

cp zoo_sample.cfg zoo.cfg

e) 编辑zoo.cfg

添加如下行:

server.1=node2:2881:3881

server.2=node3:2881:3881

server.3=node4:2881:3881

修改

dataDir=/var/bjsxt/zookeeper/data

f) 创建/var/bjsxt/zookeeper/data目录,并在该目录下放一个文件:myid

在myid中写下当前zookeeper的编号

mkdir -p /var/bjsxt/zookeeper/data

echo 3 > /var/bjsxt/zookeeper/data/myid

2181 用户客户端连接zk集群的端口

zkCli.sh 客户端启动脚本

zkServer.sh 服务端启动脚本

mysql -uroot -p123456

mysqld 服务端

g) 将/opt/zookeeper-3.4.6通过网络拷贝到node2、node3上

scp -r zookeeper-3.4.6/ node2:/opt

scp -r zookeeper-3.4.6/ node3:/opt

h) 在node2和node3上分别创建/var/bjsxt/zookeeper/data目录,

并在该目录下放一个文件:myid

node2:

mkdir -p /var/bjsxt/zookeeper/data

echo 1 > /var/bjsxt/zookeeper/data/myid

node3:

mkdir -p /var/bjsxt/zookeeper/data

echo 2 > /var/bjsxt/zookeeper/data/myid

i) 启动zookeeper

zkServer.sh start 启动zk

zkServer.sh stop 停止zk

zkServer.sh status 查看zk状态

zkServer.sh start|stop|status

j) 关闭zookeeper

zkServer.sh stop

l) 连接zookeeper

zkCli.sh node2、node3、node4都可以

m) 退出zkCli.sh命令

quit

2.hadoop配置

一律在node1上操作,做完后scp到node2、node3、node4

配置环境变量

vim /etc/profile

export JAVA_HOME=/usr/java/default

export PATH=$PATH:$JAVA_HOME/bin

export HADOOP_HOME=/opt/hadoop-2.6.5

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbinhadoop-env.sh配置JDK

export JAVA_HOME=/usr/java/defaultcore-site.xml

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://mycluster</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/var/bjsxt/hadoop/ha</value>

</property>

<!-- 指定每个zookeeper服务器的位置和客户端端口号 -->

<property>

<name>ha.zookeeper.quorum</name>

<value>node2:2181,node3:2181,node4:2181</value>

</property>

</configuration>hdfs-site.xml

<configuration>

<!-- 指定block默认副本个数 -->

<property>

<name>dfs.replication</name>

<value>2</value>

</property>

<!-- 用于解析fs.defaultFS中hdfs://mycluster中的mycluster地址 -->

<property>

<name>dfs.nameservices</name>

<value>mycluster</value>

</property>

<!-- mycluster下面由两个namenode服务支撑 -->

<property>

<name>dfs.ha.namenodes.mycluster</name>

<value>nn1,nn2</value>

</property>

<!--指定nn1的地址和端口号,发布的是一个hdfs://的服务-->

<property>

<name>dfs.namenode.rpc-address.mycluster.nn1</name>

<value>node1:8020</value>

</property>

<property>

<name>dfs.namenode.rpc-address.mycluster.nn2</name>

<value>node2:8020</value>

</property>

<!--指定三台journal服务器的地址-->

<property>

<name>dfs.namenode.shared.edits.dir</name>

<value>qjournal://node1:8485;node2:8485;node3:8485/mycluster</value>

</property>

<!-- 指定客户端查找active的namenode的策略:

会给所有namenode发请求,以决定哪个是active的 -->

<property>

<name>dfs.client.failover.proxy.provider.mycluster</name>

<value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property>

<!--在发生故障切换的时候,ssh到对方服务器,将namenode进程kill掉 kill -9 55767-->

<property>

<name>dfs.ha.fencing.methods</name>

<value>sshfence</value>

</property>

<property>

<name>dfs.ha.fencing.ssh.private-key-files</name>

<value>/root/.ssh/id_dsa</value>

</property>

<!-- 指定journalnode在哪个目录存放edits log文件 -->

<property>

<name>dfs.journalnode.edits.dir</name>

<value>/var/bjsxt/hadoop/ha/jnn</value>

</property>

<!--启用自动故障切换-->

<property>

<name>dfs.ha.automatic-failover.enabled</name>

<value>true</value>

</property>

</configuration>3.启动ha的hadoop

0)启动zookeeper集群

a) 在node1\node2\node3上启动三台journalnode

hadoop-daemon.sh start journalnodeb) 选择namenode node1,格式化HDFS

hdfs namenode -format格式化后,启动namenode进程

hadoop-daemon.sh start namenodec) 在另一台namenode node2上同步元数据

hdfs namenode -bootstrapStandbyd) 初始化zookeeper上的内容 一定是在namenode节点上。

hdfs zkfc -formatZKe) 启动hadoop集群,可在node1到node4这四台服务器上任意位置执行

start-dfs.sh

stop-dfs.sh停止hadoop服务。如果格式化之后,启动:

启动三台zk

随意节点:start-dfs.sh

hadoop-daemon.sh stop namenode

hadoop-daemon.sh stop zkfc

4.zookeeper操作

在node2或者node3或者node4上运行

zkCli.sh

ls /hadoop-ha/mycluster 查看临时文件

get /hadoop-ha/mycluster/ActiveStandbyElectorLock 查看临时文件的内容

退出zkCli.sh

quit

5、停止集群:

首先

stop-dfs.sh

其次,停止zookeeper集群

node2、node3、node4上执行:

zkServer.sh stop

本文介绍Hadoop高可用(HA)集群与Zookeeper集群的详细搭建过程,包括Zookeeper集群配置、Hadoop HA配置及启动步骤,以及如何进行Zookeeper的基本操作。

本文介绍Hadoop高可用(HA)集群与Zookeeper集群的详细搭建过程,包括Zookeeper集群配置、Hadoop HA配置及启动步骤,以及如何进行Zookeeper的基本操作。

761

761

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?