Nginx配置实例-负载均衡

目标

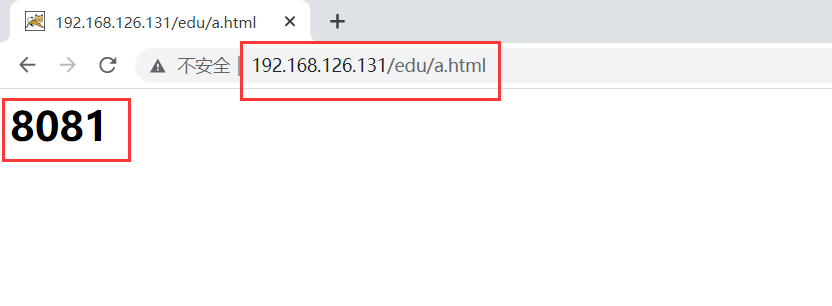

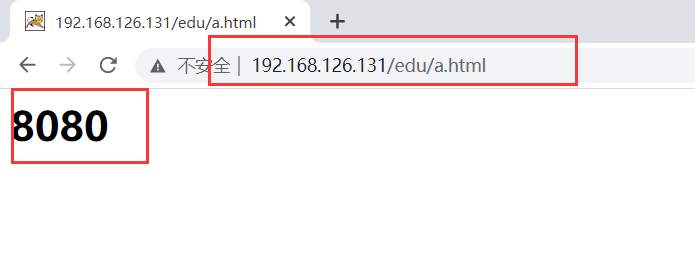

在浏览器地址栏输入地址 http://192.168.126.131:8080/edu/a.html,负载均衡效果,平均分配到 8080 和 8081 端口中

准备工作

(1)准备两台 tomcat 服务器,一台 8080,一台 8081

(2)在两台 tomcat 里面 webapps 目录中,分别创建名称是 edu 和 com 的文件夹,在 edu 文件夹中创建页面 a.html,在 com 文件夹中创建页面为 b.html ,用于测试.

(这两个步骤可以参考我上一篇博客 Nginx学习3:反向代理实例 里面的内容)

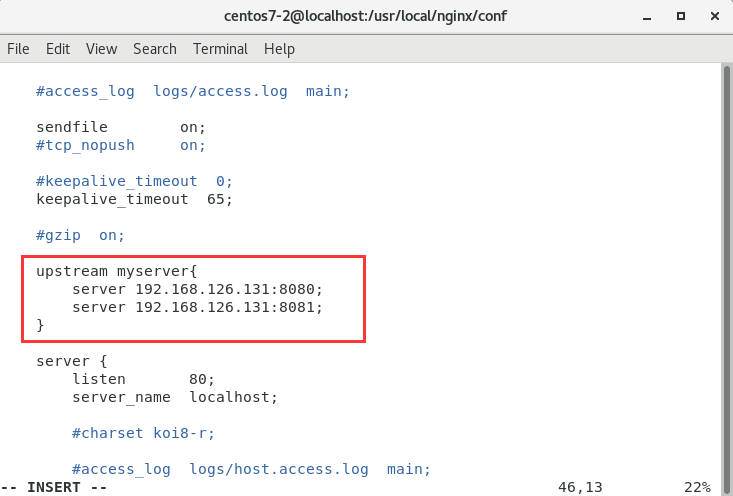

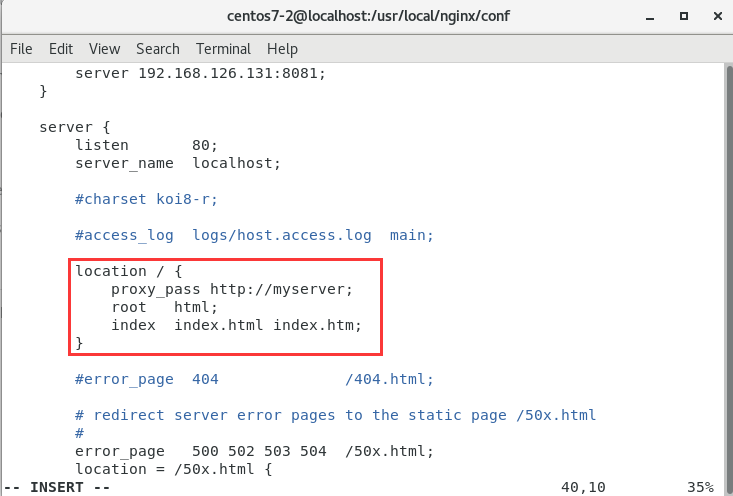

具体配置

在 nginx 的配置文件中进行负载均衡的配置

设置负载均衡策略。

最终结果

我们可以看到,随着不断刷新页面,nginx 将请求随机转发到两台 tomcat 去。

Nginx 分配服务器的策略

我们来简单了解一下 Nginx 的负载均衡策略。

第一种:轮询(默认)

每个请求按时间顺序逐一分配到不同的后端服务器,如果后端服务器 down 掉,能自动剔除。

第二种:weight

weight 代表权重,默认为 1,权重越高,被分配的客户端越多

指定轮询几率,weight 和访问比率成正比,用于后端服务器性能不均的情况。 例如:

upstream server_pool{

server 192.168.5.21:8080 weight=5;

server 192.168.5.22:8080 weight=10;

}

第三种:ip_hash

每个请求按访问 ip 的 hash 结果分配,这样每个访客固定访问一个后端服务器,可以解决 session 共享的问题。 例如:

upstream server_pool{

ip_hash;

server 192.168.5.21:8080;

server 192.168.5.22:8080;

}

第四种:fair(非官方)

按后端服务器的响应时间来分配请求,响应时间短的优先分配。例如:

upstream server_pool{

server 192.168.5.21:80;

server 192.168.5.22:80;

fair;

}

PS:可以到我的个人博客查看更多内容

个人博客地址:小关同学的博客

本文介绍了如何通过Nginx实现负载均衡,以http://192.168.126.131:8080/edu/a.html为例,详细阐述了配置过程。同时,探讨了Nginx的四种负载均衡策略:轮询、权重分配、IP哈希和公平算法,帮助理解其工作原理和应用场景。

本文介绍了如何通过Nginx实现负载均衡,以http://192.168.126.131:8080/edu/a.html为例,详细阐述了配置过程。同时,探讨了Nginx的四种负载均衡策略:轮询、权重分配、IP哈希和公平算法,帮助理解其工作原理和应用场景。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?