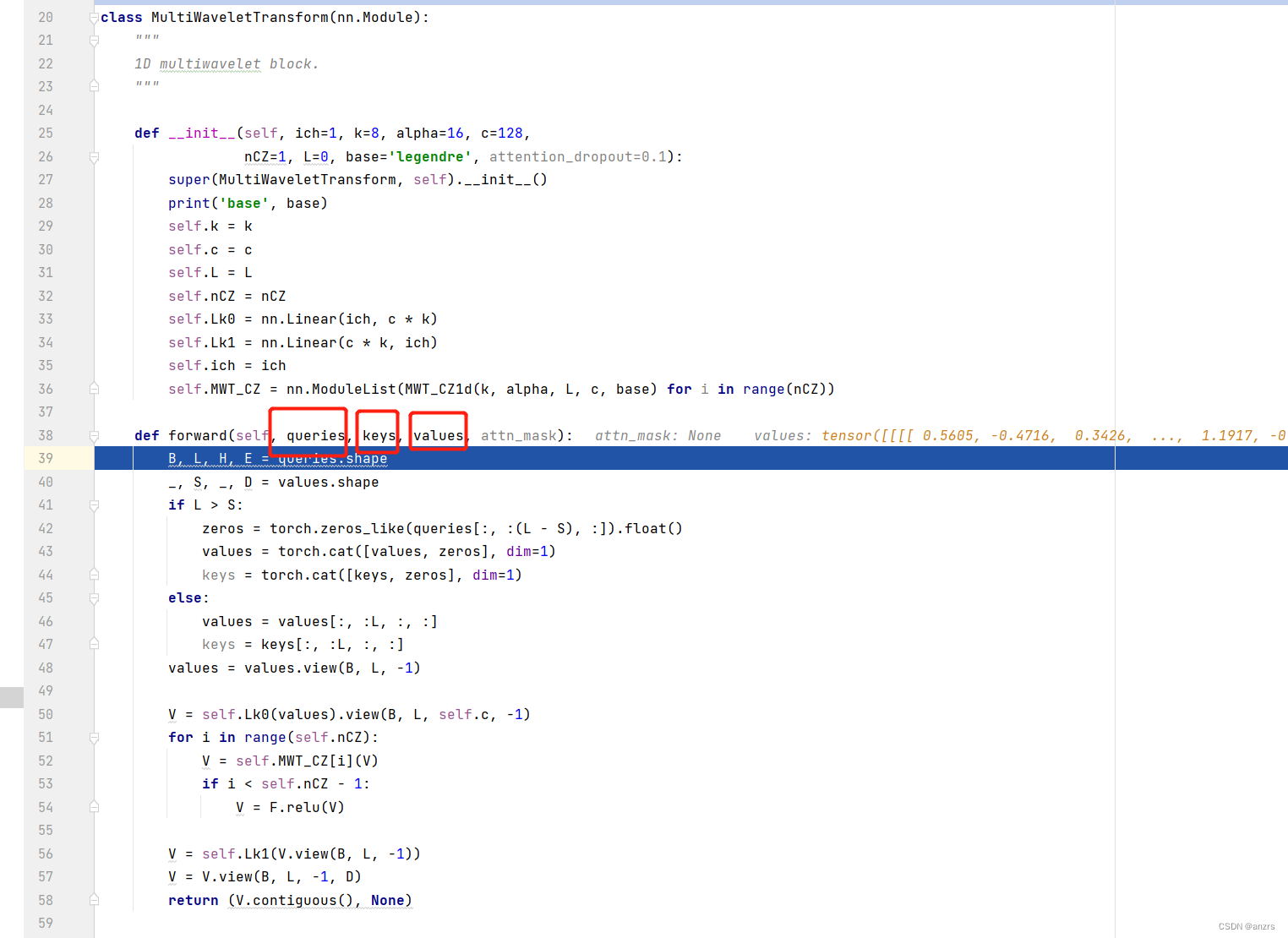

这个里面q,k,v就像是attention的qkv。

他们的维度都是

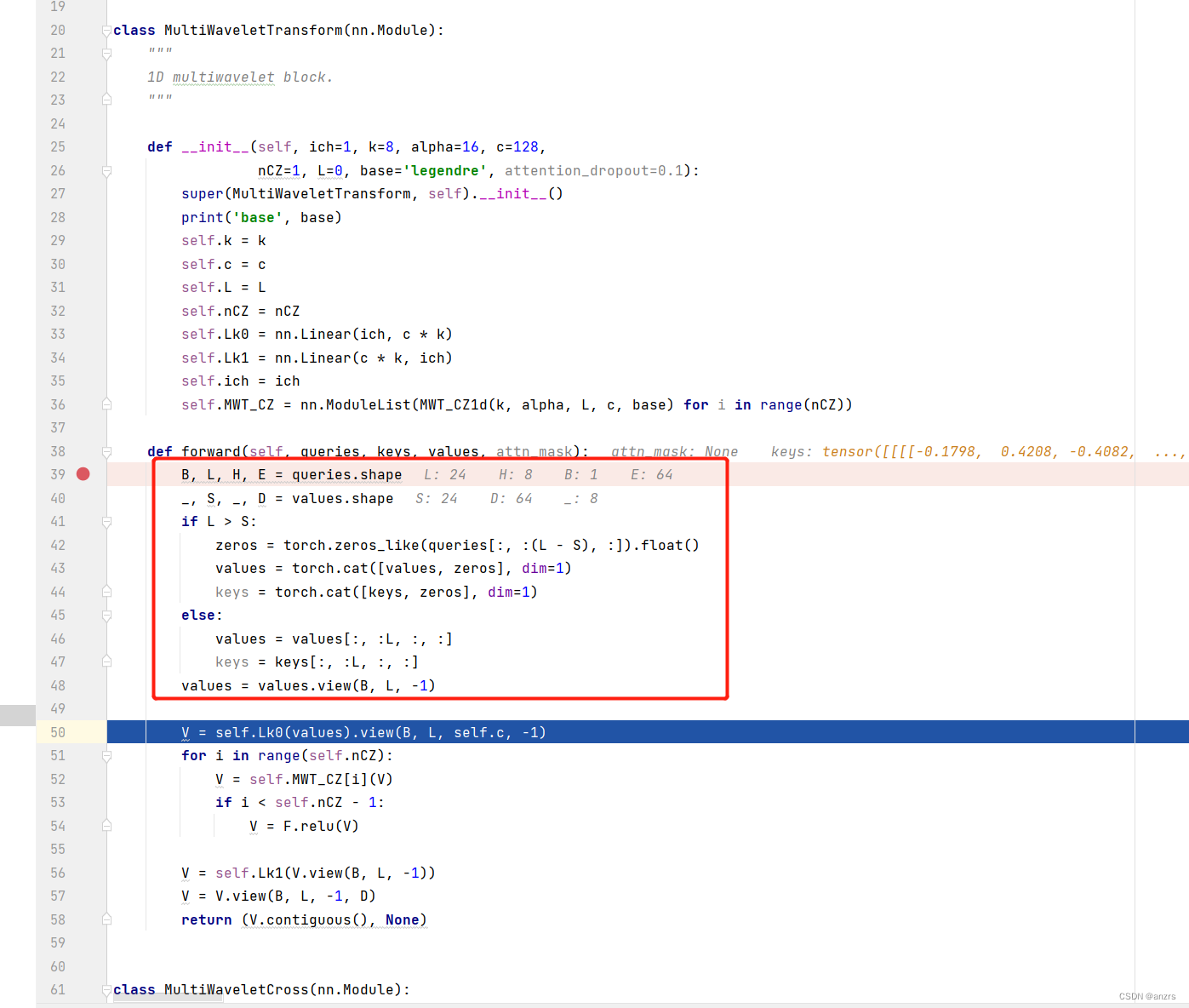

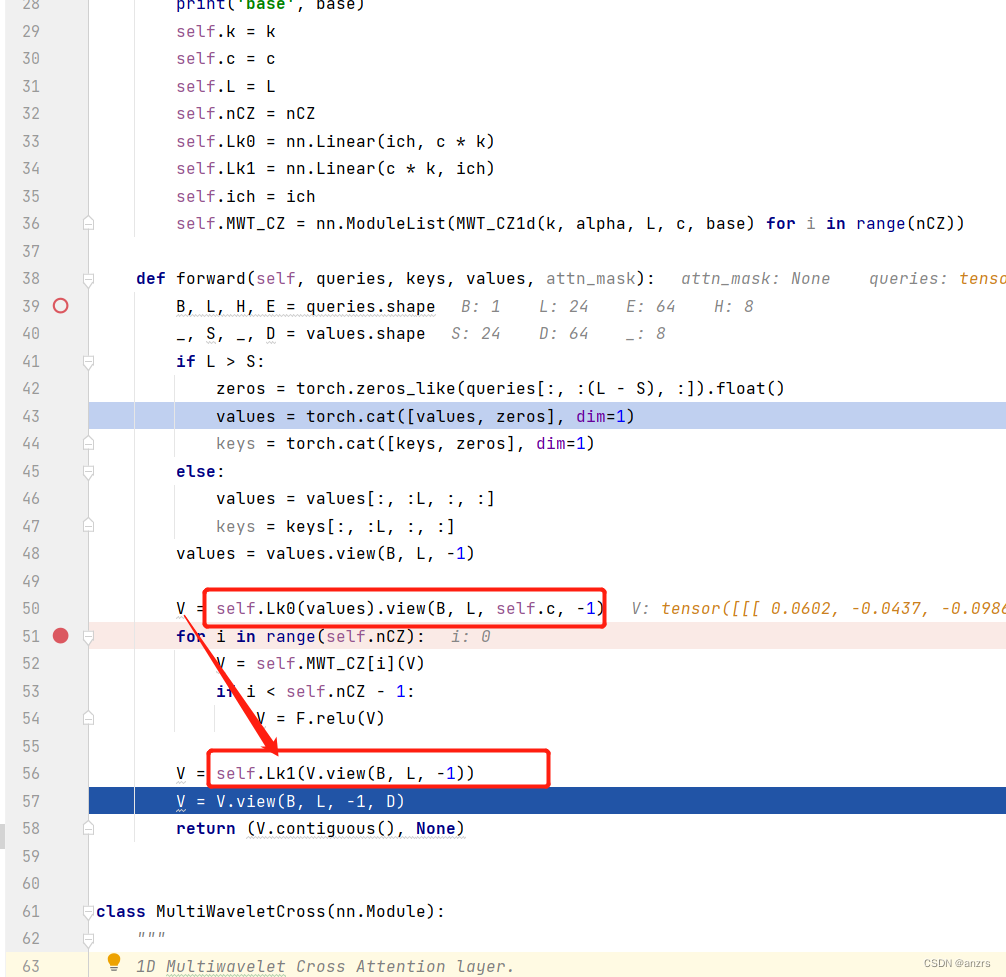

然后,会判断L和S谁大谁小。

一般来说,应该是一样大的,所以应该不会进入这个里面。

下面,到了下面这一步,这个values有变回来了(1,24,512)

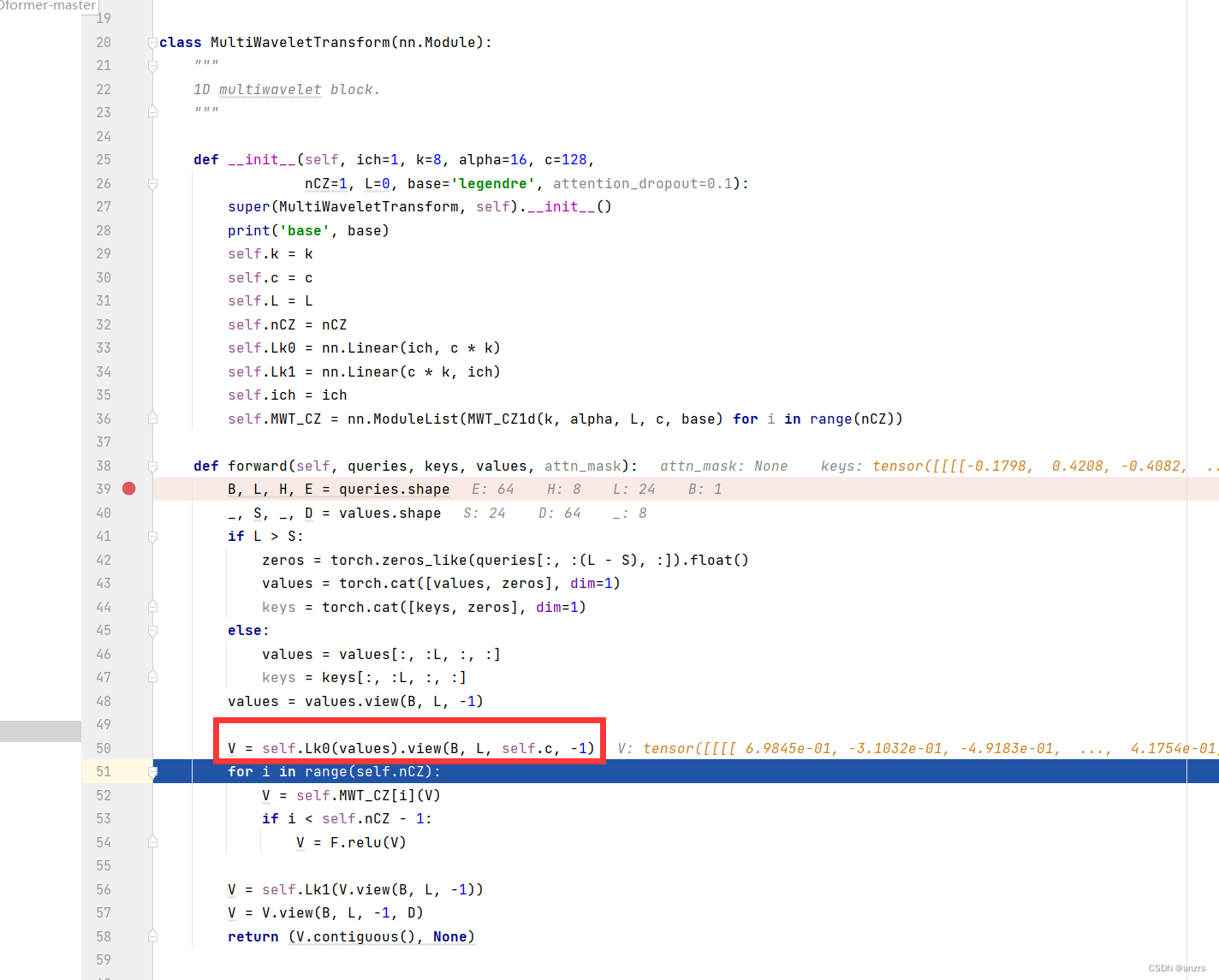

然后,这个V用了一个linear来进行映射一下,values就变成了,(1,24,128,8)

然后,会对V进行这些操作。

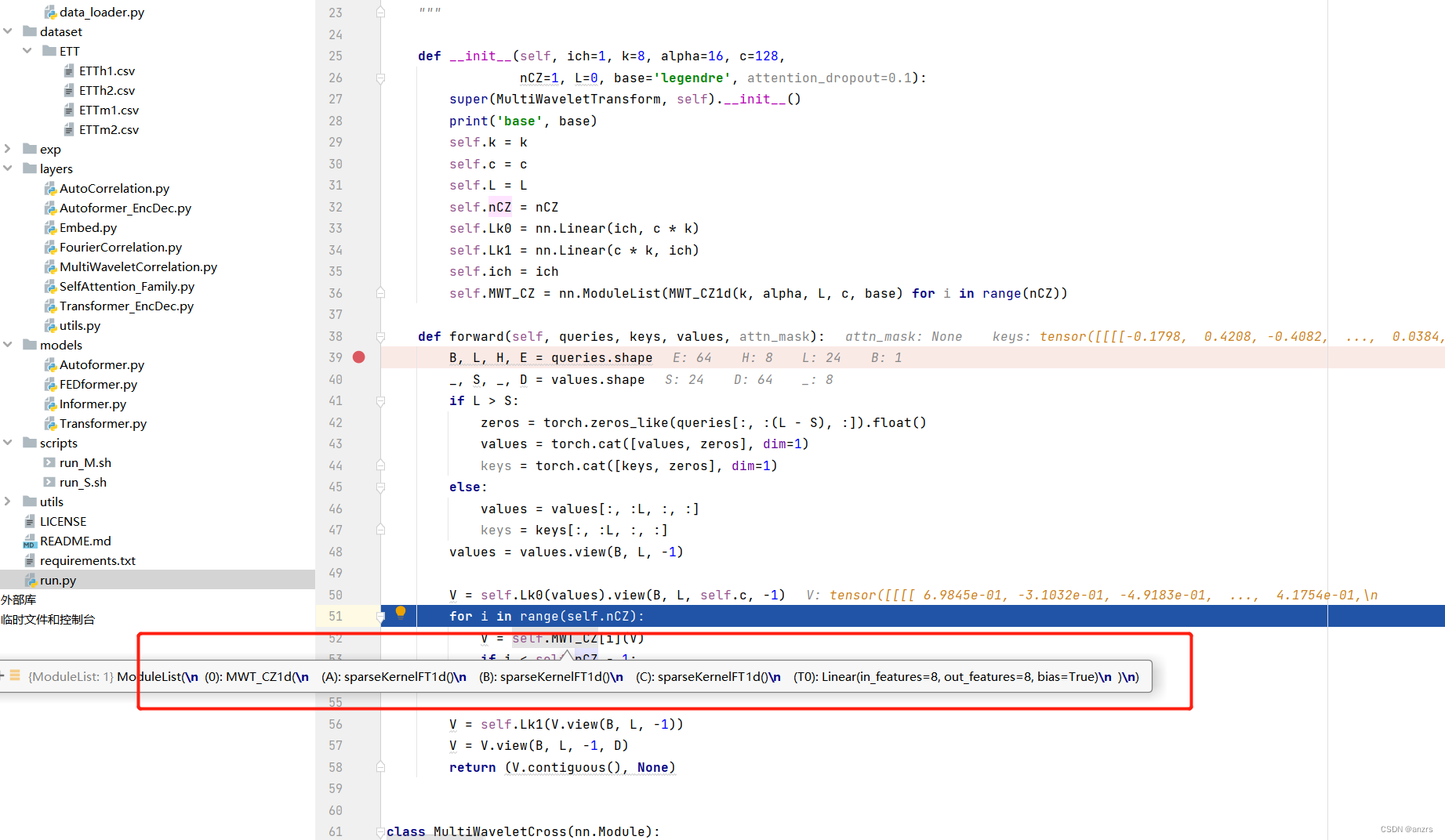

list,里面有这些东西,是learning的一些操作。

一开始,V的维度是(1,24,128,8)的尺寸。

然后,在这里,对value做了操作。具体的操作是里面的这个MWT_CZ这个操作,

大概的意思是,先把维度拓展了,然后又变了回来。通过linear变回来,通过linear变过去。

这篇博客探讨了Transformer模型中Q、K、V的维度变换过程。在注意力机制中,Q、K、V通常有相同的维度。在某个步骤中,values的维度从(1,24,512)变为(1,24,128,8),之后经过线性映射操作。MWT_CZ操作被用于扩展和重塑维度,保持信息的完整性和学习过程的有效性。

这篇博客探讨了Transformer模型中Q、K、V的维度变换过程。在注意力机制中,Q、K、V通常有相同的维度。在某个步骤中,values的维度从(1,24,512)变为(1,24,128,8),之后经过线性映射操作。MWT_CZ操作被用于扩展和重塑维度,保持信息的完整性和学习过程的有效性。

555

555

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?