FCN:Fully Convolutional Networks for Semantic Segmentation阅读笔记

摘要

卷积神经网络是一种可以产生特征层次结构的可视化模型,我们证明了卷积神经网络本身在图像分割中可以实现端到端的、像素到像素的训练,并可达到SOTA。**我们的主要观点是建立了可以采用任意尺寸输入,并经过有效的推理和学习能够产生相应大小的输出的全卷积神经网络。**我们定义并详细描述了完全卷积网络的空间,解释了它们在空间密集型预测任务中的应用,以及与先前模型的联系。我们将当代分类网络(AlexNet、VGG网络和GoogLeNet[32])改编为完全卷积网络,并通过微调将其学习表示转移到分割任务中。然后,我们定义了一种新的体系结构,它将来自深层、粗糙层的语义信息与来自浅层、精细层的外观信息相结合,以产生精确而详细的分割。我们的完全卷积网络实现了PASCAL VOC(相对于2012年的62.2%平均IU)、NYUDv2和SIFT流的最先进分割,而对典型图像的推断只需不到五分之一秒。

全卷积网络

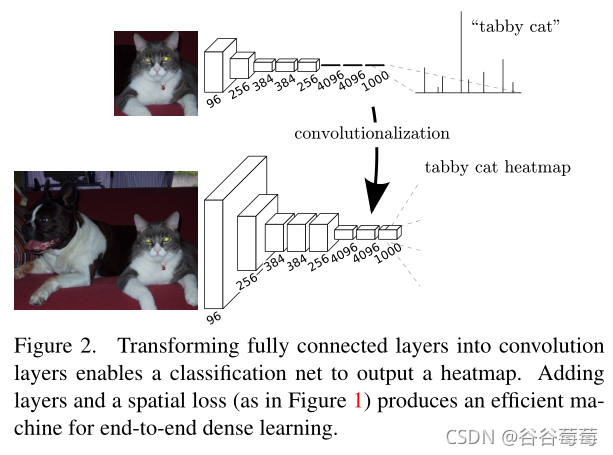

典型的识别网络,采用了固定的输出和产生没有空间的输出,这些网络的全连接层也可以看成是对整张图进行卷积操作的卷积核,这样就可以将全连接层转化为全卷积层,能接受任意大小的输入和输出分类图。这种变化如原图2所示。

上采样是反向步幅卷积

从某种意义上说,因子f的上采样是与分数输入步幅为1/f的卷积。只要f是积分的,那么上采样的一种自然方法就是反卷积(有时称为反卷积),其输出步幅为f。这样的操作实现起来很简单,因为它只是将卷积的前向和后向过程颠倒过来。因此,在网络内进行上采样,从像素损失反向传播进行端到端学习。

网络结构

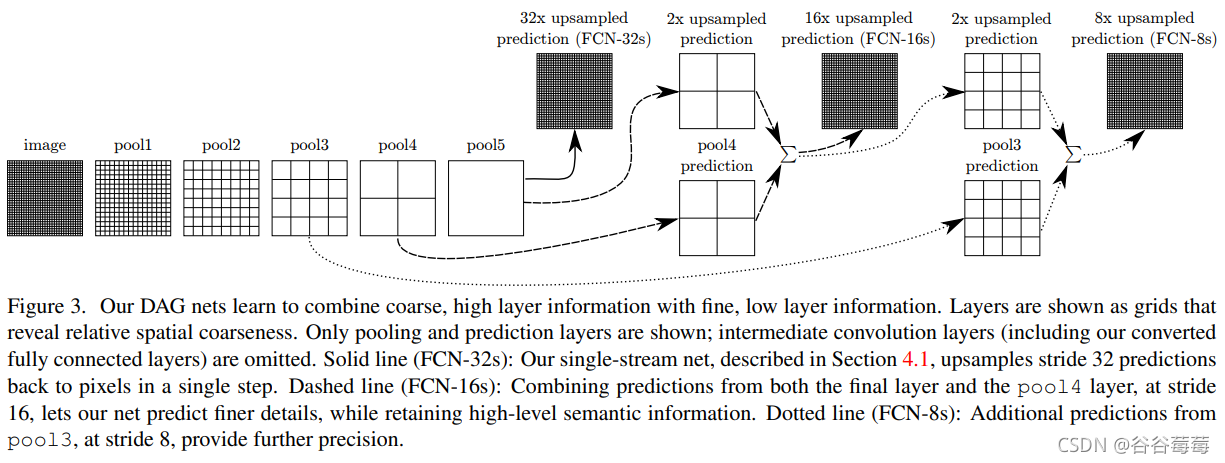

原始图像先经过五次卷积和池化操作,分别生成原图像1/2,1/4,1/8,1/16,1/32大小的特征图,操作期间保留第3,4,5次的输出。(到此典型分类网络进行的是全连接层,而本文则采用卷积层)

1.对保存的第5次输出的特征图进行池化操作,然后进行32倍的上采样,至此可以进行分割预测,称为FCN-32s。

2.对保存的第5次输出的特征图进行池化操作,进行2倍的上采样,与保存的第4次输出的特征图融合,然后进行16倍的上采样,成为FCN-16s。

3.将2中融合的特征图进行2倍的上采样,与保存的第3次输出的特征图融合,然后进行8倍的上采样,称为FCN-8s。

仅作自己学习,有不对的地方,请指出。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?