一文看懂Python 爬虫 进阶(一)

文章目录

必需模块

- -相信你已经对爬虫已经有过简单了解,所有这些都是直接切入主题的干货教程

- -这些必需模块简单的看看下列代码就懂了,很简单,我们在后面的应用中会用到,现在看不懂,后面自然就懂了

请求模块(urllib.request)

req = request.Request(url,headers=headers)

res = request.urlopen(req)

html = res.read().decode('utf-8')

编码模块(urllib.parse)

1、urlencode({dict})

urlencode({'wd':'美女','pn':'20'})

编码后 :'wd=%E8%D5XXX&pn=20'

2、quote(string)

quote('织女')

编码后 :'%D3%F5XXX'

3、unquote('%D3%F5XXX')

解析模块(re)

使用流程

p = re.compile('正则表达式',re.S)

r_list = p.findall(html)

贪婪匹配和非贪婪匹配

贪婪匹配(默认) : .*

非贪婪匹配 : .*?

正则表达式分组

1、想要什么内容在正则表达式中加()

2、多个分组,先按整体正则匹配,然后再提取()中数据。结果:[(),(),(),(),()]

csv模块

作用

将爬取的数据存放到本地的csv文件中

使用流程

1、导入模块

2、打开csv文件

3、初始化写入对象

4、写入数据(参数为列表)

示例代码

创建 test.csv 文件,在文件中写入2条数据(01_csv_example.py)

# 单行写入(writerow([]))

import csv

with open('test.csv','w') as f:

writer = csv.writer(f)

writer.writerow(['詹姆斯','35'])

writer.writerow(['杜兰特','30'])

# 多行写入(writerows([(),(),()]

import csv

with open('test.csv','w') as f:

writer = csv.writer(f)

writer.writerows([('哈登','28'),('威少','27'),('卡佩拉','26')])

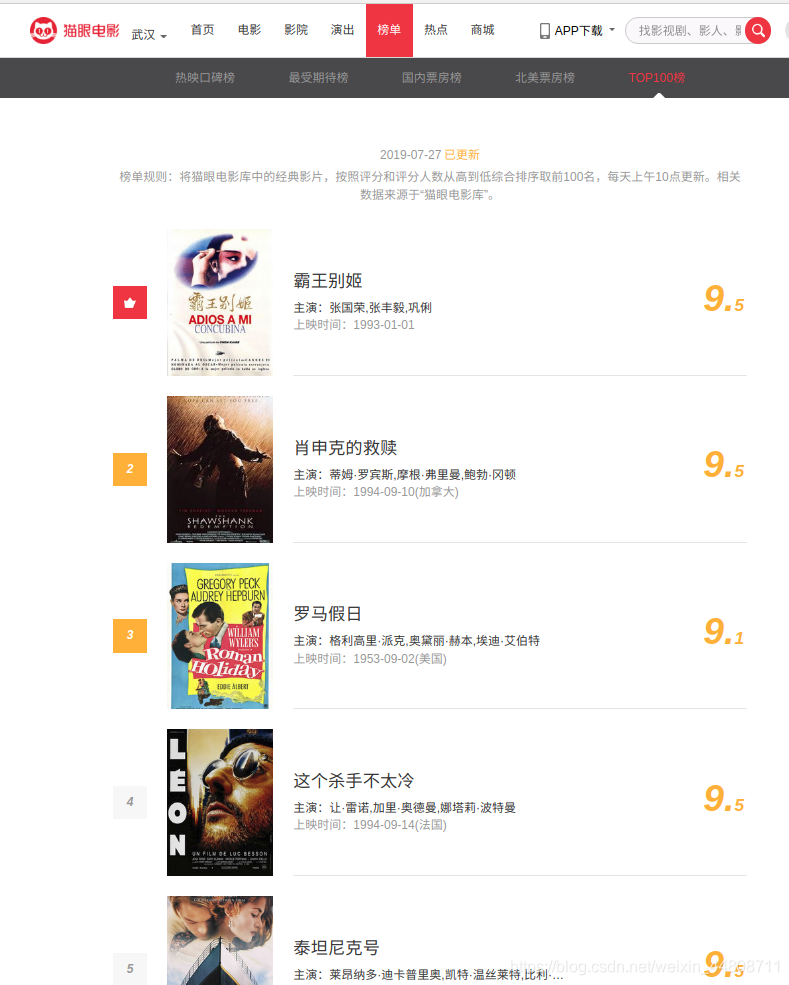

猫眼电影top100抓取案例

如图所示

确定URL网址

猫眼电影 - 榜单 - top100榜

目标

电影名称、主演、上映时间

操作步骤

-

- 找URL规律

第1页:https://maoyan.com/board/4?offset=0

第2页:https://maoyan.com/board/4?offset=10

第n页:offset=(n-1)*10

-

- 正则表达式

<div class="movie-item-info">.*?title="(.*?)".*?class="star">(.*?)</p>.*?releasetime">(.*?)</p>

-

- 编写程序框架,完善程序(四部曲)

from urllib import request

import time

import re

import csv

import random

class MaoyanSpider(object):

def __init__(self):

self.url = 'https://maoyan.com/board/4?offset={}'

self.ua_list = [

'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/72.0.3626.119 Safari/537.36',

'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/535.1 (KHTML, like Gecko) Chrome/14.0.835.163 Safari/535.1',

'Mozilla/5.0 (Windows NT 6.1; WOW64; rv:6.0) Gecko/20100101 Firefox/6.0'

]

# 爬取页数计数

self.page = 1

# 获取页面

def get_page(self,url):

# 访问不同页面使用随机的User-Agent

headers = {'User-Agent':random.choice(self.ua_list)}

req = request.Request(url,headers=headers)

res = request.urlopen(req)

html = res.read().decode('utf-8')

# 直接调用解析函数

self.parse_page(html)

# 解析页面

def parse_page(self,html):

# 正则解析

p = re.compile('<div class="movie-item-info">.*?title="(.*?)".*?class="star">(.*?)</p>.*?releasetime">(.*?)</p>',re.S)

r_list = p.findall(html)

# r_list : [('霸王别姬','张国荣','1993'),(),()]

self.write_page(r_list)

# 保存数据(从终端输出)

def write_page(self,r_list):

# r_list : [(),(),()]

print(r_list)

film_dict = {}

for rt in r_list:

film_dict['name'] = rt[0].strip()

film_dict['star'] = rt[1].strip()

film_dict['time'] = rt[2].strip()

print(film_dict)

# 主函数

def main(self):

# 用range函数可获取某些查询参数的值

for offset in range(0,41,10):

url = self.url.format(offset)

self.get_page(url)

print('第{}页爬取成功'.format(self.page))

self.page += 1

# 每爬1页随机休眠,控制爬取速率

time.sleep(random.randint(0,2))

if __name__ == '__main__':

spider = MaoyanSpider()

spider.main()

再次梳理一下爬取的流程

- 找URL规律

- 正则表达式

- 编写程序框架,完善程序(四部曲)

数据持久化存储(MySQL数据库)

让我们来回顾一下pymysql模块的基本使用

import pymysql

db = pymysql.connect('localhost','root','123456','maoyandb',charset='utf8')

cursor = db.cursor()

# execute()方法第二个参数为列表传参补位

cursor.execute('insert into film values(%s,%s,%s)',['霸王别姬','张国荣','1993'])

# 提交到数据库执行

db.commit()

# 关闭

cursor.close()

db.close()

让我们来回顾一下pymysql中executemany()的用法

import pymysql

# 数据库连接对象

db = pymysql.connect(

'localhost','root','123456',charset='utf8'

)

# 游标对象

cursor = db.cursor()

# 存放所有数据的大列表

ins_list = []

for i in range(2):

name = input('请输入第%d个学生姓名:' % (i+1))

age = input('请输入第%d个学生年龄:' % (i+1))

ins_list.append([name,age])

# 定义插入语句

ins = 'insert into t3 values(%s,%s)'

# 一次数据库的IO操作可插入多条语句,提升性能

cursor.executemany(ins,ins_list)

# 提交到数据库执行

db.commit()

cursor.close()

db.close()

练习:把猫眼电影案例中电影信息存入MySQL数据库中(尽量使用executemany方法)

from urllib import request

import time

import re

import csv

import random

import pymysql

class MaoyanSpider(object):

def __init__(self):

self.url = 'https://maoyan.com/board/4?offset={}'

self.ua_list = [

'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/72.0.3626.119 Safari/537.36',

'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/535.1 (KHTML, like Gecko) Chrome/14.0.835.163 Safari/535.1',

'Mozilla/5.0 (Windows NT 6.1; WOW64; rv:6.0) Gecko/20100101 Firefox/6.0'

]

# 爬取页数计数

self.page = 1

# 创建2个对象

self.db = pymysql.connect(

'192.168.153.130','tiger','123456','maoyandb',

charset='utf8'

)

self.cursor = self.db.cursor()

# 获取页面

def get_page(self,url):

# 访问不同页面使用随机的User-Agent

headers = {'User-Agent':random.choice(self.ua_list)}

req = request.Request(url,headers=headers)

res = request.urlopen(req)

html = res.read().decode('utf-8')

# 直接调用解析函数

self.parse_page(html)

# 解析页面

def parse_page(self,html):

# 正则解析

p = re.compile('<div class="movie-item-info">.*?title="(.*?)".*?class="star">(.*?)</p>.*?releasetime">(.*?)</p>',re.S)

r_list = p.findall(html)

# r_list : [('霸王别姬','张国荣','1993'),(),()]

self.write_page(r_list)

# 保存数据(存到mysql数据库)

def write_page(self,r_list):

# 存放1页电影数据的空列表

one_page_list = []

ins = 'insert into maoyanfilm(name,star,time) values(%s,%s,%s)'

for rt in r_list:

one_film_list = [

rt[0].strip(),

rt[1].strip(),

rt[2].strip()[5:15]

]

one_page_list.append(one_film_list)

self.cursor.executemany(ins,one_page_list)

# 提交到数据库执行

self.db.commit()

# 主函数

def main(self):

# 用range函数可获取某些查询参数的值

for offset in range(0,41,10):

url = self.url.format(offset)

self.get_page(url)

print('第{}页爬取成功'.format(self.page))

self.page += 1

# 每爬1页随机休眠,控制爬取速率

time.sleep(random.randint(0,2))

if __name__ == '__main__':

spider = MaoyanSpider()

spider.main()

让我们来做个SQL命令查询

1、查询20年以前的电影的名字和上映时间

select name,time from film where time<=(now()-interval 20 year);

2、查询1990-2000年的电影名字和上映时间

select name,time from film where time>='1990-01-01' and time<='2000-12-31';

电影天堂案例(二级页面抓取)

- 确定URL地址

百度搜索 :电影天堂 - 2019年新片 - 更多

- 目标(输出格式)

*********一级页面***********

1、电影名称

2、电影链接

*********二级页面***********

1、下载链接

- 步骤

- 还是那四部曲,只不过在解析的时候多了一个对于二级页面的解析

- 找URL规律

第1页 :https://www.dytt8.net/html/gndy/dyzz/list_23_1.html

第2页 :https://www.dytt8.net/html/gndy/dyzz/list_23_2.html

第n页 :https://www.dytt8.net/html/gndy/dyzz/list_23_n.html

- 写正则表达式

1、一级页面正则表达式

<table width="100%".*?<td width="5%".*?<a href="(.*?)".*?ulink">(.*?)</a>.*?</table>

2、二级页面正则表达式

<td style="WORD-WRAP.*?>.*?>(.*?)</a>

- 代码实现

from urllib import request

import re

class FilmSpider(object):

def __init__(self):

self.url = 'https://www.dytt8.net/html/gndy/dyzz/list_23_{}.html'

self.headers = {'User-Agent': 'Mozilla/5.0'}

# 获取页面

def get_page(self, url):

req = request.Request(url, headers=self.headers)

res = request.urlopen(req)

html = res.read().decode('gb18030', 'ignore')

return html

# 解析一级页面

def parse_one_page(self, html):

p = re.compile('<table width="100%".*?<td width="5%".*?<a href="(.*?)".*?ulink">(.*?)</a>.*?</table>', re.S)

film_list = p.findall(html)

# [('/html/gndy/dyzz/20190523/58629.html', '2019年爱情喜剧《最佳男友进化论》HD国语中字'),]

for film_info in film_list:

film_name = film_info[1]

# 拼接详情页链接

film_link = 'https://www.dytt8.net{}'.format(film_info[0].strip())

# 获取二级页面的函数

down_link = self.get_download_link(film_link)

film = {

'电影名称': film_name,

'下载链接': down_link[0].strip()

}

print(film)

# 获取二级页面的数据

def get_download_link(self, film_link):

html = self.get_page(film_link)

p = re.compile('<td style="WORD-WRAP.*?>.*?>(.*?)</a>', re.S)

download_link_list = p.findall(html)

return download_link_list

def main(self):

for i in range(1,11):

url = self.url.format(i)

html = self.get_page(url)

self.parse_one_page(html)

if __name__ == '__main__':

spider = FilmSpider()

spider.main()

``

- 看到这里,那么恭喜你,你已经成功的会了爬虫入门的第一步

本文详细介绍Python爬虫的必备模块及应用,包括请求、编码、解析和数据存储等关键环节,通过猫眼电影和电影天堂案例,展示如何抓取网页数据并进行持久化存储。

本文详细介绍Python爬虫的必备模块及应用,包括请求、编码、解析和数据存储等关键环节,通过猫眼电影和电影天堂案例,展示如何抓取网页数据并进行持久化存储。

2853

2853

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?