知识追踪

- (2015 NIPS)Deep Knowledge Tracing

- (2017 WWW)Dynamic Key-Value Memory Networks for Knowledge Tracing

- (2019 AAAI)Knowledge Tracing Machines-Factorization Machines for Knowledge Tracing

- (2019 WI)Graph-based Knowledge Tracing—Modeling Student Proficiency Using Graph Neural Network

- (2021 CIKM)Multi-Factors Aware Dual-Attentional Knowledge Tracing

(2015 NIPS)Deep Knowledge Tracing

Paper链接: DKT

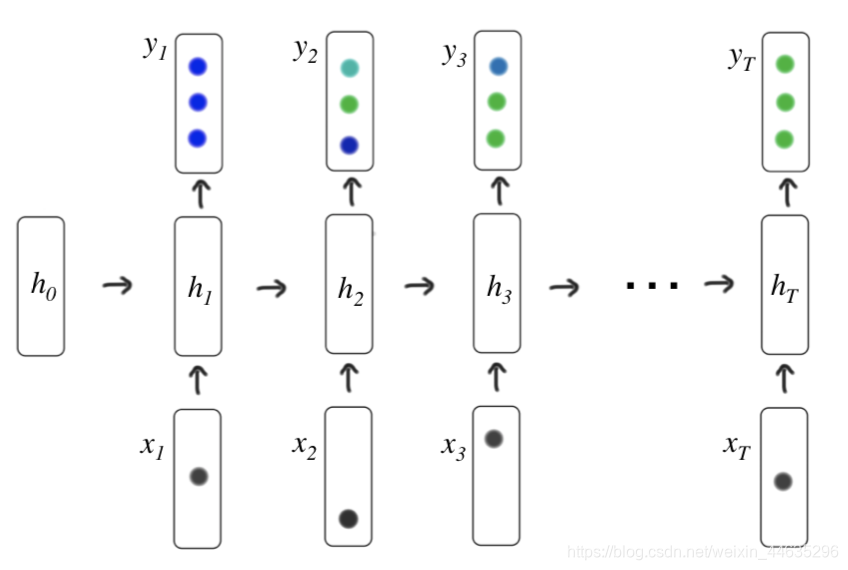

虽然知识追踪这个方向很早就被提出来了,但是直到2015年,才首次将深度神经网络(RNN)引入到知识追踪领域,并显示出卓越的性能。模型部分使用的是一个传统的RNN模型:

这里面模型的输入是学生和题目的交互向量 x t x_{t} xt,其中 x t ∈ ( 0 , 1 ) 2 N x_{t}\in\mathbb (0,1)^{2N} xt∈(0,1)2N, x t x_{t} xt的前N个向量对应学生做题正确的记录,后N个向量对应学生做错的记录,其中哪一题做对或者做错,那么对应位置的元素为1,其余的元素为0,所以输入的是one-hot向量。RNN网络中每一时刻的隐层向量 h t h_{t} ht对应的是学生在该时刻的知识状态。

DKT不仅在预测方面取得了较好的性能,还可以发掘练习题之间的关系: J i j = y ( j ∣ i ) Σ k y ( j ∣ k ) J_{ij}=\frac{y(j|i)}{\varSigma_ky(j|k)} Jij=Σky(j∣k)y(j∣i)

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3568

3568

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?