第一章 部署虚拟环境安装linux

一、先安装好VM虚拟机

二、打开安装好的vm虚拟机,选择创建新的虚拟机

三、在弹出的窗口中选择稍后安装系统,接下来根据引导知道结束。

四、在新建出来的虚拟机中编辑虚拟机的配置。将声卡、打印机等等不用的硬件统统删掉

五、根据自己真实机的情况分配好内存大小,与处理器数量,cd/dvd中选择下载好的系统镜像,网卡选择仅主机模式

六、启动虚拟机。进去系统安装界面。

七、选择好语言(推荐选择英语,一举两得)。done。下一步

八、选择时区、选择键盘、选择语言、选择安装源、选择安装软件(一定要选择带GUI的服务,“server with GUI”)、选择安装位置(一定选择自动分区)、网络服务中自定义hostname主机名

九、开始安装。创建root用户密码

十、重启进入系统,同意许可,不启用kdump。

十一、创建本地用户

十二、正常使用Linux系统

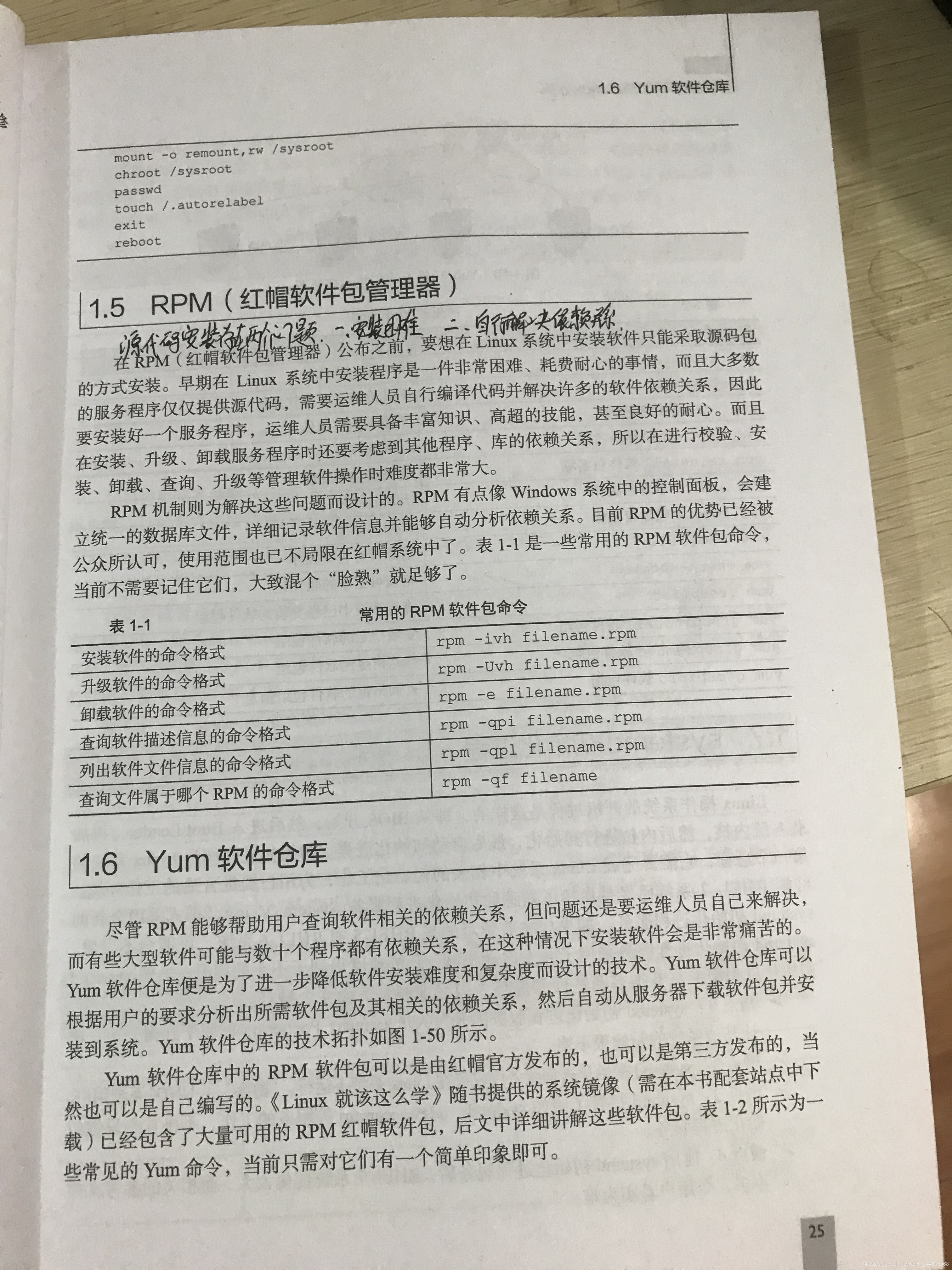

linux系统不像windows系统,在拿到一个新系统后,连上网络,自行下载自己喜欢的软件。这种操作在linux系统中变得很复杂很繁琐。这些复杂繁琐主要体现在两个方面:一、用户需要自行准备编译环境。二、用户需要自行解决依赖关系(这个才是最繁琐的)。为了简化这些过程,提高对用户的友好性,拉低系统的使用门槛,就出现了yum(后来的dnf)仓库管理。yum好比一个仓库,你需要什么就可以从这个

本文介绍了如何在虚拟机中部署Linux系统,从安装VM虚拟机到选择系统镜像,再到设置虚拟机配置和安装过程。强调了在Linux系统中软件安装的复杂性,特别是依赖关系的解决,介绍了yum(dnf)仓库管理的重要性。此外,还提及了Red Hat 7中使用systemd初始化进程的变化,并列举了常用systemctl命令。

本文介绍了如何在虚拟机中部署Linux系统,从安装VM虚拟机到选择系统镜像,再到设置虚拟机配置和安装过程。强调了在Linux系统中软件安装的复杂性,特别是依赖关系的解决,介绍了yum(dnf)仓库管理的重要性。此外,还提及了Red Hat 7中使用systemd初始化进程的变化,并列举了常用systemctl命令。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?