目录

2. Stochastic Gradient Descent

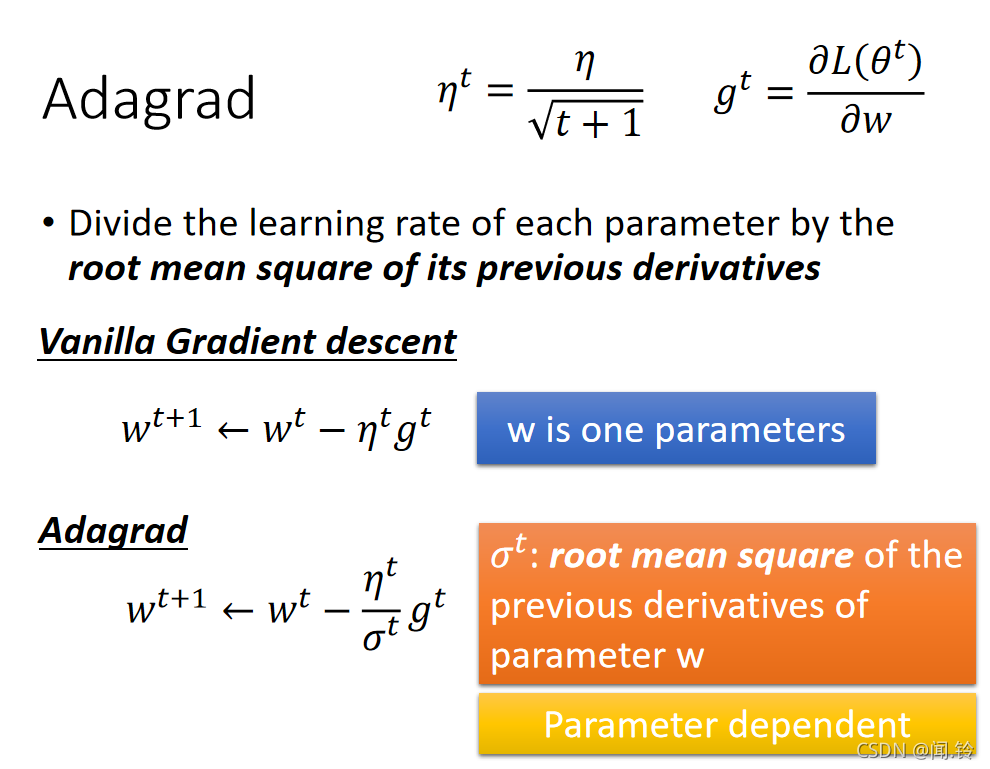

1. 调整learning rate——Adagrad

2. Stochastic Gradient Descent

每看一个数据,就做一次梯度下降

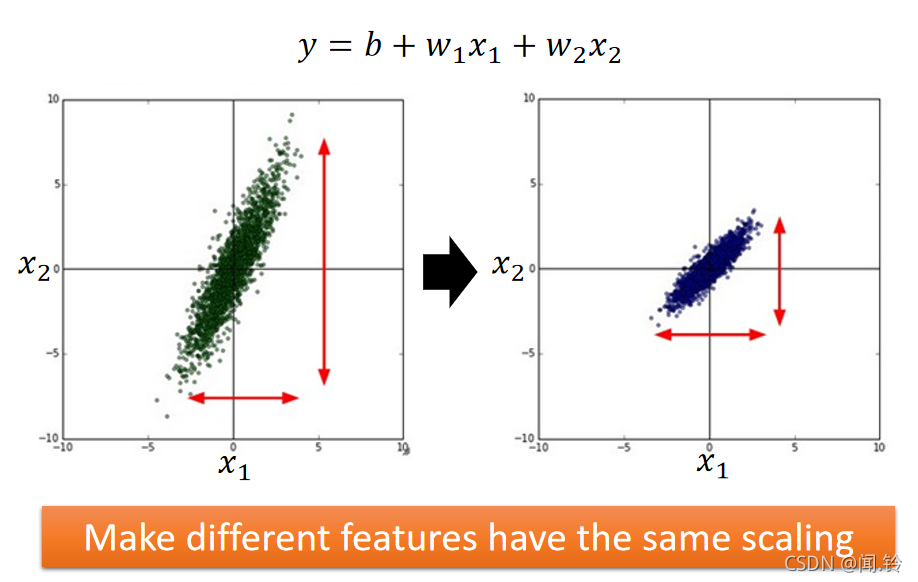

3. Feature Scaling

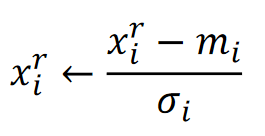

把不同参数的尺度调到一样的大小:mean normalization(均值归一化)

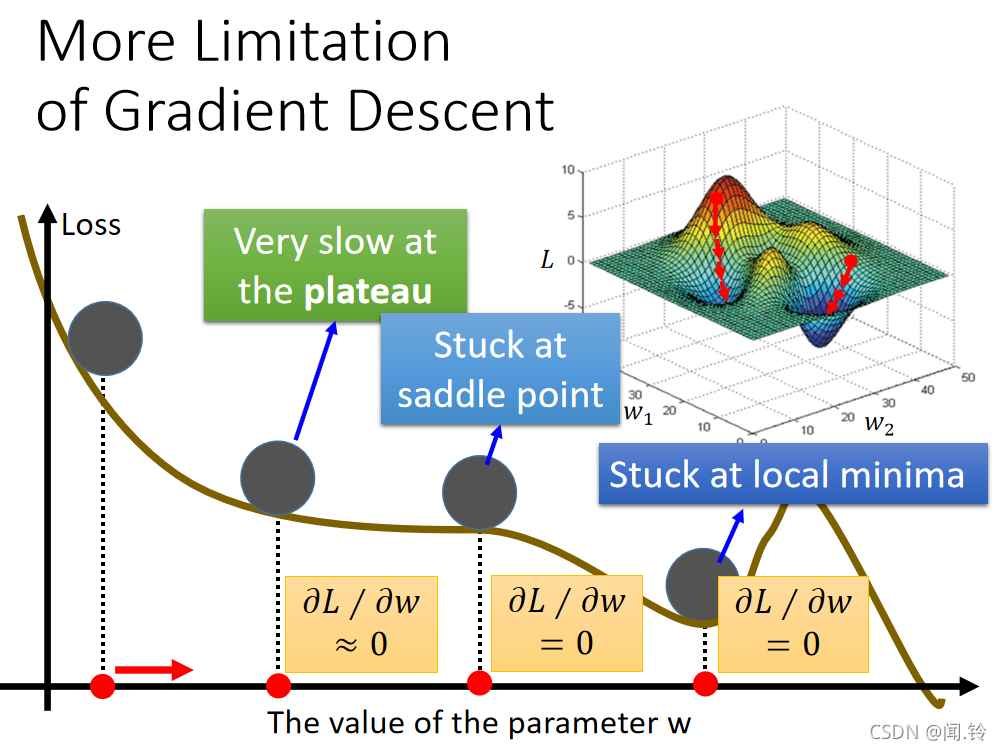

4. 梯度下降的局限

4.1 Very slow at the plateau

4.2 Stuck at saddle point

4.3 Stuck at local minima

本文探讨了三种优化算法在机器学习中的应用:Adagrad通过动态调整学习率来提升训练效果;Stochastic Gradient Descent(SGD)每次迭代仅使用一个样本,加速收敛过程;Feature Scaling通过均值归一化使特征在同一尺度上,确保模型稳定训练。同时,也指出了梯度下降的局限,如平台期速度慢、可能陷入鞍点或局部最小值。

本文探讨了三种优化算法在机器学习中的应用:Adagrad通过动态调整学习率来提升训练效果;Stochastic Gradient Descent(SGD)每次迭代仅使用一个样本,加速收敛过程;Feature Scaling通过均值归一化使特征在同一尺度上,确保模型稳定训练。同时,也指出了梯度下降的局限,如平台期速度慢、可能陷入鞍点或局部最小值。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?