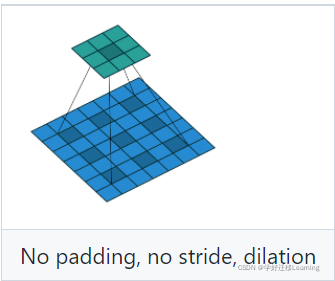

dilation=1,称为空洞卷积,在卷积核相邻像素之间插入一个空白像素。

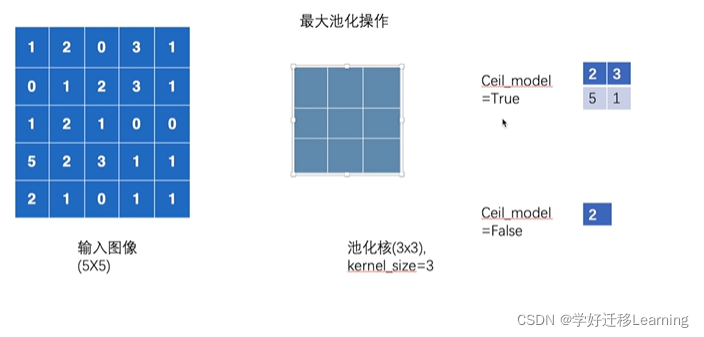

默认池化核:kernel_size = 3

Ceil_model=True or False: 是否对非完整像素进行保留(默认为False)

import torch

import torchvision.datasets

from mmcv import DataLoader

from mmcv.cnn import MaxPool2d

from torch import nn

from torch.utils.tensorboard import SummaryWriter

dataset = torchvision.datasets.CIFAR10(r"C:\Users\123\Desktop\python4.7\test03\data", train=False, download=True,

transform=torchvision.transforms.ToTensor())

dataloader = DataLoader(dataset, batch_size=64)

# input = torch.tensor([[1, 2, 0, 3, 1],

# [0, 1, 2, 3, 1],

# [1, 2, 1, 0, 0],

# [5, 2, 3, 1, 1],

# [2, 1, 0, 1, 1]], dtype=torch.float32) # 经常使用的是浮点数,而这里计算机以为是整数,所以需要变一下

# input = torch.reshape(input, (-1, 1, 5, 5)) # Input: (N, C, H_{in}, W_{in}) N 为batchsize

#

# print(input.shape)

class LR(nn.Module):

def __init__(self):

super(LR, self).__init__()

self.maxpool = MaxPool2d(kernel_size=3, ceil_mode=True)

def forward(self, input):

output = self.maxpool(input)

return output

lrp = LR()

# output = lrp(input)

# print(output)

writer = SummaryWriter("logs_maxpool")

step = 0

for data in dataloader:

imgs, labels = data

writer.add_images("input", imgs, step)

output = lrp(imgs)

writer.add_images("output", output, step)

step = step + 1

writer.close()

本文介绍了如何在PyTorch中使用CIFAR10数据集,并详细讲解了空洞卷积的概念,涉及默认池化核和Ceil_mode选项。通过实例演示了如何创建一个简单的卷积神经网络模型并使用MaxPool2d进行操作。

本文介绍了如何在PyTorch中使用CIFAR10数据集,并详细讲解了空洞卷积的概念,涉及默认池化核和Ceil_mode选项。通过实例演示了如何创建一个简单的卷积神经网络模型并使用MaxPool2d进行操作。

1584

1584

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?