使用Python爬虫从dangxiaoshuo网站爬取小说《从红月开始》

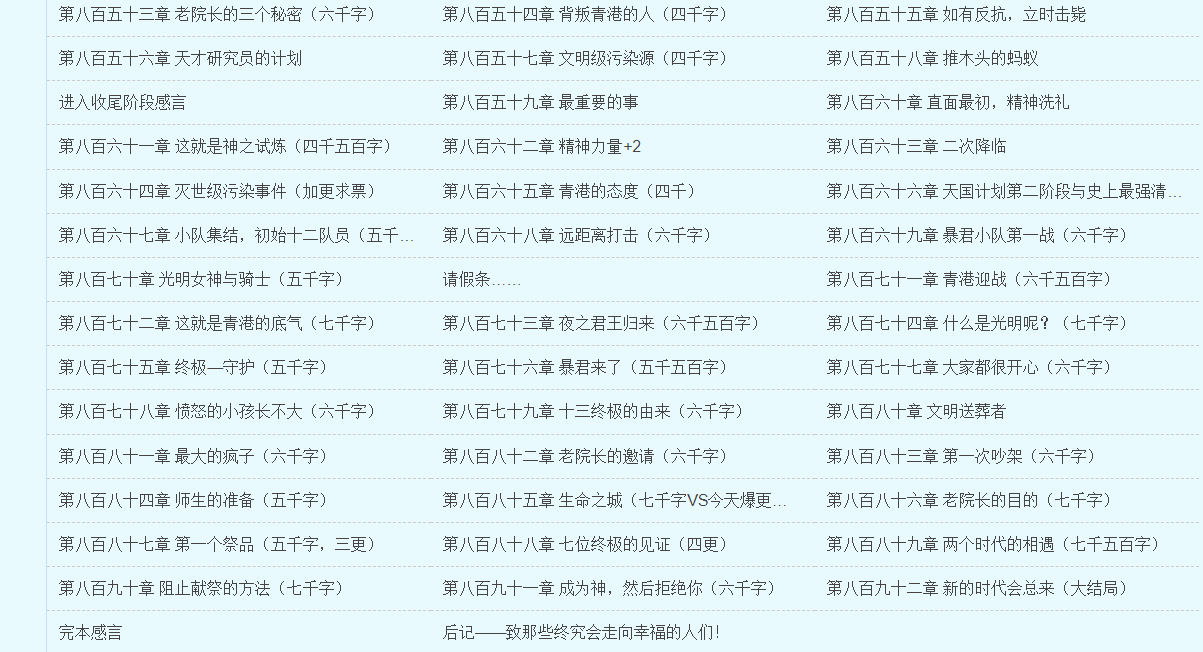

在本教程中,我将为您介绍如何使用Python编写一个简单的爬虫程序,从dangxiaoshuo网站上爬取小说《从红月开始》的全部内容,并将其保存到本地文件中。

1. 准备工作

首先,确保您已经安装好了Python和所需的库。本教程中使用的库包括:re、os、requests和BeautifulSoup。

可以在命令行中使用以下命令来安装缺少的库:

pip install requests

pip install beautifulsoup4

2. 导入所需模块

在编写爬虫之前,首先需要导入所需的模块。打开您的Python编辑器或IDE,并在代码文件的开头添加以下导入语句:

import

本教程介绍了如何使用Python爬虫从dangxiaoshuo网站抓取小说《从红月开始》的所有章节内容,并将其保存到本地。教程涵盖了安装依赖库、设置请求头、获取网页响应、解析内容、爬取存储等步骤,强调了合法和合理使用爬虫的重要性。

本教程介绍了如何使用Python爬虫从dangxiaoshuo网站抓取小说《从红月开始》的所有章节内容,并将其保存到本地。教程涵盖了安装依赖库、设置请求头、获取网页响应、解析内容、爬取存储等步骤,强调了合法和合理使用爬虫的重要性。

订阅专栏 解锁全文

订阅专栏 解锁全文

4634

4634

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?