任务链接:https://github.com/InternLM/Tutorial/blob/camp4/docs/L1/Evaluation/task.md

基础任务

使用 OpenCompass 评测浦语 API 记录复现过程并截图。

使用 OpenCompass 评测 internlm2.5-chat-1.8b 模型在 ceval 数据集上的性能,记录复现过程并截图。

OpenCompass提供了_API模式评测 和本地直接评测 _两种方式。其中 API 模式评测针对那些以 API 服务形式部署的模型,而本地直接评测则面向那些可以获取到模型权重文件的情况。

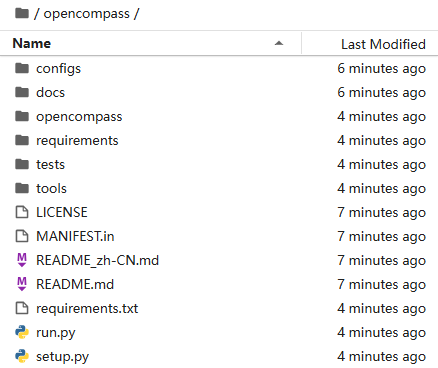

创建评测环境

conda create -n opencompass python=3.10

conda activate opencompass

cd /root

# 克隆0.3.3这个分支的代码

git clone -b 0.3.3 https://github.com/open-compass/opencompass

cd opencompass

pip install -e .

pip install -r requirements.txt

pip install huggingface_hub==0.25.2

1 评测API模型

步骤一:获取浦语API

打开浦语官方地址 https://internlm.intern-ai.org.cn/api/document 获得 api key和api服务地址

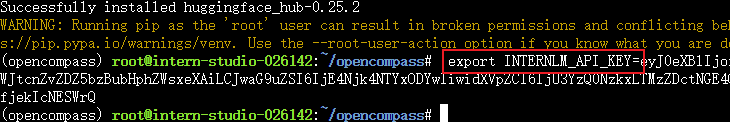

在终端中运行:

export INTERNLM_API_KEY=xxxxxxxxxxxxxxxxxxxxxxx # 填入你申请的 API Key

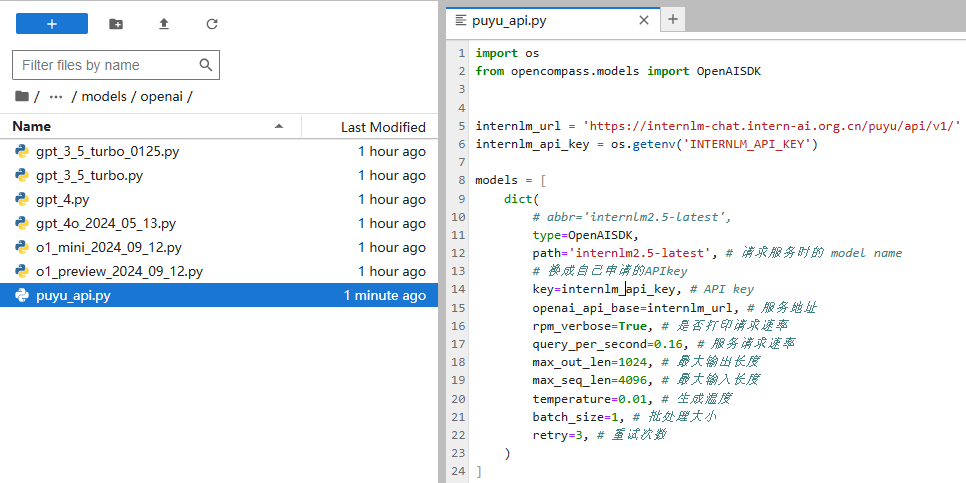

步骤二:配置模型

cd /root/opencompass/

touch opencompass/configs/models/openai/puyu_api.py

打开文件, 贴入以下代码:

import os

from opencompass.models import OpenAISDK

internlm_url = 'https://internlm-chat.intern-ai.org.cn/puyu/api/v1/' # 你前面获得的 api 服务地址

internlm_api_key = os.getenv('INTERNLM_API_KEY')

models = [

dict(

# abbr='internlm2.5-latest',

type=OpenAISDK,

path='internlm2.5-latest', # 请求服务时的 model name

# 换成自己申请的APIkey

key=internlm_api_key, # API key

openai_api_base=internlm_url, # 服务地址

rpm_verbose=True, # 是否打印请求速率

query_per_second=0.16, # 服务请求速率

max_out_len=1024, # 最大输出长度

max_seq_len=4096, # 最大输入长度

temperature=0.01, # 生成温度

batch_size=1, # 批处理大小

retry=3, # 重试次数

)

]

步骤三:配置数据集

cd /root/opencompass/

touch opencompass/configs/datasets/demo/demo_cmmlu_chat_gen.py

打开文件, 贴入以下代码:

from mmengine import read_base

with read_base():

from ..cmmlu.cmmlu_gen_c13365 import cmmlu_datasets

# 每个数据集只取前1个样本进行评测

for d in cmmlu_datasets:

d['abbr'] = 'demo_' +<

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1900

1900

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?