研究背景

对抗训练是目前最有效的提升深度学习模型鲁棒性的方法。但问题在于对抗训练后常常会伴随着原始样本分类正确率的下降,这是对抗训练存在的一大问题。

主要贡献

- 本文分析了对抗训练导致原始样本分类正确率下降的主要原因

- 本文提出了一种新的对抗训练方法,在模型对抗鲁棒性持平的情况下提升原始样本的分类正确率

主要方法

1、对抗训练对于原始样本分类的影响

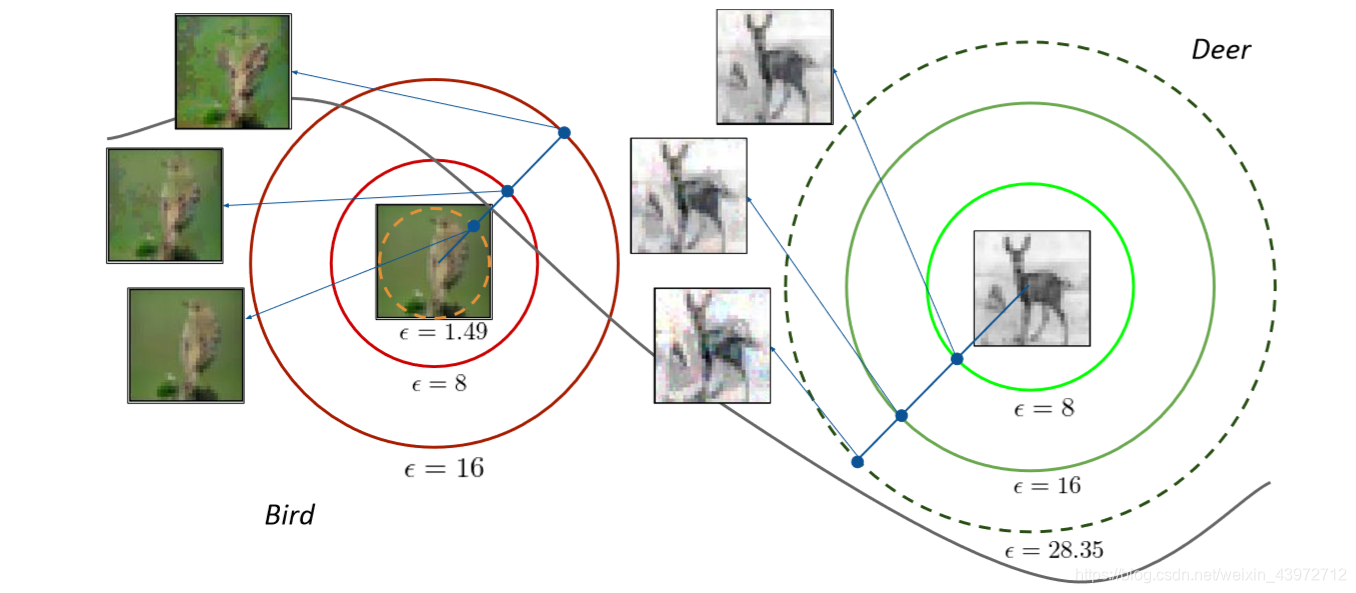

本文提出,目前所有的对抗训练都是固定了噪声大小,例如规定噪声 L ∞ L_{\infty } L∞<=16.0等。但这会导致某些样本被过度影响,有些样本则远远没有达到受影响的程度。

如上图所示,在 ϵ \epsilon ϵ为8的时候,分类为bird的样本已经跨越决策边界成为对抗样本,而分类为deer的样本则在 ϵ \epsilon

本文分析了对抗训练导致的原始样本分类正确率下降的原因,并提出实例自适应对抗训练方法,该方法根据每个样本特性调整对抗样本的生成,从而在提升模型对抗鲁棒性的同时,保持或提高原始样本的分类准确率。实验结果显示,新方法在原始样本和对抗样本分类正确率上均有所提升。

本文分析了对抗训练导致的原始样本分类正确率下降的原因,并提出实例自适应对抗训练方法,该方法根据每个样本特性调整对抗样本的生成,从而在提升模型对抗鲁棒性的同时,保持或提高原始样本的分类准确率。实验结果显示,新方法在原始样本和对抗样本分类正确率上均有所提升。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?