pytorch学习笔记(九)————交叉熵

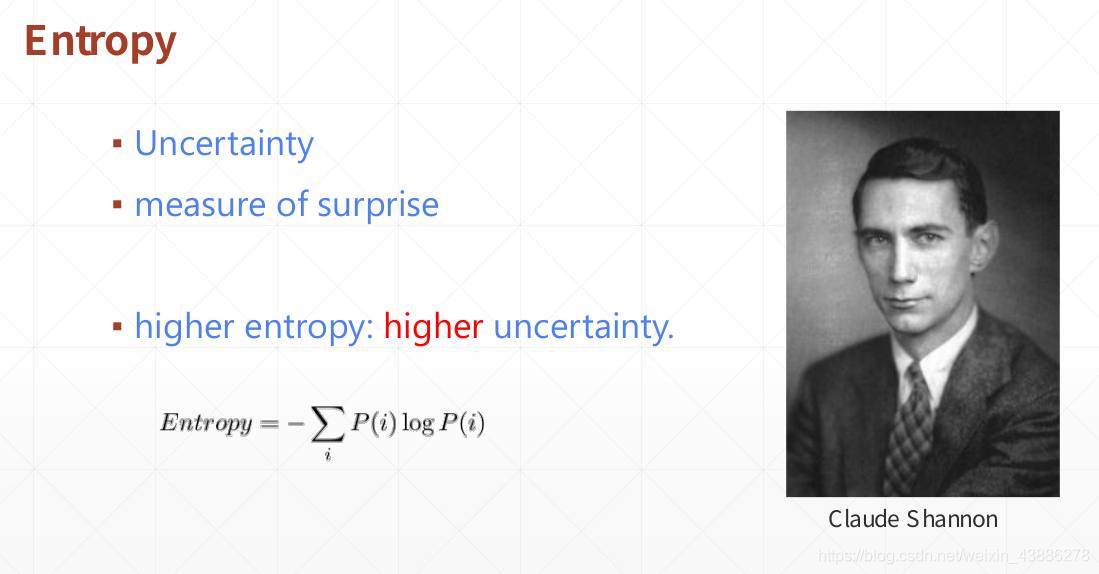

(1)熵的定义

熵(Entropy)代表事件所包含的不确定性,也叫作惊喜度。熵越高则代表事件的不确定性越高,具体原因可参考博客:https://blog.youkuaiyun.com/am290333566/article/details/81187124

举个例子:

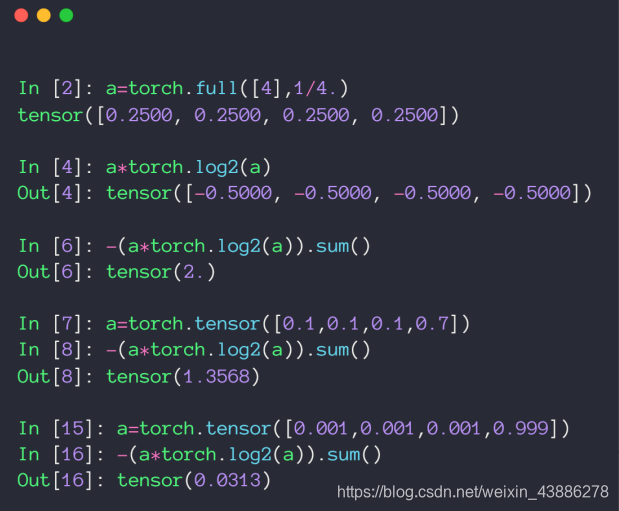

1.假如有四个事件,发生的概率都是0.25,也就是说这四个事件发生的概率一样,很难在一开始就预测到哪个事件会发生,包含的不确定性因素非常大。所以此时计算出的信息熵非常高。

2.若四个事件有三个发生概率小,一个事件发生概率大,那么我们可以大胆的预测这个概率大的事件会发生,因此不确定性小,信息熵也就小。

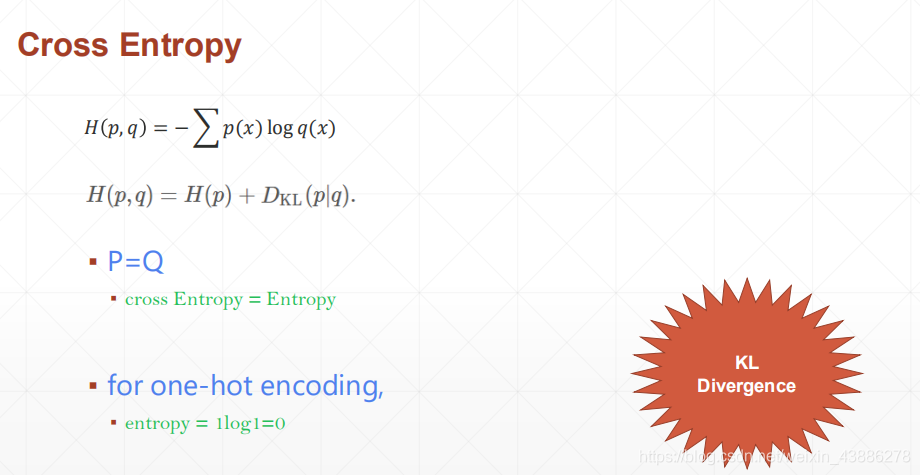

(2)引入交叉熵

考虑一种情况,对于一个样本集,存在两个概率分布 p ( x ) p(x) p(x)和 q ( x ) q(x) q(x),其中 p ( x ) p(x) p(x) 为真实分布, q ( x ) q(x) q(x)为非真实分布。基于真实分布 p ( x ) p(x) p(x)我们可以计算这个样本集的信息熵也就是编码长度的期望为:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1735

1735

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?