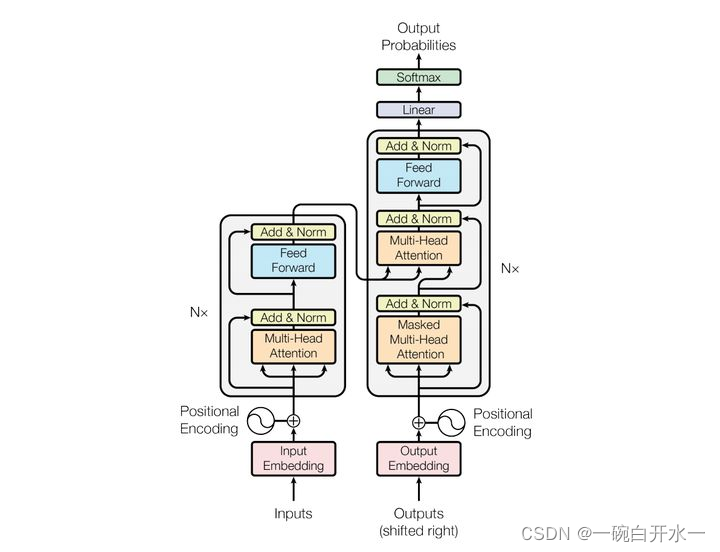

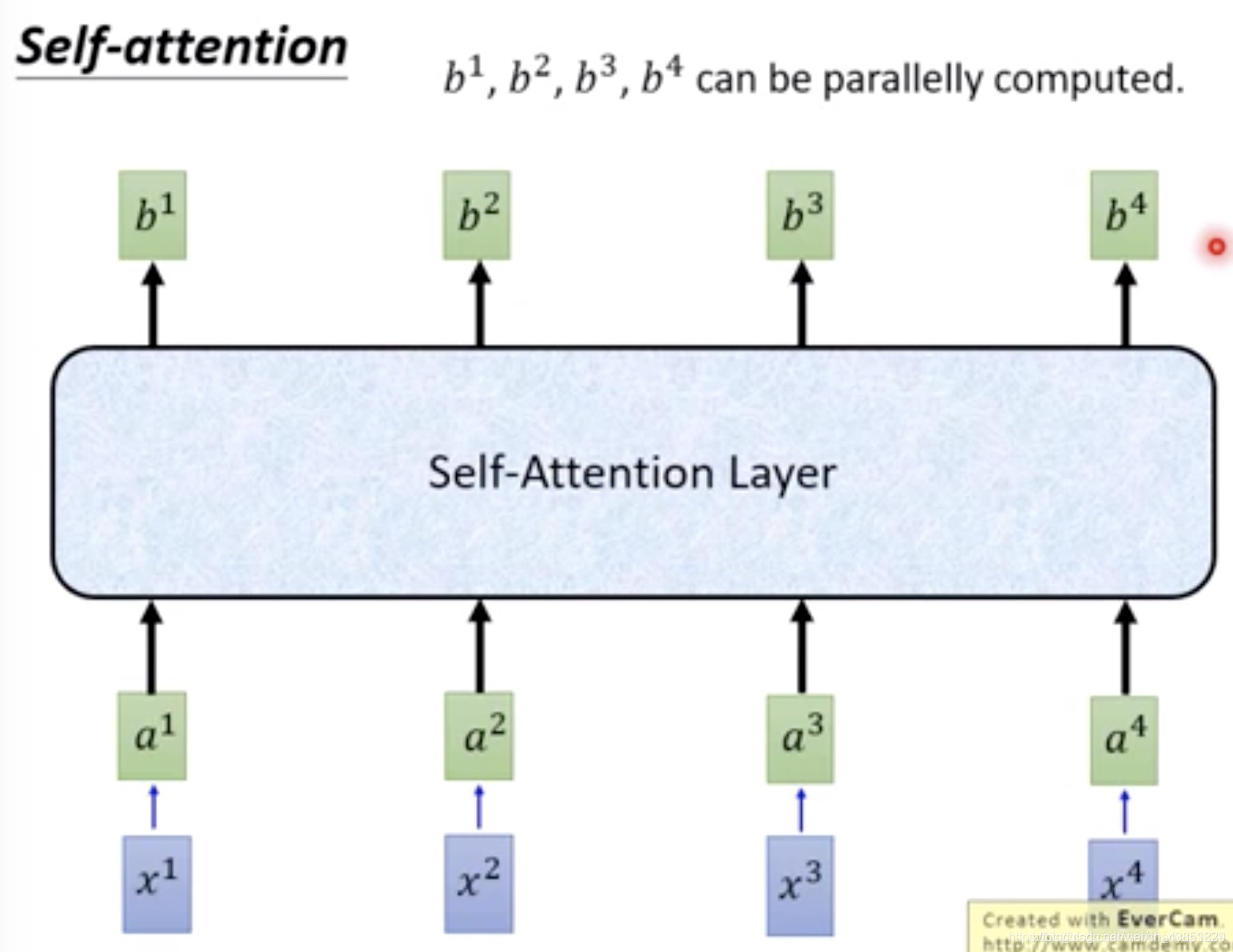

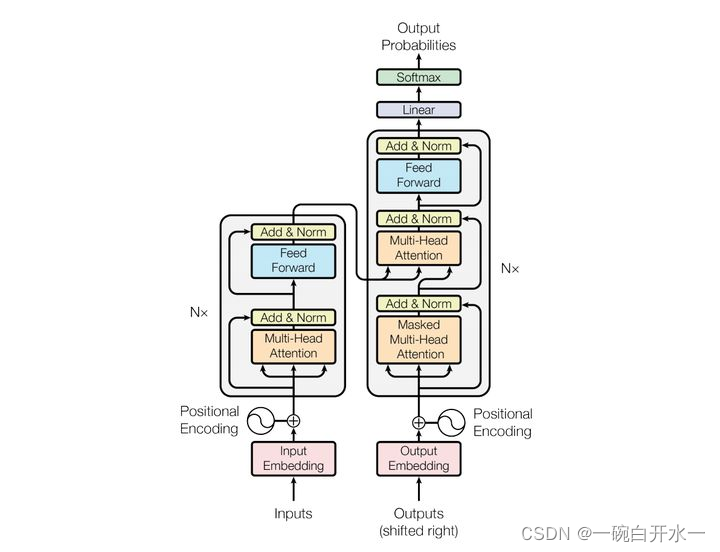

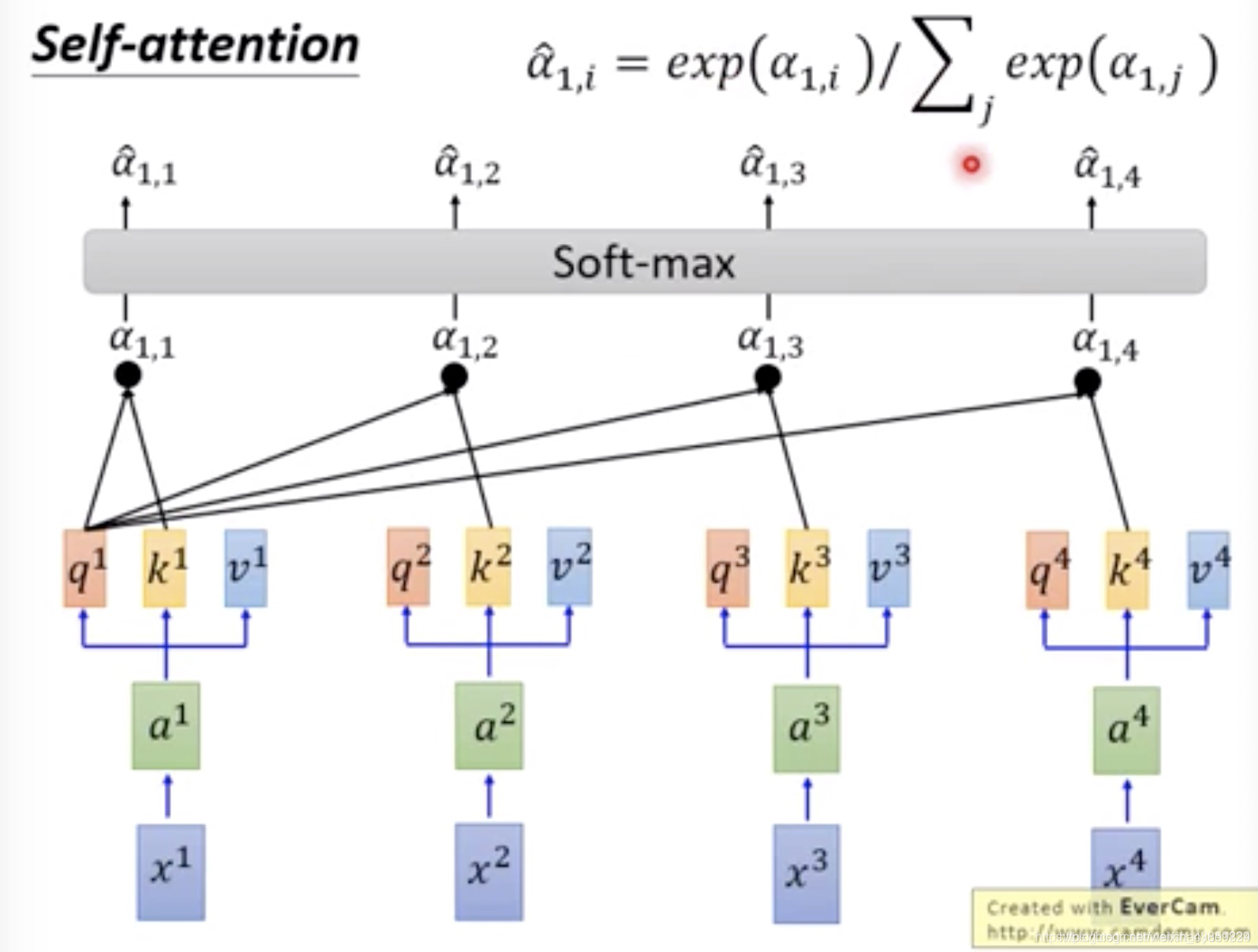

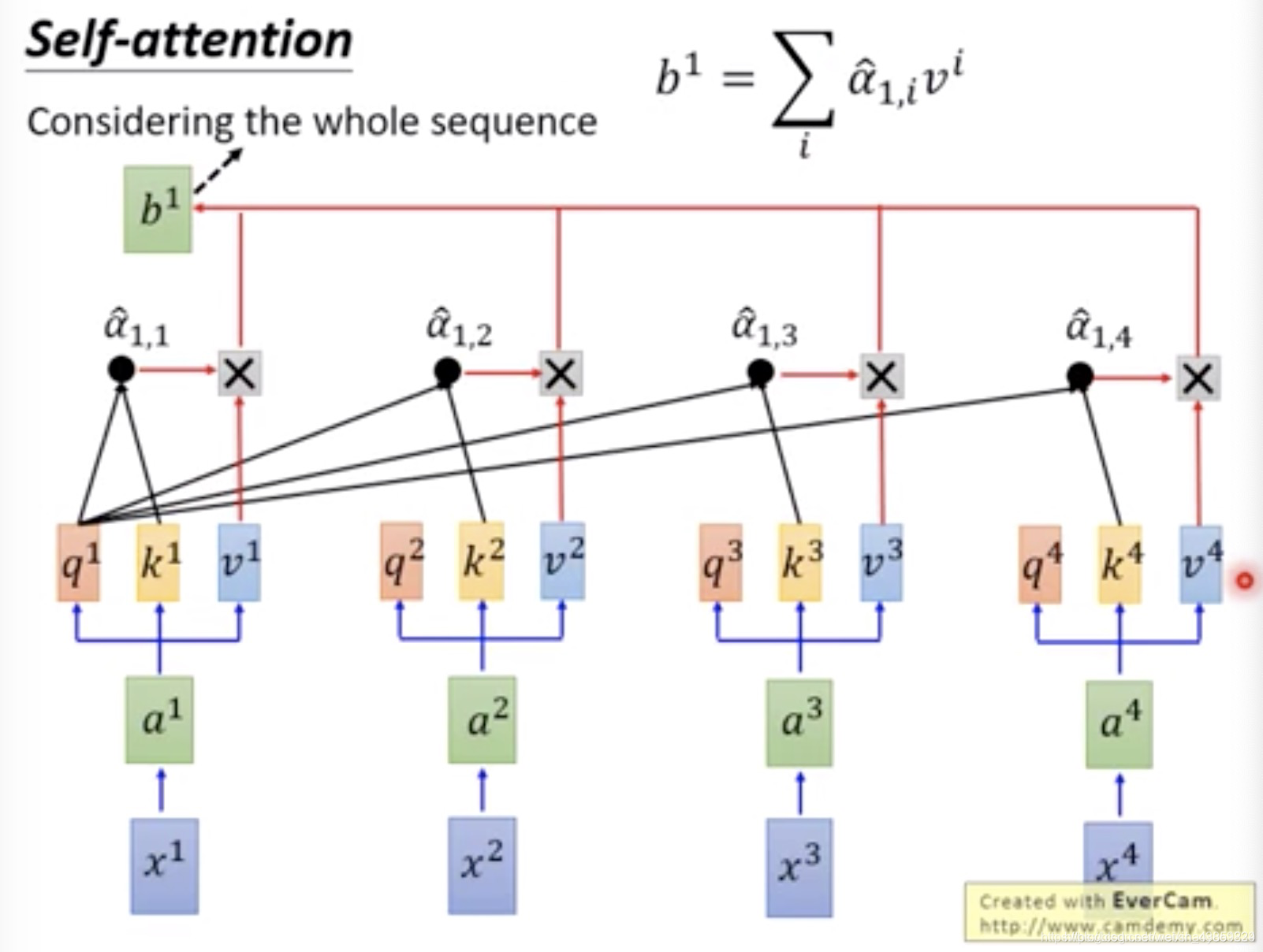

首先被google提出的 transformer is all you need 中提出的。图出自李宏毅老师ppt.

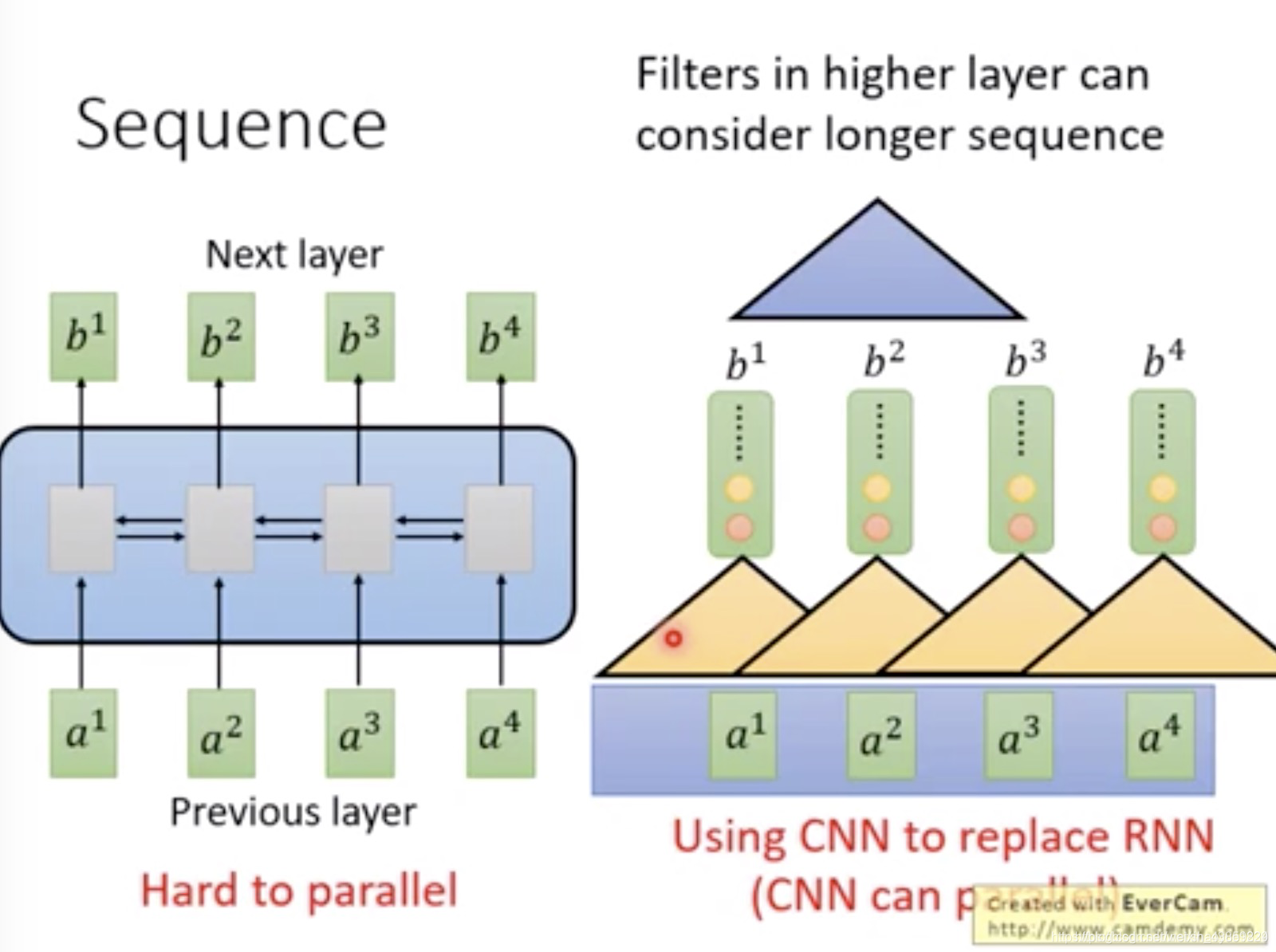

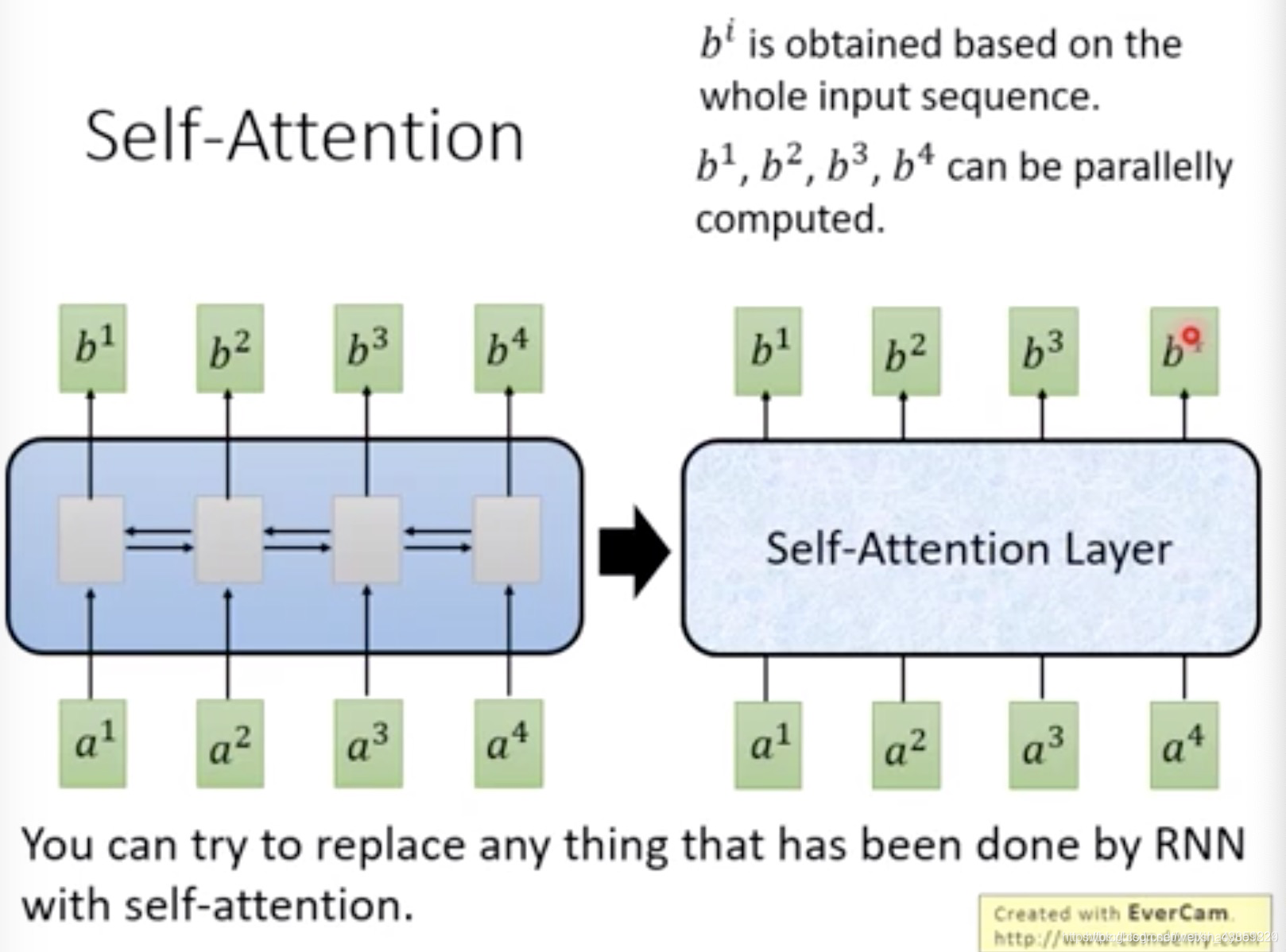

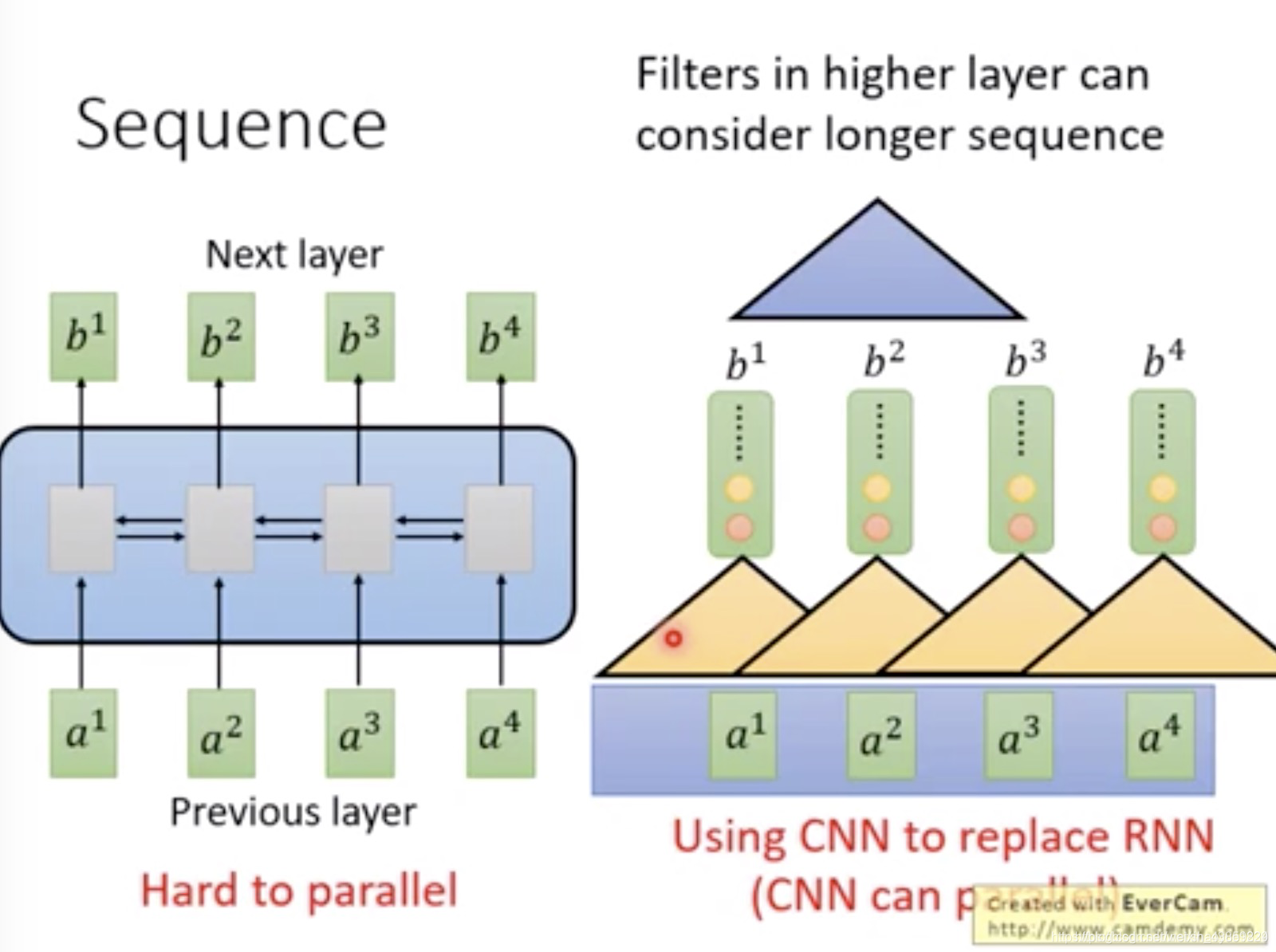

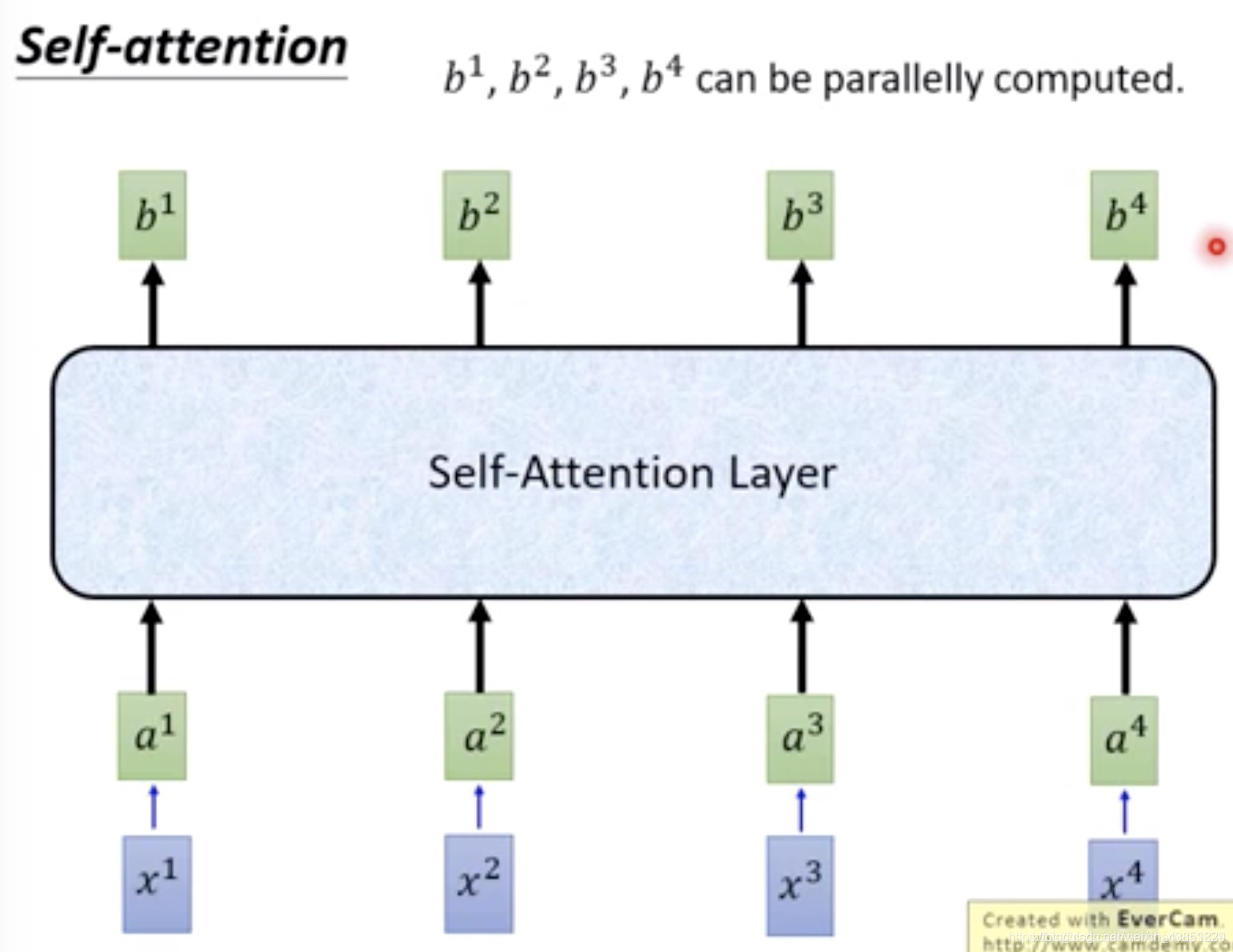

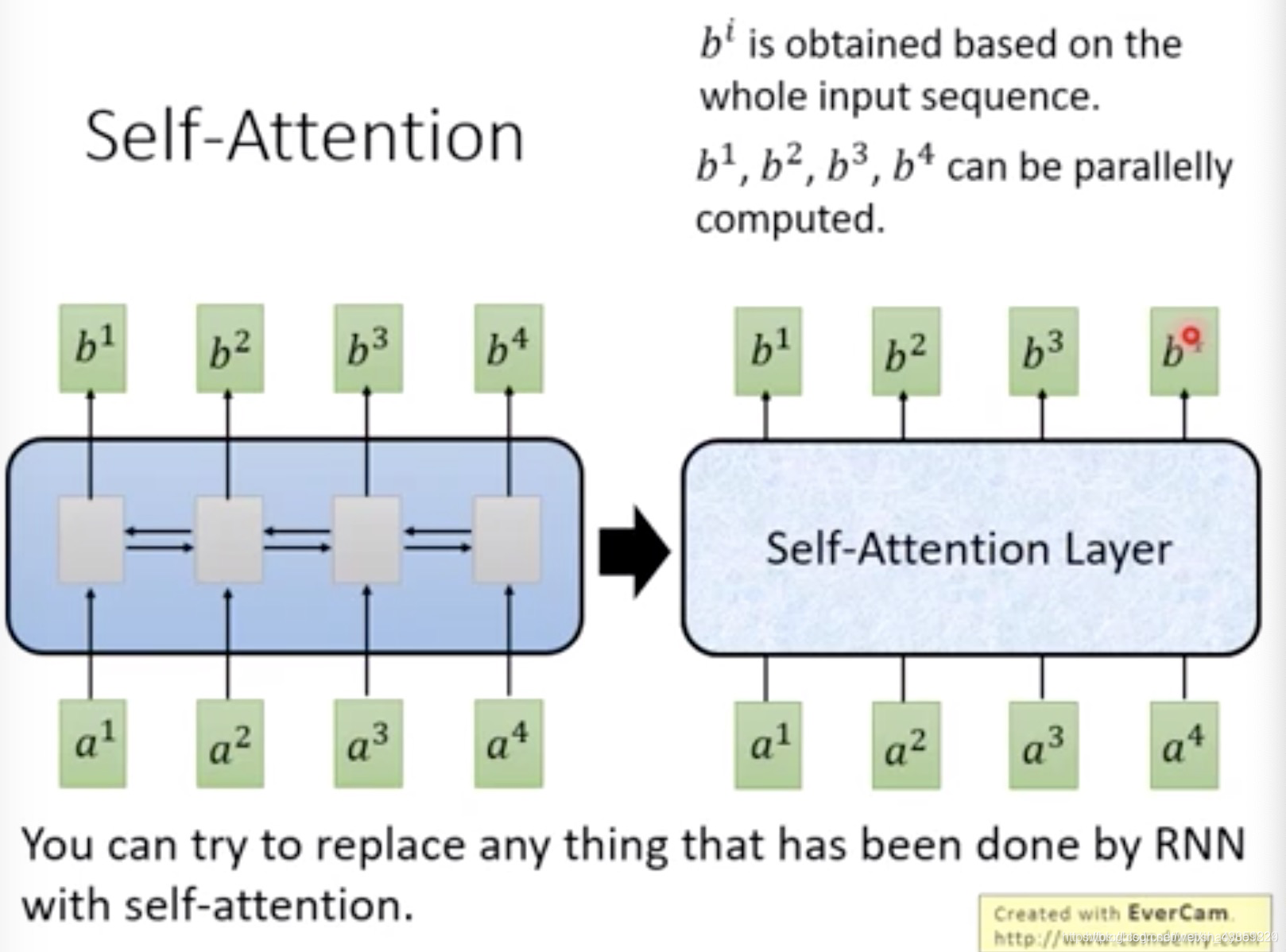

对于有时序的模型来说,RNN 是需要依靠前/后的信息,不能并行处理。Transformer 则采用CNN 替换rnn来实现并行处理。

对于有时序的模型来说,RNN 是需要依靠前/后的信息,不能并行处理。Transformer 则采用CNN 替换rnn来实现并行处理。

首先被google提出的 transformer is all you need 中提出的。图出自李宏毅老师ppt.

对于有时序的模型来说,RNN 是需要依靠前/后的信息,不能并行处理。Transformer 则采用CNN 替换rnn来实现并行处理。

对于有时序的模型来说,RNN 是需要依靠前/后的信息,不能并行处理。Transformer 则采用CNN 替换rnn来实现并行处理。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?