import com.alibaba.fastjson.{JSON, JSONObject}

import org.apache.spark.SparkConf

import scala.collection.JavaConversions._

import org.apache.spark.sql.{Dataset, Row, SparkSession}

import scala.collection.Seq

import org.apache.spark.sql.functions.{col, from_json}

import org.apache.spark.sql.types.StructType

val ssc=SparkSession.builder().appName("testspark").master("local[2]").getOrCreate();

import ssc.implicits._

val otherPeopleDataset = ssc.createDataset(

"""{"name":"Yin","address":{"city":"Columbus","state":"Ohio"}}""" :: Nil)

val otherPeople = ssc.read.json(otherPeopleDataset)

otherPeople.show()

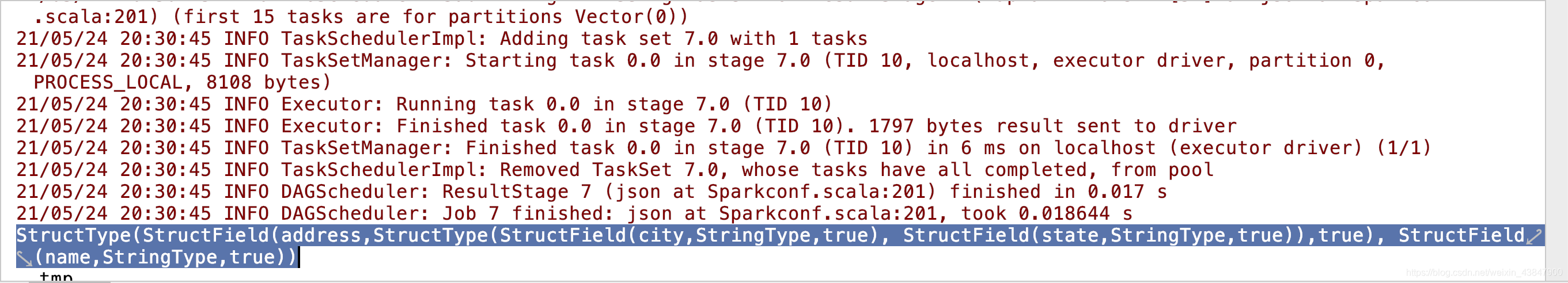

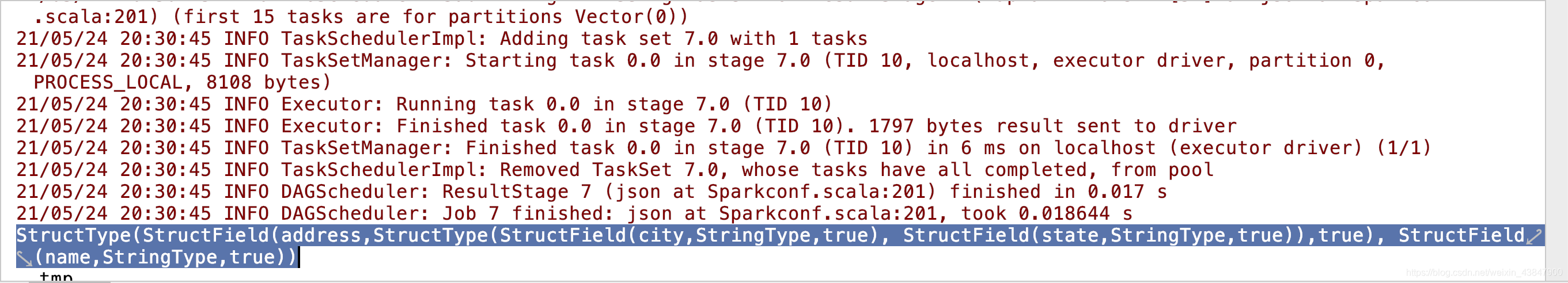

val schema = ssc.read.json(otherPeopleDataset).schema

println(schema)

本文介绍如何使用 Apache Spark 处理 JSON 数据格式,包括创建 Dataset、读取 JSON 数据并展示其内容,同时展示了如何获取 JSON 数据的 Schema 结构。

本文介绍如何使用 Apache Spark 处理 JSON 数据格式,包括创建 Dataset、读取 JSON 数据并展示其内容,同时展示了如何获取 JSON 数据的 Schema 结构。

197

197

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?